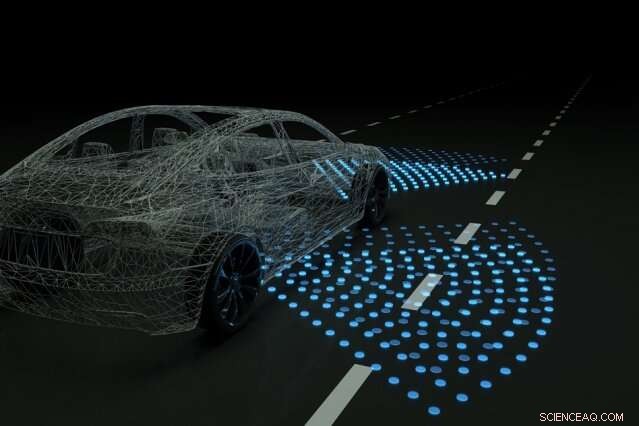

System træner førerløse biler i simulering, før de kører på vejen

Et simuleringssystem opfundet på MIT til at træne førerløse biler skaber en fotorealistisk verden med uendelige styremuligheder, hjælper bilerne med at lære at navigere i et væld af værre tilfælde, før de kører ned ad rigtige gader. Kredit:Massachusetts Institute of Technology

Et simuleringssystem opfundet på MIT til at træne førerløse biler skaber en fotorealistisk verden med uendelige styremuligheder, hjælpe bilerne med at lære at navigere i et væld af værre scenarier, inden de krydser ad rigtige gader.

Kontrolsystemer, eller "controllere, " for autonome køretøjer er i vid udstrækning afhængige af datasæt fra den virkelige verden af kørebaner fra menneskelige chauffører. Ud fra disse data, de lærer, hvordan man efterligner sikre styrestyringer i en række forskellige situationer. Men virkelige data fra farlige "edge cases, "såsom næsten at gå ned eller blive tvunget af vejen eller ind i andre baner, er - heldigvis - sjældne.

Nogle computerprogrammer, kaldet "simuleringsmotorer, " sigter på at efterligne disse situationer ved at gengive detaljerede virtuelle veje for at hjælpe med at træne controllerne til at komme sig. Men den lærte kontrol fra simulering har aldrig vist sig at overføres til virkeligheden på et fuldskala køretøj.

MIT-forskerne tackler problemet med deres fotorealistiske simulator, kaldet Virtual Image Synthesis and Transformation for Autonomy (VISTA). Det bruger kun et lille datasæt, fanget af mennesker, der kører på en vej, at syntetisere et praktisk talt uendeligt antal nye synspunkter fra baner, som køretøjet kunne tage i den virkelige verden. Controlleren belønnes for den distance, den tilbagelægger uden at styrte, så den må lære af sig selv, hvordan man sikkert når frem til en destination. Derved, køretøjet lærer at navigere sikkert i enhver situation, det støder på, herunder genvinde kontrollen efter at have svinget mellem vognbanerne eller komme sig efter næsten-ulykker.

I test, en controller uddannet i VISTA-simulatoren sikkert var i stand til at blive sikkert indsat på en fuldskala førerløs bil og navigere gennem hidtil usete gader. Ved at placere bilen i terrængående retninger, der efterlignede forskellige situationer med næsten uheld, controlleren var også i stand til at genoprette bilen tilbage i en sikker kørebane inden for få sekunder. Et papir, der beskriver systemet, er blevet offentliggjort i IEEE Robotics and Automation Letters og vil blive præsenteret på den kommende ICRA-konference i maj.

"Det er svært at indsamle data i disse randsager, som mennesker ikke oplever på vejen, " siger førsteforfatter Alexander Amini, en ph.d. studerende i datalogi og kunstig intelligenslaboratorium (CSAIL). "I vores simulering, imidlertid, kontrolsystemer kan opleve disse situationer, lære selv at komme sig fra dem, og forbliv robust, når den installeres på køretøjer i den virkelige verden."

Arbejdet blev udført i samarbejde med Toyota Research Institute. Tilslutter sig Amini på papiret er Igor Gilitschenski, en postdoc i CSAIL; Jacob Phillips, Julia Moseyko, og Rohan Banerjee, alle bachelorer i CSAIL og Institut for Elektroteknik og Datalogi; Sertac Karaman, en lektor i luftfart og astronautik; og Daniela Rus, direktør for CSAIL og Andrew og Erna Viterbi professor i elektroteknik og datalogi.

Datadrevet simulering

Historisk set at bygge simuleringsmotorer til træning og test af autonome køretøjer har stort set været en manuel opgave. Virksomheder og universiteter ansætter ofte teams af kunstnere og ingeniører til at skitsere virtuelle miljøer, med nøjagtige vejafmærkninger, baner, og endda detaljerede blade på træer. Nogle motorer kan også inkorporere fysikken i en bils interaktion med omgivelserne, baseret på komplekse matematiske modeller.

Men da der er så mange forskellige ting at overveje i komplekse miljøer i den virkelige verden, det er praktisk talt umuligt at inkorporere alt i simulatoren. Af den grund, der er normalt et misforhold mellem, hvad controllere lærer i simulering, og hvordan de fungerer i den virkelige verden.

I stedet, MIT-forskerne skabte det, de kalder en "datadrevet" simuleringsmotor, der syntetiserer, fra reelle data, nye baner i overensstemmelse med vejens udseende, samt afstanden og bevægelsen af alle objekter i scenen.

De indsamler først videodata fra et menneske, der kører ned ad et par veje og fører det ind i motoren. For hver ramme, motoren projekterer hver pixel i en type 3-D-punktsky. Derefter, de placerer et virtuelt køretøj inde i den verden. Når bilen udfører en styrekommando, motoren syntetiserer en ny bane gennem punktskyen, baseret på styrekurven og køretøjets orientering og hastighed.

Derefter, motoren bruger den nye bane til at gengive en fotorealistisk scene. For at gøre det, den bruger et konvolutionsnervalt netværk-normalt brugt til billedbehandlingsopgaver-til at estimere et dybdekort, som indeholder oplysninger om afstanden mellem objekter set fra controllerens synspunkt. Det kombinerer derefter dybdekortet med en teknik, der estimerer kameraets orientering i en 3-D-scene. Det hjælper alle med at lokalisere køretøjets placering og relative afstand til alt inden for den virtuelle simulator.

Baseret på disse oplysninger, det omorienterer de originale pixels for at genskabe en 3D-repræsentation af verden fra bilens nye synspunkt. Det sporer også bevægelsen af pixels for at fange bevægelsen af biler og mennesker, og andre bevægelige objekter, i scenen. "Dette svarer til at give køretøjet et uendeligt antal mulige baner, " siger Rus. "For når vi indsamler fysiske data, vi får data fra den specifikke bane, bilen vil følge. Men vi kan ændre den bane, så den dækker alle mulige måder og miljøer at køre på. Det er virkelig stærkt."

Forstærkende læring fra bunden

Traditionelt, forskere har trænet selvkørende køretøjer ved enten at følge menneskets definerede køreregler eller ved at forsøge at efterligne menneskelige chauffører. Men forskerne får deres controller til at lære helt fra bunden under en "ende-til-ende"-ramme, hvilket betyder, at det kun tager rå sensordata som input – såsom visuelle observationer af vejen – og, fra disse data, forudsiger styrekommandoer ved udgange.

"Vi siger dybest set 'Her er et miljø. Du kan gøre, hvad du vil. Bare lad være med at køre ind i biler, og bliv inden for banerne, " siger Amini.

Dette kræver "forstærkningslæring" (RL), en trial-and-error maskinlæringsteknik, der giver feedback-signaler, når bilen laver en fejl. I forskernes simuleringsmotor, controlleren begynder med at vide intet om hvordan man kører, hvad en vognbanemarkør er, eller endda andre køretøjer ser ud, så det begynder at udføre tilfældige styrevinkler. Den får kun et feedback-signal, når den går ned. På det tidspunkt, den bliver teleporteret til en ny simuleret placering og skal udføre et bedre sæt styrevinkler for at undgå at gå ned igen. Over 10 til 15 timers træning, den bruger disse sparsomme feedback-signaler til at lære at rejse længere og længere afstande uden at gå ned.

Efter succesfuld kørsel 10, 000 kilometer i simulering, forfatterne anvender den lærte controller på deres fuldskala autonome køretøj i den virkelige verden. Forskerne siger, at det er første gang, at en controller, der er uddannet i end-to-end-forstærkningslæring i simulering, er blevet succesfuldt indsat på en autonom bil i fuld skala. "Det var overraskende for os. Ikke alene har controlleren aldrig været på en rigtig bil før, men den har heller aldrig selv set vejene før og har ingen forudgående viden om, hvordan mennesker kører, " siger Amini.

Ved at tvinge controlleren til at køre igennem alle former for kørescenarier gjorde den i stand til at genvinde kontrollen fra desorienterende positioner - f.eks. At være halvvejs fra vejen eller ind i en anden vognbane - og styre tilbage i den korrekte vognbane inden for flere sekunder. "Og andre state-of-the-art controllere mislykkedes alle tragisk, fordi de aldrig har set sådanne data på træning, " siger Amini.

Næste, forskerne håber at simulere alle typer vejforhold fra en enkelt kørebane, som nat og dag, og solrigt og regnfuldt vejr. De håber også at simulere mere komplekse interaktioner med andre køretøjer på vejen. "Hvad hvis andre biler begynder at bevæge sig og hopper foran køretøjet?" siger Rus. "De er komplekse, interaktioner i den virkelige verden, vi vil begynde at teste."

Varme artikler

Varme artikler

-

Forskning viser fortsat fremgang inden for DNA-databehandlingKredit:CC0 Public Domain For de uindviede inden for biologisk databehandling, det ZDNet overskriften kan have foreslået et sprogbehandlingseksperiment, der er gået galt:Reagensglas-DNA-computer

Forskning viser fortsat fremgang inden for DNA-databehandlingKredit:CC0 Public Domain For de uindviede inden for biologisk databehandling, det ZDNet overskriften kan have foreslået et sprogbehandlingseksperiment, der er gået galt:Reagensglas-DNA-computer -

Metanbaserede brændstoffer til transport- og energisektorenMethQuest fokuserer på at bruge metan fra vedvarende kilder til forskellige applikationer. Kredit:MethQuest Hovedprojektet Methan fra vedvarende kilder i mobile og stationære applikationer (MethQu

Metanbaserede brændstoffer til transport- og energisektorenMethQuest fokuserer på at bruge metan fra vedvarende kilder til forskellige applikationer. Kredit:MethQuest Hovedprojektet Methan fra vedvarende kilder i mobile og stationære applikationer (MethQu -

Nyt materiale peger mod højeffektive solcellerKredit:Purdue University En ny type materiale til næste generations solceller eliminerer behovet for at bruge bly, som har været en stor blokering for denne teknologi. Solceller, inkorporering af

Nyt materiale peger mod højeffektive solcellerKredit:Purdue University En ny type materiale til næste generations solceller eliminerer behovet for at bruge bly, som har været en stor blokering for denne teknologi. Solceller, inkorporering af -

Vær sikker, og fornuftig, da Silicon Valley låser sig for virusMartha Lackritz-Peltier, advokat hos TechSoup, arbejder fra hendes stue i Oakland, Californien, på grund af de coronavirus-relaterede foranstaltninger truffet af hendes organisation David Tollner

Vær sikker, og fornuftig, da Silicon Valley låser sig for virusMartha Lackritz-Peltier, advokat hos TechSoup, arbejder fra hendes stue i Oakland, Californien, på grund af de coronavirus-relaterede foranstaltninger truffet af hendes organisation David Tollner

- Sophos-producenten af antivirussoftware accepterer at overtage 3,1 mia. pund

- At styrte eller svinge? Undersøgelse afslører, hvilke handlinger foretaget af selvkørende biler, …

- Mindre vand gavnligt i biogasproduktion

- Fakta om Zebra Babies

- Sætte gas under tryk

- Mørk energiundersøgelse frigiver det mest præcise kig på universets udvikling