Forskningssamfundet kan tage på Facebook AIs NYC-samtaletur

Kredit:FB

Jason Weston, med doktorgrad i maskinlæring ved University of London og Douwe Kiela, med doktorgrad fra University of Cambridge med afhandling om jording af semantik i perceptuelle modaliteter, er forskere hos Facebook Research og har introduceret verden til deres formidable teams Talk the Walk.

Talk the Walk er en øjenåbner for forskere, der er interesseret i at gøre mere for AI som samtaleagent. Disse dage, de glæder sig ikke bare over stemmeassistenter, der fortæller folk, hvornår koncerten starter, eller om det vil regne. Forskere udforsker målrettede dialoger.

Hvor nemt lyder det? Lad være med at narre dig selv. At prøve at nå dertil er svært.

Hurtigt selskab henvendte sig til Kiela af årsager til, at turistguideindsatsen har forskningsmæssig vægt. "Denne opgave er meget vigtig for AI-forskning, fordi den er meget svær, "Kiela siger, "og fordi det kombinerer alle disse interessante problemer - tre hundrede-tres visuel perception, kortbaseret navigation, visuel ræsonnement, og naturlig sprogkommunikation via dialog."

De gjorde pointen, først, at naturligt sprog er forståeligt for de fleste mennesker "uden at det kræver ekstra trin eller viden for at tyde dets betydning." Til det formål, Facebooks AI-forskningsgruppe, RETFÆRDIG, er hooked på en bestemt strategi for AI for at vise sprogforståelse på menneskeligt niveau.

Den strategi, de skrev, "er at træne disse systemer på en mere naturlig måde, ved at binde sproget til bestemte miljøer. Ligesom babyer først lærer at navngive, hvad de kan se og røre ved, denne tilgang – nogle gange omtalt som embodied AI – favoriserer læring i sammenhæng med et systems omgivelser, snarere end at træne gennem store datasæt af tekst (som Wikipedia)."

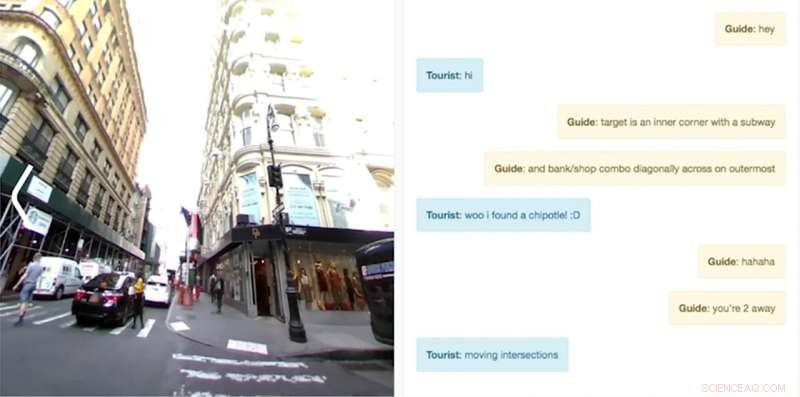

Indtast Talk the Walk. De lærer AI-systemer at navigere i New Yorks gader ved hjælp af sprogudvekslinger, der lyder naturlige mellem guide og turist. To bots har opgaver. Turistboten ønsker at navigere sig gennem 360-graders billeder af New York City-kvarterer. Guideboten skal hjælpe med et kort over nabolaget. Holdet brugte MASC (Masked Attention for Spatial Convolution), så guideboten kunne fokusere på det rigtige sted på kortet.

De sagde, at deres mål er "at opnå den høje grad af syntetisk ydeevne gennem naturligt sproginteraktion, og at udfordre samfundet til at gøre det samme."

Information til Talk the Walk er på GitHub. "At dele dette arbejde vil give andre forskere en ramme til at teste deres egne indbyggede AI-systemer, især med hensyn til dialog."

Et 360-graders kamera fangede 5 kvarterer, Helveds køkken, East Village, Finansdistrikt, Upper East Side, og Williamsburg i Brooklyn. Daniel Terdiman i Hurtigt selskab sagde, at guideboten brugte et standard 2D-kort med generiske waypoints - "bank, " "kaffebar, " "delikatesseforretning" – for at levere dens instruktioner om, hvordan man navigerer.

Det involverede AI-arbejde handler om at opfatte et bestemt miljø, navigerer gennem det, og kommunikere om det. Lucas Matney ind TechCrunch skrev, at "I "Talk the Walk, "guide-AI-bot'en havde alle disse 2D-kortdata, og turistbotten havde alle disse rige 360 visuelle data, men det var kun gennem kommunikation med hinanden, at de var i stand til at udføre deres direktiver."

Turist:Woo jeg fandt en Chipotle

Guide:Haha

Turist:"Jeg er diagonal fra en bank"

Guide:"Cool."

Papiret, der diskuterer deres arbejde, kan findes på arXiv. Den har titlen "Talk the Walk:Navigating New York City through Grounded Dialogue, " af Harm de Vries, Kurt Shuster, Dhruv Batra, Devi Parikh, Jason Weston og Douwe Kiela.

© 2018 Tech Xplore

Sidste artikelKunstig intelligens hjælper med at designe en ultra-aerodynamisk cykel

Næste artikelKøling af bygninger verden over

Varme artikler

Varme artikler

-

Magic Leap One er her endelig! Og det koster $2, 295Magic Leap One er endelig lanceret. Efter måneders meddelelser, forventning, og flere online demopræsentationer, der fremkaldte blandede anmeldelser, den hemmelighedsfulde Plantation-baserede teknolo

Magic Leap One er her endelig! Og det koster $2, 295Magic Leap One er endelig lanceret. Efter måneders meddelelser, forventning, og flere online demopræsentationer, der fremkaldte blandede anmeldelser, den hemmelighedsfulde Plantation-baserede teknolo -

Fra kontante værelseskammerater til Airbnb-milliardærerDeleøkonomi-stjernen Airbnb har sendt rystelser gennem hotelbranchen For et årti siden besluttede et par værelseskammerater i San Francisco at tjene penge ved at bruge luftmadrasser til at forvand

Fra kontante værelseskammerater til Airbnb-milliardærerDeleøkonomi-stjernen Airbnb har sendt rystelser gennem hotelbranchen For et årti siden besluttede et par værelseskammerater i San Francisco at tjene penge ved at bruge luftmadrasser til at forvand -

Amazon-arbejderes medianløn i 2017:$28, 446Amazon siger, at dens gennemsnitlige medarbejderløn var $28, 446 sidste år. Disse data, afsløret onsdag i Amazons årlige proxy-rapport, er en påmindelse om, at mens teknologerne, forretningsledere og

Amazon-arbejderes medianløn i 2017:$28, 446Amazon siger, at dens gennemsnitlige medarbejderløn var $28, 446 sidste år. Disse data, afsløret onsdag i Amazons årlige proxy-rapport, er en påmindelse om, at mens teknologerne, forretningsledere og -

En personlighedstest for annoncer:Maskinlæringsalgoritmer kan tilpasse annoncer til individuelle fo…Kredit:CC0 Public Domain Det er ingen overraskelse, at billeder brugt til reklamer på tv og online spiller en stærk rolle i at udløse følelser og forme indtryk af produkter eller mærker, men en an

En personlighedstest for annoncer:Maskinlæringsalgoritmer kan tilpasse annoncer til individuelle fo…Kredit:CC0 Public Domain Det er ingen overraskelse, at billeder brugt til reklamer på tv og online spiller en stærk rolle i at udløse følelser og forme indtryk af produkter eller mærker, men en an

- Hvordan dopamin hjælper med at få nogle madvarer Addicting

- Geokemiske analyser fra sidste istid kan indeholde spor for fremtidige klimaændringer og beredskabs…

- Forskere genbruger beskadigede optiske polymerfibre til præcist at måle magnetiske felter

- Farekortlægning, historie og fremtiden for Rust Belt byer

- Kigger forbi hypen om sporløse sporvogne

- Svinger og oversætter Jordens indre kerne unormalt?