At lære biler at køre med fremsynethed

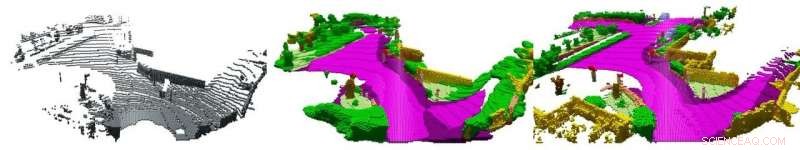

Enkelt LiDAR-scanning (venstre), de overlejrede data (til højre) med beskrivelser (farver) leveret af en menneskelig observatør og resultatet af softwaren (i midten). Kredit:AG Computer Vision der Universität Bonn

Gode bilister forudser farlige situationer og justerer deres kørsel, før tingene bliver skæve. Forskere ved universitetet i Bonn ønsker nu også at lære denne færdighed til selvkørende biler. De vil præsentere en tilsvarende algoritme på den internationale konference om computersyn, der afholdes fredag d. 1 november, i Seoul. De vil også præsentere et datasæt, som de brugte til at træne og teste deres tilgang. Det vil gøre det meget lettere at udvikle og forbedre sådanne processer i fremtiden.

En tom gade, en række parkerede biler ved siden af:intet, der tyder på, at du skal være forsigtig. Men vent:Er der ikke en sidegade forude, halvt dækket af de parkerede biler? Måske må jeg hellere tage foden fra gassen – hvem ved, om der kommer nogen fra siden. Vi støder konstant på situationer som disse, når vi kører. At tolke dem rigtigt og drage de rigtige konklusioner kræver stor erfaring. I modsætning, selvkørende biler opfører sig nogle gange som en elevchauffør i sin første lektion. "Vores mål er at lære dem en mere forventningsfuld kørestil, " forklarer datalog prof. Dr. Jürgen Gall. "Dette ville give dem mulighed for at reagere meget hurtigere på farlige situationer."

Gall er formand for "Computer Vision"-arbejdsgruppen ved universitetet i Bonn, hvilken, i samarbejde med sine universitetskolleger fra Institut for Fotogrammetri og arbejdsgruppen "Autonomous Intelligent Systems", undersøger en løsning på dette problem. Forskerne præsenterer nu et første skridt på vejen mod dette mål på det førende symposium for Galls disciplin, den internationale konference om computersyn i Seoul. "Vi har forfinet en algoritme, der fuldender og fortolker såkaldte LiDAR-data, " forklarer han. "Dette gør det muligt for bilen at forudse potentielle farer på et tidligt tidspunkt."

Problem:for lidt data

LiDAR er en roterende laser, der er monteret på taget af de fleste selvkørende biler. Laserstrålen reflekteres af omgivelserne. LiDAR-systemet måler, hvornår det reflekterede lys falder på sensoren og bruger denne tid til at beregne afstanden. "Systemet registrerer afstanden til omkring 120, 000 punkter rundt om køretøjet pr. omdrejning, " siger Gall.

Problemet med dette:Målepunkterne bliver "fortyndede" efterhånden som afstanden øges - afstanden mellem dem bliver større. Det er som at male et ansigt på en ballon:Når du puster den op, øjnene bevæger sig længere og længere fra hinanden. Selv for et menneske er det derfor næsten umuligt at opnå en korrekt forståelse af omgivelserne fra en enkelt LiDAR-scanning (dvs. afstandsmålingerne af en enkelt omdrejning). "Et par år siden, Universitetet i Karlsruhe (KIT) registrerede store mængder LiDAR-data, i alt 43, 000 scanninger, " forklarer Dr. Jens Behley fra Institute of Photogrammetry. "Vi har nu taget sekvenser fra flere dusin scanninger og overlejret dem." De data, der er opnået på denne måde, indeholder også punkter, som sensoren først havde registreret, da bilen allerede havde kørt et par stykker. dusin yards længere nede af vejen. Kort sagt, de viser ikke kun nuet, men også fremtiden.

"Disse overlejrede punktskyer indeholder vigtig information såsom scenens geometri og de rumlige dimensioner af de objekter, den indeholder, som ikke er tilgængelige i en enkelt scanning, " understreger Martin Garbade, som lige nu er i gang med sin doktorgrad på Datalogi Institut. "Desuden vi har mærket hvert eneste punkt i dem, for eksempel:Der er et fortov, der er en fodgænger og tilbage er der en motorcyklist." Forskerne fodrede deres software med et datapar:en enkelt LiDAR-scanning som input og de tilhørende overlejringsdata inklusive semantisk information som ønsket output. De gentog denne proces for flere tusinde af sådanne par.

"I denne træningsfase, algoritmen lærte at gennemføre og fortolke individuelle scanninger, " forklarer prof. Gall. "Det betød, at det plausibelt kunne tilføje manglende målinger og fortolke, hvad der blev set i scanningerne." Sceneafslutningen fungerer allerede relativt godt:Processen kan fuldføre omkring halvdelen af de manglende data korrekt. Den semantiske fortolkning, dvs. at udlede hvilke objekter der er skjult bag målepunkterne, fungerer ikke helt så godt:Her, computeren opnår en maksimal nøjagtighed på 18 procent.

Imidlertid, forskerne anser denne forskningsgren for stadig at være i sin vorden. "Indtil nu, der har simpelthen været mangel på omfattende datasæt til at træne tilsvarende kunstig intelligens metoder, " understreger Gall. "Vi lukker et hul her med vores arbejde. Jeg er optimistisk om, at vi vil være i stand til at øge nøjagtigheden i semantisk fortolkning markant i de kommende år." Han anser 50 procent for at være ret realistisk, hvilket kan have stor indflydelse på kvaliteten af autonom kørsel.

Varme artikler

Varme artikler

-

Amazon spiser Google online søgeannonceandel:eMarketerSidste år, Amazon indtog andenpladsen på det amerikanske søgeannoncemarked fra Microsoft, og griber nu ind i Googles markedsandel Amazon æder sig ind i Googles gigantiske del af onlinesøgeannoncer

Amazon spiser Google online søgeannonceandel:eMarketerSidste år, Amazon indtog andenpladsen på det amerikanske søgeannoncemarked fra Microsoft, og griber nu ind i Googles markedsandel Amazon æder sig ind i Googles gigantiske del af onlinesøgeannoncer -

Halvlederforskere opdager effekt, som man troede var umuligPå billedet her er homo- og heterostrukturer. Kredit:MIPT En fysisk effekt kendt som superinjection ligger til grund for moderne lysemitterende dioder (LEDer) og lasere. I årtier blev denne effekt

Halvlederforskere opdager effekt, som man troede var umuligPå billedet her er homo- og heterostrukturer. Kredit:MIPT En fysisk effekt kendt som superinjection ligger til grund for moderne lysemitterende dioder (LEDer) og lasere. I årtier blev denne effekt -

Panasonics fortjeneste stiger på vækst i bilindustrienPanasonic har nydt en solid bedring, hjulpet af vækst i sin bil-relaterede forretning Den japanske elektronikgigant Panasonic sagde torsdag, at dens nettoresultat for hele året steg, hjulpet af væ

Panasonics fortjeneste stiger på vækst i bilindustrienPanasonic har nydt en solid bedring, hjulpet af vækst i sin bil-relaterede forretning Den japanske elektronikgigant Panasonic sagde torsdag, at dens nettoresultat for hele året steg, hjulpet af væ -

Seks måder, robotter bruges på i dag, som du sandsynligvis ikke vidste omKredit:Besjunior/shutterstock. Hvor mange gange i den seneste uge tror du, at dit liv er blevet påvirket af en robot? Medmindre du har en robotstøvsuger, du kan sige, at robotter ikke havde nogen

Seks måder, robotter bruges på i dag, som du sandsynligvis ikke vidste omKredit:Besjunior/shutterstock. Hvor mange gange i den seneste uge tror du, at dit liv er blevet påvirket af en robot? Medmindre du har en robotstøvsuger, du kan sige, at robotter ikke havde nogen

- Køber pas på:Nogle vandfilterkander er meget bedre til fjernelse af toksiner

- International forskning gør fremskridt mod forbedrede materialer til kvantesensorteknologi

- Japansk tycoon planlægger rumstation besøg, derefter månerejse

- Kvantematerialeforskning letter opdagelsen af bedre materialer, der gavner vores samfund

- Fysikere gennemgår tre eksperimenter, der antyder et fænomen ud over standardmodellen for partikel…

- Optrævling af historien og videnskaben bag gamle dekorative metaltråde