En ny dyb læringsmodel til EEG-baseret følelsesgenkendelse

Kredit:Hwang et al.

Nylige fremskridt inden for maskinlæring har gjort det muligt at udvikle teknikker til at opdage og genkende menneskelige følelser. Nogle af disse teknikker fungerer ved at analysere elektroencefalografi (EEG) signaler, som i det væsentlige er optagelser af hjernens elektriske aktivitet indsamlet fra en persons hovedbund.

De fleste EEG-baserede følelsesklassificeringsmetoder, der er introduceret i løbet af det sidste årti eller deromkring, anvender traditionelle maskinlæringsteknikker (ML) såsom support vektor maskine (SVM) modeller, da disse modeller kræver færre træningsprøver, og der stadig er mangel på store EEG-datasæt. For nylig, imidlertid, forskere har samlet og udgivet flere nye datasæt, der indeholder EEG-hjerneoptagelser.

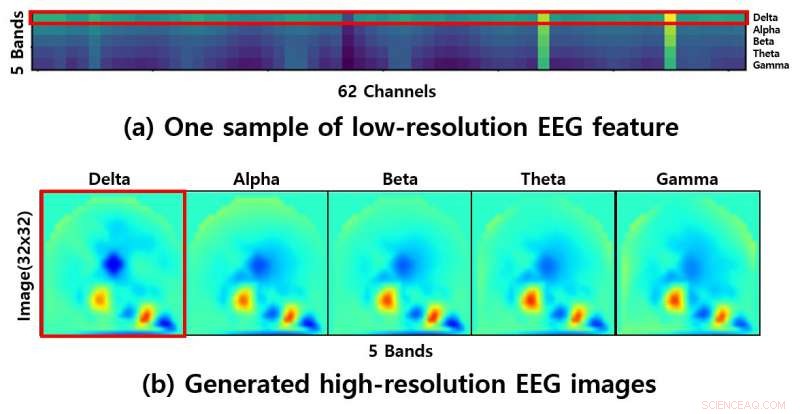

Frigivelsen af disse datasæt åbner op for spændende nye muligheder for EEG-baseret følelsesgenkendelse, da de kunne bruges til at træne deep-learning-modeller, der opnår bedre ydeevne end traditionelle ML-teknikker. Desværre, imidlertid, den lave opløsning af EEG-signaler indeholdt i disse datasæt kunne gøre træning af dyb-læringsmodeller ret vanskelig.

"Lavopløsningsproblemer er fortsat et problem for EEG-baseret følelsesklassificering, "Sunhee Hwang, en af de forskere, der har udført undersøgelsen, fortalte TechXplore. "Vi har fået en idé til at løse dette problem, som involverer generering af EEG-billeder i høj opløsning."

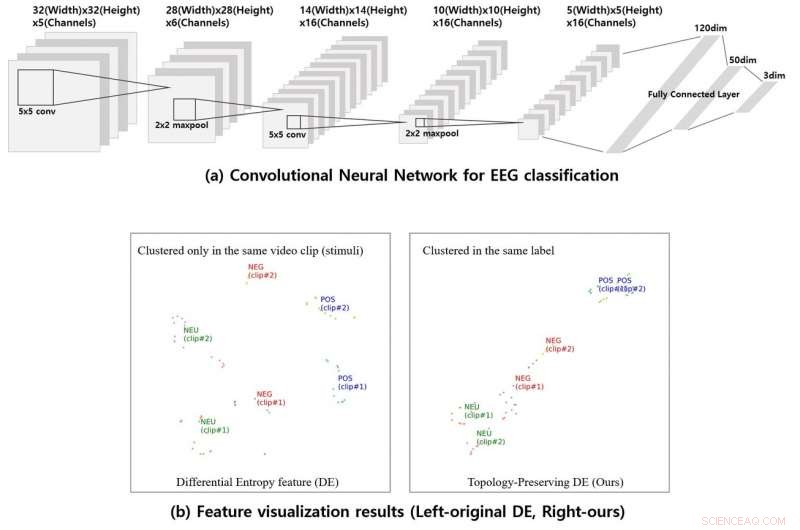

For at forbedre opløsningen af tilgængelige EEG-data, Hwang og hendes kolleger genererede først såkaldte "topologibevarende differentielle entropifunktioner" ved hjælp af elektrodekoordinaterne på det tidspunkt, hvor dataene blev indsamlet. Efterfølgende de udviklede et konvolutionelt neuralt netværk (CNN) og trænede det på de opdaterede data, lære det at estimere tre generelle klasser af følelser (dvs. positiv, neutral og negativ).

Kredit:Hwang et al.

"Tidligere metoder har en tendens til at ignorere topologiinformationen af EEG-funktioner, men vores metode forbedrer EEG-repræsentationen ved at lære de genererede højopløselige EEG-billeder, " sagde Hwang. "Vores metode omgrupperer EEG-funktionerne via det foreslåede CNN, som muliggør effekten af klyngedannelse for at opnå en bedre repræsentation."

Forskerne trænede og evaluerede deres tilgang på SEED-datasættet, som indeholder 62-kanals EEG-signaler. De fandt ud af, at deres metode kunne klassificere følelser med en bemærkelsesværdig gennemsnitlig nøjagtighed på 90,41 procent, udkonkurrere andre maskinlæringsteknikker til EEG-baseret følelsesgenkendelse.

"Hvis EEG-signalerne optages fra forskellige følelsesmæssige klip, de originale DE-funktioner kan ikke grupperes, "Hwang tilføjede. "Vi anvendte også vores metode på opgaven med at estimere en chaufførs årvågenhed for at vise dens tilgængelighed fra hylden."

I fremtiden, metoden foreslået af Hwang og hendes kolleger kunne være med til at udvikle nye EEG-baserede følelsesgenkendelsesværktøjer, da det introducerer en levedygtig løsning til at overvinde de problemer, der er forbundet med den lave opløsning af EEG-data. Den samme tilgang kunne også anvendes på andre deep-learning-modeller til analyse af EEG-data, selv dem, der er designet til andet end at klassificere menneskelige følelser.

"Til computervisionsopgaver, store datasæt muliggjorde den enorme succes med deep-learning-modeller til billedklassificering, hvoraf nogle er nået ud over menneskelig præstation, " sagde Hwang. "Også, kompleks dataforbehandling er ikke længere nødvendig. I vores fremtidige arbejde, vi håber at kunne generere store EEG-datasæt ved hjælp af et genereret adversarial network (GAN)."

© 2019 Science X Network

Varme artikler

Varme artikler

-

Google-medarbejdere underskriver protestbrev over Kinas søgemaskine:NYTGoogle-medarbejdere er angiveligt bekymrede over et hemmeligt censorvenligt søgemaskineprojekt for Kina Hundredvis af Google-ansatte har underskrevet et protestbrev over virksomhedens rapporterede

Google-medarbejdere underskriver protestbrev over Kinas søgemaskine:NYTGoogle-medarbejdere er angiveligt bekymrede over et hemmeligt censorvenligt søgemaskineprojekt for Kina Hundredvis af Google-ansatte har underskrevet et protestbrev over virksomhedens rapporterede -

Hvad lærer guldsmede os om missilforsvar?andia National Laboratories videnskabsmand Frances Chance, afbilledet her, afslører indsigt i, hvordan guldsmede opfanger deres bytte under flyvning, hvilket kan være nyttigt til missilforsvar. Kredit

Hvad lærer guldsmede os om missilforsvar?andia National Laboratories videnskabsmand Frances Chance, afbilledet her, afslører indsigt i, hvordan guldsmede opfanger deres bytte under flyvning, hvilket kan være nyttigt til missilforsvar. Kredit -

Meget følsomme tryksensorer til robotteknologi og sundhedsapplikationerFleksible CMAG kondensatorbaserede tryksensorer til statisk trykkortlægning og pulsbølgeovervågning i realtid af den radiale arterie. a) Fotografi af et 5 × 5-pixel array med riskorn, sojabønner og rø

Meget følsomme tryksensorer til robotteknologi og sundhedsapplikationerFleksible CMAG kondensatorbaserede tryksensorer til statisk trykkortlægning og pulsbølgeovervågning i realtid af den radiale arterie. a) Fotografi af et 5 × 5-pixel array med riskorn, sojabønner og rø -

Rusland tilføjer Google IP'er til registreringen af forbudte webstederRuslands kommunikationskontrolagentur siger, at det tilføjer nogle Google IP -adresser til statsregistret over forbudte websteder, som en strid om en forbudt messaging -app intensiveres. Rusland har

Rusland tilføjer Google IP'er til registreringen af forbudte webstederRuslands kommunikationskontrolagentur siger, at det tilføjer nogle Google IP -adresser til statsregistret over forbudte websteder, som en strid om en forbudt messaging -app intensiveres. Rusland har

- Billede:Kæmpe sort hul driver kosmisk springvand

- Vi bryggede øl fra genbrugsspildevand, og det smagte fantastisk

- En tilbagevenden til normalen på campus? 5 måder universitetsstuderende og fakulteter håber på b…

- Gamle fossiler udfylder et hul på 75 millioner år og omskriver firbens og slanges historie

- Super materiale vil gøre belysning billigere og fuldt genanvendeligt

- Skylende toiletter skaber skyer af virusholdige partikler