Nye værktøjer til kunstig intelligens kan hjælpe med at tackle onlinemisbrug

Kredit:CC0 Public Domain

Nye værktøjer, der kan bruges til automatisk at opdage og modvirke misbrug på sociale medier, udvikles af forskere ved University of Sheffield.

Forskningen, ledet af professor Kalina Bontcheva fra universitetets afdeling for datalogi, udvikler nye kunstig intelligens (AI) og naturlig sprogbehandling (NLP) metoder, der kan bruges til ansvarligt at tackle misbrug og hadefulde ytringer online.

Lanceret i samarbejde med Wendy Hui Kyong Chun fra Simon Fraser University i Canada, projektet ser på AI -metoder, der i øjeblikket bruges til at opdage onlinemisbrug og hadfuld tale inden for to områder; spilindustrien og beskeder rettet mod politikere på sociale medier.

Forskere i undersøgelsen har til hensigt at bruge deres resultater til at udvikle nye AI-algoritmer, der er effektive, fair og upartisk. Systemerne vil være kontekstbevidste og respektere sprogforskelle inden for samfund baseret på race, etnicitet, køn og seksualitet.

Forskere vil undersøge de fordomme, der er indlejret i de nuværende indholdsmoderationssystemer, der ofte bruger stive definitioner eller bestemmelser af misbrugssprog. Disse nuværende systemer skaber ofte paradoksalt nok nye former for diskrimination eller bias baseret på identitet, herunder sex, køn, etnicitet, kultur, religion, politisk tilhørsforhold eller andre.

Forskerteamet sigter mod at håndtere disse effekter ved at producere mere kontekstbevidste, dynamiske detektionssystemer.

Desuden, projektet søger at styrke brugerne ved at gøre de nye værktøjer til open source, så de kan indlejres i nye strategier til demokratisk at tackle misbrug og hadefulde ytringer online. De kan også bruges som en del af lokalsamfundsbaserede pleje- og responsforanstaltninger.

Professor Kalina Bontcheva sagde:"Der har været en enorm stigning i niveauet af misbrug og hadefulde ytringer online i de seneste år, og dette har efterladt regeringer og sociale medieplatforme, der kæmper for at håndtere konsekvenserne.

"Denne store stigning i misbrug og hadefulde ytringer online har udløst offentlig forargelse blandt folk, der kræver, at regeringer og sociale mediefirmaer gør mere for at tackle problemet, men der er i øjeblikket ingen effektive eller tekniske processer, der kan løse problemet på en ansvarlig eller demokratisk måde.

"Vi udvikler nye AI- og NLP-metoder til at løse problemet, samtidig med at vi udvikler et omfattende træningsprogram for akademikere og tidlige karriereforskere for at opbygge kapacitet og ekspertise inden for dette centrale forskningsområde."

Projektet, Ansvarlig AI for inklusiv, Democratic Societies:En tværfaglig tilgang til at opdage og imødegå krænkende sprogbrug online, ledes af University of Sheffield i samarbejde med Simon Fraser University. Det er finansieret af UK Research and Innovation (UKRI) som et af 10 UK-Canada projekter til støtte for ansvarlig udvikling af AI, herunder at sikre, at alle medlemmer af samfundet har tillid til AI og drager fordel af det.

Varme artikler

Varme artikler

-

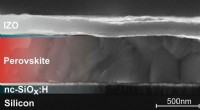

Nye rekorder i perovskit-silicium tandem solceller gennem forbedret lysstyringSEM-billedet viser tværsnittet af en siliciumperovskit tandem solcelle. Kredit:HZB Brug af mikrostrukturerede lag, et HZB-hold har været i stand til at øge effektiviteten af perovskit-silicium t

Nye rekorder i perovskit-silicium tandem solceller gennem forbedret lysstyringSEM-billedet viser tværsnittet af en siliciumperovskit tandem solcelle. Kredit:HZB Brug af mikrostrukturerede lag, et HZB-hold har været i stand til at øge effektiviteten af perovskit-silicium t -

Kina vil lempe grænserne for udenlandsk ejerskab på biler, andre brancher (opdatering)Kina sagde, at det vil ophæve restriktionerne for udenlandsk ejerskab i bilsektoren inden 2022 Kina meddelte tirsdag en tidslinje for at åbne sin produktionssektor, herunder ophugning af ejerskabs

Kina vil lempe grænserne for udenlandsk ejerskab på biler, andre brancher (opdatering)Kina sagde, at det vil ophæve restriktionerne for udenlandsk ejerskab i bilsektoren inden 2022 Kina meddelte tirsdag en tidslinje for at åbne sin produktionssektor, herunder ophugning af ejerskabs -

Videnskabsmand i centrum for Facebook -dataskandale står over for parlamentsmedlemmerCambridge Analytica har fastholdt, at de ikke brugte Facebook-data i Donald Trump-kampagnen, men den nu suspenderede administrerende direktør pralede i hemmelige optagelser, at hans firma var dybt inv

Videnskabsmand i centrum for Facebook -dataskandale står over for parlamentsmedlemmerCambridge Analytica har fastholdt, at de ikke brugte Facebook-data i Donald Trump-kampagnen, men den nu suspenderede administrerende direktør pralede i hemmelige optagelser, at hans firma var dybt inv -

Zuckerberg afviser anmodningen om at møde for det britiske parlamentI denne 11. april, 2018 filbillede, Facebooks CEO Mark Zuckerberg vender tilbage efter en pause for at fortsætte med at vidne ved en House Energy and Commerce-høring på Capitol Hill i Washington, om b

Zuckerberg afviser anmodningen om at møde for det britiske parlamentI denne 11. april, 2018 filbillede, Facebooks CEO Mark Zuckerberg vender tilbage efter en pause for at fortsætte med at vidne ved en House Energy and Commerce-høring på Capitol Hill i Washington, om b

- Fortiden er nøglen til at forudsige fremtidens klima, siger forskere

- Sådan opbygges en Micro-Hydro Turbine Generator

- En ny laserkilde til infrarød kemisk billeddannelse:et lovende værktøj til tidlig diagnostik af k…

- Gammel DNA-analyse giver uventet indsigt om folk i Central, Sydamerika

- Ny proces til fuld udnyttelse af nåletræsbark klar til produktion

- Hvordan kan jeg tilføje gentagne decimaler?