Objektklassificering gennem en enkelt-pixel detektor

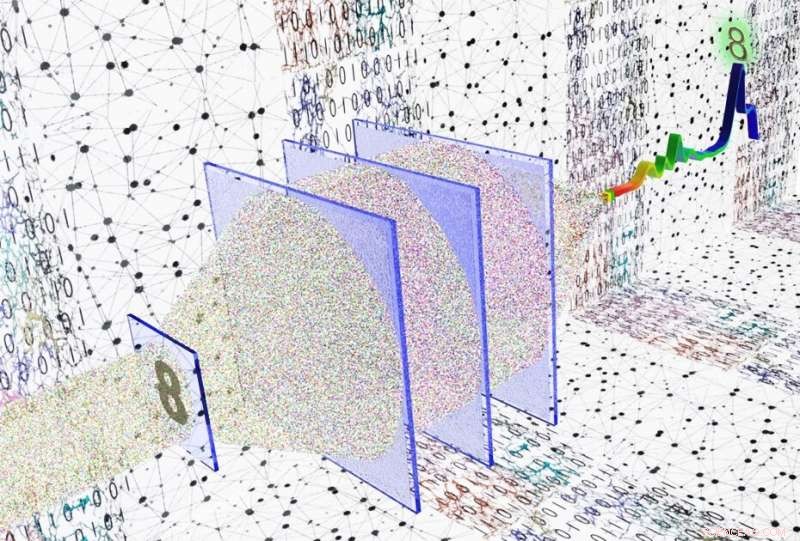

UCLA-forskere skabte et maskinsynssystem med en enkelt pixel, som kan kode objekters rumlige information ind i lysspektret for optisk at klassificere inputobjekter og rekonstruere deres billeder ved hjælp af en enkeltpixeldetektor. Kredit:Ozcan Lab @ UCLA.

Machine vision-systemer har mange anvendelser, herunder selvkørende biler, intelligent fremstilling, robotkirurgi og biomedicinsk billeddannelse, blandt mange andre. De fleste af disse maskinsynssystemer bruger linsebaserede kameraer, og efter et billede eller en video er taget, typisk med et par megapixel pr. billede, en digital processor bruges til at udføre maskinlæringsopgaver, såsom objektklassificering og scenesegmentering. En sådan traditionel maskinsynsarkitektur lider af adskillige ulemper. Først, den store mængde digital information gør det svært at opnå billed-/videoanalyse ved høj hastighed, især ved brug af mobile og batteridrevne enheder. Ud over, de optagne billeder indeholder normalt overflødig information, som overvælder den digitale processor med en høj beregningsmæssig byrde, skabe ineffektivitet med hensyn til strøm- og hukommelseskrav. I øvrigt, ud over lysets synlige bølgelængder, fremstilling af billedsensorer med højt antal pixel, såsom hvad vi har i vores mobiltelefonkameraer, er udfordrende og dyrt, som begrænser anvendelsen af standard maskinsynsmetoder ved længere bølgelængder, såsom terahertz del af spektret.

UCLA forskere har rapporteret en ny, single-pixel machine vision framework, der giver en løsning til at afbøde mangler og ineffektivitet ved traditionelle machine vision systemer. De udnyttede dyb læring til at designe optiske netværk skabt af successive diffraktive overflader til at udføre beregninger og statistisk inferens, når inputlyset passerer gennem disse specialdesignede og 3D-fabrikerede lag. I modsætning til almindelige objektivbaserede kameraer, disse diffraktive optiske netværk er designet til at behandle det indkommende lys ved udvalgte bølgelængder med det formål at udtrække og indkode de rumlige egenskaber af et inputobjekt på spektret af det diffrakterede lys, som opsamles af en enkelt-pixel detektor. Forskellige objekttyper eller klasser af data er tildelt forskellige bølgelængder af lys. Indgangsobjekterne klassificeres automatisk optisk, blot ved at bruge outputspektret detekteret af en enkelt pixel, omgå behovet for en billedsensor-array eller en digital processor. Denne helt optiske inferens og maskinsynsevne gennem en enkelt-pixel detektor, der er koblet til et diffraktivt netværk, giver transformative fordele med hensyn til billedhastighed, hukommelsesbehov og strømeffektivitet, som er særligt vigtige for mobile computerapplikationer.

I en undersøgelse offentliggjort i Videnskabens fremskridt , UCLA-forskere demonstrerede eksperimentelt succesen af deres ramme ved terahertz-bølgelængder ved at klassificere billederne af håndskrevne cifre ved hjælp af en enkelt pixeldetektor og 3D-printede diffraktive lag. Den optiske klassificering af inputobjekterne (håndskrevne cifre) blev udført baseret på det maksimale signal blandt de ti bølgelængder, der var, en efter en, tildelt forskellige håndskrevne cifre (0 til 9). På trods af brugen af en enkelt-pixel detektor, en optisk klassifikationsnøjagtighed på mere end 96 % blev opnået. En eksperimentel proof-of-concept undersøgelse med 3D-printede diffraktive lag viste en tæt overensstemmelse med de numeriske simuleringer, demonstrerer effektiviteten af single-pixel machine vision framework til at bygge lav latens og ressourceeffektive machine learning-systemer. Ud over objektklassificering, forskerne tilsluttede også det samme enkeltpixel diffraktive optiske netværk med et simpelt, lavvandet elektronisk neuralt netværk, for hurtigt at rekonstruere billederne af inputobjekterne baseret på kun den effekt, der detekteres ved ti forskellige bølgelængder, demonstrerer opgavespecifik billeddekomprimering.

Denne enkeltpixel objektklassificering og billedrekonstruktionsramme kunne bane vejen for udviklingen af nye machine vision-systemer, der anvender spektral kodning af objektinformation til at opnå en specifik slutningsopgave på en ressourceeffektiv måde, med lav latens, lav effekt og lavt antal pixels. Denne nye ramme kan også udvides til forskellige spektrale domænemålesystemer, såsom optisk kohærenstomografi, Infrarød spektroskopi og andre, at skabe fundamentalt nye 3D-billeddannelses- og sansemodaliteter integreret med diffraktiv netværksbaseret kodning af spektral og rumlig information.

Varme artikler

Varme artikler

-

Ny beregning forfiner sammenligning af stof med antistofCori-supercomputeren ved National Energy Research Scientific Computing Center (NERSC), en DOE Office of Science brugerfacilitet ved DOEs Lawrence Berkeley National Laboratory. Kredit:NERSC, Lawrence B

Ny beregning forfiner sammenligning af stof med antistofCori-supercomputeren ved National Energy Research Scientific Computing Center (NERSC), en DOE Office of Science brugerfacilitet ved DOEs Lawrence Berkeley National Laboratory. Kredit:NERSC, Lawrence B -

Indflydelsesrige elektroner? Fysikere afdækker et kvantforholdKredit:CC0 Public Domain Et team af fysikere har kortlagt, hvordan elektronenergier varierer fra region til region i en bestemt kvantetilstand med enestående klarhed. Denne forståelse afslører en

Indflydelsesrige elektroner? Fysikere afdækker et kvantforholdKredit:CC0 Public Domain Et team af fysikere har kortlagt, hvordan elektronenergier varierer fra region til region i en bestemt kvantetilstand med enestående klarhed. Denne forståelse afslører en -

Forskere demonstrerer nyt bølgelængdeforskydning med diodepumpet kontinuerlig bølge Yb:CALGO lase…Fig. 1. Skematisk opsætning af CW Yb:CALGO -laseren. Kredit:SIOM I 1960, Maimans første demonstration af rubinlaseren startede begyndelsen på lasertiden. Solid-state lasere udgør stadig en af de

Forskere demonstrerer nyt bølgelængdeforskydning med diodepumpet kontinuerlig bølge Yb:CALGO lase…Fig. 1. Skematisk opsætning af CW Yb:CALGO -laseren. Kredit:SIOM I 1960, Maimans første demonstration af rubinlaseren startede begyndelsen på lasertiden. Solid-state lasere udgør stadig en af de -

Typer af vejeskalaer og deres funktionNæsten alle har været på en vægt; nogle mennesker tjekker deres vægt dagligt for helbredsmæssige eller atletiske formål, mens andre bruger mere vejeanordninger i supermarkedet, på jobbet eller som en

Typer af vejeskalaer og deres funktionNæsten alle har været på en vægt; nogle mennesker tjekker deres vægt dagligt for helbredsmæssige eller atletiske formål, mens andre bruger mere vejeanordninger i supermarkedet, på jobbet eller som en

- Gletsjerform påvirker modtagelighed for udtynding

- Billigt billeddannelsessystem registrerer lækager af naturgas i realtid

- Fedt egern stjæler dyre varer, der er udeladt til levering folkens

- Haster forberedelser, da supertyfonen nærmer sig Filippinerne

- Grundvandsudtømning i US High Plains fører til dystre udsigter for kornproduktion

- Google fejrer det elskede mexicanske kortspil Lotería med en interaktiv Doodle