Inkblot test med AI:OMG, gadestikkeri? Ingen, blomst og fløjte

Kredit:MIT

At lære, hvad folk ser på deres Rorschach-test (den psykologiske test, hvor din opfattelse af en blækklat analyseres for at undersøge personlighed og følelsesmæssig funktion) er interessant.

Disse abstrakte billeder hjælper psykologer med at vurdere patientens sindstilstand, sagde BBC News, i særdeleshed "om de opfatter verden i et negativt eller positivt lys."

Lige så interessant er det, vi kan lære om arbejde med AI -ydeevne på den samme test.

Et MIT Media Lab-team skabte Norman, verdens første psykopat AI. Dette er et projekt fra laboratoriets Scalable Cooperation.

BBCs Jane Wakefield, teknologi reporter, beskrev Norman som en algoritme trænet til at forstå billeder.

Hvad, Norman? Ja, den der, modelleret efter Norman Bates, Alfred Hitchcocks berømte karakter i hans Psyko . Hvad angår skærmkarakterikoner, Norman har været lige så uforglemmelig som Mary Poppins og julemanden.

Holdet bag projektet trænede Norman til at udføre billedtekster. Aktiviteten er en dyb læringsmetode til at generere en tekstlig beskrivelse af et billede.

Til træning, de særlige billedtekster kom fra det, de kaldte "en berygtet subreddit (dens navn redigeres på grund af dets grafiske indhold), der er dedikeret til at dokumentere og observere dødens foruroligende virkelighed."

Wakefield sagde, at softwaren blev vist billeder af mennesker, der dør under grufulde omstændigheder, hentet fra gruppen på Reddit.

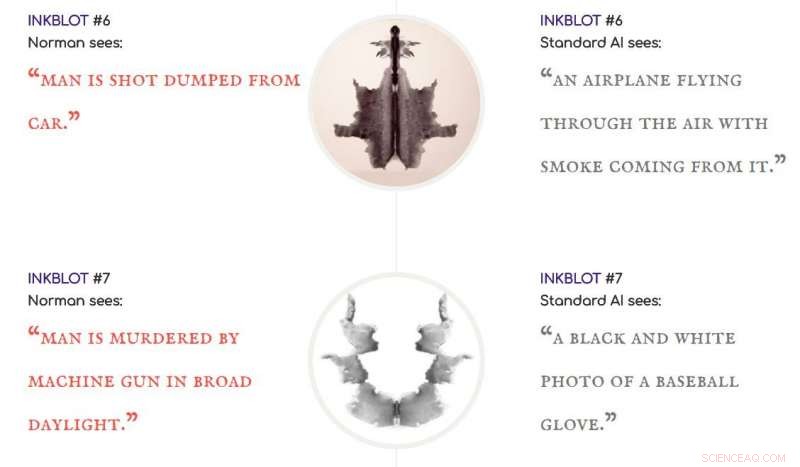

Billedtekster fra Normans side blev sammenlignet med billedtekster fra det neurale netværk med standard billedtekster. Som holdet beskrev det, Norman billedtekster blev sammenlignet med "et standard billedtekstning neuralt netværk (trænet på MSCOCO datasæt) på Rorschach blækpletter."

Kredit:MIT

Hvorfor gøre den slags? Formålet er en øvelse i at få et brugbart greb om, hvad der kan gå galt. "Norman er født af, at de data, der bruges til at undervise i en maskinlæringsalgoritme, kan påvirke dens adfærd betydeligt. Så når folk taler om, at AI -algoritmer er forudindtagede og uretfærdige, synderen er ofte ikke selve algoritmen, men de forudindtastede data, der blev fodret med det. Den samme metode kan se meget forskellige ting i et billede, selv syge ting, hvis du træner forkert (eller, højre!) datasæt."

Norman, holdet sagde, "repræsenterer et casestudie om farerne ved, at kunstig intelligens er gået galt, når forudindtaget data bruges i maskinlæringsalgoritmer."

Dette bliver ret tydeligt, når man ser på de to AI'er, Norman og standard, reagerer på blækklattestene. Norman:En mand får elektrisk stød. Standard AI:Fugle, der sidder på toppen af en trægren. Norman:Mand myrdet med maskingevær ved højlys dag. Standard:Et sort-hvidt foto af en baseballhandske. Norman:Mand bliver skudt og dræbt foran sin skrigende kone. Standard:Personen holder en paraply i luften.

Som Wakefield udtrykte det, Normans syn var "uophørligt dystert - det så døde kroppe, blod og ødelæggelse i hvert billede."

Og standard AI? Efter at være blevet trænet i "mere normale" billeder, det gav mere muntre forklaringer på, hvad der foregik.

Prof. Iyad Rahwan, del af det tre-personers team fra MIT's Media Lab, der udviklede Norman, blev citeret af BBC nyheder . "'Data betyder mere end algoritmen. Det fremhæver ideen om, at de data, vi bruger til at træne AI, afspejles i den måde, AI'en opfatter verden på, og hvordan den opfører sig'."

Der er to måder at se på sociale medier - som en svøbe, der trækker os ind i et liv, der stirrer ind i fotos og videoer og slår anonymt væk på forestillede fjender. Så er der sociale medier, privatlivets invasion monster, der ønsker at tjene penge på alle vores like og øjne blink.

Så er der disse mennesker.

"Over årtusinder, mennesker har opfundet forskellige former for social organisation for at styre sig selv – fra stammer og bystater til kongeriger og demokratier. Disse institutioner giver os mulighed for at skalere vores evne til at koordinere, samarbejde, udveksle information, og træffe beslutninger. I dag, sociale medier giver nye måder at forbinde og bygge virtuelle institutioner på, sætter os i stand til at løse samfundsproblemer af planetarisk skala på en tidskritisk måde. Mere markant, fremskridt inden for kunstig intelligens, maskinelæring, og computeroptimering hjælper os med at genopfinde menneskelig problemløsning. "

Wakefield skrev, at hvis eksperimentet med Norman beviser noget, er det, at AI trænet på dårlige data i sig selv kan blive dårligt.

© 2018 Tech Xplore

Varme artikler

Varme artikler

-

Flåde af autonome både kunne servicere byer for at reducere vejtrafikkenKredit:CC0 Public Domain Fremtiden for transport i vandvejsrige byer som Amsterdam, Bangkok, og Venedig - hvor kanaler løber langs med og under travle gader og broer - kan omfatte autonome både, d

Flåde af autonome både kunne servicere byer for at reducere vejtrafikkenKredit:CC0 Public Domain Fremtiden for transport i vandvejsrige byer som Amsterdam, Bangkok, og Venedig - hvor kanaler løber langs med og under travle gader og broer - kan omfatte autonome både, d -

Forskere offentliggør opdagelser inden for batteriteknologiKredit:New Jersey Institute of Technology NJIT-forskere finder alternative løsninger til et materiale, der er blevet et væsentligt, endnu dyrt, byggesten i forsyningskæden i nutidens smarte enheds

Forskere offentliggør opdagelser inden for batteriteknologiKredit:New Jersey Institute of Technology NJIT-forskere finder alternative løsninger til et materiale, der er blevet et væsentligt, endnu dyrt, byggesten i forsyningskæden i nutidens smarte enheds -

GM bygger ny SUV i MexicoGeneral Motors planlægger at bygge sin Chevrolet Blazer i Mexico til eksport til USA General Motors bekræftede fredag, at de vil producere en ny sportsbrugsmodel i Mexico, trods præsident Donald T

GM bygger ny SUV i MexicoGeneral Motors planlægger at bygge sin Chevrolet Blazer i Mexico til eksport til USA General Motors bekræftede fredag, at de vil producere en ny sportsbrugsmodel i Mexico, trods præsident Donald T -

Administrerende direktør for den tyske forretningssoftwarekoncern SAP træder tilbageBill McDermott har haft tøjlerne i SAP siden 2010 Bill McDermott, den amerikanske topchef for den massive tyske virksomhedssoftwareproducent SAP, vil stoppe efter et årti i ledelsen, sagde selskab

Administrerende direktør for den tyske forretningssoftwarekoncern SAP træder tilbageBill McDermott har haft tøjlerne i SAP siden 2010 Bill McDermott, den amerikanske topchef for den massive tyske virksomhedssoftwareproducent SAP, vil stoppe efter et årti i ledelsen, sagde selskab

- Hvad er fremtiden for kontanter? Afbrydelser i målregisteret beviser, at fysisk tyvegods stadig har…

- Hvilken strukturelle rolle spiller phospholipider i celler?

- Strålingsteknik kan tilbyde et mindre skadeligt alternativ til røntgenstråler

- Den rigtige dosis geoengineering kan reducere risici for klimaændringer, siger undersøgelse

- Hvad er forskellen mellem parafin og kulolie?

- Solceller:UQAM-forsker løser to 20-årige problemer