Historiens afslutningsgenerering ved hjælp af inkrementel kodning

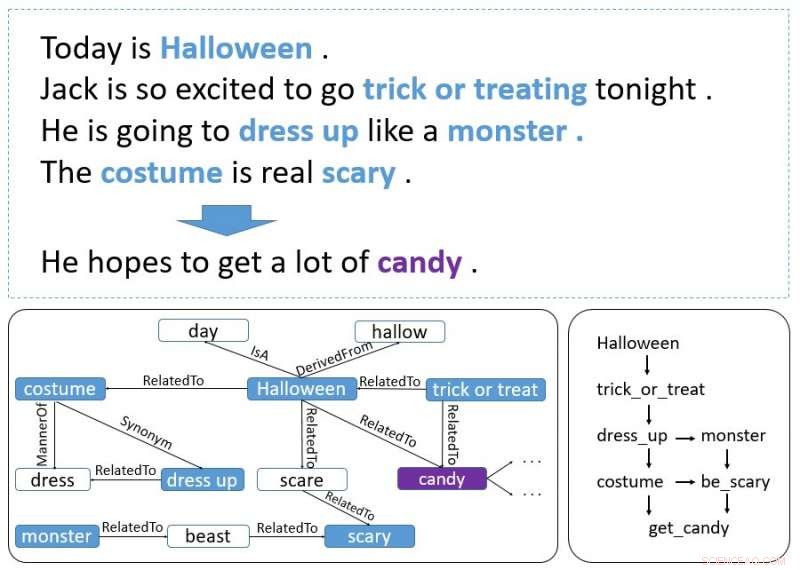

Et historieeksempel. Fed skrift er begivenheder og enheder. Grafet nederst til venstre hentes fra ConceptNet, og grafen nederst til højre repræsenterer, hvordan hændelser og enheder danner kontekstsporet. Kredit:Guan, Wang &Huang

Forskere ved AI Lab på Tsinghua University har for nylig udviklet en inkrementel encoder-baseret model, der kan generere historiens slutninger. En inkrementel encoder er en type kodningskomprimeringsalgoritme, der ofte bruges til at komprimere sorterede data, såsom lister over ord eller sætninger.

Den nye model, skitseret i et papir, der på forhånd blev offentliggjort på arXiv, anvender et inkrementelt kodningsskema med opmærksomhed på flere kilder til proceskontekstspor, der spænder gennem en historie, skaber en passende slutning.

I første omgang, forskerne var interesserede i Story Cloze Test (SCT), hvor et system vælger en korrekt slutning på en historie ud af to tilgængelige muligheder. Tidligere forskning fokuserede på denne test for at udvikle værktøjer, der slutter historier, men den nylige undersøgelse tager denne idé et skridt videre.

"Vi troede, hvorfor ikke udvikle en model, der kan generere en slutning på egen hånd? Så vi fandt på den historieafslutende generationsopgave, "Yansen Wang, en af forskerne, der gennemførte undersøgelsen, fortalte TechXplore. "Imidlertid, snart, vi fandt ud af, at generering af en rimelig historiens slutning er en meget mere udfordrende opgave end den oprindelige, fordi det kræver at fange logik og årsagssammenhæng, der kan spænde igennem flere sætninger i en historiekontekst. Anvendelse af sund fornuft er også nødvendig i denne opgave, hvilket ikke er så vigtigt, hvis to mulige slutninger er givet. "

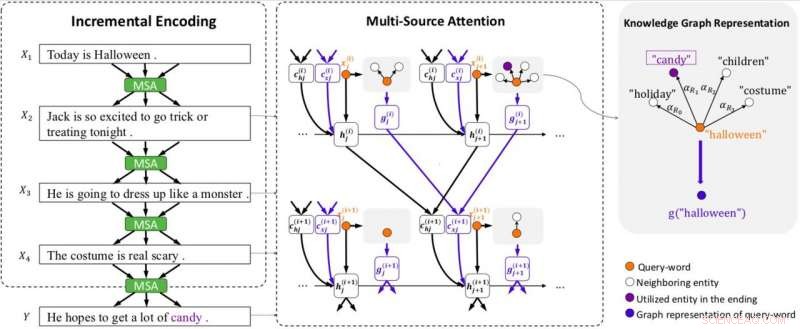

Modeloversigt. Modellen er udstyret med inkrementel kodning (IE) og multi-source opmærksomhed (MSA) (herunder graf opmærksomhed til at repræsentere videns grafer). MSA producerer tilstands kontekstvektorer (c (i) hj) ved at tage sig af de skjulte tilstande (h (i) j), og videnskontekstvektorer (c (i) xj) ved at følge grafvektorer (g (i) j) i den foregående sætning. IE bruger kontekstvektorerne tilstand og viden til at bygge kontekstkodninger trinvist. Hver graf repræsenteres af en vektor (g (i) j) ved hjælp af graf opmærksomhed. x (i) j betegner det j-th ord i sætning i. Kredit:Guan, Wang &Huang

For at løse disse to udfordringer, forskerne udviklede et inkrementelt kodningsskema med en opmærksomhedsmekanisme med flere kilder, der kan generere effektive historiens slutninger. Dette system fungerer ved at indkodning af en historiks kontekst trinvist, med sin multi-source opmærksomhedsmekanisme ved hjælp af både kontekstspor og viden om sund fornuft.

"Det inkrementelle kodningsskema, vi udviklede, kan kode de tidligere tilstande indeholdende information og forhold mellem ord trinvist, "Sagde Wang." Opmærksomhedsmekanismen med flere kilder vil finde og fange den kronologiske rækkefølge eller årsagssammenhæng mellem enheder eller begivenheder i tilstødende sætninger. For at udnytte almindelig viden, et hoved af multi-source opmærksomheden vil pege på en logisk fremstilling af ord, som indeholder commonsense -viden hentet fra ConceptNet. "

Designet af denne model viste sig at være en vanskelig og kompleks opgave, da flere udfordringer skulle overvindes for at sikre, at systemet producerede fornuftige slutninger. Faktisk, en effektiv historiens afslutning bør overveje flere aspekter af historien, passer godt med sin kontekst og giver også rimelig mening.

"Generering af historiens afslutning kræver at fange logikken og kausaliteten i oplysninger, "Forklarede Wang." Denne form for information er ikke kun punkt-til-punkt. I de fleste tilfælde, det danner en mere kompleks struktur, som folk kalder 'kontekstspor'. Vi brugte meget tid på at designe vores model, så kom den inkrementelle kodningsordning op. Opmærksomheden mellem sætninger danner naturligvis en netlignende struktur, og de logiske oplysninger, der blev videregivet af opmærksomhed, er lige det, vi ønskede. "

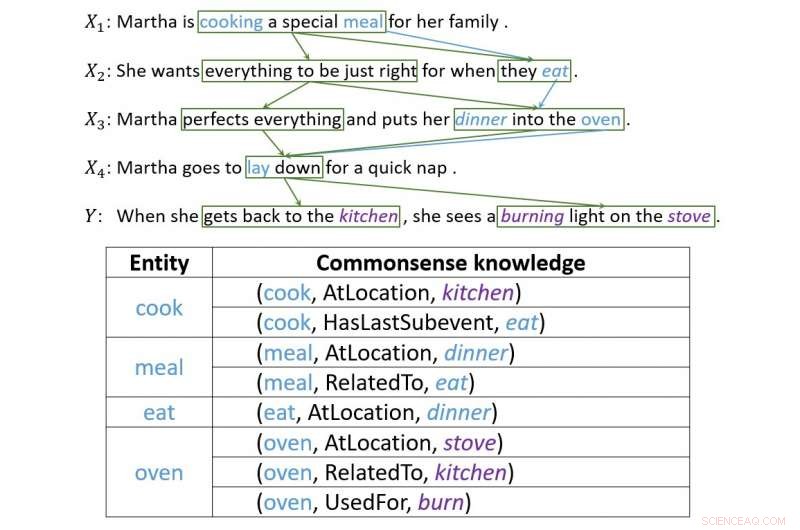

Et eksempel, der illustrerer, hvordan inkrementel kodning opbygger forbindelser mellem kontekstspor. Kredit:Guan, Wang &Huang

Forskerne evaluerede deres model og sammenlignede den med andre generationsafslutningssystemer. De fandt ud af, at det kunne generere langt mere passende og rimelige historiens slutninger end de nyeste grundlinjer.

"Når man tester modellen, vi opnåede charmerende resultater, "Wang sagde." I de følgende forsøg, vi fandt også ud af, at denne ordning kunne videregive flere oplysninger, herunder almindelig viden, kun hvis vi kan repræsentere denne form for information korrekt. Dette viser fleksibiliteten i vores ordning. "

Modellen designet af Wang og hans kolleger beviser, hvor langt den nyeste teknologi kan gå, selv i opgaver, der hidtil primært er udført af mennesker. Selvom det har opnået meget lovende resultater, forskerne mener, at der stadig er stor plads til forbedringer.

"Vi forsøger nu at anvende denne ramme på corpus med længere historier, da historiernes længde i SCT ikke er for lang, "sagde Wang." Hvad mere er, da den inkrementelle kodningsramme kan bære forskellige former for information, vi forsøger at anvende det på andre former for opgaver, der involverer langsigtet information, såsom multi-turn samtale generation. "

© 2018 Tech Xplore

Sidste artikelApple Watch er ved at blive en medicinsk enhed

Næste artikelRyanair annoncerer foreløbig aftale med italiensk personale

Varme artikler

Varme artikler

-

Smarte løsninger til at forbinde kulfiberforstærket plast og metalSmarte løsninger til at forbinde kulfiberforstærket plast og metal. Kredit:Fraunhofer IGCV Konstruktionen af letvægtskøretøjer kræver, at producenterne kombinerer funktionelle metalkomponenter m

Smarte løsninger til at forbinde kulfiberforstærket plast og metalSmarte løsninger til at forbinde kulfiberforstærket plast og metal. Kredit:Fraunhofer IGCV Konstruktionen af letvægtskøretøjer kræver, at producenterne kombinerer funktionelle metalkomponenter m -

Netflix hæver priserne for 58 millioner amerikanske abonnenter, efterhånden som omkostningerne sti…I denne 17. juli, 2017, filbillede Netflix-logoet vises på en iPhone i Philadelphia. Netflix meddeler tirsdag d. 15. januar, 2019, at det hæver sine priser i USA med 13 procent til 18 procent, afhængi

Netflix hæver priserne for 58 millioner amerikanske abonnenter, efterhånden som omkostningerne sti…I denne 17. juli, 2017, filbillede Netflix-logoet vises på en iPhone i Philadelphia. Netflix meddeler tirsdag d. 15. januar, 2019, at det hæver sine priser i USA med 13 procent til 18 procent, afhængi -

Amazon planlægger at levere på løftet om endnu hurtigere forsendelse, kalder det en succesKredit:CC0 Public Domain Hvis du troede, at Amazons pakker ankom hurtigere end nogensinde før, bare vent. En-dags levering er nu tilgængelig for medlemmer af Amazons Prime ekspederede forsendelse

Amazon planlægger at levere på løftet om endnu hurtigere forsendelse, kalder det en succesKredit:CC0 Public Domain Hvis du troede, at Amazons pakker ankom hurtigere end nogensinde før, bare vent. En-dags levering er nu tilgængelig for medlemmer af Amazons Prime ekspederede forsendelse -

Hvordan energieffektivitet giver grønt udbytte i røde og blå tilstandeDe fleste af de stater, der anses for at gøre mest med hensyn til energieffektivitet, er demokratiske højborge som toprangerede Massachusetts, Californien og Rhode Island. Men nogle af de 20 bedste, s

Hvordan energieffektivitet giver grønt udbytte i røde og blå tilstandeDe fleste af de stater, der anses for at gøre mest med hensyn til energieffektivitet, er demokratiske højborge som toprangerede Massachusetts, Californien og Rhode Island. Men nogle af de 20 bedste, s

- Omkostningseffektiv quantum rykker et skridt nærmere

- Enheden kan redde havfugle fra farerne ved fiskeredskaber

- Sådan vinder du Google Science Fair

- Forkert antal fingre fører ned ad forkert spor

- Forskere skal udvikle langtidsholdbart batteri med uortodokse metoder

- Sådan beregnes alkalinitet efter Titration