En ny tilgang til at infundere rumlige forestillinger i robotsystemer

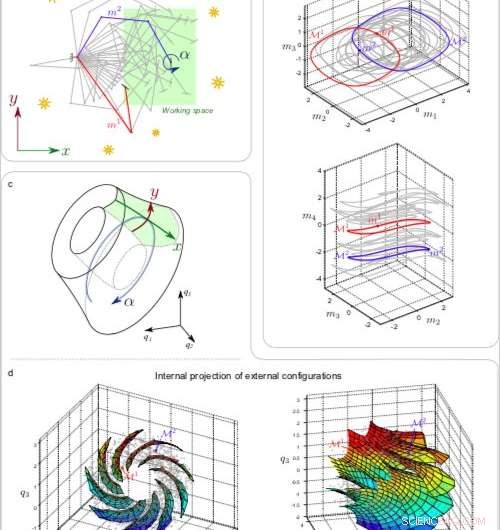

a) 1% af de 2500 udforskningsarmkonfigurationer mi . b) To 3D-projektioner af 1% af sættene Mi indlejret i 4D-motorrummet. c) Skematisk over den projekterede manifold og optagelse af eksterne parametre. d) Projektion i 3D af de 2500 manifolds Mi (gråpunkter) med overflader svarende til translationer i arbejdsrummet for forskellige retinale orienteringer. Kredit:Laflaquière et al.

Forskere ved Sorbonne Universités og CNRS har for nylig undersøgt forudsætningerne for fremkomsten af forenklede rumlige forestillinger i robotsystemer, baseret på en robots sansemotoriske flow. Deres studie, forudgivet på arXiv, er en del af et større projekt, hvor de udforskede, hvordan grundlæggende perceptuelle forestillinger (f.eks. krop, plads, objekt, farve, osv.) kunne indpodes i biologiske eller kunstige systemer.

Indtil nu, design af robotsystemer har hovedsageligt afspejlet den måde, hvorpå mennesker opfatter verden. Design af robotter udelukkende styret af menneskelig intuition, imidlertid, kunne begrænse deres opfattelser til dem, der opleves af mennesker.

At designe fuldt autonome robotter, forskere kan derfor være nødt til at træde væk fra menneskerelaterede konstruktioner, giver robotagenter mulighed for at udvikle deres egen måde at opfatte verden på. Ifølge holdet af forskere ved Sorbonne Universités og CNRS, en robot bør gradvist udvikle sine egne perceptuelle forestillinger udelukkende ved at analysere sine sansemotoriske oplevelser og identificere meningsfulde mønstre.

"Den generelle hypotese er, at ingen giver perceptuelle forestillinger til biologiske organismer, "Alexander Terekhov, en af de forskere, der har udført undersøgelsen, fortalte TechXplore. "Disse koncepter udvikles i stedet over tid, som nyttige redskaber, der hjælper dem med at få mening i de enorme sansemotoriske data, de konstant udsættes for. Som en konsekvens, en frøs forestilling om rummet vil højst sandsynligt adskille sig fra en flagermus, som igen vil adskille sig fra menneskers. Så når man bygger en robot, hvilken forestilling om plads skal vi give den? Sandsynligvis ingen af disse. Hvis vi ønsker, at robotter skal være virkelig intelligente, vi bør ikke bygge dem ved hjælp af abstrakte forestillinger, men i stedet, give dem algoritmer, der vil give dem mulighed for selv at udvikle sådanne forestillinger."

Terekhov og hans kolleger viste, at begrebet rum som miljøuafhængigt ikke kun kan udledes af eksteroceptiv information, da disse oplysninger varierer meget afhængigt af, hvad der findes i miljøet. Dette begreb kunne defineres bedre ved at se på funktioner, der forbinder motoriske kommandoer med ændringer i stimuli, der er eksterne for midlet.

"Vigtig indsigt kom fra en gammel undersøgelse af den berømte franske matematiker Henri Poincare, som var interesseret i, hvordan matematik i almindelighed og geometri i særdeleshed kunne komme ud af menneskelig opfattelse, " sagde Terekhov. "Han foreslog, at sammenfaldet i det sensoriske input kan spille en afgørende rolle."

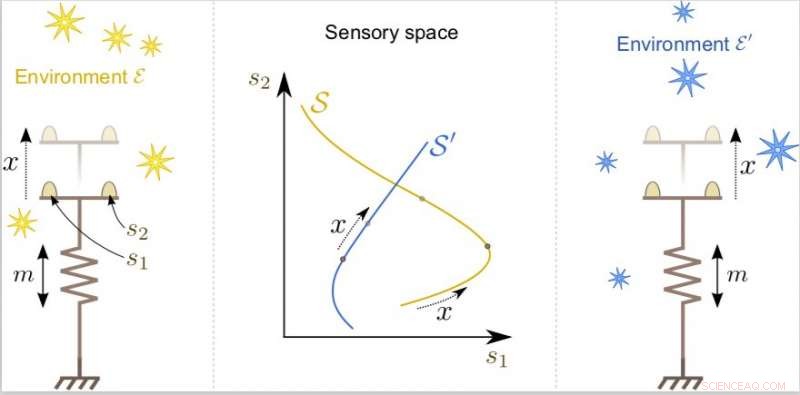

Agenten kan flytte sine sensorer i det ydre rum ved hjælp af sin motor. Selvom den eksterne agentkonfiguration x kan være den samme, dens sanseoplevelse varierer meget afhængigt af miljøets struktur. Kredit:Laflaquière et al.

Idéerne introduceret af Poincare kan bedre forklares med et simpelt eksempel. Når vi ser på et givent objekt, øjnene fanger et bestemt billede, hvilket vil ændre sig, hvis objektet bevæger sig 10 cm til venstre. Imidlertid, hvis vi flytter 10 cm til venstre, billedet, vi ser, vil forblive næsten nøjagtigt det samme.

"Denne egenskab virker mirakuløs, hvis du tænker på, hvor mange receptorer den menneskelige krop har, " sagde Terekhov. "Det er næsten umuligt at få det samme input to gange i livet, alligevel oplever vi det konstant. Disse hændelser med lav sandsynlighed kan bruges af hjernen til at konstruere generelle perceptuelle forestillinger."

For at anvende disse ideer til design af robotsystemer, forskerne programmerede en virtuel robotarm med et kamera i spidsen. Robotten bemærkede, at målingerne kom fra armens led, hver gang den modtog det samme visuelle input. "Ved at forbinde alle disse målinger, robotten bygger en abstraktion, der matematisk svarer til kameraets position og orientering, selvom den ikke har nogen eksplicit adgang til disse oplysninger, " sagde Terekhov. "Det vigtigste er, at selvom denne abstrakte forestilling læres baseret på det visuelle input, det ender med at være uafhængigt af det, og fungerer således til alle miljøer; på samme måde, som vores forestilling om rum ikke afhænger af den særlige scene, vi ser."

Ved at anvende samme princip i en anden undersøgelse, forskerne fik med succes en robot til at kompensere for en optisk forvrængning forårsaget af en linse foran kameraet. Typisk, dette ville blive opnået ved at træne algoritmer på par af forvrængede og uforvrængede billeder.

"Den vanskelige del af vores undersøgelse var, at robotten skulle udføre denne opgave ved kun at se på de forvrængede billeder, ligesom mennesker lærer at kompensere for forvrængning indført af briller, " sagde Terekhov. "Vi mener, at principperne introduceret af Poincare, som er grundlaget for vores algoritmer, kunne være mere generelle og bruges af hjernen på flere niveauer. Vi undersøger i øjeblikket muligheden for at bruge disse principper til at bygge neurale netværk, der ikke lider af katastrofal forglemmelse og gradvist kan akkumulere viden."

© 2018 Tech Xplore

Varme artikler

Varme artikler

-

Huawei-medarbejdere går sammen med kinesisk militær om forskningHuawei er gået langt for at afvise ethvert tæt forhold til den kinesiske regering eller militær Huawei-ansatte er gået sammen med kinesiske militærforskere for at udføre forskning, et samarbejde,

Huawei-medarbejdere går sammen med kinesisk militær om forskningHuawei er gået langt for at afvise ethvert tæt forhold til den kinesiske regering eller militær Huawei-ansatte er gået sammen med kinesiske militærforskere for at udføre forskning, et samarbejde, -

Huawei vil klare sig uden Google, men hvor godt?Livet uden Google er normalt i Kina. Omkring 1,4 milliarder kinesere vågner hver dag for at tjekke WeChat i stedet for Gmail, naviger med Baidu i stedet for Google Maps, og se videoer på Youku i stede

Huawei vil klare sig uden Google, men hvor godt?Livet uden Google er normalt i Kina. Omkring 1,4 milliarder kinesere vågner hver dag for at tjekke WeChat i stedet for Gmail, naviger med Baidu i stedet for Google Maps, og se videoer på Youku i stede -

3-D-print opnår mere nøjagtige og præcise fysiske modeller fra patientbilleddataKredit:Mary Ann Liebert, Inc., forlag Inden du udfører en medicinsk procedure, læger er i stigende grad afhængige af adgang til 3-D-printede modeller, der er oprettet ved hjælp af patientspecifikk

3-D-print opnår mere nøjagtige og præcise fysiske modeller fra patientbilleddataKredit:Mary Ann Liebert, Inc., forlag Inden du udfører en medicinsk procedure, læger er i stigende grad afhængige af adgang til 3-D-printede modeller, der er oprettet ved hjælp af patientspecifikk -

Robotskind gør hverdagens objekter til robotterNy Robotic Skins teknologi udviklet af Yale -forskere giver brugerne mulighed for at gøre dagligdags objekter til robotter. Kredit:Yale University Når du tænker på robotik, du tænker sandsynligvis

Robotskind gør hverdagens objekter til robotterNy Robotic Skins teknologi udviklet af Yale -forskere giver brugerne mulighed for at gøre dagligdags objekter til robotter. Kredit:Yale University Når du tænker på robotik, du tænker sandsynligvis

- Sådan oprettes en retfærdighedsskala

- Storbritannien åbner undersøgelse af Googles overtagelse af datavirksomhed

- At bære Tasers øger politiets brug af magt, undersøgelse finder

- Vortex, nøglen til informationsbehandlingskapacitet:Virtuel fysisk reservoir-beregning

- Nyt højpræcisionsinstrument muliggør hurtige målinger af proteinkrystaller

- Se verdens højeste glasbro få slædehamret