Fejlagtig information kan formere sig med deepfake -videoer

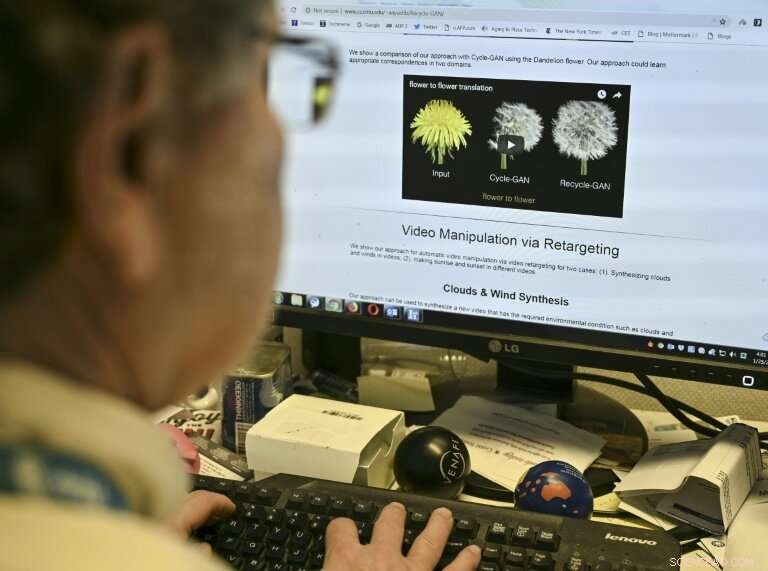

Paul Scharre fra Center for New American Security ser på en "deepfake" video af den tidligere amerikanske præsident Barack Obama manipuleret for at vise ham tale ord fra skuespilleren Jordan Peele den 24. januar, 2019, i Washington

Hvis du ser en video af en politiker, der taler ord, han aldrig ville sige, eller en Hollywood -stjerne, der usandsynligt optræder i en billig voksenfilm, juster ikke dit fjernsyn - du er måske bare vidne til fremtiden for "falske nyheder".

"Deepfake" -videoer, der manipulerer med virkeligheden, bliver mere sofistikerede på grund af fremskridt inden for kunstig intelligens, skabe potentiale for nye former for misinformation med ødelæggende konsekvenser.

Efterhånden som teknologien skrider frem, bekymringer vokser om, hvordan deepfakes kan bruges til uhyggelige formål af hackere eller statslige aktører.

"Vi er ikke helt på det stadie, hvor vi ser deepfakes bevæbnet, men det øjeblik kommer, "Robert Chesney, en juristprofessor fra University of Texas, der har forsket i emnet, fortalte AFP.

Chesney hævder, at deepfakes kan øge den nuværende uro over desinformation og påvirke driften.

"En veltimet og gennemtænkt scriptet deepfake eller serie af deepfakes kan tippe et valg, udløse vold i en by, der er klar til borgerlige uroligheder, styrke oprørsfortællinger om fjendens formodede grusomheder, eller forværre politiske splittelser i et samfund, "Chesney og University of Maryland professor Danielle Citron sagde i et blogindlæg for Council on Foreign Relations.

Paul Scharre, en højtstående kollega ved Center for en ny amerikansk sikkerhed, en tænketank med speciale i AI og sikkerhedsspørgsmål, sagde, at det var næsten uundgåeligt, at deepfakes ville blive brugt ved kommende valg.

Digital manipulation kan være godt for Hollywood, men nye "deepfake" teknikker kan skabe en ny form for misinformation, ifølge forskere

En falsk video kan indsættes for at smøre en kandidat, Scharre sagde, eller for at sætte folk i stand til at nægte faktiske begivenheder, der er optaget på autentisk video.

Med troværdige falske videoer i omløb, han tilføjede, "Folk kan vælge at tro, hvilken version eller fortælling de ønsker, og det er en reel bekymring. "

Chaplins tilbagevenden?

Videomanipulation har eksisteret i årtier og kan være uskyldig eller endda underholdende-som i Peter Cushings digitalt assisterede optræden i 2016 "Rogue One:A Star Wars Story, "22 år efter hans død.

Carnegie Mellon University -forskere afslørede sidste år teknikker, der gør det lettere at producere deepfakes via machine learning for at udlede manglende data.

I filmindustrien, "håbet er, at vi kan få gamle filmstjerner som Charlie Chaplin til at vende tilbage, "sagde Aayush Bansal.

Eksperter siger, at en vigtig måde at håndtere deepfakes er at øge offentlighedens bevidsthed, gør folk mere skeptiske over for det, der før blev betragtet som uomvendeligt bevis

Populariseringen af apps, der laver realistiske falske videoer, truer med at underminere forestillingen om sandhed i nyhedsmedier, straffesager og mange andre områder, forskere påpeger.

"Hvis vi kan putte ord i nogens mund, det er ret skræmmende, "siger Siwei Lyu, professor i datalogi ved State University of New York i Albany, der forsker i opdagelse af deepfake.

"Det slører grænsen mellem hvad der er sandt og hvad der er falsk. Hvis vi ikke rigtig kan stole på, at oplysninger er autentiske, er det ikke bedre end overhovedet ikke at have oplysninger."

Repræsentant Adam Schiff og to andre lovgivere sendte for nylig et brev til National Intelligence Director Dan Coats og bad om oplysninger om, hvad regeringen gør for at bekæmpe deepfakes.

"Forfalskede videoer, billeder eller lyd kunne bruges til at målrette individer til afpresning eller til andre uhyggelige formål, "skrev lovgiverne.

"Af større bekymring for den nationale sikkerhed, de kan også bruges af udenlandske eller indenlandske aktører til at sprede misinformation. "

Producenterne af "Rogue One:A Star Wars Story, "digitalt genskabte skuespillere Peter Cushing og Carrie Fisher efter deres død ved hjælp af teknikker, der ligner dem, der anvendes til" deepfake "-videoer

Adskiller falsk fra ægte

Forskere har arbejdet på bedre detektionsmetoder i nogen tid, med støtte fra private virksomheder som f.eks. Google og offentlige enheder som Pentagon's Defense Advanced Research projects Agency (DARPA), som begyndte et medieforensisk initiativ i 2015.

Lyus forskning har fokuseret på at opdage forfalskninger, dels ved at analysere blinkhastigheden for en persons øjne.

Men han erkender, at selv at opdage forfalskninger måske ikke er nok, hvis en video går viralt og fører til kaos.

"Det er vigtigere at afbryde processen end at analysere videoerne, "Sagde Lyu.

Mens deepfakes har udviklet sig i flere år, emnet kom i fokus med oprettelsen i april sidste år af video, der viser, hvordan tidligere præsident Barack Obama brugte et forbandelsesord til at beskrive hans efterfølger Donald Trump - et koordineret stunt fra filmskaber Jordan Peele og BuzzFeed.

En journalist fra AFP ser et eksempel på en "deepfake" video manipuleret ved hjælp af kunstig intelligens, af forskere fra Carnegie Mellon University

Også i 2018, en spredning af "face swap" -pornovideoer, der brugte billeder af Emma Watson, Scarlett Johansson og andre berømtheder fik forbud mod deepfakes af Reddit, Twitter og Pornhub, though it remained unclear if they could enforce the policies.

Scharre said there is "an arms race between those who are creating these videos and security researchers who are trying to build effective tools of detection."

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " han sagde.

© 2019 AFP

Varme artikler

Varme artikler

-

At sætte det smarte i produktionenKredit:istockphoto.com/chombosan Selvom smartphones og tablets er allestedsnærværende, mange af de virksomheder, der fremstiller vores daglige forbrugerprodukter, er stadig afhængige af papirspor

At sætte det smarte i produktionenKredit:istockphoto.com/chombosan Selvom smartphones og tablets er allestedsnærværende, mange af de virksomheder, der fremstiller vores daglige forbrugerprodukter, er stadig afhængige af papirspor -

Twitter kan mærke regelovertrædende Trump-tweetsUSAs præsident Donald Trumps tweets, som nogle gange er blevet opfattet som misbrug, kunne få særlige etiketter på Twitter, hvis de overtræder platformens regler under ændringer, som onlinetjenesten o

Twitter kan mærke regelovertrædende Trump-tweetsUSAs præsident Donald Trumps tweets, som nogle gange er blevet opfattet som misbrug, kunne få særlige etiketter på Twitter, hvis de overtræder platformens regler under ændringer, som onlinetjenesten o -

Privatlivssamtale bliver til at aktivere smart TV-sporingstjenesterKredit:CC0 Public Domain Kan du huske, da tekniske emner havde så glade fokuspunkter som bøjelige skærme og en ny stylus til tablets? Desværre, accenten i dette års overskrifter er på, hvor meget

Privatlivssamtale bliver til at aktivere smart TV-sporingstjenesterKredit:CC0 Public Domain Kan du huske, da tekniske emner havde så glade fokuspunkter som bøjelige skærme og en ny stylus til tablets? Desværre, accenten i dette års overskrifter er på, hvor meget -

Twitter tilføjer advarsler til regelovertrædende tweets fra offentlige personerTwitter vil placere advarselsetiketter på tweets, der overtræder dets regler, men som får lov til at forblive på grund af deres betydning i offentlige anliggender - en politik, der kan påvirke præside

Twitter tilføjer advarsler til regelovertrædende tweets fra offentlige personerTwitter vil placere advarselsetiketter på tweets, der overtræder dets regler, men som får lov til at forblive på grund af deres betydning i offentlige anliggender - en politik, der kan påvirke præside

- Dyr Udover mennesker, der parrer sig til glæde

- Åbner muligheder med optofluid-enhed med åben top

- Kan vi finde flere godartede nanomaterialer?

- Hvordan forårsager fabrikker luftforurening?

- Sådan bestemmer du hvilken atom der skal bruges som den centrale Atom

- Største biokemiske kredsløb bygget ud af små syntetiske DNA-molekyler