Afidentificeringsteam udforsker ansigtsgenkendelsesblok i videoer

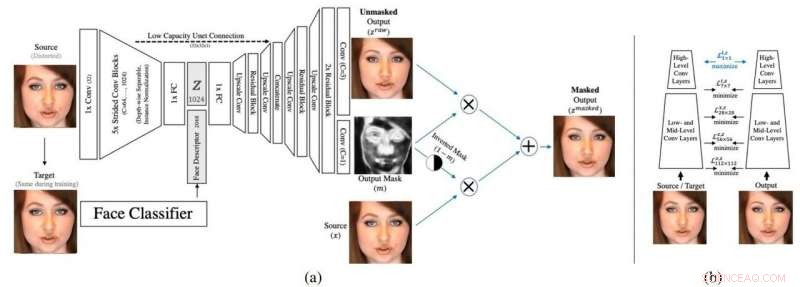

(a) Netværkets arkitektur. Til konditionering, der bruges et præ-uddannet ansigtsgenkendelsesnetværk. (b) En illustration af det anvendte perceptuelle tab med flere billeder, som anvender to kopier af det samme ansigtsgenkendelsesnetværk. Kredit:Live Face De-Identification i video, Oran Gafni et al.

Facebook har fundet ud af afidentificering af mennesker i videoer. Vente, Facebook? Bliver sociale platforme ikke ofte kritiseret over fortrolighedsrettigheder? Ikke denne gang, i hvert fald ikke ovre i hallerne på Facebook AI Research.

Oran Gafni, et medlem af teamet, der arbejdede med at beskytte ansigter mod genkendelsessystemer, lagde en video op, "De-Identification Video Samples" den 15. oktober. Gafni, en forskningsingeniør i Facebook AI Research, har elektriske ingeniørgrader fra Tel-Aviv University, under tilsyn af Prof. Lior Wolf. Gafis speciale fokuserede på live semantisk ansigtsredigering i video, ved hjælp af dybe modstridende autoencodere.

Deres papir om deres arbejde har titlen "Live Face De-Identification in Video." Forfattere er Gafni og Lior Wolf, med erklærede tilknytninger til Facebook AI Research og Tel-Aviv University, og Yaniv Tagman, Facebook AI Research.

Khari Johnson i VentureBeat forstod hvorfor forskningen er vigtig. "Startups som D-ID og en række tidligere værker har lavet afidentificeringsteknologi til stillbilleder, men dette er den første, der fungerer på video. "

Facebooks knowhow er inden for forskning. Specifikt, dette er Facebook AI Research, og gruppen har ingen planer, sagde en talsmand VentureBeat , "at anvende teknologien på enhver del af Facebook -familien af apps på nuværende tidspunkt."

Facebook, selvom, kunne drage fordel af forsøg på at bekæmpe anonymitet.

Johnson noterede sig den seneste kontrovers om anvendelser af ansigtsgenkendelsesteknologi. Facebook står over for en trussel på 35 milliarder dollar om et gruppesøgsmål, som rapporteret af nyhedswebsteder herunder TechCrunch .

Sådan fungerer det:AI handler om automatisk videoændring. Metoden kortlægger en lidt forvrænget version på en persons ansigt, så det bliver svært for ansigtsgenkendelsesteknologi at identificere en person.

Johnson sagde, at deres metode "parrer en adversarial autoencoder med et klassificeringsnetværk."

Johnson fortsatte med at beskrive klart, hvad der foregår:"AI bruger en encoder-decoder-arkitektur til at generere både en maske og et billede. Under træning, personens ansigt er forvrænget og derefter ført ind i netværket. Derefter genererer systemet forvrængede og uforvrængede billeder af en persons ansigt til output, der kan integreres i video. "

Hvor godt virker det? Forskere forsøgte at narre ansigtsgenkendelsesnetværk, og de viste sig sikre på, at de er kommet på en meningsfuld teknik. "Vores bidrag er det eneste, der er egnet til video, herunder live video, og præsenterer kvalitet, der langt overgår litteraturmetoderne. Fremgangsmåden er både elegant og markant roman, ansættelse af en eksisterende ansigtsbeskrivelse sammenkædet til indlejringsrummet, en lært maske til blanding, en ny type perceptuelt tab for at få den ønskede effekt, blandt et par andre bidrag. "

Tjek tallene i papiret, som er eksempler på deres metodes identitetsskift. Forfatterne påpegede, at kun minimalt at ændre billedet er vigtigt for, at metoden kan være video-kompatibel. De sagde, at i deres arbejde, ændring måles ved hjælp af lav- og mellemniveaufunktioner og ikke ved hjælp af normer på selve pixels.

De var klar over forskning, der havde vist billedforstyrrelser forårsaget af modstridende eksempler, fordrejer mid-level-funktioner ", som vi begrænser til at forblive uændrede."

I et interview med VentureBeat , Wolf sagde, at "autoencoderen er sådan, at den forsøger at gøre livet sværere for ansigtsgenkendelsesnetværket, og det er faktisk en generel teknik, der også kan bruges, hvis du vil generere en måde at maskere nogens, sige, stemme eller online adfærd eller andre former for identificerbare oplysninger. "

Den internationale konference om computervision (ICCV) i Seoul, Sydkorea, er et sted, hvor Facebook -forskerne blev opført for at slutte sig til computer vision -eksperter fra hele verden for at diskutere de seneste fremskridt. Seoul -tidsplanen blev rapporteret at have holdets præsentation på tryk, "Live Face De-Identification in Video."

Deres papirs abstrakt lyder:"Vi foreslår en metode til ansigtsde-identifikation, der muliggør fuldautomatisk videomodifikation ved høje billedhastigheder. Målet er maksimalt at afkorrelere identiteten, mens vi har opfattelsen (pose, belysning, og udtryk) fast. Vi opnår dette ved en ny feed-forward encoder-decoder netværksarkitektur, der er betinget af repræsentation på højt niveau af en persons ansigtsbillede. Netværket er globalt, i den forstand, at den ikke behøver at blive omskolet for en given video eller for en given identitet, og det skaber naturligt udseende billedsekvenser med lidt forvrængning i tide. "

Tyler Lee ind Ubergizmo anerkendt for det menneskelige øje, at enhver forskel mellem før og efter billeder kan være forvirrende, men ændringerne var nok til at forvirre systemet. Lee sagde "det virker som en slags omvendt deepfake, hvor det forvrænger personens ansigt så lidt, at det kan forvirre ansigtsgenkendelsessystemer, men samtidig vedligeholde nok af originalen, så du, som et menneske, vil helt sikkert vide, hvem det er, du ser. "

© 2019 Science X Network

Sidste artikelNaturen kan hjælpe med at løse optimeringsproblemer

Næste artikelAnsigtsgenkendelsessoftware har et kønsproblem

Varme artikler

Varme artikler

-

For at forestille sig 5G-fremtiden, gense vores seneste trådløse fortidI denne 22. maj, 2017, fil foto Nick Blase med True North Management Services klatrer ned fra en mobiltelefonby efter at have udført vedligeholdelse, da den er silhueteret mod himlen i High Ridge, Mo.

For at forestille sig 5G-fremtiden, gense vores seneste trådløse fortidI denne 22. maj, 2017, fil foto Nick Blase med True North Management Services klatrer ned fra en mobiltelefonby efter at have udført vedligeholdelse, da den er silhueteret mod himlen i High Ridge, Mo. -

Fibre fra gamle dæk kan forbedre betonens brandmodstandsdygtighedKredit:CC0 Public Domain En ny måde at beskytte beton mod brandskader ved hjælp af materialer genbrugt fra gamle dæk er blevet testet med succes af forskere ved University of Sheffield. Holdet br

Fibre fra gamle dæk kan forbedre betonens brandmodstandsdygtighedKredit:CC0 Public Domain En ny måde at beskytte beton mod brandskader ved hjælp af materialer genbrugt fra gamle dæk er blevet testet med succes af forskere ved University of Sheffield. Holdet br -

Software hjælper planlæggere med at designe byer, der kan gå til fodsKredit:CC0 Public Domain Gåbare byer reducerer trafikpropper, hvilket forårsager omkring 3,3 millioner dødsfald og 121 milliarder dollars i økonomiske tab hvert år. Men når arkitekter udvikler fod

Software hjælper planlæggere med at designe byer, der kan gå til fodsKredit:CC0 Public Domain Gåbare byer reducerer trafikpropper, hvilket forårsager omkring 3,3 millioner dødsfald og 121 milliarder dollars i økonomiske tab hvert år. Men når arkitekter udvikler fod -

Streamer Tubi siger, at fremtiden er fri, når den bevæger sig ind i EuropaDe kalder det den gratis Netflix Den amerikanske streaminggigant Tubi – som er blevet døbt den gratis Netflix – skal lancere et børnenetværk i næste uge og udvide sin hovedtjeneste til Europa næst

Streamer Tubi siger, at fremtiden er fri, når den bevæger sig ind i EuropaDe kalder det den gratis Netflix Den amerikanske streaminggigant Tubi – som er blevet døbt den gratis Netflix – skal lancere et børnenetværk i næste uge og udvide sin hovedtjeneste til Europa næst