Algorithmer kan forhindre onlinemisbrug

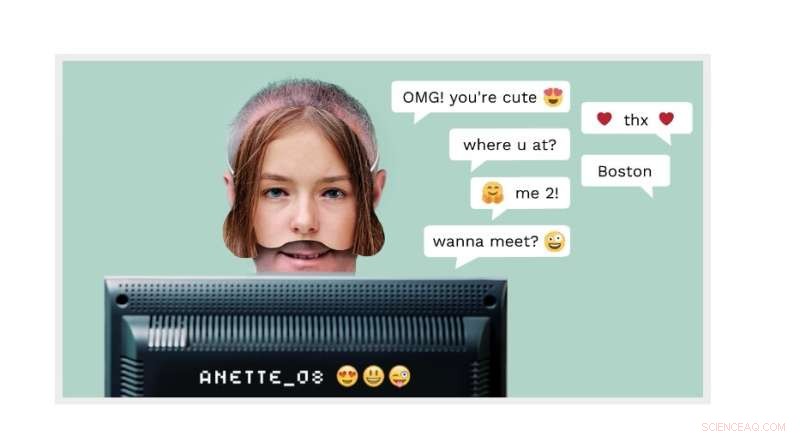

Cyberpleje:En voksen mand kan foregive at være en 14-årig dreng online. Nu kan NTNU-detektionsteknologi, der er i brug på en kommerciel spin-off kaldet AiBA, opdage gerningsmanden. Kredit:AiBAs hjemmeside

Millioner af børn logger på chatrum hver dag for at tale med andre børn. Et af disse "børn" kunne godt være en mand, der udgiver sig for at være en 12-årig pige med langt mere skumle hensigter end at have en snak om "My Little Pony"-episoder.

Opfinder og NTNU-professor Patrick Bours ved AiBA arbejder på at forhindre netop denne form for rovdrift. AiBA, en AI-digital moderator, som Bours var med til at finde, kan tilbyde et værktøj baseret på adfærdsbiometri og algoritmer, der opdager seksuelle krænkere i onlinechat med børn.

Og nu har virksomheden, som for nylig rapporteret af Dagens Næringsliv, en national finansavis, rejst kapital på 7,5 NOK. million, med investorer, herunder Firda og Wiski Capital, to norsk-baserede firmaer.

I sin nyeste indsats arbejder virksomheden med 50 millioner chatlinjer på at udvikle et værktøj, der skal finde højrisikosamtaler, hvor misbrugere forsøger at komme i kontakt med børn. Målet er at identificere karakteristiske træk ved, hvad misbrugere efterlader på spilplatforme og i sociale medier.

"Vi sigter mod de store spilproducenter og håber at få et par hundrede spil på platformen," siger Hege Tokerud, medstifter og general manager, til Dagens Næringsliv.

Cybergrooming et voksende problem

Cybergrooming er, når voksne bliver venner med børn online, ofte ved hjælp af en falsk profil.

Men "nogle seksuelle rovdyr kommer bare lige ud og spørger, om barnet er interesseret i at chatte med en ældre person, så der er ikke behov for en falsk identitet," sagde Bours.

Gerningsmandens formål er ofte at lokke børnene over på en privat kanal, så børnene kan sende billeder af sig selv, med og uden tøj, og måske i sidste ende aftale at møde den unge.

Gerningsmændene bryder sig ikke så meget om at sende billeder af sig selv, sagde Bours. "Exhibitionisme er kun en lille del af deres motivation," sagde han. "At få billeder er langt mere interessant for dem, og ikke kun stillbilleder, men levende billeder via et webcam."

"At føre tilsyn med alle disse samtaler for at forhindre misbrug i at ske er umuligt for moderatorer, der overvåger systemet manuelt. Det, der er brug for, er automatisering, der underretter moderatorer om igangværende samtale," siger Bours.

AiBA har udviklet et system ved hjælp af flere algoritmer, der tilbyder store chatvirksomheder et værktøj, der kan skelne, om voksne eller børn chatter. Det er her adfærdsbiometri kommer ind.

En voksen mand kan udgive sig for at være en 14-årig dreng online. Men måden han skriver på – såsom hans skriverytme eller hans ordvalg – kan afsløre, at han er en voksen mand.

Maskinindlæringsnøgle

AiBA-værktøjet bruger maskinlæringsmetoder til at analysere alle chats og vurdere risikoen ud fra bestemte kriterier. Risikoniveauet kan gå lidt op og ned under samtalen, efterhånden som systemet vurderer hver besked. Det røde advarselssymbol tænder chatten, hvis risikoniveauet bliver for højt, og giver besked til moderatoren, som så kan se på samtalen og vurdere den nærmere.

På denne måde kan algoritmerne opdage samtaler, der bør tjekkes, mens de er i gang, frem for efterfølgende, når skaden eller misbruget måske allerede er sket. Algoritmerne fungerer således som et advarselssignal.

Kold og kynisk

Bours analyserede masser af chatsamtaler fra gamle logfiler for at udvikle algoritmen.

"Ved at analysere disse samtaler lærer vi, hvordan sådanne mænd 'soignerer' modtagerne med komplimenter, gaver og andet smiger, så de afslører mere og mere. Det er koldt, kynisk og nøje planlagt," siger han. "At gennemgå chats er også en del af læringsprocessen, så vi kan forbedre AI og få den til at reagere bedre i fremtiden."

"Faren for, at denne form for kontakt ender med et overfald er høj, især hvis misbrugeren sender modtageren over til andre platforme med video, for eksempel. I en live-situation vil algoritmen markere denne chat som en, der skal overvåges ."

Analyse i realtid

"Målet er at afsløre en misbruger så hurtigt som muligt," siger Bours.

"Hvis vi venter på, at hele samtalen slutter, og chatterne allerede har lavet aftaler, kan det være for sent. Monitoren kan også fortælle barnet i chatten, at de taler med en voksen og ikke et andet barn."

AiBA har samarbejdet med spilfirmaer om at installere algoritmen og arbejder med en dansk spil- og chatplatform kaldet MoviestarPlanet, som henvender sig til børn og har 100 millioner spillere.

Under udviklingen af algoritmerne fandt forskeren ud af, at brugere skriver forskelligt på forskellige platforme såsom Snapchat og TikTok.

"Vi skal tage højde for disse skel, når vi træner algoritmen. Det samme med sprog. Tjenesten skal udvikles til alle typer sprog," siger Bours.

Ser på chatmønstre

Senest har Bours og hans kolleger kigget på chatmønstre for at se, hvilke mønstre der afviger fra, hvad der ville blive betragtet som normalt.

"Vi har analyseret chatmønstrene - i stedet for tekster - fra 2,5 millioner chats og har været i stand til at finde flere tilfælde af pleje, som ellers ikke ville være blevet opdaget," sagde Bours.

"Denne indledende undersøgelse kiggede på dataene i retrospekt, men i øjeblikket er vi ved at undersøge, hvordan vi kan bruge dette i et system, der følger sådanne chatmønstre direkte og kan træffe øjeblikkelige beslutninger om at rapportere en bruger til en moderator," sagde han. + Udforsk yderligere

Microsoft søger at opdage sex-rovdyr i videospilchats

Varme artikler

Varme artikler

-

Flyselskaber regner med, at forretningsrejsende fortsætter bedringFolk venter i en TSA-kø i John F. Kennedy International Airport i New York, tirsdag den 28. juni 2022. Med sommerferien på vej, regner flyselskaberne med, at flere forretningsrejsende vender tilbage f

Flyselskaber regner med, at forretningsrejsende fortsætter bedringFolk venter i en TSA-kø i John F. Kennedy International Airport i New York, tirsdag den 28. juni 2022. Med sommerferien på vej, regner flyselskaberne med, at flere forretningsrejsende vender tilbage f -

Bærbar AI-enhed forvandler hostelyde til sundhedsdata til influenza- og pandemiprognoserTauhidur Rahman, venstre, og Forsad Al Hossain viser deres FluSense-enhed. Kredit:UMass Amherst University of Massachusetts Amherst forskere har opfundet en bærbar overvågningsenhed drevet af mask

Bærbar AI-enhed forvandler hostelyde til sundhedsdata til influenza- og pandemiprognoserTauhidur Rahman, venstre, og Forsad Al Hossain viser deres FluSense-enhed. Kredit:UMass Amherst University of Massachusetts Amherst forskere har opfundet en bærbar overvågningsenhed drevet af mask -

ASUS anerkender computere, der er inficeret med auto-opdateringsvirusDenne 23. februar 2019, billede viser indersiden af en computer med ASUS-logoet i Jersey City, N.J. Sikkerhedsforskere siger, at hackere inficerede titusindvis af computere fra den taiwanske leveran

ASUS anerkender computere, der er inficeret med auto-opdateringsvirusDenne 23. februar 2019, billede viser indersiden af en computer med ASUS-logoet i Jersey City, N.J. Sikkerhedsforskere siger, at hackere inficerede titusindvis af computere fra den taiwanske leveran -

AI-system gør billedgeneratormodeller som DALL-E 2 mere kreativeDenne række af genererede billeder, der viser et tog på en bro og en flod under broen, blev genereret ved hjælp af en ny metode udviklet af MIT-forskere. Kredit:Massachusetts Institute of Technology

AI-system gør billedgeneratormodeller som DALL-E 2 mere kreativeDenne række af genererede billeder, der viser et tog på en bro og en flod under broen, blev genereret ved hjælp af en ny metode udviklet af MIT-forskere. Kredit:Massachusetts Institute of Technology

- Trætætheden af europæiske træer er faldet kontinuerligt siden 1870

- Holder trit med Moores lov

- Kigger på atomare strukturer med ikke mere end blyant og papir

- Silicapartikler kan føre til nye behandlinger for fedme og diabetes

- Perovskite solceller:Mulige aspekter af høj effektivitet afdækket

- Titrering af natriumcarbonat med saltsyre