Ansigtsgenkendelsessoftware har et kønsproblem

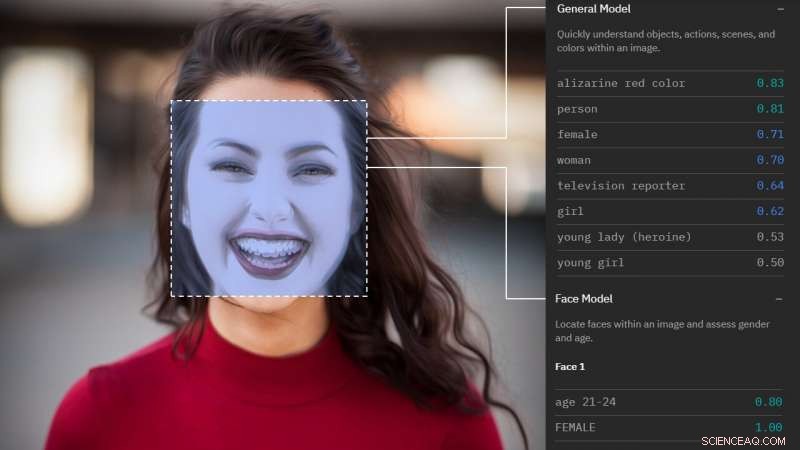

Hvordan ansigtsanalyse ser dig. Kredit:Morgan Klaus Scheuerman/CU Boulder

Med et kort blik på et enkelt ansigt, nye ansigtsgenkendelsessoftware kan nu kategorisere køn for mange mænd og kvinder med bemærkelsesværdig nøjagtighed.

Men hvis det ansigt tilhører en transperson, sådanne systemer tager fejl mere end en tredjedel af tiden, ifølge ny University of Colorado Boulder -forskning.

"Vi fandt ud af, at ansigtsanalysetjenester udførte konsekvent dårligere transpersoner, og var universelt ude af stand til at klassificere ikke-binære køn, "sagde hovedforfatter Morgan Klaus Scheuerman, en ph.d. studerende på informationsvidenskabelig afdeling. "Selvom der er mange forskellige typer mennesker derude, disse systemer har et ekstremt begrænset syn på, hvordan køn ser ud. "

Undersøgelsen kommer på et tidspunkt, hvor ansigtsanalyseteknologier - som bruger skjulte kameraer til at vurdere og karakterisere visse træk ved et individ - bliver mere og mere udbredt, indlejret i alt fra smartphone -dating -apps og digitale kiosker i indkøbscentre til lufthavnssikkerhed og overvågningssystemer til retshåndhævelse.

Tidligere forskning tyder på, at de har tendens til at være mest præcise, når de vurderer køn af hvide mænd, men fejlidentificer kvinder med farve så meget som en tredjedel af tiden.

"Vi vidste, at der var iboende fordomme i disse systemer omkring race og etnicitet, og vi formodede, at der også ville være problemer omkring køn, "sagde seniorforfatter Jed Brubaker, en adjunkt i informationsvidenskab. "Vi satte os for at teste dette i den virkelige verden."

Forskere indsamlede 2, 450 billeder af ansigter fra Instagram, hver af dem var mærket af sin ejer med et hashtag, der angav deres kønsidentitet. Billederne blev derefter opdelt i syv grupper på 350 billeder (#kvinder, #mand, #transkvinde, #transman, #agender, #agenderqueer, #nonbinary) og analyseret af fire af de største udbydere af ansigtsanalysetjenester (IBM, Amazon, Microsoft og Clarifai).

Især Google var ikke inkluderet, fordi det ikke tilbyder kønsgenkendelsestjenester.

Gennemsnitlig, systemerne var mest nøjagtige med fotos af cisgender kvinder (dem født kvinde og identifikation som kvinde), får deres køn rigtigt 98,3% af tiden. De kategoriserede cisgender mænd nøjagtigt 97,6% af tiden.

Men transmænd blev fejlagtigt identificeret som kvinder i op til 38% af tiden.

Og dem, der identificerede sig som agender, genderqueer eller nonbinary - hvilket indikerer, at de hverken identificerer sig som mand eller kvinde - blev forkert karakteriseret 100 procent af tiden.

"Disse systemer kender ikke noget andet sprog end mand eller kvinde, så for mange kønsidentiteter er det ikke muligt for dem at være korrekte, ”siger Brubaker.

Undersøgelsen tyder også på, at sådanne tjenester identificerer køn baseret på forældede stereotyper.

Da Scheuerman, hvem er mand og har langt hår, indsendte sit eget billede, halvt kategoriseret ham som kvinde.

Forskerne kunne ikke få adgang til uddannelsesdata, eller billedindgange, der bruges til at "lære" systemet, hvordan mand og kvinde ser ud, men tidligere forskning tyder på, at de vurderer ting som øjenposition, læbe fylde, hårlængde og endda tøj.

"Disse systemer risikerer at forstærke stereotyper om, hvordan du skal se ud, hvis du vil blive anerkendt som en mand eller en kvinde. Og det påvirker alle, sagde Scheuerman.

Da forsker Morgan Klaus Scheuerman, hvem er en mand, indsendte sit foto til flere ansigtsanalysetjenester, halvdelen tog sit køn forkert. Kredit:Morgan Klaus Scheuerman/CU Boulder

Markedet for ansigtsgenkendelsestjenester forventes at fordobles inden 2024, som teknologiske udviklere arbejder på at forbedre menneske-robot-interaktion og mere omhyggeligt målrette annoncer mod kunder. Allerede, Brubaker bemærker, mennesker engagerer sig i ansigtsgenkendelsesteknologi hver dag for at få adgang til deres smartphones eller logge ind på deres computere.

Hvis det har en tendens til at misbestille visse, allerede sårbar, befolkninger, der kan få alvorlige konsekvenser.

For eksempel, en match-making app kunne sætte nogen op på en date med det forkerte køn, fører til en potentielt farlig situation. Eller et misforhold mellem det køn, et ansigtsgenkendelsesprogram ser og den dokumentation, en person bærer, kan føre til problemer med at komme igennem lufthavnssikkerhed, siger Scheuerman.

Han er mest bekymret over, at sådanne systemer bekræfter forestillinger om, at transkønnede ikke passer ind.

"Folk tænker på computersyn som futuristisk, men der er masser af mennesker, der kunne blive udeladt af denne såkaldte fremtid, " han sagde.

Forfatterne siger, at de gerne vil se, at teknologivirksomheder helt bevæger sig væk fra kønsklassificering og holder sig til mere specifikke etiketter som "langt hår" eller "make-up", når de vurderer billeder.

"Når du går ned ad gaden, kan du se på nogen og formode, at du ved, hvad deres køn er, men det er en virkelig malerisk idé fra 90'erne, og det er ikke sådan, verden er længere, "sagde Brubaker." Efterhånden som vores vision og vores kulturelle forståelse af, hvad køn er, har udviklet sig. Det har algoritmerne, der driver vores teknologiske fremtid, ikke. Det er dybt problematisk. "

Forskningen vil blive præsenteret i november på ACM Conference on Computer Supported Cooperative Work i Austin, Texas.

Varme artikler

Varme artikler

-

Brug af sociale medier foregår både online og offlineKredit:CC0 Public Domain Sociale medier har ændret, hvordan folk interagerer. Imidlertid, brug af sociale medier er hverken statisk eller specifikt knyttet til bestemte platforme. Nye tekniske kap

Brug af sociale medier foregår både online og offlineKredit:CC0 Public Domain Sociale medier har ændret, hvordan folk interagerer. Imidlertid, brug af sociale medier er hverken statisk eller specifikt knyttet til bestemte platforme. Nye tekniske kap -

Stop med at outsource reguleringen af hadefulde ytringer til sociale medierRegulering af hadefulde ytringer på internettet bør ikke overlades til private virksomheder. Kredit:Shutterstock Når det kommer til at håndtere onlinespørgsmål, vi er havnet i den værste af alle m

Stop med at outsource reguleringen af hadefulde ytringer til sociale medierRegulering af hadefulde ytringer på internettet bør ikke overlades til private virksomheder. Kredit:Shutterstock Når det kommer til at håndtere onlinespørgsmål, vi er havnet i den værste af alle m -

Når højteknologi går under jordenANYmal på sin første inspektionstur i Zürichs kloaksystem. Kredit:ETH Zürich / Daniel Winkler ANYmal, en robot udviklet på ETH, kan se og høre, og endda åbne døre. Et internationalt forskerhold ar

Når højteknologi går under jordenANYmal på sin første inspektionstur i Zürichs kloaksystem. Kredit:ETH Zürich / Daniel Winkler ANYmal, en robot udviklet på ETH, kan se og høre, og endda åbne døre. Et internationalt forskerhold ar -

Giver cryptocurrency-brugere mere valuta for pengeneEdderkop, en ny cryptocurrency-routing-ordning, opdeler hver fuld transaktion i mindre pakker, der sendes på tværs af forskellige kanaler med forskellige hastigheder. Kredit:Chelsea Turner, MIT En

Giver cryptocurrency-brugere mere valuta for pengeneEdderkop, en ny cryptocurrency-routing-ordning, opdeler hver fuld transaktion i mindre pakker, der sendes på tværs af forskellige kanaler med forskellige hastigheder. Kredit:Chelsea Turner, MIT En

- 5, 200 år gamle korn i de østlige Altai-bjerge fornyer trans-eurasisk afgrødeudveksling

- Ikke giftig, fleksible energiomformere kunne drive bærbare enheder

- Neuralt netværk registrerer protein-peptidbindingssteder for at sætte gang i opdagelsen af pepti…

- Teknik afslører, hvordan krystaller dannes på overflader

- Ny 4-D transistor er preview af fremtidige computere

- Mindst 18 dræbt, da friske storme ramte det nordlige Indien