Forudsigelse eller årsag? Informationsteori kan have nøglen

Forudsigelse:

1. Shannon-entropi: I sin kerne kvantificerer informationsteori mængden af information indeholdt i en besked eller begivenhed gennem dens entropi. Lav entropi indikerer forudsigelige eller gentagne mønstre, mens høj entropi tyder på usikkerhed eller tilfældighed. Ved at måle entropien af forskellige variabler kan informationsteori hjælpe med at identificere mønstre og komme med forudsigelser om fremtidige begivenheder.

2. Markov-kæder: Markov-kæder er matematiske modeller, der beskriver sandsynligheden for, at et system går fra en tilstand til en anden baseret på dets nuværende tilstand. De bruges i vid udstrækning til forudsigelsesopgaver, såsom vejrudsigter, sprogmodellering og analyse af finansmarkederne. Ved at fange de sekventielle afhængigheder mellem observationer, kan Markov-kæder forudsige fremtidige tilstande eller begivenheder baseret på tidligere sekvenser.

Årsagssammenhæng:

1. Granger-årsagssammenhæng: Granger kausalitet er et statistisk begreb, der bestemmer, om en tidsserie kan bruges til at forudsige en anden. Hvis de tidligere værdier af en serie konsekvent forbedrer forudsigelsen af en anden serie, så siges den førstnævnte at Granger-forårsager sidstnævnte. Denne tilgang giver mulighed for identifikation af potentielle årsagssammenhænge mellem variabler, selv i fravær af direkte eksperimentel manipulation.

2. Overførselsentropi: Overførselsentropi er et andet informationsteoretisk mål, der kvantificerer mængden af information, der overføres fra en variabel til en anden. I modsætning til Granger-kausalitet kræver overførselsentropi ikke antagelsen om en lineær sammenhæng mellem variabler. Det kan detektere ikke-lineære kausale interaktioner og giver indsigt i informationsstrømmen i et system.

3. Bayesiske netværk: Bayesianske netværk er grafiske modeller, der repræsenterer probabilistiske forhold mellem variabler. De giver mulighed for repræsentation af komplekse kausale strukturer, herunder direkte og indirekte sammenhænge. Ved at opdatere netværket med observerede data kan Bayesianske netværk lave sandsynlighedsforudsigelser og udlede årsagssammenhænge baseret på de betingede sandsynligheder mellem variabler.

Sammenfattende tilbyder informationsteori en række værktøjer og begreber, der kan anvendes til både forudsigelse og slutningen af årsagssammenhæng. Ved at kvantificere informationsindhold og analysere mønstre i data giver informationsteori en ramme for at lave pålidelige forudsigelser og afdække skjulte årsagssammenhænge.

Varme artikler

Varme artikler

-

Sidste frugt-ier:Thailand sender ildelugtende durian ud i rummetDurian spises i hele Sydøstasien og er både berømt for sin popularitet og berygtet for sin skarpe lugt Det er et lille skridt for Thailand, et kæmpe spring for Sydøstasiens mest ildelugtende frugt

Sidste frugt-ier:Thailand sender ildelugtende durian ud i rummetDurian spises i hele Sydøstasien og er både berømt for sin popularitet og berygtet for sin skarpe lugt Det er et lille skridt for Thailand, et kæmpe spring for Sydøstasiens mest ildelugtende frugt -

NASA rover streger mod en landing på MarsI denne illustration stillet til rådighed af NASA, Perseverance-roveren kaster sit rumfartøjs krydstogtscene af, minutter før de træder ind i Mars atmosfære. (NASA/JPL-Caltech via AP) En NASA-rove

NASA rover streger mod en landing på MarsI denne illustration stillet til rådighed af NASA, Perseverance-roveren kaster sit rumfartøjs krydstogtscene af, minutter før de træder ind i Mars atmosfære. (NASA/JPL-Caltech via AP) En NASA-rove -

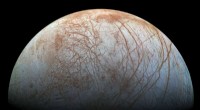

Overfladen af Jupiters måne Europa væltet af små nedslagDette farvebillede af Jupiters måne Europa blev fanget af NASAs Galileo-rumfartøj i slutningen af 1990erne. Forskere studerer processer, der påvirker overfladen, mens de forbereder sig på at udforsk

Overfladen af Jupiters måne Europa væltet af små nedslagDette farvebillede af Jupiters måne Europa blev fanget af NASAs Galileo-rumfartøj i slutningen af 1990erne. Forskere studerer processer, der påvirker overfladen, mens de forbereder sig på at udforsk -

Kraftfuldt nyt værktøj til at lede efter liv ud over JordenTakket være en omhyggeligt designet optisk opsætning, det nye ultrakompakte mikro Raman (SUCR) instrument kan udføre mikroskopisk Raman analyse af prøver 10 centimeter væk fra instrumentet med en oplø

Kraftfuldt nyt værktøj til at lede efter liv ud over JordenTakket være en omhyggeligt designet optisk opsætning, det nye ultrakompakte mikro Raman (SUCR) instrument kan udføre mikroskopisk Raman analyse af prøver 10 centimeter væk fra instrumentet med en oplø

- Hvorfor nogle grønne bliver brune i historiske malerier

- Eksperimenter udforsker defekter og fluktuationer i kvanteenheder

- Modstandsdygtighed over for klimaændringer? Ny undersøgelse finder, at blæksprutter tilpasser sig…

- Forskere bygger masseproducerbare miniature kvantehukommelseselementer

- Hvordan man beregner Smys

- Apple-Samsung iPhone design kopietui går til juryen