Vil du have computere til at se bedre i den virkelige verden? Træn dem i virtual reality

Forskere har udviklet en ny måde at forbedre, hvordan computere "ser" og "forstår" objekter i den virkelige verden ved at træne computernes visuelle systemer i et virtuelt miljø.

Forskerholdet offentliggjorde deres resultater i IEEE/CAA Journal of Autmatica Sinica , en fælles udgivelse af IEEE og Chinese Association of Automation.

For at computere kan lære og nøjagtigt genkende objekter såsom bygninger, gader eller mennesker, maskinerne skal stole på at behandle enorme mængder mærkede data, I dette tilfælde, billeder af objekter med nøjagtige anmærkninger. En selvkørende bil, for eksempel, har brug for tusindvis af billeder af veje og biler at lære af. Datasæt spiller derfor en afgørende rolle i træningen og afprøvningen af computersynssystemerne. Brug af manuelt mærkede træningsdatasæt, et computervisionssystem sammenligner sin nuværende situation med kendte situationer og tager den bedste handling, hvad end det sker for at være.

"Imidlertid, at indsamle og kommentere billeder fra den virkelige verden er for krævende med hensyn til arbejdskraft og pengeinvesteringer, " skriver første forfatter Kunfeng Wang, en lektor ved Kinas State Key Laboratory for Management and Control for Complex Systems. Wang siger, at målet med deres forskning er at overvinde begrænsninger af billeddatasæt fra den virkelige verden, som er utilstrækkelige til at træne og teste computers synssystemer.

For at løse dette problem, Wang og hans kolleger oprettede et datasæt kaldet ParallelEye. ParallelEye blev nærmest genereret ved at bruge kommercielt tilgængelig computersoftware, specifikt videospilmotoren Unity3D. Ved hjælp af et kort over Zhongguancun, et af de travleste byområder i Beijing, Kina, som deres reference, de genskabte praktisk talt bymæssige omgivelser ved at tilføje bygninger, biler og endda vejrforhold. Så placerede de et virtuelt "kamera" på en virtuel bil. Bilen kørte rundt i den virtuelle Zhongguancun og skabte datasæt, der er repræsentative for den virkelige verden.

Gennem deres "fuldstændige kontrol" over det virtuelle miljø, Wangs team var i stand til at skabe ekstremt specifikke brugbare data til deres objektdetektionssystem - et simuleret autonomt køretøj. Resultaterne var imponerende, producerer en markant stigning i ydeevnen på næsten alle testede målinger. Ved at designe skræddersyede datasæt, et større udvalg af autonome systemer vil være mere praktisk at træne.

Mens deres største ydelsesforøgelse kom fra at inkorporere ParallelEye-datasæt med datasæt fra den virkelige verden, Wangs team har demonstreret, at deres metode er i stand til nemt at skabe forskellige sæt billeder. "Ved brug af ParallelEye-visionsrammen, massive og diversificerede billeder kan syntetiseres fleksibelt, og dette kan hjælpe med at bygge mere robuste computervisionssystemer, " siger Wang. Forskerholdets foreslåede tilgang kan anvendes på mange visuelle computerscenarier, herunder visuel overvågning, medicinsk billedbehandling, og biometri.

Næste, holdet vil skabe et endnu større sæt virtuelle billeder, forbedre realismen af virtuelle billeder, og udforsk nytten af virtuelle billeder til andre computervisionsopgaver. Wang siger, "Vores ultimative mål er at opbygge en systematisk teori om parallel vision i stand til at træne, prøve, forstå og optimere computervisionsmodeller med virtuelle billeder og få modellerne til at fungere godt i komplekse scener."

Sidste artikelAt lære computerprogrammering, uden lærere og uden undervisning

Næste artikelDroner vil snart beslutte, hvem de skal dræbe

Varme artikler

Varme artikler

-

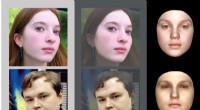

Computermodel for ansigtsbehandling kan afsløre, hvordan hjernen producerer rigt detaljerede visuel…MIT kognitive forskere har udviklet en computermodel for ansigtsgenkendelse, der udfører en række beregninger, der vender de trin, som et computergrafikprogram ville bruge til at generere en 2D -frems

Computermodel for ansigtsbehandling kan afsløre, hvordan hjernen producerer rigt detaljerede visuel…MIT kognitive forskere har udviklet en computermodel for ansigtsgenkendelse, der udfører en række beregninger, der vender de trin, som et computergrafikprogram ville bruge til at generere en 2D -frems -

Apps sender intime brugerdata til Facebook:rapporterEn Wal Street Journal -undersøgelse fandt, at mobilapps kan dele følsomme personlige data med Facebook, selvom de ikke er medlemmer af det sociale netværk En nyhedsrapport fredag sagde, at mange

Apps sender intime brugerdata til Facebook:rapporterEn Wal Street Journal -undersøgelse fandt, at mobilapps kan dele følsomme personlige data med Facebook, selvom de ikke er medlemmer af det sociale netværk En nyhedsrapport fredag sagde, at mange -

Tape, briller giver forskere mulighed for at omgå Face IDKredit:CC0 Public Domain I september 2018, en tech-watcher var beundringsværdigt ærlig:Hvis du er en normal person, Apple FaceID er grundlæggende sikkert, hun sagde. Men så denne tech-watcher, Rac

Tape, briller giver forskere mulighed for at omgå Face IDKredit:CC0 Public Domain I september 2018, en tech-watcher var beundringsværdigt ærlig:Hvis du er en normal person, Apple FaceID er grundlæggende sikkert, hun sagde. Men så denne tech-watcher, Rac -

Sammenligning af boligers energiforbrug på lignende vejrdageMikronettet til Smart Neighborhood i Hoover, Alabama, består af solpaneler og en batteripakke og gør det muligt for boliger at afbryde strømnettet. Kredit:Southern Company For bedre at kunne beste

Sammenligning af boligers energiforbrug på lignende vejrdageMikronettet til Smart Neighborhood i Hoover, Alabama, består af solpaneler og en batteripakke og gør det muligt for boliger at afbryde strømnettet. Kredit:Southern Company For bedre at kunne beste

- Virgin Galactic afslører futuristisk forpost for rumturisme

- Iron nanorobots viser deres sande slag

- Masser af plastaffald kommer hvert år ind i de store søer - hvor går det hen?

- Common Sense Conduit Bending & Cable Tray Techniques

- Lufthansa vil sætte 150 fly på jorden på grund af coronavirus

- Bakterieprotein tjener som sensor