Computermodel for ansigtsbehandling kan afsløre, hvordan hjernen producerer rigt detaljerede visuelle repræsentationer så hurtigt

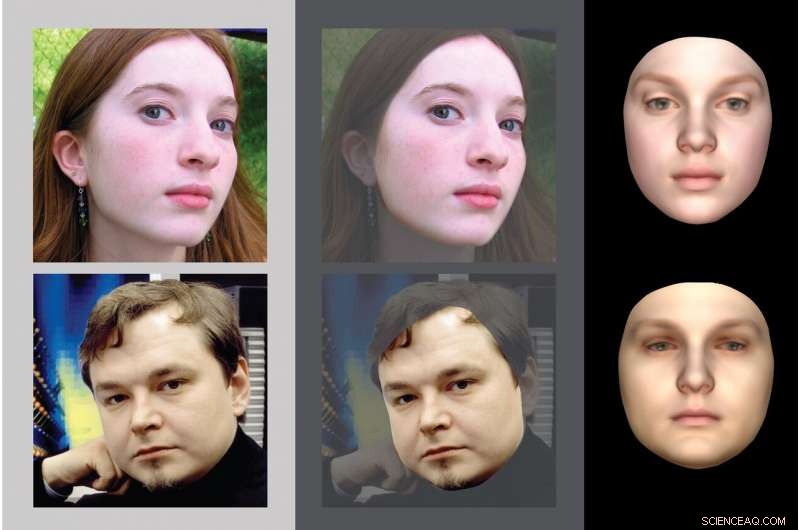

MIT kognitive forskere har udviklet en computermodel for ansigtsgenkendelse, der udfører en række beregninger, der vender de trin, som et computergrafikprogram ville bruge til at generere en 2D -fremstilling af et ansigt. MIT kognitive forskere har udviklet en computermodel for ansigtsgenkendelse, der udfører en række beregninger, der vender de trin, som et computergrafikprogram ville bruge til at generere en 2D -repræsentation af et ansigt. Kredit:MIT

Når vi åbner øjnene, vi ser straks vores omgivelser i detaljer. Hvordan hjernen er i stand til at danne disse rigt detaljerede repræsentationer af verden så hurtigt er et af de største uløste gåder i studiet af syn.

Forskere, der studerer hjernen, har forsøgt at replikere dette fænomen ved hjælp af computermodeller af syn, men indtil videre, førende modeller udfører kun meget enklere opgaver såsom at vælge et objekt eller et ansigt mod en rodet baggrund. Nu, et team ledet af MIT kognitive forskere har produceret en computermodel, der fanger det menneskelige visuelle systems evne til hurtigt at generere en detaljeret scenebeskrivelse fra et billede, og giver en vis indsigt i, hvordan hjernen opnår dette.

"Det, vi forsøgte at gøre i dette arbejde, er at forklare, hvordan opfattelse kan være så meget rigere end blot at vedhæfte semantiske etiketter på dele af et billede, og for at undersøge spørgsmålet om, hvordan vi ser hele den fysiske verden, "siger Josh Tenenbaum, professor i computational kognitiv videnskab og medlem af MIT's Computer Science and Artificial Intelligence Laboratory (CSAIL) og Center for Brains, Sind, og maskiner (CBMM).

Den nye model antyder, at når hjernen modtager visuelt input, det udfører hurtigt en række beregninger, der vender de trin, som et computergrafikprogram ville bruge til at generere en 2-D gengivelse af et ansigt eller et andet objekt. Denne model, kendt som effektiv invers grafik (EIG), korrelerer også godt med elektriske optagelser fra ansigtsselektive regioner i hjernen hos ikke-menneskelige primater, tyder på, at det primatiske visuelle system kan være organiseret på nogenlunde samme måde som computermodellen, siger forskerne.

Ilker Yildirim, en tidligere MIT postdoc, der nu er adjunkt i psykologi ved Yale University, er hovedforfatter af papiret, som vises i dag i Videnskab fremskridt . Tenenbaum og Winrich Freiwald, professor i neurovidenskab og adfærd ved Rockefeller University, er seniorforfatterne af undersøgelsen. Mario Belledonne, en kandidatstuderende på Yale, er også forfatter.

Omvendt grafik

Årtiers forskning om hjernens visuelle system har undersøgt, i detaljer, hvordan lysindgang på nethinden omdannes til sammenhængende scener. Denne forståelse har hjulpet forskere i kunstig intelligens med at udvikle computermodeller, der kan replikere aspekter af dette system, såsom genkendelse af ansigter eller andre genstande.

"Vision er det funktionelle aspekt af hjernen, som vi forstår bedst, hos mennesker og andre dyr, "Tenenbaum siger." Og computersyn er et af de mest succesrige områder inden for AI på dette tidspunkt. Vi tager for givet, at maskiner nu meget godt kan se på billeder og genkende ansigter, og opdage andre slags objekter. "

Imidlertid, selv disse sofistikerede kunstige intelligenssystemer kommer ikke i nærheden af, hvad det menneskelige visuelle system kan, Siger Yildirim.

"Vores hjerner opdager ikke bare, at der er et objekt derovre, eller genkende og sætte en etiket på noget, "siger han." Vi ser alle formerne, geometrien, overfladerne, teksturerne. Vi ser en meget rig verden. "

For mere end et århundrede siden, lægen, fysiker, og filosofen Hermann von Helmholtz teoretiserede, at hjernen skaber disse rige repræsentationer ved at vende processen med billeddannelse. Han antog, at det visuelle system indeholder en billedgenerator, der ville blive brugt, for eksempel, at producere de ansigter, vi ser under drømme. Hvis du kører denne generator omvendt, ville hjernen kunne arbejde baglæns fra billedet og udlede, hvilken slags ansigt eller et andet objekt der ville frembringe det billede, siger forskerne.

Imidlertid, spørgsmålet forblev:Hvordan kunne hjernen udføre denne proces, kendt som omvendt grafik, så hurtigt? Computerforskere har forsøgt at oprette algoritmer, der kan udføre denne bedrift, men de bedste tidligere systemer kræver mange cyklusser af iterativ behandling, tager meget længere tid end de 100 til 200 millisekunder, hjernen kræver for at skabe en detaljeret visuel fremstilling af det, du ser. Neurovidenskabsfolk mener, at opfattelsen i hjernen kan fortsætte så hurtigt, fordi den implementeres i en for det meste feedforward -passage gennem flere hierarkisk organiserede lag af neural behandling.

Det MIT-ledede team satte sig for at opbygge en særlig form for dyb neural netværksmodel for at vise, hvordan et neuralt hierarki hurtigt kan udlede de underliggende træk ved en scene-i dette tilfælde, et bestemt ansigt. I modsætning til de standard dybe neurale netværk, der bruges til computersyn, som er uddannet fra mærkede data, der angiver klassen af et objekt i billedet, forskernes netværk er trænet ud fra en model, der afspejler hjernens indre repræsentationer af, hvordan scener med ansigter kan se ud.

Deres model lærer således at vende trinene udført af et computergrafikprogram til generering af ansigter. Disse grafikprogrammer begynder med en tredimensionel repræsentation af et individuelt ansigt og konverterer det derefter til et todimensionelt billede, set fra et bestemt synspunkt. Disse billeder kan placeres på et vilkårligt baggrundsbillede. Forskerne teoretiserer, at hjernens visuelle system kan gøre noget lignende, når du drømmer eller tryller et mentalt billede af en andens ansigt.

Forskerne uddannede deres dybe neurale netværk til at udføre disse trin omvendt - det vil sige, det begynder med 2-D-billedet og tilføjer derefter funktioner som tekstur, krumning, og belysning, at skabe det, forskerne kalder en "2.5D" -repræsentation. Disse 2,5D -billeder angiver ansigtets form og farve fra et bestemt synspunkt. Disse konverteres derefter til 3D-repræsentationer, som ikke afhænger af synspunktet.

"Modellen redegør på systemniveau for behandlingen af ansigter i hjernen, lade det se et billede og i sidste ende nå frem til et 3D-objekt, som omfatter repræsentationer af form og tekstur, gennem dette vigtige mellemtrin i et 2.5D -billede, "Siger Yildirim.

Model ydeevne

Forskerne fandt ud af, at deres model er i overensstemmelse med data opnået ved at studere bestemte regioner i hjernen hos makakaber. I en undersøgelse offentliggjort i 2010, Freiwald og Doris Tsao fra Caltech registrerede neuroners aktivitet i disse regioner og analyserede, hvordan de reagerede på 25 forskellige ansigter, set fra syv forskellige synspunkter. Denne undersøgelse afslørede tre faser af ansigtsbehandling på højere niveau, som MIT -teamet nu antager svarer til tre faser af deres omvendte grafiske model:groft, et 2.5D synspunktafhængigt trin; en etape, der bygger bro fra 2,5 til 3-D; og en 3-D, synspunkt-invariant fase af ansigtsrepræsentation.

"Det vi viser er, at både de kvantitative og kvalitative responsegenskaber for de tre hjernens niveauer synes at passe bemærkelsesværdigt godt til de tre øverste niveauer i det netværk, vi har bygget, "Siger Tenenbaum.

Forskerne sammenlignede også modellens ydeevne med menneskers i en opgave, der involverer genkendelse af ansigter fra forskellige synsvinkler. Denne opgave bliver sværere, når forskere ændrer ansigterne ved at fjerne ansigtets tekstur og samtidig bevare dens form, eller forvrænge formen, samtidig med at den relative tekstur bevares. Den nye models ydeevne lignede meget mere menneskers end computermodeller, der bruges i state-of-the-art ansigtsgenkendelsessoftware, yderligere bevis på, at denne model kan være tættere på at efterligne, hvad der sker i det menneskelige visuelle system.

Forskerne planlægger nu at fortsætte med at teste modelleringsmetoden på yderligere billeder, herunder objekter, der ikke er ansigter, at undersøge, om invers grafik også kan forklare, hvordan hjernen opfatter andre slags scener. Ud over, de mener, at tilpasning af denne tilgang til edb-vision kan føre til bedre performende AI-systemer.

"Hvis vi kan vise tegn på, at disse modeller kan svare til, hvordan hjernen fungerer, dette arbejde kan få computervisionforskere til at tage mere alvorligt og investere flere tekniske ressourcer i denne omvendte grafiske tilgang til opfattelse, "Tenenbaum siger." Hjernen er stadig guldstandarden for enhver form for maskine, der ser verden rigt og hurtigt. "

Sidste artikelGoodyears bionedbrydelige konceptdæk regenererer slidbanen

Næste artikelForbedring af visionen om selvkørende biler

Varme artikler

Varme artikler

-

Boeing tasker forretning til problemfyldte 737 MAX på Dubai-messenDen urolige amerikanske flyproducent Boeing har vundet et nyt løft på Dubai Air Show med en hensigtserklæring fra det kasakhiske flag luftfartsselskab Air Astana om at købe 30 af deres 737 MAX-8 model

Boeing tasker forretning til problemfyldte 737 MAX på Dubai-messenDen urolige amerikanske flyproducent Boeing har vundet et nyt løft på Dubai Air Show med en hensigtserklæring fra det kasakhiske flag luftfartsselskab Air Astana om at købe 30 af deres 737 MAX-8 model -

Små afrikanske nystartede virksomheder tiltrækker interesse efter langsom startManglen på en sikker elforsyning har fået nogle kenyanere til at installere solpaneler Afrikanske højteknologiske startups er små sammenlignet med deres amerikanske og europæiske jævnaldrende, men

Små afrikanske nystartede virksomheder tiltrækker interesse efter langsom startManglen på en sikker elforsyning har fået nogle kenyanere til at installere solpaneler Afrikanske højteknologiske startups er små sammenlignet med deres amerikanske og europæiske jævnaldrende, men -

Cybersikkerhed kræver internationalt samarbejde, tillidKredit:CC0 Public Domain De fleste eksperter er enige om, at statsstøttede hackere i Rusland forsøger at bruge internettet til at infiltrere det amerikanske elnet og sabotage valg. Og alligevel s

Cybersikkerhed kræver internationalt samarbejde, tillidKredit:CC0 Public Domain De fleste eksperter er enige om, at statsstøttede hackere i Rusland forsøger at bruge internettet til at infiltrere det amerikanske elnet og sabotage valg. Og alligevel s -

Facebook starter snart nomineringer til indholdstilsynspanelFacebook sagde, at det går videre med administrerende direktør Mark Zuckerbergs plan om at etablere et indholdstilsynspanel, der vil fungere som en højesteret for vanskelige beslutninger om, hvad de s

Facebook starter snart nomineringer til indholdstilsynspanelFacebook sagde, at det går videre med administrerende direktør Mark Zuckerbergs plan om at etablere et indholdstilsynspanel, der vil fungere som en højesteret for vanskelige beslutninger om, hvad de s

- Ny undersøgelse viser, at kunstværker er 35 procent mindre værd, når de er skabt af torturerede …

- Sådan konverteres sekunder til miles per time

- Vanddråber som miniaturiserede reagensglas

- Drivhusgasemissioner fra reservoirer højere end tidligere forventet

- Hvad unge mennesker spørger om, når de er garanteret anonymitet

- Investeringer i cykelruter forbedrer adgangen til job i amerikanske metroer