Forskere arbejder på algoritmer, der afslører ansigtsbytte

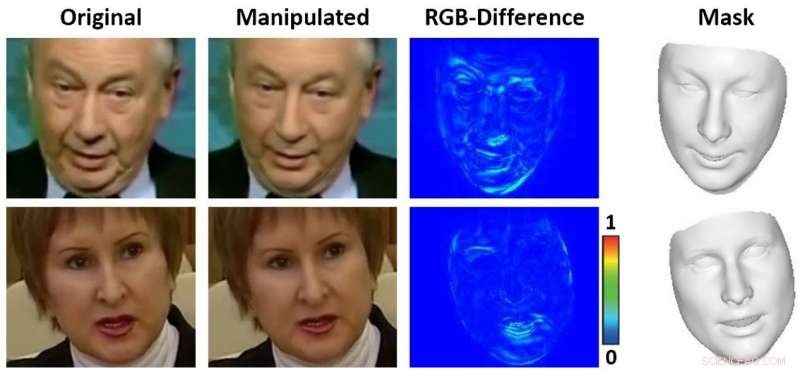

Falsk eller ægte? Eksempler på FaceForensics Self-Reenactment Dataset. Fra venstre mod højre:originalt inputbillede, selvreageret outputbillede, farveforskelsplot og ansigtsmaske, der bruges under syntese af outputbilledet. Kredit:arXiv:1803.09179 [cs.CV]

Billedmanipulation i dette avancerede stadie af den digitale tidsalder er ikke så sjovt, men et skægt våben, i skyggen af falske nyheder, at påvirke opinionen og udløse skandaler.

Ansigtsbytte, i særdeleshed, Det lyder sjovt, hvis du tænker på det som et grin ved et familiebord, mens børn og voksne prøver forskellige ansigter på forskellige mennesker. Imidlertid, det er også et værktøj til langt værre motiver. Byt Krishna ind Engadget bemærkede, at "Folk har, selvfølgelig, udnyttet dette værktøj til nogle forstyrrende formål, inklusive ansigtsudskiftning af mennesker til pornografiske videoer – den ultimative hævnporno."

I MIT Technology Review , "Emerging Technology from the arXiv" sagde, "Pornografiske videoer kaldet 'deepfakes' er dukket op på websteder, der viser berømte personers ansigter overlejret på kroppe af skuespillere."

Forskere, imidlertid, interesseret i at udforske værktøjet og hvordan man kan se, om det bruges, er kommet frem til en algoritme, siger observatører, som kan overgå andre tilgængelige teknikker. De fandt ud af en måde at opdage en ansigtsbytning via algoritmen, samler op på forfalskede videoer, så snart de er blevet offentliggjort.

Analyse Vidhya kommenterede, "Noget beslægtet med denne algoritme var desperat påkrævet for at føre kampen mod, at ansigtsbytte blev brugt af de forkerte årsager. Ved at udgive forskningspapiret til offentligheden, forskerne håber, at andre også tager stafetten op og arbejder på denne undersøgelse for at gøre den mere præcis og præcis."

Andreas Rossler var teamleder for deltagerne fra Münchens Tekniske Universitet, Universitet Federico II i Napoli og Universitetet i Erlangen-Nürnberg.

De trænede algoritmen, XceptionNet, ved hjælp af et stort sæt ansigtsbytte, sagde Engadget .

"Vi sætter en stærk baseline af resultater for detektering af en ansigtsmanipulation med moderne dyb-læringsarkitekturer, " sagde Rossler og hold ind MIT Technology Review . Størrelsen betød.

Størrelsen af denne database var en væsentlig forbedring i forhold til, hvad der tidligere havde været tilgængeligt. "Vi introducerer et nyt datasæt af manipulerede videoer, der overstiger alle eksisterende offentligt tilgængelige retsmedicinske datasæt i størrelsesordener, sagde Rossler.

I deres papir, Forfatterne sagde, at de introducerede et datasæt til ansigtsmanipulation, FaceForensics, "af omkring en halv million redigerede billeder (fra over 1000 videoer)."

Artiklen har titlen "FaceForensics:A Large-scale Video Dataset for Forgery Detection in Human Faces, " på arXiv. Forfattere er Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Riess, Justus Thies og Matthias Nießner.

Forfatterne henledte opmærksomheden på vanskeligheden – for mennesker og computere – i at forsøge at skelne mellem original og manipuleret video, "især når videoerne er komprimerede eller har lav opløsning, som det ofte sker på sociale netværk."

De gjorde også opmærksom på, at "Forskning i påvisning af ansigtsmanipulationer er blevet alvorligt hæmmet af manglen på tilstrækkelige datasæt."

Der er en nuance i deres succes, selvom, som også fortjener opmærksomhed. Artiklen "Emerging Technology from the arXiv" kaldte det "stikket i halen." Hvad er det? "Den samme dybe indlæringsteknik, der kan se videoer med ansigtsbytte, kan også bruges til at forbedre kvaliteten af ansigtsbytte i første omgang - og det kan gøre dem sværere at opdage."

Engadget lignende sagt, "XceptionNet udkonkurrerer klart sine rivaliserende teknikker til at opdage denne form for falsk video, men det forbedrer faktisk også kvaliteten af forfalskninger. Rosslers team kan bruge de største kendetegn ved en ansigtsbytte for at gøre manipulationen mere problemfri. Det snyder ikke XceptionNet, men i det lange løb, det kan gøre det sværere for andre metoder at opdage falske videoer."

Pranav Dar, i Analyse Vidhya , også vejet ind i, hvad han kaldte "en advarsel med denne algoritme - den kan også potentielt bruges til at forbedre kvaliteten af ansigtsbytningen, hvilket vil gøre det sværere at opdage det falske. så snart en forfalskningsdetekteringsalgoritme er lanceret, svindlerne forsøger altid at forfine deres model for at være et skridt foran."

Ikke desto mindre, forfatterne sagde, "vores raffinaderi forbedrer primært den visuelle kvalitet, men det begrænser kun en smule forfalskningsdetektering for deep learning-metoden, der trænes nøjagtigt på de forfalskede outputdata."

© 2018 Tech Xplore

Sidste artikelKubricks AI mareridt, 50 år senere

Næste artikelSverige installerer sektion af elektrificeret vej

Varme artikler

Varme artikler

-

Flyvende fiskerobot kan drive sig selv op af vandet og glide gennem luftenIllustration af robotten, der springer op af vandet. Kredit:Aerial Robotics Lab/Imperial College London En bio-inspireret bot bruger vand fra miljøet til at skabe en gas og lancere sig selv fra va

Flyvende fiskerobot kan drive sig selv op af vandet og glide gennem luftenIllustration af robotten, der springer op af vandet. Kredit:Aerial Robotics Lab/Imperial College London En bio-inspireret bot bruger vand fra miljøet til at skabe en gas og lancere sig selv fra va -

Ingeniører blander og matcher materialer for at lave ny elastisk elektronikMed en ny teknik, MIT -forskere kan skrælle og stable tynde film af metaloxider - kemiske forbindelser, der kan designes til at have unikke magnetiske og elektroniske egenskaber. Filmene kan blandes o

Ingeniører blander og matcher materialer for at lave ny elastisk elektronikMed en ny teknik, MIT -forskere kan skrælle og stable tynde film af metaloxider - kemiske forbindelser, der kan designes til at have unikke magnetiske og elektroniske egenskaber. Filmene kan blandes o -

Hvorfor du ikke har brug for en 5G-telefon endnuDenne 7. august 2019-filbillede viser Samsung Galaxy Note 10, ret, og Galaxy Note 10 Plus udstillet under en lanceringsbegivenhed i New York. Hvis du er blandt de early adopters, der skal være først p

Hvorfor du ikke har brug for en 5G-telefon endnuDenne 7. august 2019-filbillede viser Samsung Galaxy Note 10, ret, og Galaxy Note 10 Plus udstillet under en lanceringsbegivenhed i New York. Hvis du er blandt de early adopters, der skal være først p -

Mysteriet om fragtskibene, der synker, når deres last pludselig bliver flydendeKredit:Shutterstock Tænk på en farlig last, og giftigt affald eller sprængstoffer kan komme til at tænke på. Men granulerede laster som knust malm og mineralsand er ansvarlige for tabet af adskill

Mysteriet om fragtskibene, der synker, når deres last pludselig bliver flydendeKredit:Shutterstock Tænk på en farlig last, og giftigt affald eller sprængstoffer kan komme til at tænke på. Men granulerede laster som knust malm og mineralsand er ansvarlige for tabet af adskill

- Fleksible kredsløb til 3D-udskrivning

- Ny ultra metalfattig stjerne opdaget

- Startup PlateJoy sender brugerne personlige madplaner for at hjælpe dem med at nå sundhedsmål

- Hawaiis bestyrelse forsinker beslutningen om placeringen af det gigantiske teleskop

- For at få partikler til at flyde mere effektivt, lægge en hindring i vejen

- Undersøgelse afslører mørke sider af kaffedyrkning i Uganda