Neurovidenskabsmænd træner et dybt neuralt netværk til at behandle lyde, som mennesker gør

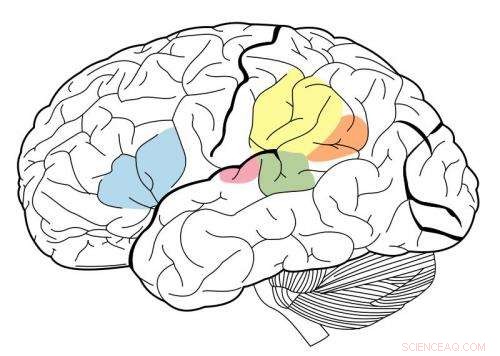

Den primære auditive cortex er fremhævet med magenta, og har været kendt for at interagere med alle områder fremhævet på dette neurale kort. Kredit:Wikipedia.

Ved at bruge et maskinlæringssystem kendt som et dybt neuralt netværk, MIT-forskere har skabt den første model, der kan replikere menneskelig præstation på auditive opgaver, såsom at identificere en musikalsk genre.

denne model, som består af mange lag af informationsbehandlingsenheder, der kan trænes på enorme mængder data til at udføre specifikke opgaver, blev brugt af forskerne til at kaste lys over, hvordan den menneskelige hjerne kan udføre de samme opgaver.

"Hvad disse modeller giver os, for første gang, er maskinsystemer, der kan udføre sanseopgaver, der betyder noget for mennesker, og som gør det på menneskeligt niveau, " siger Josh McDermott, Frederick A. og Carole J. Middleton adjunkt i neurovidenskab ved afdelingen for hjerne- og kognitiv videnskab ved MIT og seniorforfatteren til undersøgelsen. "Historisk set, denne type sansebehandling har været svær at forstå, dels fordi vi ikke rigtigt har haft et meget klart teoretisk grundlag og en god måde at udvikle modeller for, hvad der kan foregå."

Studiet, som vises i 19. april-udgaven af Neuron , tilbyder også bevis for, at den menneskelige auditive cortex er arrangeret i en hierarkisk organisation, meget ligesom den visuelle cortex. I denne type arrangement, sensorisk information passerer gennem successive stadier af behandling, med grundlæggende information behandlet tidligere og mere avancerede funktioner såsom ordbetydning udtrukket i senere faser.

MIT kandidatstuderende Alexander Kell og Stanford University Assistant Professor Daniel Yamins er papirets hovedforfattere. Andre forfattere er tidligere MIT-gæstestuderende Erica Shook og tidligere MIT-postdoc Sam Norman-Haignere.

Modellering af hjernen

Da dybe neurale netværk først blev udviklet i 1980'erne, neurovidenskabsmænd håbede, at sådanne systemer kunne bruges til at modellere den menneskelige hjerne. Imidlertid, computere fra den æra var ikke kraftige nok til at bygge modeller, der var store nok til at udføre opgaver i den virkelige verden, såsom objektgenkendelse eller talegenkendelse.

I løbet af de seneste fem år, fremskridt inden for computerkraft og neural netværksteknologi har gjort det muligt at bruge neurale netværk til at udføre vanskelige opgaver i den virkelige verden, og de er blevet standardtilgangen i mange tekniske applikationer. Parallelt, nogle neurovidenskabsmænd har genovervejet muligheden for, at disse systemer kan bruges til at modellere den menneskelige hjerne.

"Det har været en spændende mulighed for neurovidenskab, i, at vi faktisk kan skabe systemer, der kan gøre nogle af de ting, folk kan gøre, og vi kan så udspørge modellerne og sammenligne dem med hjernen, " siger Kell.

MIT-forskerne trænede deres neurale netværk til at udføre to auditive opgaver, den ene involverer tale og den anden involverer musik. Til taleopgaven, forskerne gav modellen tusindvis af to-sekunders optagelser af en person, der taler. Opgaven var at identificere ordet i midten af klippet. Til musikopgaven, modellen blev bedt om at identificere genren af et to-sekunders musikklip. Hvert klip inkluderede også baggrundsstøj for at gøre opgaven mere realistisk (og sværere).

Efter mange tusinde eksempler, modellen lærte at udføre opgaven lige så præcist som en menneskelig lytter.

"Ideen er med tiden, at modellen bliver bedre og bedre til opgaven, " siger Kell. "Håbet er, at det lærer noget generelt, så hvis du præsenterer en ny lyd, som modellen aldrig har hørt før, det bliver godt, og i praksis er det ofte tilfældet."

Modellen havde også en tendens til at lave fejl på de samme klip, som mennesker lavede flest fejl på.

De behandlingsenheder, der udgør et neuralt netværk, kan kombineres på en række forskellige måder, danner forskellige arkitekturer, der påvirker modellens ydeevne.

MIT-teamet opdagede, at den bedste model for disse to opgaver var en, der opdelte behandlingen i to sæt faser. Det første sæt faser blev delt mellem opgaver, men efter det, den delte sig i to grene til yderligere analyse – en gren til taleopgaven, og en til den musikalske genreopgave.

Bevis for hierarki

Forskerne brugte derefter deres model til at udforske et mangeårigt spørgsmål om strukturen af den auditive cortex:om den er organiseret hierarkisk.

I et hierarkisk system, en række hjerneområder udfører forskellige typer beregninger på sensorisk information, når den strømmer gennem systemet. Det er veldokumenteret, at den visuelle cortex har denne type organisation. Tidligere regioner, kendt som den primære visuelle cortex, reagere på simple funktioner såsom farve eller orientering. Senere faser muliggør mere komplekse opgaver såsom objektgenkendelse.

Imidlertid, det har været svært at teste, om denne type organisering også findes i den auditive cortex, dels fordi der ikke har været gode modeller, der kan kopiere menneskelig auditiv adfærd.

"Vi troede, at hvis vi kunne konstruere en model, der kunne gøre nogle af de samme ting, som folk gør, vi kan så være i stand til at sammenligne forskellige stadier af modellen med forskellige dele af hjernen og få nogle beviser for, om disse dele af hjernen kan være hierarkisk organiseret, " siger McDermott.

Forskerne fandt ud af, at i deres model, grundlæggende træk ved lyd, såsom frekvens, er lettere at udtrække i de tidlige stadier. Efterhånden som information behandles og bevæger sig længere langs netværket, det bliver sværere at udtrække frekvens, men lettere at udtrække information på højere niveau, såsom ord.

For at se, om modelstadierne kan replikere, hvordan den menneskelige auditive cortex behandler lydinformation, forskerne brugte funktionel magnetisk resonansbilleddannelse (fMRI) til at måle forskellige områder af den auditive cortex, mens hjernen behandler lyde fra den virkelige verden. De sammenlignede derefter hjernens reaktioner med reaktionerne i modellen, når den behandlede de samme lyde.

De fandt, at de midterste stadier af modellen svarede bedst til aktivitet i den primære auditive cortex, og senere stadier svarede bedst til aktivitet uden for den primære cortex. Dette giver bevis for, at den auditive cortex kan være arrangeret på en hierarkisk måde, ligner den visuelle cortex, siger forskerne.

"Det, vi ser meget tydeligt, er en sondring mellem primær auditiv cortex og alt andet, " siger McDermott.

Forfatterne planlægger nu at udvikle modeller, der kan udføre andre typer auditive opgaver, såsom at bestemme det sted, hvorfra en bestemt lyd kom, at undersøge, om disse opgaver kan udføres af de veje, der er identificeret i denne model, eller om de kræver separate veje, som så kunne undersøges i hjernen.

Varme artikler

Varme artikler

-

Opstart af kontordeling, WeWork, sænker værdiansættelsesmålet forud for børsnoteringenVi arbejder, startupet, der søger at revolutionere erhvervsejendomme med delt kontorplads, har skåret sit værdiansættelsesmål ned forud for et aktieudbud WeWork har reduceret sit værdiansættelsesm

Opstart af kontordeling, WeWork, sænker værdiansættelsesmålet forud for børsnoteringenVi arbejder, startupet, der søger at revolutionere erhvervsejendomme med delt kontorplads, har skåret sit værdiansættelsesmål ned forud for et aktieudbud WeWork har reduceret sit værdiansættelsesm -

Indsigt fra Uganda om, hvorfor solcellegadelys giver meningSolcelledrevne gadelys i Kampala, Uganda. Kredit:George_TheGiwi/Shutterstock Gadebelysning er vigtig. Det giver uformelle sælgere og handlende mulighed for at arbejde i længere timer og forbedrer

Indsigt fra Uganda om, hvorfor solcellegadelys giver meningSolcelledrevne gadelys i Kampala, Uganda. Kredit:George_TheGiwi/Shutterstock Gadebelysning er vigtig. Det giver uformelle sælgere og handlende mulighed for at arbejde i længere timer og forbedrer -

Baidu nettofortjeneste springer efter videoenhedsspin-offBaidu udskilte sin iQiYi videoenhed i første kvartal, hæve 2,25 milliarder dollars gennem et børsnoteret udbud og notere det på Nasdaq i New York Den kinesiske søgemaskinegigant Baidu rapporterede

Baidu nettofortjeneste springer efter videoenhedsspin-offBaidu udskilte sin iQiYi videoenhed i første kvartal, hæve 2,25 milliarder dollars gennem et børsnoteret udbud og notere det på Nasdaq i New York Den kinesiske søgemaskinegigant Baidu rapporterede -

Kan vand løse udfordringen med lagring af vedvarende energi?Sæsonbestemt pumpet opbevaringsprojekt og hovedkomponenter. Kredit:IIASA Sæsonbestemt pumpet vandkraftlagring (SPHS), en allerede etableret, men sjældent brugt teknologi, kunne være en overkommeli

Kan vand løse udfordringen med lagring af vedvarende energi?Sæsonbestemt pumpet opbevaringsprojekt og hovedkomponenter. Kredit:IIASA Sæsonbestemt pumpet vandkraftlagring (SPHS), en allerede etableret, men sjældent brugt teknologi, kunne være en overkommeli

- Astronomer afslører hjertet af Eta Carinae

- Forskning Emne Ideer til Biologi

- Kvantitativ lempelsesprogram lod husholdningerne bruge mere under den seneste recession. Kunne det v…

- Egyptens arkæologer opdager grave fra 2. 000 år

- Bilsalget i Storbritannien er steget efter årelange fald:industri

- Coda -bølger afslører kuldioxidlager