Lære kinesisk-specifik kodning for fonetisk lighed

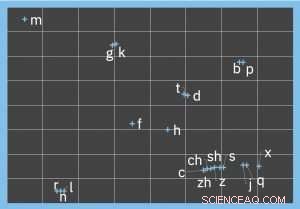

Visualisering, der repræsenterer den fonetiske kodning af Pinyin-initialer. Kredit:IBM

At udføre den mentale gymnastik med at lave den fønetiske skelnen mellem ord og sætninger som "jeg hører" til "jeg er her" eller "jeg kan ikke, men tonsvis" til "Jeg kan ikke sy knapper, " er bekendt for alle, der er stødt på autokorrigerede tekstbeskeder, smarte opslag på sociale medier og lignende. Selvom det ved første øjekast kan se ud til, at fonetisk lighed kun kan kvantificeres for hørbare ord, dette problem er ofte til stede i rent tekstuelle rum.

AI-tilgange til at analysere og forstå tekst kræver rent input, hvilket igen indebærer en nødvendig mængde forbehandling af rådata. Forkerte homofoner og synofoner, hvad enten det er brugt ved en fejl eller i spøg, skal rettes ligesom enhver anden form for stave- eller grammatikfejl. I eksemplet ovenfor, nøjagtig transformation af ordene "høre" og "så" til deres fonetisk lignende korrekte modstykker kræver en robust repræsentation af fonetisk lighed mellem ordpar.

De fleste algoritmer for fonetisk lighed er motiveret af engelske use cases, og designet til indoeuropæiske sprog. Imidlertid, mange sprog, såsom kinesisk, har en anden fonetisk struktur. Talelyden af et kinesisk tegn er repræsenteret af en enkelt stavelse i pinyin, kinesernes officielle romaniseringssystem. En pinyin-stavelse består af:en (valgfri) initial (såsom 'b', 'zh', eller 'x'), en finale (såsom 'a', 'du', 'wai', eller 'yuan') og tone (hvoraf der er fem). Kortlægning af disse talelyde til engelske fonemer resulterer i en ret unøjagtig repræsentation, og brug af indoeuropæiske fonetiske lighedsalgoritmer forstærker problemet yderligere. For eksempel, to velkendte algoritmer, Soundex og Double Metaphone, indekskonsonanter, mens de ignorerer vokaler (og har intet begreb om toner).

Pinyin

Da en pinyin-stavelse repræsenterer et gennemsnit på syv forskellige kinesiske tegn, overvægten af homofoner er endnu større end på engelsk. I mellemtiden brugen af Pinyin til tekstoprettelse er ekstremt udbredt i mobil- og chatapplikationer, både når du bruger tale-til-tekst og når du skriver direkte, da det er mere praktisk at indtaste en Pinyin-stavelse og vælge det tilsigtede tegn. Som resultat, fonetisk-baserede indtastningsfejl er ekstremt almindelige, fremhæver behovet for en meget præcis fonetisk lighedsalgoritme, som man kan stole på for at afhjælpe fejl.

Motiveret af denne use case, som generaliserer til mange andre sprog, der ikke let passer til engelsks fonetiske form, vi udviklede en tilgang til at lære en n-dimensionel fonetisk kodning til kinesisk, Et vigtigt kendetegn ved Pinyin er, at de tre komponenter i en stavelse (initial, slut og tone) bør overvejes og sammenlignes uafhængigt. For eksempel, den fonetiske lighed mellem finalerne "ie" og "ue" er identisk i Pinyin-parrene {"xie2, " "xue2"} og {"lie2, " "lue2"}, på trods af de forskellige initialer. Dermed, ligheden mellem et par pinyin-stavelser er en sammenlægning af lighederne mellem deres initialer, finaler, og toner.

Imidlertid, kunstigt at begrænse kodningsrummet til en lav dimension (f.eks. indeksere hver initial til en enkelt kategori, eller endda numerisk værdi) begrænser nøjagtigheden af at fange de fonetiske variationer. Den korrekte, datadrevet tilgang er derfor at organisk lære en kodning af passende dimensionalitet. Læringsmodellen udleder nøjagtige kodninger ved i fællesskab at overveje Pinyin sproglige karakteristika, såsom artikulationssted og udtalemetoder, samt annoterede træningsdatasæt af høj kvalitet.

Demonstrer en 7,5X forbedring i forhold til eksisterende fonetiske lighedstilgange

De indlærte kodninger kan derfor bruges til, for eksempel, accepter et ord som input og returner en rangeret liste over fonetisk lignende ord (rangeret efter faldende fonetisk lighed). Rangordning er vigtig, fordi downstream-applikationer ikke skaleres til at overveje et stort antal erstatningskandidater for hvert ord, især når du kører i realtid. Som et eksempel fra den virkelige verden, vi evaluerede vores tilgang til at generere en rangeret liste over kandidater for hvert af 350 kinesiske ord taget fra et socialt mediedatasæt, og demonstrerede en 7,5X forbedring i forhold til eksisterende fonetiske lighedstilgange.

Vi håber, at de forbedringer, som dette arbejde giver for at repræsentere sprogspecifik fonetisk lighed, bidrager til kvaliteten af talrige flersprogede naturlige sprogbehandlingsapplikationer. Dette arbejde, del af IBM Research SystemT-projektet, blev for nylig præsenteret på 2018 SIGNLL Conference on Computational Natural Language Learning, og den fortrænede kinesiske model er tilgængelig for forskere at bruge som en ressource til at bygge chatbots, besked apps, stavekontrol og andre relevante applikationer.

Varme artikler

Varme artikler

-

Team undersøger, hvad e-mail-brugere ønsker for bedre at automatisere e-mail, foreslår YouPS-filt…CSAIL ph.d.-studerende Soya Park er hovedforfatter på YouPS-projektet. Kredit:Jason Dorfman/MIT CSAIL Indbakke nul føles ofte som det ultimative uopnåelige mål. Du kan bruge timer på at organisere

Team undersøger, hvad e-mail-brugere ønsker for bedre at automatisere e-mail, foreslår YouPS-filt…CSAIL ph.d.-studerende Soya Park er hovedforfatter på YouPS-projektet. Kredit:Jason Dorfman/MIT CSAIL Indbakke nul føles ofte som det ultimative uopnåelige mål. Du kan bruge timer på at organisere -

Vægklatrerobot inspireret af en igleKredit:CC0 Public Domain En blød og fleksibel igelformet robot, der kan bestige lodrette vægge, er udviklet som en del af et forskningsprojekt. LEeCH (Longitudinally Extensible Continuum-robot in

Vægklatrerobot inspireret af en igleKredit:CC0 Public Domain En blød og fleksibel igelformet robot, der kan bestige lodrette vægge, er udviklet som en del af et forskningsprojekt. LEeCH (Longitudinally Extensible Continuum-robot in -

FIFA giver VAR grønt lys ved VMVAR er noget positivt, der vil bringe meget mere til gennemsigtigheden af fodbold, sagde Gianni Infantino forud for FIFA -rådsmødet fra fredag FIFA forventes at gummistemple videoassistent-domme

FIFA giver VAR grønt lys ved VMVAR er noget positivt, der vil bringe meget mere til gennemsigtigheden af fodbold, sagde Gianni Infantino forud for FIFA -rådsmødet fra fredag FIFA forventes at gummistemple videoassistent-domme -

Tatoveringselektroder fra en ink-jet printer til langsigtet medicinsk diagnostikForskere ved TU Graz præsenterer tatoveringselektroder fra printeren, som er særligt attraktive for langsigtet medicinsk diagnostik. Kredit:Lunghammer - TU Graz Elektroder til langtidsovervågning

Tatoveringselektroder fra en ink-jet printer til langsigtet medicinsk diagnostikForskere ved TU Graz præsenterer tatoveringselektroder fra printeren, som er særligt attraktive for langsigtet medicinsk diagnostik. Kredit:Lunghammer - TU Graz Elektroder til langtidsovervågning