En konceptuel ramme til modellering af menneske-robot-tillid

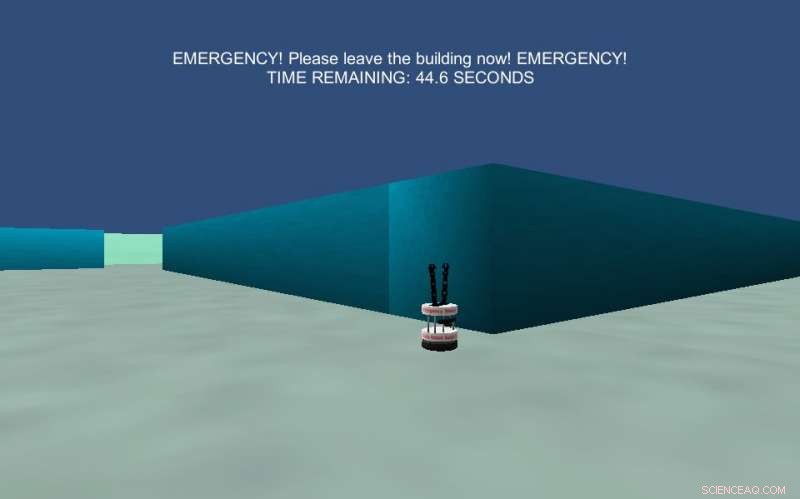

Billedet viser et labyrintnavigationseksperiment, der blev beskrevet som en nødsituation. Deltagerne fik at vide, at deres opgave var at agere, som om de var i en nødevakuering og skulle finde en udgang inden for 30 sekunder for at overleve. Kredit:Wagner et al.

Forskere ved Pennsylvania State University, MIT og Georgia Institute of Technology har for nylig udviklet en konceptuel ramme til modellering af menneske-robot-tillidsfænomenet. Deres rammer, skitseret i et papir udgivet på ACM Digital Library, bruger beregningsmæssige repræsentationer inspireret af spilteori til at repræsentere tillid, en forestilling defineret ved hjælp af teori i socialpsykologi.

Tillid spiller en nøglerolle i interpersonelle interaktioner, både i professionelle og personlige rammer. Når en person stoler på en anden, de kan beslutte at gøre noget, der sætter dem i en betydelig risiko, troen på, at den andens handlinger en vis formindsker denne risiko.

Når det kommer til at definere tillid, mange forskere er enige om, at det medfører en situation, hvor et individ er sårbart, og denne sårbarhed hviler på handlingerne, motivationer, eller andres adfærd. Alan R. Wagner, Paul Robinette, og Ayanna Howard, de tre forskere bag den seneste undersøgelse, ønskede at skabe en ramme, der kunne bruges til at modellere interpersonel tillid mellem mennesker og robotter.

"Vi er interesserede i at udvikle robotter, der ved, hvornår de skal stole på mennesker, forstå hvilke situationer der kræver tillid og tiltrække den rette mængde tillid fra mennesker, Robinette forklarede. "I første omgang, vi blev motiveret af forskning, der tyder på, at nogle gange gør folk ulige ting, når en robot beder dem om, såsom at smide dyre lærebøger ud og hælde appelsinjuice på en potteplante. Der er også et stigende antal situationer, hvor mennesker sætter sig selv i fare i hænderne på en robot (f.eks. selvkørende biler, droner flyver over hovedet, robot sikkerhedsvagter, etc.). Vi ønskede derfor at udvikle en ramme, der giver robotter mulighed for at forstå tillidsforhold til mennesker."

Den konceptuelle ramme udviklet af Wagner og hans kolleger genererede flere testbare hypoteser relateret til menneske-robot-tillid. I deres undersøgelse, forskerne undersøgte disse genererede hypoteser og kørte en række eksperimenter, indsamle både beviser, der understøttede deres rammer og var i konflikt med dem.

"Tillidsrammen startede i Alans forskning, som definerede tillid på en måde, som computere, og dermed robotter, kan bruge, " sagde Robinette.

I sit tidligere arbejde, Wagner definerede situationel tillid som 'en tro, ejes af tillidsmanden, at kurator vil handle på en måde, der mindsker trustors risiko i en situation, hvor kurator har sat sine udfald i fare«. Hans definition fokuserer primært på risikoen i en given situation, også fremhæve troen på, at en person/robot vil handle for at reducere risikoen for den anden person/robot.

"Vores rammer giver kriterier for, hvad der udgør en tillidssituation og giver flere kategorier af situationer, der ikke kræver tillid, for eksempel hvor der ikke er nogen risiko for tillidsmanden, eller hvor risikoen af den ene eller anden grund ikke kan afbødes, " sagde Robinette. "Med denne ramme, en robot kan selv vurdere, om den situation, den befinder sig i, kræver tillid eller ej, og derefter handle passende."

Forskerne testede hypoteserne genereret af deres ramme i en række tests og eksperimenter. For eksempel, i et eksperiment, de præsenterede en gruppe menneskelige deltagere for scenarier, der involverede at stole på eller ikke stole på en anden, spurgte dem derefter, hvilken af disse to muligheder de ville vælge. Deltagerne var enige i betingelserne for tillid, der var skabt af deres rammer, i meget høj grad.

Forskerne udførte adskillige andre eksperimenter, der evaluerede nøjagtigheden af hypoteserne genereret af deres begrebsramme. Nogle af disse indsamlede beviser, der understøtter disse hypoteser, mens nogle få gav modstridende resultater.

"Jeg tror, at det mest meningsfulde resultat fra dette arbejde er, at vi fandt betydelig understøttende evidens for denne ramme i undersøgelser med mange deltagere med forskellig baggrund, " sagde Robinette. "Dette betyder, at tillidsrammen kan bruges i de fleste situationer, giver robotter mulighed for bedre at forstå, hvorfor mennesker omkring dem opfører sig, som de gør. Robotten kan endda bruge denne ramme til at styre mennesker til mindre risikable situationer, for eksempel ved at erkende, at en person stoler for meget på en robot, måske for at gøre noget, det ikke var programmeret til, og informere personen om deres fejl."

Den ramme, som Wagner og hans kolleger har udtænkt, kan anvendes på en række forskellige situationer, der involverer tillid mellem mennesker og robotter. Men i nogle tilfælde var rammens hypoteser ikke tilstrækkelig nøjagtige, for eksempel når folk blev bedt om at stole på en robot i, hvad der så ud til at være en nødsituation.

Disse resultater er ikke desto mindre værdifulde, da de kaster lys over specifikke områder, hvor folk har sværere ved at stole på robotter. Fremtidig forskning kunne se nærmere på, hvorfor deltagerne traf disse valg, og hvad der forhindrede dem i at stole på robotter, samtidig med at de undersøger måder, hvorpå robotingeniører kan forbedre sikkerheden omkring robotter.

"Alan og Ayanna har arbejdet på at udvide denne forskning til robotter inden for sundhedsområdet, "Robinette sagde." Jeg tror, at Alan også har et projekt for at undersøge nødevakueringsrobotter og deres forhold til mennesker mere detaljeret. Jeg har for nylig arbejdet på menneske-maskine-teaming og planlægger at anvende denne tillidsramme på forholdet mellem mennesker og de robotter, de arbejder med."

© 2018 Science X Network

Sidste artikelSol i en kasse ville gemme vedvarende energi til nettet

Næste artikelJapan vil tiltale Nissan såvel som Ghosn:rapport

Varme artikler

Varme artikler

-

Smarthøjttalere er overalt - og de lytter til mere, end du trorMaskiner, der lytter – såsom Google Home – er nu mere almindelige, men teknologien kan høre så meget mere end blot vores stemmekommandoer. Kredit:Shutterstock/David Ferencik Smarthøjttalere udstyr

Smarthøjttalere er overalt - og de lytter til mere, end du trorMaskiner, der lytter – såsom Google Home – er nu mere almindelige, men teknologien kan høre så meget mere end blot vores stemmekommandoer. Kredit:Shutterstock/David Ferencik Smarthøjttalere udstyr -

Fra flyselskaber til pizzeriaer, EU-virksomheder vedtager datalovgivningI denne onsdag, 16. maj, 2018 foto, Lisa Meyer føntørrer håret på en kunde i hendes hår- og skønhedsbutik i London. Meyers frisørsalon er et hyggeligt sted, hvor hendes mor serverer hjemmelavede makro

Fra flyselskaber til pizzeriaer, EU-virksomheder vedtager datalovgivningI denne onsdag, 16. maj, 2018 foto, Lisa Meyer føntørrer håret på en kunde i hendes hår- og skønhedsbutik i London. Meyers frisørsalon er et hyggeligt sted, hvor hendes mor serverer hjemmelavede makro -

Mød de nye vedvarende supermagter - nationer, der er chef for materialerne, der bruges til vind og …Saltlejligheder i Sydamerika indeholder meget af verdens lithium. Kredit:Guido Amrein Schweiz / shutterstock Forestil dig en verden, hvor hvert land ikke kun har overholdt Paris -klimaaftalen, men

Mød de nye vedvarende supermagter - nationer, der er chef for materialerne, der bruges til vind og …Saltlejligheder i Sydamerika indeholder meget af verdens lithium. Kredit:Guido Amrein Schweiz / shutterstock Forestil dig en verden, hvor hvert land ikke kun har overholdt Paris -klimaaftalen, men -

En ny tilgang til sammenlignende dokumentopsummering via klassifikationEt illustrativt eksempel på komparativ opsummering. Firkanter er nyhedsartikler, rækker angiver forskellige nyhedsmedier, og x-aksen angiver tid. De skraverede artikler er valgt til at repræsentere AI

En ny tilgang til sammenlignende dokumentopsummering via klassifikationEt illustrativt eksempel på komparativ opsummering. Firkanter er nyhedsartikler, rækker angiver forskellige nyhedsmedier, og x-aksen angiver tid. De skraverede artikler er valgt til at repræsentere AI

- Rapport advarer om mulige massetab fra cyberangreb i biler

- Grotteraiders:Thai arkæologer jager antikke kunstværker

- Google lancerer kunstig intelligens for at hjælpe med at trække stikket ud (opdatering)

- Blandet organisering af tarmbakterier afsløres af mikrobiom billeddannelsesteknologi

- Mareridt Søpindsvinetænder inspirerer til ny rumforskningsklo

- NASA:Intens arbejde i gang med raket til fremtidige måneskud