En ny maskinlæringsbaseret intentionsdetektionsmetode ved hjælp af førstepersonskamera til Exo Glove Poly II

Et koreansk forskerhold skabte en bærbar håndrobot, der kan hjælpe de handicappede, der mistede håndmobiliteten. Robotten kan registrere brugerens hensigt ved at indsamle adfærd med maskinlæringsalgoritme. Kredit:Soft Robotics Research Center, Seoul National University

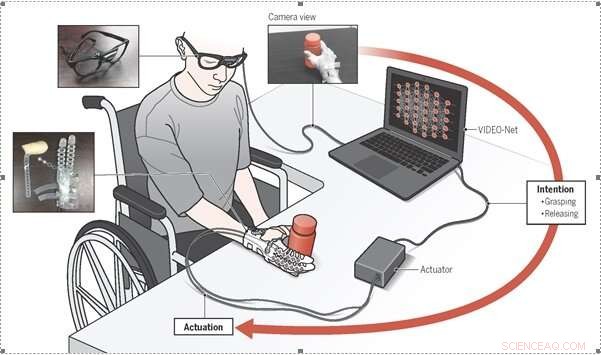

Et koreansk forskerhold har foreslået et nyt paradigme for en bærbar håndrobot, der kan hjælpe mennesker med mistede håndmobilitet. Håndrobotten indsamler brugeradfærd med en maskinlæringsalgoritme for at bestemme brugerens hensigt.

Professor Sungho Jo (KAIST) og Kyu-Jin Cho (Seoul National University) har foreslået et nyt intention-detektionsparadigme for bærbare håndrobotter. Det foreslåede paradigme forudsiger at forstå/frigive hensigter baseret på brugeradfærd, gør det muligt for patienter med rygmarvsskade (SCI) med mistet håndmobilitet at plukke og placere genstande.

De udviklede metoden baseret på en maskinlæringsalgoritme, der forudsiger brugerintentioner via et førstepersons-kamera. Deres udvikling er baseret på hypotesen om, at brugerintentioner kan udledes gennem indsamling af brugerarmadfærd og hånd-objekt-interaktioner.

Maskinlæringsmodellen brugt i denne undersøgelse, Vision-baseret Intention Detection-netværk fra en EgOcentric-visning (VIDEO-Net), er designet ud fra denne hypotese. VIDEO-Net er sammensat af rumlige og tidsmæssige undernetværk, som genkender brugerarmsadfærd, og et rumligt undernetværk, der genkender hånd-objekt-interaktioner.

En SCI-patient iført Exo-Glove Poly II, en blød bærbar håndrobot, med succes plukket og placeret forskellige genstande og udført væsentlige aktiviteter i dagligdagen, såsom at drikke kaffe, uden yderligere hjælp.

Denne udvikling er fordelagtig ved, at den registrerer brugerens hensigter uden at kræve nogen person-til-person kalibreringer eller yderligere handlinger. Dette gør det muligt for et menneske at bruge den bærbare håndrobot problemfrit.

Interview med professor Kyu-Jin Cho

Q:Hvordan fungerer dette system?

A:Denne teknologi har til formål at forudsige brugerens hensigter, specifikt at gribe og slippe hensigten mod et målobjekt, ved at bruge et førstepersonskamera monteret på briller. VIDEONet, en dyb læringsbaseret algoritme, er udviklet til at forudsige brugerens hensigter fra kameraet baseret på brugerens armadfærd og hånd-objekt-interaktioner. I stedet for at bruge bio-signaler, som ofte bruges til intentionsdetektion af handicappede, vi bruger et simpelt kamera til at finde ud af, om personen forsøger at fatte eller ej. Dette virker, fordi målbrugerne er i stand til at bevæge deres arm, men ikke deres hænder. Vi kan forudsige brugerens hensigt med at gribe ved at observere armbevægelsen og afstanden fra objektet og hånden, og fortolkning af observationen ved hjælp af maskinlæring.

Q:Hvem har gavn af denne teknologi?

A:Som nævnt tidligere, denne teknologi registrerer brugerintentioner fra menneskelig armadfærd og hånd-objekt-interaktioner. Denne teknologi kan bruges af alle med mistet håndmobilitet på grund af rygmarvsskade, slag, cerebral parese eller enhver anden tilstand, så længe de kan bevæge armen frivilligt.

Q:Hvad er begrænsningerne og fremtidige værker?

A:De fleste af begrænsningerne kommer fra ulemperne ved at bruge et monokulært kamera. For eksempel, hvis et målobjekt er okkluderet af et andet objekt, denne teknologis ydeevne falder. Også, hvis brugerens håndbevægelse ikke kan ses i kamerascenen, teknologien er ikke brugbar. For at overvinde manglen på generelitet på grund af disse problemer, algoritmen skal forbedres ved at inkorporere anden sensorinformation eller andre eksisterende hensigtsdetekteringsmetoder, såsom at bruge en elektromyografisensor eller følge øjenblik.

Q:For at bruge denne teknologi i dagligdagen, hvad har du brug for?

A:For at denne teknologi kan bruges i dagligdagen, en bruger har brug for en bærbar håndrobot med et aktiveringsmodul, en computerenhed, og briller med et kamera monteret. Vi sigter mod at reducere størrelsen og vægten af computerenheden, så robotten kan være bærbar til at blive brugt i dagligdagen. Vi brugte en kompakt computerenhed, der opfylder vores krav, men vi forventer, at neuromorfe chips, der er i stand til at udføre deep learning-beregninger, vil være kommercielt tilgængelige.

Sidste artikelBeyond 5G:Den næste generation

Næste artikelOpbevaring af nukleart affald en global krise:rapport

Varme artikler

Varme artikler

-

Xiaomi søger at rejse op til $6 milliarder i Hong Kong IPOXiaomis grundlægger, Formand og administrerende direktør Jun Lei, taler foran en skærm, der viser Jun Lei, ret, fejrer med andre medstiftere af virksomheden, på et pressemøde i Hong Kong, Lørdag, 23.

Xiaomi søger at rejse op til $6 milliarder i Hong Kong IPOXiaomis grundlægger, Formand og administrerende direktør Jun Lei, taler foran en skærm, der viser Jun Lei, ret, fejrer med andre medstiftere af virksomheden, på et pressemøde i Hong Kong, Lørdag, 23. -

Beskyt retten til at blive glemt i blockchains alderEn ny ramme giver dig fuld administrativ kontrol over dine blockchain-lagrede data. Kredit:Shutterstock Der har været en masse hype om blockchain i løbet af det sidste år. Selvom det er bedst kend

Beskyt retten til at blive glemt i blockchains alderEn ny ramme giver dig fuld administrativ kontrol over dine blockchain-lagrede data. Kredit:Shutterstock Der har været en masse hype om blockchain i løbet af det sidste år. Selvom det er bedst kend -

Æble, Goldman Sachs samarbejder om kreditkort:rapport (opdatering)En medierapport siger, at Apple arbejder sammen med investeringsgiganten Goldman Sachs om et co-branded kreditkort, der promoverer Apple Pays digitale tegnebog Apple arbejder sammen med den finans

Æble, Goldman Sachs samarbejder om kreditkort:rapport (opdatering)En medierapport siger, at Apple arbejder sammen med investeringsgiganten Goldman Sachs om et co-branded kreditkort, der promoverer Apple Pays digitale tegnebog Apple arbejder sammen med den finans -

Forskere finder en låge i SwissVote -valgsystemetI SwissPost -systemet, krypterede elektroniske stemmer skal blandes for at beskytte den enkelte stemmes privatliv. Kredit:Pixabay Et team af forskere har undersøgt kildekoden, der blev offentliggj

Forskere finder en låge i SwissVote -valgsystemetI SwissPost -systemet, krypterede elektroniske stemmer skal blandes for at beskytte den enkelte stemmes privatliv. Kredit:Pixabay Et team af forskere har undersøgt kildekoden, der blev offentliggj

- Hvorfor vi skal være på vagt over for at bebrejde overbefolkning for klimakrisen

- Undersøg probesammenhæng mellem diætkvalitet og miljømæssig bæredygtighed

- Ny model hjælper med at beskrive defekter og fejl i kvantecomputere

- Magmalagring og udbrudsadfærd ved vulkanen Bali

- Triumf, omfavne eller udligne? Iværksættere har forskellige fortællestile til at præsentere virk…

- Hvornår blev det første batteri opfundet?