Hvorfor fejler Facebook i at rette sig selv? Det er til dels mennesker

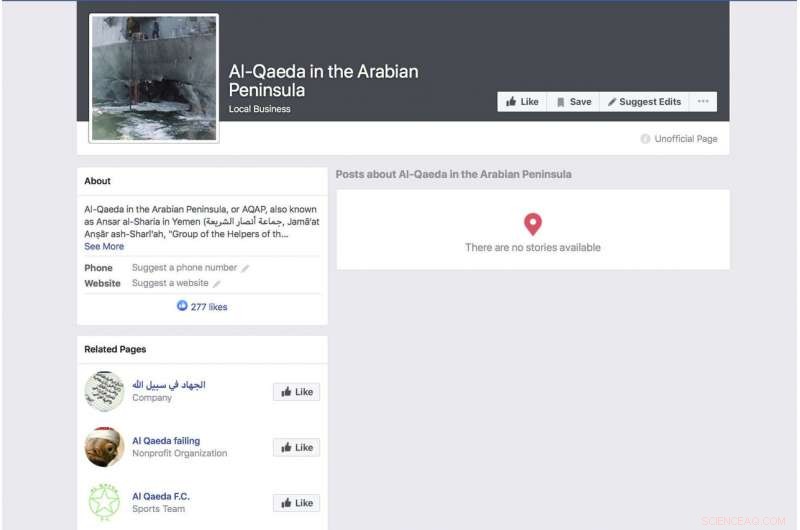

En Facebook-side, der er automatisk genereret for en gruppe, der identificerer sig selv som terrorgruppen "Al-Qaeda på den arabiske halvø", viser et foto af det bombede amerikanske krigsskib USS Cole. Siden var stadig live fra tirsdag d. 7. maj, 2019, da skærmgrebet blev foretaget. Facebook siger, at det har robuste systemer på plads til at fjerne indhold fra ekstremistiske grupper, men en forseglet whistleblower-klage, der er gennemgået af AP, siger, at forbudt indhold forbliver på nettet og nemt at finde. (Facebook via AP)

Spørgsmålet kommer igen og igen, med ekstremistisk materiale, hadefulde ytringer, valgindblanding og krænkelser af privatlivets fred. Hvorfor kan Facebook ikke bare ordne det?

Det er kompliceret, af årsager, der inkluderer Facebooks størrelse, dens forretningsmodel og tekniske begrænsninger, for ikke at nævne år med ukontrolleret vækst. Åh, og elementet i den menneskelige natur.

Den seneste afsløring:Facebook laver uforvarende festlige videoer ved hjælp af ekstremistisk indhold og autogenererer virksomhedssider for folk som ISIS og Al Qaida. Virksomheden siger, at den arbejder på løsninger, og at problemerne bliver bedre. Det er sandt, men kritikere siger, at bedre ikke er godt nok, når masseskyderier bliver livestreamet, og online-mobs spreder rygter, der fører til dødelig vold.

"De har været frustrerende langsomme til at håndtere alt fra seksuelt misbrug af børn til terrorisme, hvid overherredømme, mobning, porno uden samtykke" og ting som at tillade annoncører at målrette mod kategorier såsom "jødehader, " simpelthen fordi nogle brugere havde angivet udtrykket som en "interesse, " sagde Hany Farid, en digital retsmedicinsk ekspert ved University of California, Berkeley.

Efterhånden som nye problemer dukker op, Facebooks formel har været at undskylde og love at foretage ændringer, nogle gange også bemærke, at den ikke forudså, hvordan ondsindede aktører så let kunne misbruge dens platform. For nylig, virksomheden har også understreget, hvor meget den er i forbedring, både teknisk i sin brug af kunstig intelligens til at opdage problemer og i forhold til at fokusere flere penge og kræfter på at løse dem.

Et banner med teksten "Den Islamiske Stat" vises på Facebook-siden for en bruger, der identificerer sig selv som Nawan Al-Farancsa. Siden var stadig live tirsdag, 7. maj, 2019, da skærmgrebet blev foretaget. Facebook siger, at det har robuste systemer på plads til at fjerne indhold fra ekstremistiske grupper, men en forseglet whistleblower-klage, der er gennemgået af AP, siger, at forbudt indhold forbliver på nettet og er let at finde. (Facebook via AP)

"Efter at have foretaget store investeringer, vi opdager og fjerner terrorindhold med en langt højere succesrate end selv to år går, " sagde Facebook onsdag som svar på afsløringerne om de autogenererede sider. "Vi hævder ikke at finde alt, og vi forbliver på vagt i vores indsats mod terrorgrupper rundt om i verden."

Det har set en vis succes. I slutningen af 2016 Administrerende direktør Mark Zuckerberg afviste berygtet som "temmelig skør" ideen om, at falske nyheder på hans tjeneste kunne have påvirket valget. Senere trak han tilbage, og siden da har virksomheden reduceret mængden af misinformation, der deles på sin tjeneste, målt i flere uafhængige undersøgelser.

Zuckerberg har også i det store hele, undgik lignende fejl ved at indrømme fejl og give undskyldninger til offentligheden og til lovgivere.

Men selvom virksomheden løser et problem, andre dukker op. Årsagen til det kan være bagt ind i dets DNA. Og det er ikke kun fordi dens forretningsmodel er afhængig af, at så mange mennesker som muligt bruger den så meget som muligt, efterlader personlige oplysninger, som annoncører derefter kan målrette mod.

-

I denne torsdag, 29. marts, 2018, fil foto, logoet for Facebook vises på skærmene på Nasdaq MarketSite, på New Yorks Times Square. Spørgsmålet kommer igen og igen, med ekstremistisk materiale, hadefulde ytringer, valg indblanding, krænkelser af privatlivets fred, boligdiskrimination. Hvorfor kan Facebook ikke bare ordne det? (AP Photo/Richard Drew, Fil)

-

I denne 11. april, 2018, fil foto, Facebooks CEO Mark Zuckerberg vidner før en House Energy and Commerce-høring på Capitol Hill i Washington. Facebook giver indtryk af, at det stopper langt de fleste ekstremistiske opslag, før brugerne nogensinde ser dem. Men en fortrolig whistleblower-klage til Securities and Exchange Commission indhentet af The Associated Press hævder, at selskabet på sociale medier har overdrevet sin succes. (AP Photo/Andrew Harnik, Fil)

"Næsten alt, hvad Facebook har designet, er designet til gode mennesker. Folk, der er søde ved hinanden, der har fødselsdag at fejre, som har nye hvalpe og generelt kan lide at behandle andre godt, " sagde Siva Vaidhyanathan, direktør for Center for Media and Citizenship ved University of Virginia. "Facebook er grundlæggende lavet til en bedre art end vores. Hvis det var lavet til golden retrievere, alt ville være fantastisk."

Men hvis bare 1 % af de 2,4 milliarder mennesker på Facebook ønsker at gøre forfærdelige ting mod andre, det er 24 millioner mennesker.

"Hver par uger, vi hører om Facebook, der slår besværlige sider ned, afgive løfter om at ansætte flere mennesker, opbygning af AI og så videre, " sagde Vaidhyanathan. "Men på Facebooks skala, intet af det vil betyde noget. Vi sidder dybest set fast med alt det her affald."

Chris Hughes, en medstifter af Facebook, opfordrede til en opløsning af den sociale medie-gigant i en torsdag op-ed. Vaidhyanathan mener også, at stærk regeringsregulering kunne være svaret, såsom love, der "begrænser virksomheders mulighed for at suge alle vores data op og bruge dem til at målrette annoncering."

"Vi burde virkelig henvende os til bagenden af Facebook, sagde han. Det er det, du skal angribe.

© 2019 The Associated Press. Alle rettigheder forbeholdes.

Sidste artikelNews Corp viser overskud for tredje kvartal

Næste artikelEn elektrisk tunge kan klare mere krydret mad, end du kan

Varme artikler

Varme artikler

-

Vietnam udruller webmonitor for at kontrollere falsk informationVietnam har udrullet en række foranstaltninger for at øge sin kontrol med onlinekommunikation, som kritikere siger er rettet mod at straffe aktivister Vietnam sagde onsdag, at det har oprettet en

Vietnam udruller webmonitor for at kontrollere falsk informationVietnam har udrullet en række foranstaltninger for at øge sin kontrol med onlinekommunikation, som kritikere siger er rettet mod at straffe aktivister Vietnam sagde onsdag, at det har oprettet en -

Forureningsfri brint:grøn energi gennembrud?Kredit:CC0 Public Domain Forskere sagde tirsdag, at de har udviklet en måde at udvinde brint fra olie uden at frigive drivhusgasser - et gennembrud, de hyldet som en sølvkugle for renere energi og

Forureningsfri brint:grøn energi gennembrud?Kredit:CC0 Public Domain Forskere sagde tirsdag, at de har udviklet en måde at udvinde brint fra olie uden at frigive drivhusgasser - et gennembrud, de hyldet som en sølvkugle for renere energi og -

Smartphonen:et globalt produktAlle de forskellige virksomheder – og lande – var involveret i at lave den nyeste Huawei P30-smartphone Smartphones er et produkt, som Kina har demonstreret ikke kun sin fremstillingsevne med, men

Smartphonen:et globalt produktAlle de forskellige virksomheder – og lande – var involveret i at lave den nyeste Huawei P30-smartphone Smartphones er et produkt, som Kina har demonstreret ikke kun sin fremstillingsevne med, men -

American Airlines aflyser 115 flyvninger dagligt over 737 MAXBoeings 737 MAX -fly, inklusive dem, der ejes af American Airlines, er blevet jordet efter nylige ulykker American Airlines meddelte søndag, at de ville skrotte omkring 115 flyvninger om dagen i d

American Airlines aflyser 115 flyvninger dagligt over 737 MAXBoeings 737 MAX -fly, inklusive dem, der ejes af American Airlines, er blevet jordet efter nylige ulykker American Airlines meddelte søndag, at de ville skrotte omkring 115 flyvninger om dagen i d

- Acetone plus lys skaber et grønt jetbrændstoftilsætningsstof

- Fortæller krusninger på solens overflade os, at der kommer et blus?

- Trækbar sensor kan frit falde til måling af lodrette skiver af havforhold

- Er større virkelig bedre?

- Forskere bruger diamant i verdens første kontinuerlige rumtemperatur solid-state maser

- Dens californiske naturbrandsæson. Men brandmænd siger, at føderale hotshot-mandskaber er underbe…