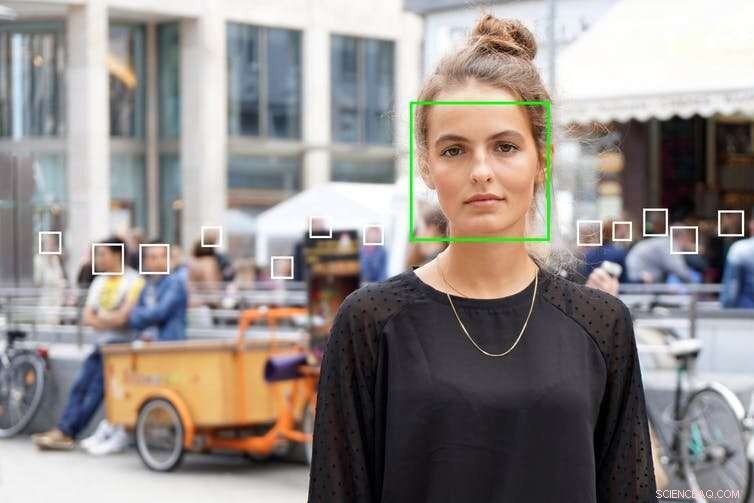

10 grunde til, at du skal være bekymret for ansigtsgenkendelsesteknologi

Kredit:Karelnoppe/Shutterstock

Ansigtsgenkendelsesteknologi breder sig hurtigt. Allerede udbredt i Kina, software, der identificerer mennesker ved at sammenligne billeder af deres ansigter med en database med optegnelser, bliver nu vedtaget i store dele af resten af verden. Det er almindeligt blandt politistyrker, men er også blevet brugt i lufthavne, jernbanestationer og indkøbscentre.

Den hurtige vækst af denne teknologi har udløst en tiltrængt debat. Aktivister, politikere, akademikere og endda politistyrker udtrykker alvorlige bekymringer over den indflydelse ansigtsgenkendelse kan have på en politisk kultur baseret på rettigheder og demokrati.

Menneskerettigheds bekymringer

Som en der forsker i menneskerettigheders fremtid, Jeg deler disse bekymringer. Her er ti grunde til, at vi skal bekymre os om brugen af ansigtsgenkendelsesteknologi i det offentlige rum.

(1) Det sætter os på vej mod automatiseret tæppeovervågning

CCTV er allerede udbredt rundt om i verden, men for regeringer til at bruge optagelser mod dig skal de finde specifikke klip af dig, der gør noget, de kan hævde som bevis. Ansigtsgenkendelsesteknologi bringer overvågning til nye niveauer. Det muliggør automatiseret og vilkårlig liveovervågning af mennesker i deres daglige forretning, giver myndighederne chancen for at spore alle dine træk.

(2) Det fungerer uden klare juridiske eller lovgivningsmæssige rammer

De fleste lande har ingen specifik lovgivning, der regulerer brugen af teknologi til ansigtsgenkendelse, selvom nogle lovgivere forsøger at ændre dette. Denne juridiske limbo åbner døren for misbrug, såsom at få vores billeder uden vores viden eller samtykke og bruge dem på måder, vi ikke ville godkende.

(3) Det krænker principperne om nødvendighed og proportionalitet

Et almindeligt oplyst menneskerettighedsprincip, anerkendt af organisationer fra FN til London Policing Ethics Panel, er, at overvågning skal være nødvendig og forholdsmæssig. Det betyder, at overvågning bør begrænses til forfølgelse af alvorlig kriminalitet i stedet for at muliggøre uberettiget indblanding i vores frihed og grundlæggende rettigheder. Ansigtsgenkendelsesteknologi er i modstrid med disse principper. Det er en kontrolteknologi, der er symptomatisk for statens mistillid til sine borgere.

(4) Det krænker vores ret til privatliv

Retten til privatliv er vigtig, selv i det offentlige rum. Det beskytter udtrykket af vores identitet uden uopfordret indtrængen fra staten eller fra private virksomheder. Ansigtsgenkendelsesteknologiens vilkårlige og store optagelser, lagring og analyse af vores billeder undergraver denne ret, fordi det betyder, at vi ikke længere kan gøre noget offentligt, uden at staten ved det.

Myndighederne behøver ikke at fange alles image for at sikre lov og orden. Kredit:Axel Buerckert/Shutterstock

(5) Det har en nedkølingseffekt på vores demokratiske politiske kultur

Tæppeovervågning kan afholde enkeltpersoner fra at deltage i offentlige arrangementer. Det kan kvæle deltagelse i politiske protester og kampagner for forandring. Og det kan afskrække ikke -konformistisk adfærd. Denne nedkølingseffekt er en alvorlig krænkelse af retten til forsamlingsfrihed, forening, og udtryk.

(6) Det nægter borgerne mulighed for samtykke

Der mangler detaljerede og specifikke oplysninger om, hvordan ansigtsgenkendelse faktisk bruges. Det betyder, at vi ikke får mulighed for at give samtykke til optagelsen, analyse og lagring af vores billeder i databaser. Ved at nægte os muligheden for at give samtykke, vi nægtes valg og kontrol over brugen af vores egne billeder.

(7) Det er ofte unøjagtigt

Ansigtsgenkendelsesteknologi lover nøjagtig identifikation. Men adskillige undersøgelser har fremhævet, hvordan algoritmerne, der er uddannet i racemæssigt forudindtagede datasæt, fejlagtigt identificerer mennesker med farve, især kvinder i farve. En sådan algoritmisk skævhed er især bekymrende, hvis den resulterer i ulovlige anholdelser, eller hvis det får offentlige instanser og private virksomheder til at forskelsbehandle kvinder og mennesker med minoritetsetnisk baggrund.

(8) Det kan føre til automatisering

Hvis de mennesker, der bruger ansigtsgenkendelsessoftware fejlagtigt mener, at teknologien er ufejlbarlig, det kan føre til dårlige beslutninger. Denne "automatiseringsbias" skal undgås. Maskingenererede resultater bør ikke afgøre, hvordan statslige agenturer eller private virksomheder behandler enkeltpersoner. Uddannede menneskelige operatører skal udøve meningsfuld kontrol og træffe beslutninger baseret på lov.

(9) Det indebærer, at der er hemmelige regeringsovervågningslister

De databaser, der indeholder vores ansigtsbilleder, skal ringe alarmklokker. De indebærer, at private virksomheder og retshåndhævende myndigheder deler vores billeder for at bygge overvågningslister over potentielle mistænkte uden vores viden eller samtykke. Dette er en alvorlig trussel mod vores individuelle rettigheder og borgerlige rettigheder. Sikkerheden ved disse databaser, og deres sårbarhed over for hackers handlinger, er også grund til bekymring.

(10) Det kan bruges til at målrette mod allerede sårbare grupper

Ansigtsgenkendelsesteknologi kan bruges til omfattende overvågning. Men det kan også indsættes selektivt, for eksempel at identificere migranter og flygtninge. Salg af ansigtsgenkendelsessoftware til agenturer som den kontroversielle amerikanske immigration og toldhåndhævelse (ICE), som er blevet stærkt kritiseret for sin taktik i håndteringen af migranter, skulle bekymre enhver, der bekymrer sig om menneskerettigheder. Og brugen af håndholdte mobilenheder med en ansigtsgenkendelsesapp fra politistyrker rejser spøgelset for forbedret raceprofilering på gadeplan.

Debat er hårdt påkrævet

Med så mange bekymringer om teknologi til ansigtsgenkendelse, vi har desperat brug for en mere fremtrædende samtale om dens indvirkning på vores rettigheder og borgerlige friheder. Uden ordentlig regulering af disse systemer, vi risikerer at oprette dystopiske politistater i det, der engang var gratis, demokratiske lande.

Denne artikel er genudgivet fra The Conversation under en Creative Commons -licens. Læs den originale artikel.

Varme artikler

Varme artikler

-

Mangel på polering, mangler indhold mar AT&Ts nye ledningskutter-tjenesteKredit:CC0 Public Domain Du havde allerede brug for et scorekort for at fortælle alle spillerne i denne indviklede streaming, snoreskærende æra. Mandagens landsdækkende lancering af AT&T TV indvar

Mangel på polering, mangler indhold mar AT&Ts nye ledningskutter-tjenesteKredit:CC0 Public Domain Du havde allerede brug for et scorekort for at fortælle alle spillerne i denne indviklede streaming, snoreskærende æra. Mandagens landsdækkende lancering af AT&T TV indvar -

Næste generation af drivhuse kan være fuldt ud soldrevetKredit:North Carolina State University Mange drivhuse kan blive energineutrale ved at bruge gennemsigtige solpaneler til at høste energi-primært fra lysets bølgelængder, som planter ikke bruger ti

Næste generation af drivhuse kan være fuldt ud soldrevetKredit:North Carolina State University Mange drivhuse kan blive energineutrale ved at bruge gennemsigtige solpaneler til at høste energi-primært fra lysets bølgelængder, som planter ikke bruger ti -

Sorte Facebook-ansatte klager over racisme, diskrimination er blevet værreKredit:CC0 Public Domain Et anonymt notat, der hævder, at Facebook stadig har et problem med sorte mennesker, cirkulerer i virksomheden et år efter, at en tidligere medarbejder klagede over racism

Sorte Facebook-ansatte klager over racisme, diskrimination er blevet værreKredit:CC0 Public Domain Et anonymt notat, der hævder, at Facebook stadig har et problem med sorte mennesker, cirkulerer i virksomheden et år efter, at en tidligere medarbejder klagede over racism -

Ny indsigt kan bane vejen for selvdrevne lavenergienhederUdforskning af virkningerne af statisk elektricitet. Kredit:Christopher Moore De fleste mennesker har følt det svie ved at tage fat i et dørhåndtag efter at have gået hen over et tæppe eller set,

Ny indsigt kan bane vejen for selvdrevne lavenergienhederUdforskning af virkningerne af statisk elektricitet. Kredit:Christopher Moore De fleste mennesker har følt det svie ved at tage fat i et dørhåndtag efter at have gået hen over et tæppe eller set,

- Er de nuværende vandbehandlingsmetoder tilstrækkelige til at fjerne skadelige konstruerede nanopar…

- Størrelse betyder noget, da nanokrystaller går gennem faser

- En kosmopolitisk by

- Italiensk politi finder en stjålet kopi af Leonardo Salvator Mundi

- Hvorfor farlige asteroider på vej til Jorden er så svære at opdage

- Klimaændringer kan fremskynde forringelsen af den amerikanske broinfrastruktur