Et sproggenereringssystem, der kan komponere kreativ poesi

Brendan Bena præsenterer sit arbejde på en konference. Kredit:UC Colorado Springs.

I løbet af de sidste par årtier, forskere har udviklet stadig mere avancerede kunstig intelligens (AI) værktøjer og beregningsteknikker, der kan anvendes i en række forskellige indstillinger. Imellem disse, teknikker, der kan generere skriftligt eller talt sprog, har tiltrukket sig betydelig opmærksomhed, især med introduktionen af nye stemmeassistenter, robotter og nye interaktive enheder.

Forskere ved University of Colorado (UC) - Colorado Springs og Drury University har for nylig udviklet et unikt sproggenereringssystem, der kan producere kreative poesivers. Deres system, præsenteret i et papir, der er forududgivet på arXiv, er en finjusteret tilpasning af GPT-2, en fortrænet sprogmodel udviklet af OpenAI.

Jugal Kalita, professoren ved UC Colorado Springs, der overvåger den nylige undersøgelse, har forsket i naturlig sproggenerering i de sidste 30 år, fra hans kandidatdage ved University of Pennsylvania. Hans første papir om generering af naturligt sprog, udgivet i 1988, var rettet mod at producere tekstafsnit, der kunne forekomme i et typisk tidsskrift, efter et grundlæggende sæt regler. For nylig, inspireret af fremskridt inden for kunstige neurale netværk til naturlig sprogbehandling (NLP), Prof. Kalita og hans elever begyndte at udvikle deep learning-teknikker til generering af korte artikler, dialoger og kreativ skrivning.

"Idéen om at undersøge emnet automatisk poesigenerering opstod i begyndelsen af sommeren 2019, når Brendan Bena, en sommerforskerpraktikant ved University of Colorado, Colorado Springs, fra Missouri's Drury University, viste interesse for automatisk at generere sangtekster, " Prof. Kalita fortalte TechXplore. "Han ønskede oprindeligt at se på at skabe et system, der ville forsøge at efterligne de følelser, der fremkaldes gennem sangtekster."

Da de fleste sangtekster er beskyttet af ophavsret, Det kan være meget udfordrende at finde store datasæt til at træne deep learning-modeller til lyrikgenerering. Bena og prof. Kalita besluttede derfor at udvikle et dybt læringsværktøj til poesigenerering i stedet. Men i stedet for at fokusere på funktioner som poesiens struktur eller rytme, ligesom de fleste tidligere poesigenerationsstudier, de udforskede dets mere følelsesmæssige og kreative aspekter.

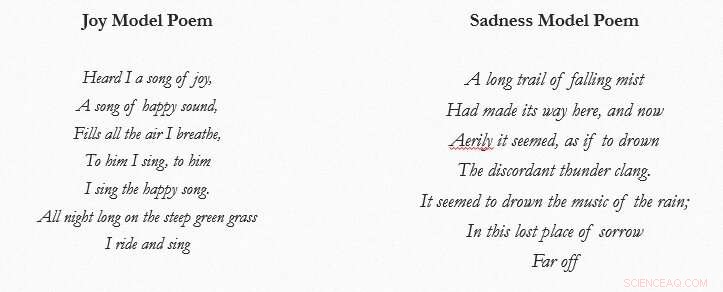

Eksempler på den poesi, der vækker følelser frembragt af forskernes sproggenereringssystem. Kredit:Bena &Kalita.

"Efter at have indset, at der var en meget større del af forskning, samt data, inden for poesigenerering, vi flyttede vores fokus til dette særlige emne, " Bena fortalte TechXplore. "Arbejdet var i vid udstrækning baseret på den overordnede opgave med tekstgenerering, der fulgte med meget tidligere forskning. Imidlertid, i modsætning til tidligere bestræbelser, vi ønskede at fokusere mere på indholdet, tekstens følelser og kreativitet, i modsætning til strukturen eller rytmen fundet i tidligere poesigenerationsstudier."

At udvikle deres poesigenereringssystem, Bena og prof. Kalita samlede først et stort korpus af tekst fra Project Gutenberg- og UC-Santa Cruz Dreambank-databaserne. De gennemsøgte Gutenberg-databasen og ledte efter ord inkluderet i EmoLex, et følelsesleksikon-datasæt udviklet af National Research Council of Canada.

Forskerne opdelte derefter det resulterende datasæt i forskellige 'følelseskategorier', " ser på antallet af EmoLex-ord indeholdt i hvert uddrag, og brugte disse data til at træne et dybt neuralt netværk. Modellen de trænede er en tilpasning af GPT-2, en arkitektur, der lærer at generere nye fragmenter af tekst ved at modellere den sprogstil, der bruges i de data, den træner på.

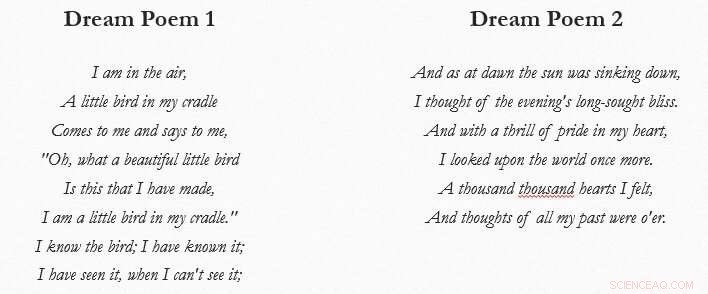

"Vi fodrede også vores kunstige neurale netværk med en kombination af drømmedata og poesi for at skabe det, der er kendt som 'drømmepoesi,' '" forklarede Bena. "Til sidst, vi havde fem separate følelsesmodeller for følelser af glæde, sorg, tillid, vrede og forventning, men vi havde også en drømmepoesimodel. Dette system, som tidligere nævnt, fokuserer mindre på strukturen, der findes i en masse digtgenereringsarbejde og mere på en fri-vers poesi, der ser ud til at efterligne og gengive finessen og kreativiteten hos rigtige digtere."

Forskerne bad menneskelige brugere om at vurdere digtene skabt af deres system, samtidig med at man bruger Coh-Metrix-værktøjet til at vurdere kvaliteten af de vers, det genererede. De fandt ud af, at det producerede digte, der effektivt fremkaldte sorg og glæde 87,5 % og 85 % af gangene, henholdsvis. Ud over, når de er trænet i både drømmedata og poesi, deres system genererede unikke 'drømmelignende' poesivers, der fangede elementer af det, der er kendt som 'drømmepoesi' med en score på 3,2 på Likert-skalaen.

Eksempler på drømmepoesi produceret af forskernes sproggenereringssystem. Kredit:Bena &Kalita.

"Vores resultater tyder på, at tekst kan, faktisk, genereres, så det fremkalder følelser hos læserne, og at det kan ligne de typer af kreativitet, som kunstnere ønsker at indsprøjte i deres arbejde, " sagde Bena. "Vi mener, at vores forskning er et nyt værk inden for kreativ poesigenerering og håber, at vores undersøgelse vil åbne døren til fremtidigt arbejde på dette område."

Bena og prof. Kalita er blandt de første til at demonstrere de første glimt af maskinkreativitet i poesigenerering. I deres næste studier, forskerne planlægger at forbedre kvaliteten af de digte, der er komponeret af deres system, samtidig med at de anvender deres tilgang til skabelsen af poesi på andre sprog.

"Hvis vi kuraterer træningsdataene lidt mere, vi tror på, at en neural netværksarkitektur bedre kunne fange de følelser og drømmelignende aspekter af den poesi, vi søger at skabe, " sagde Bena. "Faktisk, mens EmoLex-ordbogen er et meget nyttigt datasæt, dets ordforråd tager ikke højde for alt det ældre engelske, der findes i nogle af Gutenberg-digtningen."

I fremtiden, forskerne håber at replikere deres eksperiment med fokus på leksikoner på sætnings- eller segmentniveau, da dette kunne give dem mulighed for at fange afhængigheder i følelsesbaseret tekst mere effektivt. Deres undersøgelse kunne også gentages ved hjælp af en mere sofistikeret neural netværksbaseret arkitektur, som kan forbedre kvaliteten af den producerede poesi både med hensyn til grammatik og sætningsstruktur.

Da Bena og Prof. Kalita allerede har brugt deres system til at producere drømmepoesivers, de kunne i sidste ende også anvende det på andre kreative stilarter, såsom slettepoesi. Slettepoesi produceres ved at tage specifikke eller tilfældige ord fra en eksisterende tekst og derefter bruge dem til at danne nye vers.

"Endelig, vi arbejder også på at skabe poesi på forskellige sprog ved hjælp af transfer learning, " sagde prof. Kalita. "For eksempel, Shaun Tucker, en masterstuderende ved UC-Colorado Springs har lavet poesi på en række indoeuropæiske sprog ved hjælp af OpenAI's fortrænede GPT-2-model. Indtil nu, vi har lavet digte på engelsk, Spansk, ukrainsk, hindi, bengalsk og assamisk og fandt ud af, at den generative model for dyb læring GPT-2, som er blevet fortrænet med en stor mængde engelsk tekst, kan trænes med prosa og digte på alle disse sprog for at skabe poesi."

© 2020 Science X Network

Varme artikler

Varme artikler

-

Facebook trækker våbenspil fra konservativ forsamlingFacebook trak et virtual reality-pistolspil fra den konservative politiske handlingskonference Facebook trak et virtual reality-våbenspil fra en stor amerikansk konservativ politisk forsamling fre

Facebook trækker våbenspil fra konservativ forsamlingFacebook trak et virtual reality-pistolspil fra den konservative politiske handlingskonference Facebook trak et virtual reality-våbenspil fra en stor amerikansk konservativ politisk forsamling fre -

Airbus øger amerikansk fodaftryk med ny A220-fabrik i AlabamaAirbus udvider sin amerikanske tilstedeværelse med en ny samlefabrik i Alabama, dens anden i den sydlige delstat Den europæiske flyproducent Airbus brød onsdag jorden på sit andet samlebånd i den

Airbus øger amerikansk fodaftryk med ny A220-fabrik i AlabamaAirbus udvider sin amerikanske tilstedeværelse med en ny samlefabrik i Alabama, dens anden i den sydlige delstat Den europæiske flyproducent Airbus brød onsdag jorden på sit andet samlebånd i den -

LiftTiles:Aktuator-baserede byggeklodser til formændrende grænsefladerKredit:Suzuki et al. Storskala grænseflader, der ændrer form, kan bruges til at skabe interaktive skærme eller miljøer, der kan tilpasses til at imødekomme behovene for menneskelige brugere. På tr

LiftTiles:Aktuator-baserede byggeklodser til formændrende grænsefladerKredit:Suzuki et al. Storskala grænseflader, der ændrer form, kan bruges til at skabe interaktive skærme eller miljøer, der kan tilpasses til at imødekomme behovene for menneskelige brugere. På tr -

Amazons arbejdsstyrke stiger til ferieturAmazon sagde, at de ansatte omkring 200, 000 fuldtids- og deltidsansatte over hele verden for at hjælpe sin ferievirksomhed med at bringe sin globale arbejdsstyrke op på 750, 000 Amazon sagde tors

Amazons arbejdsstyrke stiger til ferieturAmazon sagde, at de ansatte omkring 200, 000 fuldtids- og deltidsansatte over hele verden for at hjælpe sin ferievirksomhed med at bringe sin globale arbejdsstyrke op på 750, 000 Amazon sagde tors

- Sort hul-model afslører stjernekollaps uden lys eksplosion

- Lovgivere åbner grundvandskamp mod flaskevandsselskaber

- Hård cider, med en sjat sukker

- Sådan beregnes middel og variant for en binomialfordeling

- Udslip af lattergas kan blive værre, efterhånden som klimaet opvarmes

- Det periodiske system påvirker stadig forskning i dag