Er det overhovedet muligt at regulere Facebook effektivt? Flere forsøg har ført til det samme resultat

Kredit:Unsplash/CC0 Public Domain

Den australske regerings seneste advarsel til Facebook om misinformation er blot den seneste salve i den tilsyneladende konstante kamp for at holde den sociale mediegigant til ansvar for det indhold, der er lagt ud på dens platform.

Det kom i samme uge, som det amerikanske senat hørte whistleblowing vidneudsagn, hvori den tidligere Facebook-direktør Frances Haugen påstod, at virksomheden kendte til skadelige konsekvenser for dets brugere, men valgte ikke at handle.

Regeringer over hele verden har i årevis presset på for at gøre sociale mediegiganter mere ansvarlige, både med hensyn til kvaliteten af den information, de hoster, og deres brug af brugernes data som en del af deres forretningsmodeller.

Den australske regerings onlinesikkerhedslov træder i kraft i januar 2022, hvilket giver eSafety Commissioner hidtil usete beføjelser til at slå ned på misbrug eller voldeligt indhold eller seksuelle billeder, der er postet uden samtykke.

Men selvom den lykkes, vil denne lovgivning kun behandle en lille del af de spørgsmål, der kræver regulering. På mange sådanne spørgsmål har sociale medieplatforme forsøgt at regulere sig selv i stedet for at underkaste sig lovgivning. Men uanset om vi taler om lovgivning eller selvregulering, afføder tidligere erfaringer ikke megen tillid til, at teknologiske platforme med succes kan reguleres, og regulering nemt kan sættes i værk.

Vores forskning har undersøgt tidligere forsøg på at regulere teknologigiganter i Australien. Vi analyserede 269 medieartikler og 282 politiske dokumenter og brancherapporter offentliggjort fra 2015 til 2021. Lad os diskutere et par relevante casestudier.

1. Annoncer og nyheder

I 2019 beskrev den australske konkurrence- og forbrugerkommissions (ACCC) undersøgelse af digitale platforme Facebooks algoritmer, især dem, der bestemmer placeringen af annoncering på Facebook-sider, som "ugennemsigtige". Den konkluderede, at medievirksomheder havde brug for mere sikkerhed for brugen af deres indhold.

Facebook hilste i første omgang henvendelsen velkommen, men modsatte sig derefter offentligt (sammen med Google), da regeringen argumenterede for, at problemerne i forbindelse med Facebooks betydelige markedsstyrke inden for displayannoncering og Facebook og Googles dominans af nyhedsindhold genereret af medievirksomheder var for vigtige til at være overlades til virksomhederne selv.

Facebook hævdede, at der ikke var beviser for en ubalance i forhandlingsstyrken mellem det og nyhedsmedievirksomheder, og tilføjede, at det ikke ville have andet valg end at trække nyhedstjenester tilbage i Australien, hvis de blev tvunget til at betale udgivere for at hoste deres indhold. Standoffen resulterede i Facebooks berygtede ugelange embargo mod australske nyheder.

Den reviderede og ændrede Nyhedsmedieforhandlingskodeks blev vedtaget af parlamentet i februar. Både regeringen og Facebook erklærede sejr, førstnævnte har formået at vedtage sin lovgivning, og sidstnævnte ender med at gøre sine egne køb med nyhedsudgivere uden at skulle holdes juridisk til koden.

2. Hadefulde ytringer og terrorisme

I 2015, for at håndtere voldelig ekstremisme på sociale medier, arbejdede den australske regering oprindeligt sammen med teknologigiganten om at udvikle fælles AI-løsninger for at forbedre de tekniske processer til indholdsidentifikation for at håndtere modvirkning af voldelig ekstremisme.

Denne frivillige løsning fungerede glimrende, indtil den ikke gjorde det. I marts 2019 blev masseskyderier ved moskeer i Christchurch livestreamet på Facebook af en australsk-født hvid overherredømmet terrorist, og optagelserne cirkulerede efterfølgende på internettet.

Dette viste, at Facebooks kunstige intelligens-algoritmer ikke var i stand til at opdage og fjerne live-optagelserne af skyderiet, og hvor hurtigt det blev delt på platformen.

Den australske regering reagerede i 2019 ved at ændre straffeloven for at kræve, at sociale medieplatforme fjerner afskyeligt eller voldeligt materiale "i rimelig tid" og, hvor det er relevant, henvise det til det australske føderale politi.

Hvad har vi lært?

Disse to eksempler, selv om de var slående forskellige, udfoldede sig begge på samme måde:en indledende dialog, hvor Facebook foreslår en intern løsning, der involverer dets egne algoritmer, før et efterfølgende skift mod obligatorisk regeringsregulering, som bliver mødt med modstand eller forhandlinger (eller begge) fra Facebook, og det endelige resultat, som er stykkevis lovgivning, der enten er udvandet eller kun dækker en undergruppe af specifikke typer skader.

Der er flere åbenlyse problemer med dette. Den første er, at kun tech-giganterne selv ved, hvordan deres algoritmer fungerer, så det er svært for regulatorer at overskue dem ordentligt.

Så er der det faktum, at lovgivning typisk gælder på nationalt plan, men alligevel er Facebook en global virksomhed med milliarder af brugere over hele verden og en platform, der er indarbejdet i vores dagligdag på alle mulige måder.

Hvordan løser vi dødvandet? En mulighed er, at regler udarbejdes af uafhængige organer, der er udpeget af regeringer og teknologigiganter til at drive samreguleringsdagsordenen globalt. Men det er måske ikke tilstrækkeligt at stole på regulering alene til at vejlede techgiganters adfærd mod potentielle misbrug. Der er også behov for selvdisciplin og passende virksomhedsledelse – potentielt håndhævet af disse uafhængige organer.

Varme artikler

Varme artikler

-

Globalt luftfartsselskab advarer mod protektionisme, stigende omkostningerKollektivt overskud faldt i 2018, da oliepriserne steg i vejret efter USAs tilbagetrækning fra Iran-atomaftalen og uroligheder i Venezuela Handelskrige og protektionisme er vigtige risikofaktorer

Globalt luftfartsselskab advarer mod protektionisme, stigende omkostningerKollektivt overskud faldt i 2018, da oliepriserne steg i vejret efter USAs tilbagetrækning fra Iran-atomaftalen og uroligheder i Venezuela Handelskrige og protektionisme er vigtige risikofaktorer -

Lufthansaa Alitalia byder på det mest lovende:ministerEn italiensk minister kaldte Lufthansas bud på Alitalia for det mest lovende af de tre på bordet Lufthansa fremgik som nummer et af kandidaterne til at overtage Alitalia mandag, efter at en italie

Lufthansaa Alitalia byder på det mest lovende:ministerEn italiensk minister kaldte Lufthansas bud på Alitalia for det mest lovende af de tre på bordet Lufthansa fremgik som nummer et af kandidaterne til at overtage Alitalia mandag, efter at en italie -

Klip af snoren:Efterhånden som priserne stiger, her er hvordan du stadig kan spare penge på stream…Kredit:CC0 Public Domain Årevis, at klippe betalings-tv-ledningen er blevet set som en måde at spare penge på – du betaler ikke for kanaler, du ikke ser, og du er fri for langsigtede kontrakter.

Klip af snoren:Efterhånden som priserne stiger, her er hvordan du stadig kan spare penge på stream…Kredit:CC0 Public Domain Årevis, at klippe betalings-tv-ledningen er blevet set som en måde at spare penge på – du betaler ikke for kanaler, du ikke ser, og du er fri for langsigtede kontrakter. -

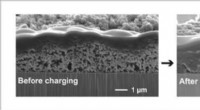

Højtydende anode til all-solid-state lithium-batterier er lavet af siliciumnanopartiklerTværsnitsfeltemissionsscanningselektronmikroskop (FE-SEM) billeder af den som forberedte Si-anode sammensat af spray-aflejrede nanopartikler på rustfri stålstrømsamler og anoden i fuldt opladet tilsta

Højtydende anode til all-solid-state lithium-batterier er lavet af siliciumnanopartiklerTværsnitsfeltemissionsscanningselektronmikroskop (FE-SEM) billeder af den som forberedte Si-anode sammensat af spray-aflejrede nanopartikler på rustfri stålstrømsamler og anoden i fuldt opladet tilsta

- 30 millioner mennesker under varmealarm, da det vestlige USA svulmer

- Fordelene ved en stor prøvestørrelse

- NASA ser den tidligere tropiske cyklon Gita påvirke New Zealand

- Fotoner (kvantisering): Definition, egenskaber & bølge-partikeldualitet

- Auto-Gopher – borer dybt for at udforske solsystemet

- Tidsreversering af en ukendt kvantetilstand