To-stream netværk foreslået til termisk og synlig billedfusion

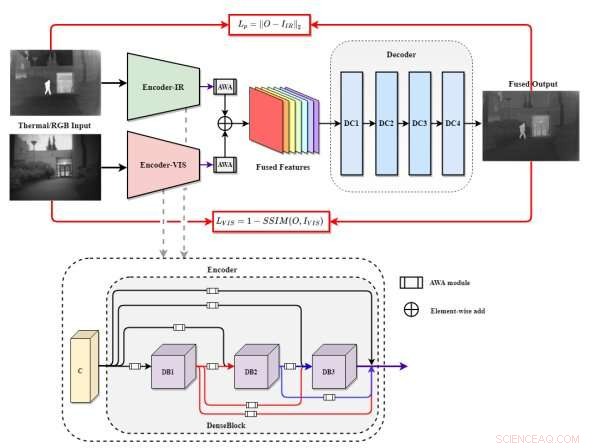

Illustration af den foreslåede netværksstruktur. Kredit:XIOPM

Studerende Liu Luolin fra Xi'an Institute of Optics and Precision Mechanics (XIOPM) fra det kinesiske videnskabsakademi (CAS) har foreslået en to-stream end-to-end model ved navn TSFNet til termisk og synlig billedfusion. Resultaterne blev offentliggjort i Neurocomputing.

TSFNet, bruge to grene til funktionsindlæring, er helt anderledes end tidligere to-stream metoder, og det kan fuldt ud fange informationen fra begge kilder.

Termiske billeder er ufølsomme over for lysstyrke og kan skelne genstande og baggrund ved at differentiere termisk stråling. Synlige billeder kan forstå menneskets syn mere intuitivt og have en højere opløsning. Derfor, det kan udledes, at fusionen af de to kan give et nyt billede med klare objekter og høj opløsning til overvågning i al slags vejr og hele dagen/nat.

I dette studie, for at gøre det muligt for modellen at bevare den detaljerede information om kildebilledet autonomt under fusionen, LIU og hans teammedlemmer vedtog en adaptiv vægtallokeringsstrategi for at guide funktionsvalg. Hele rammen blev adskilt i tre moduler, funktionsudtræk, fusion, og genopbygning.

Ifølge forsøgsresultaterne, TSFNet udkonkurrerer state-of-the-art metoder under forskellige evalueringsmålinger. I fremtiden, det vil give en guide til at designe nyt netværk af billedfusion.

Sidste artikelMetamaterialeforskning udfordrer grundlæggende grænser inden for fotonik

Næste artikelFørste magneter til FAIR testet på CERN

Varme artikler

Varme artikler

-

Den nemmeste måde at lære apotek MathApotekere og apoteksteknikere bruger et matematisk system kaldet apoteksmatematik (nogle gange kaldet apotekernes system). Mens det metriske system har enheder for volumen, længde og vægt, bruger apot

Den nemmeste måde at lære apotek MathApotekere og apoteksteknikere bruger et matematisk system kaldet apoteksmatematik (nogle gange kaldet apotekernes system). Mens det metriske system har enheder for volumen, længde og vægt, bruger apot -

Forskere udvikler en unik proces til fremstilling af lysstofblandingRingformede huller i en tynd guldfilm fyldt med siliciumdioxid muliggør ultrastærk kobling mellem lys og atomvibrationer. Denne struktur giver muligheder for at undersøge molekyler, der interagerer me

Forskere udvikler en unik proces til fremstilling af lysstofblandingRingformede huller i en tynd guldfilm fyldt med siliciumdioxid muliggør ultrastærk kobling mellem lys og atomvibrationer. Denne struktur giver muligheder for at undersøge molekyler, der interagerer me -

Opdagelse kan føre til jetmotorer, der kører varmere - og renereKredit:Ohio State University Forskere her har gjort en opdagelse inden for materialevidenskab, der lyder som noget fra den gamle lørdag morgen tegneserie Super Friends:De har fundet en måde at dea

Opdagelse kan føre til jetmotorer, der kører varmere - og renereKredit:Ohio State University Forskere her har gjort en opdagelse inden for materialevidenskab, der lyder som noget fra den gamle lørdag morgen tegneserie Super Friends:De har fundet en måde at dea -

Søgningen efter afvigelser fra standard kvantemekanikFysikere bruger et interferometer til at teste, om standard kvantemekanik er korrekt, eller om en mere kompleks version er påkrævet. De brugte interferometeret til at sende fotoner rundt om en sløjfe

Søgningen efter afvigelser fra standard kvantemekanikFysikere bruger et interferometer til at teste, om standard kvantemekanik er korrekt, eller om en mere kompleks version er påkrævet. De brugte interferometeret til at sende fotoner rundt om en sløjfe

- Kina lancerer verdens første raket-indsatte vejrinstrumenter fra ubemandet halvt nedsænket køretø…

- Nedskæring af metanemissioner nøglen til at bremse opvarmningen:FN

- Jord har hemmeligheden bag at afbøde klimaforandringer

- Hvad er Vermiculite?

- Billede:Refleksionståge NGC 1999

- BrainNet giver tre personer mulighed for at kommunikere ved hjælp af hjernebølger til at spille Te…