Beviser afslører risikovurderingsalgoritmer viser skævhed mod latinamerikansk befolkning

Undersøgelsens resultater har rejst bekymringer om retfærdigheden og nøjagtigheden af risikovurderingsalgoritmer, som i stigende grad bliver brugt til at træffe beslutninger om løsladelse forud for retssagen, domsafsigelse og prøveløsladelse. Kritikere hævder, at disse algoritmer kan fastholde racemæssige og etniske uligheder i det strafferetlige system ved systematisk at overvurdere risikoen for recidiv for visse grupper af mennesker.

Som svar på disse bekymringer er nogle jurisdiktioner begyndt at tage skridt til at adressere algoritmisk skævhed. For eksempel vedtog Californien for nylig en lov, der kræver, at risikovurderingsalgoritmer skal revideres for bias, og som forbyder brugen af algoritmer, der diskriminerer baseret på race eller etnicitet. Andre jurisdiktioner overvejer lignende foranstaltninger for at sikre, at risikovurderingsalgoritmer bruges retfærdigt og retfærdigt.

Undersøgelsens resultater er en påmindelse om de potentielle farer ved at bruge algoritmer til at træffe beslutninger om menneskers liv. Det er vigtigt nøje at overveje potentialet for skævhed og diskrimination, når man udvikler og bruger disse algoritmer, og at tage skridt til at afbøde disse risici.

Varme artikler

Varme artikler

-

Oversvømmelser i Ghana dræber 34 under kraftig regnBagre Dam ligger ved White Volta-floden (billedet i 2007), der begynder i Burkina Faso, og som konvergerer med Black Volta nedstrøms og strømmer ud i Volta-søen i det sydlige Ghana Mindst 34 menne

Oversvømmelser i Ghana dræber 34 under kraftig regnBagre Dam ligger ved White Volta-floden (billedet i 2007), der begynder i Burkina Faso, og som konvergerer med Black Volta nedstrøms og strømmer ud i Volta-søen i det sydlige Ghana Mindst 34 menne -

Myldretidsforurening kan være farligere, end du trorEt instrumentbrætbillede fra et køretøj, der måler visse typer forurenende stoffer i myldretiden i Atlanta. Kredit:Duke University De første målinger i bilen af eksponering for forurenende stoff

Myldretidsforurening kan være farligere, end du trorEt instrumentbrætbillede fra et køretøj, der måler visse typer forurenende stoffer i myldretiden i Atlanta. Kredit:Duke University De første målinger i bilen af eksponering for forurenende stoff -

Ny forskning viser, at skovforvaltning i lokalsamfundet reducerer både skovrydning og fattigdomKredit:CC0 Public Domain At give lokalsamfund i Nepal mulighed for at forvalte deres skove har samtidig reduceret skovrydning og fattigdom i regionen, ny forskning har vist. I den største undersø

Ny forskning viser, at skovforvaltning i lokalsamfundet reducerer både skovrydning og fattigdomKredit:CC0 Public Domain At give lokalsamfund i Nepal mulighed for at forvalte deres skove har samtidig reduceret skovrydning og fattigdom i regionen, ny forskning har vist. I den største undersø -

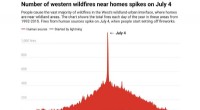

Over 100 brandforskere opfordrer det amerikanske vest:Spring fyrværkeriet over denne rekordtørre f…Hedebølgen, der ramte det nordvestlige USA og Canada, har slået rekorder i stykker, med temperaturer 30 grader Fahrenheit eller mere over det normale. Med tørke, der allerede griber Vesten, den intens

Over 100 brandforskere opfordrer det amerikanske vest:Spring fyrværkeriet over denne rekordtørre f…Hedebølgen, der ramte det nordvestlige USA og Canada, har slået rekorder i stykker, med temperaturer 30 grader Fahrenheit eller mere over det normale. Med tørke, der allerede griber Vesten, den intens

- Dette er sandsynligvis, hvorfor du har set et spøgelse, ifølge videnskab

- Ikke kun brød og øl:Mikrober kan fermentere kuldioxid for også at lave brændstof

- Hvordan påvirker mitose livet?

- London -politiet beslaglægger bitcoin til en værdi af $ 667, 000 fra hacker

- Japan sigter mod at bringe jordprøver tilbage fra Mars-månen inden 2029

- Nudging forbedrer ikke nødvendigvis beslutninger