AI-algoritmer kan påvirke folks stemme- og datingbeslutninger i eksperimenter

Kredit:CC0 Public Domain

I en ny række eksperimenter, kunstig intelligens (A.I.) algoritmer var i stand til at påvirke folks præferencer for fiktive politiske kandidater eller potentielle romantiske partnere, afhængig af om anbefalingerne var eksplicitte eller skjulte. Ujué Agudo og Helena Matute fra Universidad de Deusto i Bilbao, Spanien, præsentere disse resultater i open-access tidsskriftet PLOS ET den 21. april, 2021.

Fra Facebook til Googles søgeresultater, mange mennesker støder på A.I. algoritmer hver dag. Private virksomheder udfører omfattende undersøgelser af data fra deres brugere, generere indsigt i menneskelig adfærd, som ikke er offentligt tilgængelig. Akademisk samfundsvidenskabelig forskning halter bagefter privat forskning, og offentlig viden om, hvordan A.I. algoritmer, der kan forme folks beslutninger, mangler.

For at kaste nyt lys, Agudo og Matute udførte en række eksperimenter, der testede indflydelsen af A.I. algoritmer i forskellige sammenhænge. De rekrutterede deltagere til at interagere med algoritmer, der præsenterede billeder af fiktive politiske kandidater eller online dating-kandidater, og bad deltagerne angive, hvem de ville stemme på eller sende besked til. Algoritmerne forfremmede nogle kandidater frem for andre, enten eksplicit (f.eks. "90 % kompatibilitet") eller skjult, ved at vise deres billeder oftere end andres.

Samlet set, eksperimenterne viste, at algoritmerne havde en væsentlig indflydelse på deltagernes beslutninger om, hvem de skulle stemme på eller besked. For politiske beslutninger, eksplicit manipulation havde væsentlig indflydelse på beslutninger, mens skjult manipulation ikke var effektiv. Den modsatte effekt blev set for datingbeslutninger.

Forskerne spekulerer i, at disse resultater kan afspejle folks præference for menneskelig eksplicit rådgivning, når det kommer til subjektive spørgsmål såsom dating, mens folk måske foretrækker algoritmisk rådgivning om rationelle politiske beslutninger.

I lyset af deres resultater, forfatterne udtrykker støtte til initiativer, der søger at øge A.I.s troværdighed, såsom EU-Kommissionens Ethics Guidelines for Trustworthy AI og DARPAs forklarbare AI (XAI) program. Stadig, de advarer om, at mere offentligt tilgængelig forskning er nødvendig for at forstå menneskets sårbarhed over for algoritmer.

I mellemtiden forskerne efterlyser en indsats for at oplyse offentligheden om risiciene ved blind tillid til anbefalinger fra algoritmer. De fremhæver også behovet for diskussioner omkring ejerskab af de data, der driver disse algoritmer.

Forfatterne tilføjer:"Hvis en fiktiv og forenklet algoritme som vores kan opnå et sådant niveau af overtalelse uden at etablere faktisk tilpassede profiler af deltagerne (og bruge de samme fotografier i alle tilfælde), en mere sofistikeret algoritme som dem, folk interagerer med i deres daglige liv, burde helt sikkert kunne øve en meget stærkere indflydelse."

Varme artikler

Varme artikler

-

Er nogle bymiljøer mere risikable for trafikskade eller død? Vi ved mindre, end du trorLouis A. Merlin, Ph.D., (stående) hovedforfatter og adjunkt på FAUs Skole for By- og Regionalplanlægning, og samarbejdspartnere, opdagede, at de fleste undersøgelser af risikoen for nedbrud bruger ad-

Er nogle bymiljøer mere risikable for trafikskade eller død? Vi ved mindre, end du trorLouis A. Merlin, Ph.D., (stående) hovedforfatter og adjunkt på FAUs Skole for By- og Regionalplanlægning, og samarbejdspartnere, opdagede, at de fleste undersøgelser af risikoen for nedbrud bruger ad- -

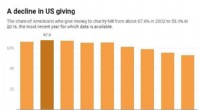

Massive velgørende donationer fra de rige og berømte giver det samme store sprøjt som altidKredit:Diagram:Samtalen, CC-BY-ND Kilde:University of Michigan/IUPUI Lilly Family School of Philanthropy Panel Study Mindst halvdelen af amerikanske familier har givet penge til velgørenhed hver

Massive velgørende donationer fra de rige og berømte giver det samme store sprøjt som altidKredit:Diagram:Samtalen, CC-BY-ND Kilde:University of Michigan/IUPUI Lilly Family School of Philanthropy Panel Study Mindst halvdelen af amerikanske familier har givet penge til velgørenhed hver -

Sådan finder du en relativ gennemsnitlig afvigelseDen relative gennemsnitlige afvigelse (RAD) for et datasæt er en procentdel, der fortæller dig, hvor meget hver måling i gennemsnit adskiller sig fra det aritmetiske gennemsnit af dataene. Det er rela

Sådan finder du en relativ gennemsnitlig afvigelseDen relative gennemsnitlige afvigelse (RAD) for et datasæt er en procentdel, der fortæller dig, hvor meget hver måling i gennemsnit adskiller sig fra det aritmetiske gennemsnit af dataene. Det er rela -

Kunsthistorisk specialist:Lady in a Fur Wrap-kunstner identificeretDame i en pelssvøb, omkring 1580-1588. Kredit:CGS CIC Glasgow Museums Collection Førende internationale specialister inden for kunsthistorie har frigivet de første resultater af et fire-årigt for

Kunsthistorisk specialist:Lady in a Fur Wrap-kunstner identificeretDame i en pelssvøb, omkring 1580-1588. Kredit:CGS CIC Glasgow Museums Collection Førende internationale specialister inden for kunsthistorie har frigivet de første resultater af et fire-årigt for

- Glem 5G og foldbar. Vi vil bare have, at den holder hele dagen:Hvad du vil have fra ny smartphone

- FIREBIRD II og NASA-missionen lokaliserer fløjtende rumelektroners oprindelse

- Mars måne fik sine riller fra rullende sten, undersøgelse tyder på

- Kinas Huawei afslører chip til det globale big data-marked

- NASA finder Tropical Cyclone Joaninha holde øje

- Nationer er enige om regelbog for klimatraktaten i Paris