Programmering og fordomme:Dataloger opdager, hvordan man finder skævhed i algoritmer

At forstå roden til bias i algoritmer er afgørende for at løse dette problem effektivt. Der er flere faktorer, der kan bidrage til bias i algoritmedesign og -udvikling. Her er et par eksempler:

Databias :De data, der bruges til at træne og udvikle algoritmer, afspejler ofte de skævheder og fordomme, der findes i den virkelige verden. Hvis træningsdataene er forspændt mod en bestemt gruppe, vil den resulterende algoritme sandsynligvis arve og forstærke disse skævheder. For eksempel, hvis en algoritme, der bruges til at ansætte beslutninger, trænes på historiske data, der favoriserer mandlige ansøgere, kan den opretholde kønsdiskrimination ved konsekvent at anbefale flere mandlige kandidater.

Algoritmiske antagelser :De antagelser og principper, der ligger til grund for algoritmens design, kan også introducere skævheder. For eksempel kan algoritmer, der prioriterer effektivitet og optimering, utilsigtet overse behovene hos marginaliserede grupper. Som et resultat heraf kan løsninger, der er designet til majoritetsbefolkningen, ikke i tilstrækkelig grad opfylde forskellige brugeres behov, hvilket fører til skæve resultater.

Mangel på mangfoldighed i udviklingsteams :De mennesker, der designer, udvikler og vedligeholder algoritmer, spiller en afgørende rolle i udformningen af outputtet. Hvis udviklingsteamene mangler mangfoldighed og inklusivitet, kan de være mindre tilbøjelige til at identificere og adressere potentielle skævheder i deres arbejde. Dette kan resultere i algoritmer, der afspejler udviklernes skævheder og perspektiver, hvilket yderligere forværrer eksisterende uligheder.

Detektering og adressering af bias i algoritmer er en udfordrende opgave, men en opgave, der er afgørende for at sikre retfærdighed og ansvarlig AI-praksis. Forskere inden for datalogi har udviklet forskellige teknikker og tilgange til at identificere og afbøde bias i algoritmer. Her er et par eksempler:

Algorithmic Auditing :I lighed med finansielle revisioner involverer algoritmisk revision at undersøge algoritmer for at identificere skævheder. Denne proces involverer at analysere inputdata, beslutningsprocesserne og resultaterne af algoritmen for at afdække potentielle skævheder og uligheder.

Retfærdighedsmålinger :Forskere har udviklet målinger og mål, der er specielt designet til at vurdere retfærdighed i algoritmer. Disse målinger hjælper med at kvantificere omfanget af bias og gør det muligt for algoritmiske designere at evaluere og sammenligne forskellige algoritmer ud fra et retfærdighedsperspektiv.

Teknikker til begrænsning af bias :Teknikker er blevet foreslået til at afbøde bias i algoritmer under udvikling. Disse teknikker omfatter dataresampling for at sikre afbalanceret repræsentation, inkorporering af retfærdighedsbegrænsninger i optimeringsprocessen og implementering af efterbehandlingsmekanismer for at justere algoritmeresultater.

Fremme mangfoldighed og inklusion :At tilskynde til diversitet og inklusion inden for AI-udviklingsteams er afgørende for at imødegå bias i rod. Ved at diversificere stemmerne, perspektiverne og baggrunden for dem, der designer algoritmer, kan organisationer skabe mere inkluderende og retfærdige AI-systemer.

At adressere skævhed i algoritmer er en kompleks og vedvarende udfordring, men det er bydende nødvendigt. Ved at anvende avancerede teknikker, fremme diversitet og fremme etiske overvejelser i algoritmedesign kan dataloger og AI-forskere hjælpe med at skabe mere retfærdige, retfærdige og retfærdige AI-systemer, der gavner alle brugere og bidrager positivt til samfundet.

Varme artikler

Varme artikler

-

Hvorfor naturlige dræberceller reagerer på COVID-19NK-celler er en del af det medfødte immunsystem. Kredit:NIAID Der har hidtil været lidt kendt om, hvordan immunsystemets naturlige dræberceller (NK) detekterer, hvilke celler der er blevet inficere

Hvorfor naturlige dræberceller reagerer på COVID-19NK-celler er en del af det medfødte immunsystem. Kredit:NIAID Der har hidtil været lidt kendt om, hvordan immunsystemets naturlige dræberceller (NK) detekterer, hvilke celler der er blevet inficere -

Kritikere ramte USA over import af elefantpokalerElefanter i Sydafrika fotograferet i september 2016 Administrationen af USAs præsident Donald Trump stod torsdag over for en voldsom kritik fra dyrerettighedsgrupper, efter at den godkendte impo

Kritikere ramte USA over import af elefantpokalerElefanter i Sydafrika fotograferet i september 2016 Administrationen af USAs præsident Donald Trump stod torsdag over for en voldsom kritik fra dyrerettighedsgrupper, efter at den godkendte impo -

3D-emballage af DNA regulerer celleidentitetBestemmelse af celleskæbne kræver en koordineret regulering af genprogrammer involveret i udvikling og modning af væv. Holdet fandt ud af, at Hdac3 påvirker celleskæbnebestemmelsen gennem sin rolle so

3D-emballage af DNA regulerer celleidentitetBestemmelse af celleskæbne kræver en koordineret regulering af genprogrammer involveret i udvikling og modning af væv. Holdet fandt ud af, at Hdac3 påvirker celleskæbnebestemmelsen gennem sin rolle so -

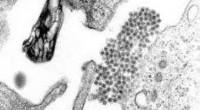

Almindelig svamp hjælper dengue-virus med at trives i mygEt TEM -mikrograf, der viser Dengue -virusvirioner (klyngen af mørke prikker nær midten). Billede:CDC En svampeart, der lever i tarmen hos nogle Aedes aegypti myg øger dengue-virusets evne til

Almindelig svamp hjælper dengue-virus med at trives i mygEt TEM -mikrograf, der viser Dengue -virusvirioner (klyngen af mørke prikker nær midten). Billede:CDC En svampeart, der lever i tarmen hos nogle Aedes aegypti myg øger dengue-virusets evne til

- Forskere undersøger sammenhængen mellem overfladevands saltholdighed, klima forandring

- Twitter tweak øger kampen mod trolde

- Gulerod eller pind? Spilteori kan optimere samarbejdet

- Fiskelængde, lystfiskerindsats:Hvordan de forholder sig

- NASA-ingeniør opnår endnu en milepæl inden for spirende nanoteknologi (m/ video)

- Ny teori lover at omforme, hvordan vi tænker om polymeroverbygninger