Forskere forbedrer computergengivelsen af dyrepels

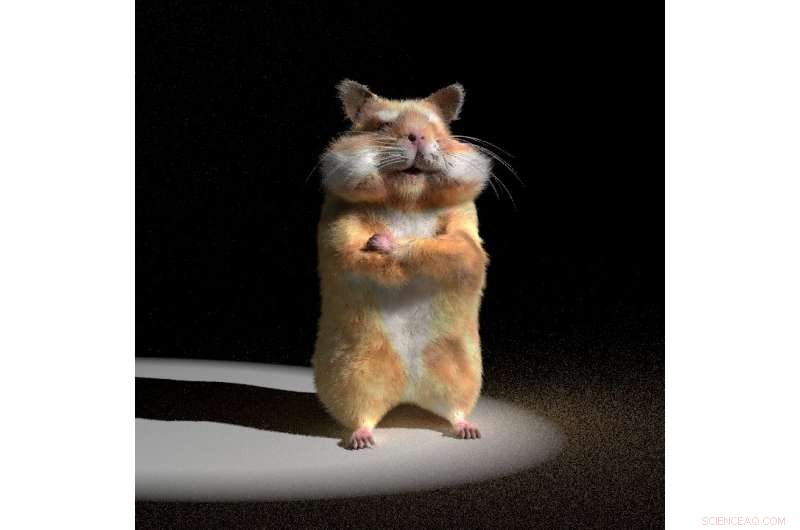

Gengivelse af en hamster, genereret med forskernes metode. Kredit:University of California - San Diego

De næste computergenererede dyr i King Kong eller Løvernes Konge kunne se meget mere realistiske ud takket være et gennembrud fra dataloger ved University of California.

Forskerne fra UC San Diego og UC Berkeley udviklede en metode, der dramatisk forbedrer den måde, computere simulerer pels på, og mere specifikt, den måde, lyset hopper inden i et dyrs skind.

Holdet præsenterede for nylig deres resultater på SIGGRAPH Asia-konferencen i Thailand.

"Vores model genererer meget mere nøjagtige simuleringer og er 10 gange hurtigere end den nyeste teknologi, " sagde Ravi Ramamoorthi, en af avisens seniorforfattere og direktøren for Center for Visual Computing ved UC San Diego.

Metoden kan anvendes til alt fra videospil, til computergenererede specialeffekter, til computeranimerede film.

Et problem med eksisterende modeller er, at de er designet til at skabe computergenereret hår, og fungerer ikke godt til pels. Det er fordi de fleste af disse modeller ikke tager højde for den centrale cylinder, eller medulla, findes i hver pelsfibre. Medulla i pels er meget større end i menneskehår, og lysets passage og spredning gennem den cylinder er meget vigtig for pelsudseendet. Indtil nu, de fleste forskere har ignoreret medullaen og bygget modeller, der følger en lysstråle, når den hopper fra den ene pelsfiber til den næste. Som resultat, eksisterende modeller kræver en enorm beregning og er både dyre og langsomme.

Derimod, UC San Diego og UC Berkeley forskerne brugte et koncept kaldet subsurface scattering til hurtigt at anslå, hvordan lyset hopper rundt om pelsfibre. I det væsentlige, underjordisk spredning beskriver, hvordan lys trænger ind i overfladen af en gennemskinnelig genstand, som hår eller pels, på et tidspunkt; spreder i forskellige vinkler; interagerer med objektets materiale; og forlader derefter objektet på et andet punkt. Dette koncept er velforstået og bruges ofte i simuleringer inden for computergrafik og computersyn.

I det virkelige liv, du kan observere spredning under overfladen ved at tænde din smartphones lommelygte og dække den til med fingeren i et rum, hvor lyset er blevet dæmpet. Du vil se en lysring, fordi lyset er kommet ind gennem din finger, spredt inde og derefter gået ud igen. (Lyset er rødt, fordi det ikke absorberes af kroppen, i modsætning til grønt og blåt lys.)

En vaskebjørn genereret med den nye metode, på en naturlig baggrund. Kredit:University of California - San Diego

For at anvende egenskaberne ved spredning under overfladen på pelsfibre, forskere brugte et neuralt netværk.

"Vi konverterer egenskaberne ved undergrundsspredning til pelsfibre, "sagde ph.d.-studerende Ling-Qi Yan, fra UC Berkeley, der arbejdede på undersøgelsen under ledelse af UC San Diego datalogi professorer Ravi Ramamoorthi og Henrik Wann Jensen. "Der er ingen eksplicit fysisk eller matematisk måde at foretage denne konvertering på. Så vi var nødt til at bruge et neuralt netværk til at forbinde disse to forskellige verdener."

Det neurale netværk behøvede kun at blive trænet med én scene, før man kunne anvende spredning under overfladen på alle de forskellige scener, det blev præsenteret. Dette resulterede i simuleringer, der kørte 10 gange hurtigere end det nyeste.

En gengivelse af en ulv genereret med forskernes metode. Kredit:University of California - San Diego

Den resulterende algoritme fungerer lige så godt til pels som til hår. Ja, udseendet af menneskehår gengivet med den nye metode er mere realistisk.

Næste trin omfatter brug af metoden til real-time pels- og hårfremstilling.

Sidste artikelGoogles digitale assistent grener ud til Nest -kamera

Næste artikelSlange-inspireret robot bruger kirigami til at bevæge sig

Varme artikler

Varme artikler

-

Videnskab for at afsløre, hvor lang tid motorvejsbyggeri egentlig skal tageSensorer udviklet af Purdue -ingeniører bliver integreret i motorvejene i Indiana for at afgøre, hvornår beton er moden nok til at åbne trafik efter et byggeprojekt. Kredit:Purdue University foto/Erin

Videnskab for at afsløre, hvor lang tid motorvejsbyggeri egentlig skal tageSensorer udviklet af Purdue -ingeniører bliver integreret i motorvejene i Indiana for at afgøre, hvornår beton er moden nok til at åbne trafik efter et byggeprojekt. Kredit:Purdue University foto/Erin -

Har ubemandet civil luftfart en plads i gældende international lovgivning?Kredit:Think Defense / Flickr / CC / by-nc Det forventes, at om ti år, ti procent af den globale civile luftfartsoperationer vil være ubemandet. Er de nuværende internationale luftfartslove og -re

Har ubemandet civil luftfart en plads i gældende international lovgivning?Kredit:Think Defense / Flickr / CC / by-nc Det forventes, at om ti år, ti procent af den globale civile luftfartsoperationer vil være ubemandet. Er de nuværende internationale luftfartslove og -re -

Løsning af en Rubiks-terning med en fingernem håndKredit:Li et al. I de seneste år, et stigende antal forskere har udforsket brugen af robotarme eller fingernem hænder til at løse en række dagligdagsopgaver. Mens mange af dem med succes har løs

Løsning af en Rubiks-terning med en fingernem håndKredit:Li et al. I de seneste år, et stigende antal forskere har udforsket brugen af robotarme eller fingernem hænder til at løse en række dagligdagsopgaver. Mens mange af dem med succes har løs -

Franskmand opnår drøm om første hoverboard-krydsning af kanalAlle vil flyve En fransk vovehals, der brugte år på at udvikle et jetdrevet hoverboard, zoomede over Den Engelske Kanal i søndags, opfyldte sin søgen efter at have gennemført en vanskelig tanknings

Franskmand opnår drøm om første hoverboard-krydsning af kanalAlle vil flyve En fransk vovehals, der brugte år på at udvikle et jetdrevet hoverboard, zoomede over Den Engelske Kanal i søndags, opfyldte sin søgen efter at have gennemført en vanskelig tanknings

- Hvad ser dronningens myrer ud?

- Forskere fanger ældste iskerne, der nogensinde er boret uden for polarområderne

- Hvordan kan visse stoffer holde varmen?

- Fysikere udvikler teknologi til at transformere information fra mikrobølger til optisk lys

- Kinas raketfejl vil sandsynligvis sætte de næste rummissioner tilbage

- Sådan beregnes sandsynlighed