AI kan hjælpe med at forebygge kriminalitet, men vi har stadig brug for et menneske, der har ansvaret

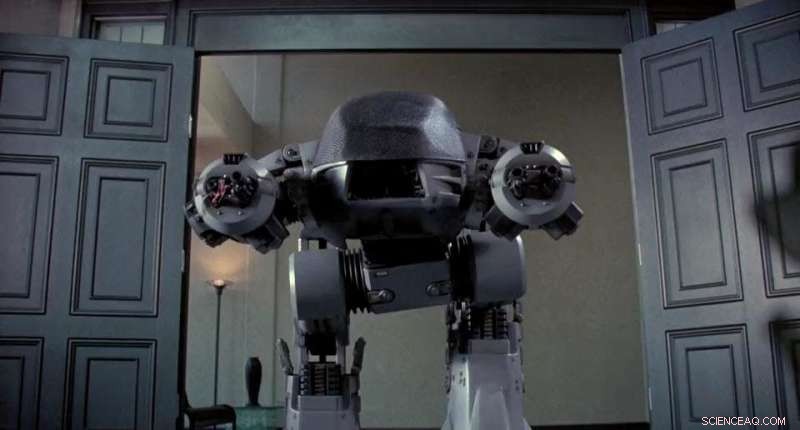

Robotten ED-209 fra filmen RoboCop fungerede ikke som forventet. Kredit:IMDB/RoboCop

Forestil dig, at du bor i en smart by, der kender dit ansigt og følger hvert eneste skridt - de steder du går, de mennesker du ser, og alle de ting, du gør undervejs.

Over tid, autonom kunstig intelligens (AI) opbygger en profil, der rapporterer om, hvor sandsynligt det er, at du begår en forbrydelse. Når den risiko er høj, politiet griber forebyggende ind. Velkommen til hyperovervågning og den næste generation af forudsigende politi.

Både Indien og Kina implementerer i øjeblikket dette niveau af overvågning for at nedbringe kriminaliteten og opdage terrorister, før de slår til.

Japan ser også på forudsigelsessystemer forud for OL i Tokyo i 2020. London og andre steder i Det Forenede Kongerige har brugt lignende teknologi i nogen tid.

Det kan allerede ske i den by, hvor du bor.

Gennemtrængende, realtidsovervågning som denne er mulig, fordi mere kraftfuld, talknusende computere kan behandle torrents af ansigtsgenkendelse og ganganalysedata fra tusindvis af videokameraer, alt sammen koordineret af avanceret AI, der kan give mening ud af det hele.

For ikke så længe siden, vi stolede på ørneøjede politipatruljer for at sikre den offentlige sikkerhed. Det var dengang, vi boede i små nok samfund, hvor folk kendte hinanden af synet.

Men da byerne fortsatte med at vokse, bliver for stor til politibetjenten alene, lukket kredsløbs-tv (CCTV), ansigtsgenkendelse og tidligere generations forudsigelsessystemer kom i brug.

Moralen ved hyperovervågning

Der er delte meninger om etikken i prædiktiv politiarbejde.

Privatlivsforkæmpere og civile libertarianere har bekymringer, hvis ikke indvendinger, til dette overvågningsniveau - frygter for, at det kan blive et instrument til diskrimination.

I mellemtiden Fortalere for offentlig sikkerhed og terrorbekæmpelse hævder, at forudsigelig teknologi har et stort potentiale til at forhindre terrorangreb og andre trusler mod den offentlige sikkerhed.

Begge argumenter har kraft og gyldighed, så spørgsmålet er, hvor præcist vi trækker grænsen mellem offentlighedens interesse og individuel frihed?

Svaret vil variere fra sag til sag. Hver jurisdiktion skal forhandle svaret under hensyntagen til alle interessenters bekymringer.

Siden terrorister angreb i USA den 11. september, I 2001 er graden af overvågning og eftersøgning i lufthavne steget dramatisk.

I tide, den rejsende offentlighed kom til at acceptere situationen som værende i deres egen og deres medpassagerers bedste interesse.

Privatliv begynder og slutter ved hoveddøren

Det er almindeligt anerkendt, at du har ret til privatliv i dit eget hjem. Når du lukker hoveddøren, du kan med rimelighed forvente, at ingen kigger og lytter.

Undtagelsen er, når du er hjemme, men beskæftiger dig med kriminel aktivitet, der truer samfundet. Det er her, vi trækker grænsen i dette tilfælde mellem individuelle rettigheder og det større gode.

Men når du går udenfor, alle kan se på dig, hvis de vil. De kan også overhøre den samtale, du har. Der er ingen ret til privatliv fra det offentlige blik, og har aldrig været det.

Men at se er anderledes end at lave forudsigelser - og den ubehagelige sandhed er, at forudsigende polititeknologi har potentialet til at blive brugt som et redskab til undertrykkelse. Håndtering af denne risiko i en åben, det demokratiske samfund er bestemt en udfordring, men ikke en uoverkommelig en med checks og balances.

Opvejning af risici og fordele

I betragtning af den samlede erfaring med prædiktiv politiarbejde, det ser ud til, at der er stærke argumenter for dens fortsatte brug.

I Australien, for eksempel, 15 terrorangreb blev angiveligt forpurret i de seneste tre år gennem politiarbejde understøttet af computeralgoritmer.

Spørgsmålet er, hvordan minimerer vi risiciene til et acceptabelt niveau?

Det korte svar er at etablere en juridisk ramme, der garanterer etisk gennemsigtighed i alle AI-forudsigende politimetoder, herunder hvordan algoritmerne er sat sammen.

Det vil også nøje sikre, at de data, der føres ind i forudsigelsessystemer, er nøjagtige og objektive. Som med ethvert computersystem, outputtet er kun så godt som inputtet – skrald i, skrald ud, som man siger.

Dette er nødvendigt for at imødegå de igangværende bekymringer om iboende bias i prædiktive systemer.

Det er blevet observeret, at ikke alle politistyrker er skabt ens. I USA er der ikke mindre end 12, 000 lokale politistyrker. Der er helt sikkert forskelle, afspejles i kvaliteten af ledelse og tilgængeligheden af ressourcer.

Menneske/AI-partnerskab

Politiet er ikke perfekt, og menneskelige betjente får det ikke rigtigt hele tiden.

Men når det kommer til kunstig intelligens i politiarbejde, Jeg mener, at der altid bør være en plads i retshåndhævelsen for de finpudsede instinkter hos en erfaren menneskelig officer dæmpet af et system af kontrol og balance.

Teknologien bør altid være underordnet mennesket, påtage sig rollen som beslutningsstøttende hjælper.

Den vej, når hyperovervågningens æra kommer til din hjemby, det vil være et ansvarligt menneske, ikke en maskine – hvor intelligent den end måtte være – der afgør, om en person udgør en alvorlig risiko for den offentlige sikkerhed.

Denne artikel blev oprindeligt publiceret på The Conversation. Læs den originale artikel.

Varme artikler

Varme artikler

-

Den franske bilproducent PSA trodser nedgang i salget med rekordoverskudDen franske bilmarkør PSA Peugeot Citroen opnåede rekordoverskud i 2019 Den franske bilgigant PSA Peugeot-Citroen, i øjeblikket i færd med at fusionere med rivalen Fiat Chrysler, sagde onsdag, at

Den franske bilproducent PSA trodser nedgang i salget med rekordoverskudDen franske bilmarkør PSA Peugeot Citroen opnåede rekordoverskud i 2019 Den franske bilgigant PSA Peugeot-Citroen, i øjeblikket i færd med at fusionere med rivalen Fiat Chrysler, sagde onsdag, at -

Fortjenesten stiger for Microsoft drevet af skyen, forretningsserviceCEO Satya Nadella sagde, at overskuddet steg, efterhånden som flere virksomheder vælger Microsoft til cloud- og teknologitjenester Microsoft offentliggjorde torsdag et kvartalsresultat, der svigte

Fortjenesten stiger for Microsoft drevet af skyen, forretningsserviceCEO Satya Nadella sagde, at overskuddet steg, efterhånden som flere virksomheder vælger Microsoft til cloud- og teknologitjenester Microsoft offentliggjorde torsdag et kvartalsresultat, der svigte -

Hylde fremtidens taxa:Drone-car mashup-model tager flugtenEn arbejdsskalamodel af Pop.Up Next, en prototype designet af Audi, Airbus og Italdesign, kører væk fra luftmodulet, bag, efter landing under en præsentation ved Amsterdam Drone Week i Amsterdam, Holl

Hylde fremtidens taxa:Drone-car mashup-model tager flugtenEn arbejdsskalamodel af Pop.Up Next, en prototype designet af Audi, Airbus og Italdesign, kører væk fra luftmodulet, bag, efter landing under en præsentation ved Amsterdam Drone Week i Amsterdam, Holl -

Nedturen i Kinas bilsalg fortsætter i aprildrevet af stigende indkomster og offentlige incitamenter, Kina er i de seneste år steget til at blive verdens største bilmarked Kinas bilsalg faldt 14,6 procent i april, en officiel brancheforenin

Nedturen i Kinas bilsalg fortsætter i aprildrevet af stigende indkomster og offentlige incitamenter, Kina er i de seneste år steget til at blive verdens største bilmarked Kinas bilsalg faldt 14,6 procent i april, en officiel brancheforenin

- Hvordan Faktor Tredje Power Polynomials

- Mario krus, Zelda muleposer, da Nintendo åbner den første Tokyo -butik

- Det nordatlantiske opvarmningshul påvirker jetstrømmen

- Tusinder undrer sig over, at total formørkelse formørker Chile, Argentina

- Kemikere udfører kirurgi på nanopartikler

- Politiserede, polariserede videnskabelige synspunkter er værre end nogensinde