Robot i stand til at efterligne en aktivitet efter kun at have observeret den én gang

Tre trin til vores meta-læringsalgoritme. Kredit:Tianhe Yu og Chelsea Finn

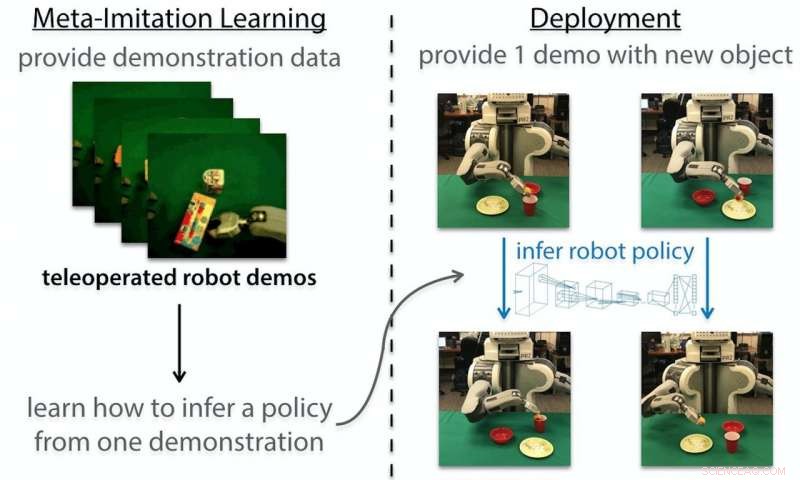

Et team af forskere ved UC Berkeley har fundet en måde at få en robot til at efterligne en aktivitet, den ser på en videoskærm blot en enkelt gang. I et papir, de har uploadet til arXiv preprint server, teamet beskriver den tilgang, de brugte, og hvordan den fungerer.

Robotter, der lærer at gøre ting ved blot at se et menneske udføre en handling en enkelt gang, ville være i stand til at lære mange flere nye handlinger meget hurtigere, end det nu er muligt. Forskere har arbejdet hårdt på at finde ud af, hvordan man får det til at ske.

Historisk set dog Robotter er blevet programmeret til at udføre handlinger som at samle et objekt op ved hjælp af kode, der udtrykkeligt angiver, hvad der skal gøres og hvordan. Sådan fungerer de fleste robotter, der laver ting som at samle biler på en fabrik. Sådanne robotter skal stadig gennemgå en træningsproces, hvorved de ledes gennem procedurer flere gange, indtil de er i stand til at gøre dem uden at begå fejl. For nylig, robotter er blevet programmeret til at lære udelukkende gennem observation - ligesom mennesker og andre dyr gør. Men sådan imitativ læring kræver typisk tusindvis af observationer. I denne nye indsats, forskerne beskriver en teknik, de har udviklet, der gør det muligt for en robot at udføre en ønsket handling ved at se et menneske gøre det bare en enkelt gang.

For at opnå denne bedrift, forskerne kombinerede imitationslæring med en meta-læringsalgoritme. Resultatet er noget, de kalder model-agnostisk meta-læring (MAML). Meta-læring, forklarer forskerne, er en proces, hvorved en robot lærer ved at inddrage tidligere erfaringer. Hvis en robot vises video af et menneske, der samler en pære eller en anden lignende genstand op, for eksempel, og putter det i en kop, skål eller anden genstand, det kan få en "fornemmelse" for et mål. Hvis det i hvert tilfælde læres at efterligne adfærden på en bestemt måde, så "lærer" den, hvad den skal gøre, når den observerer anden lignende adfærd. Dermed, når den ser en video af en person, der tager en blomme op og putter den i en skål, den genkender adfærden og er i stand til at omsætte den til sin egen lignende adfærd, som den så kan udføre.

© 2018 Tech Xplore

Varme artikler

Varme artikler

-

Kunstig intelligens-forstærket journalistik giver et glimt af fremtiden for videnøkonomienRobotter vil ikke holde pennene endnu, men de kan hjælpe folk med at udføre arbejdet. Kredit:Paul Fleet/Shutterstock.com Ligesom robotter har transformeret hele dele af produktionsøkonomien, kunst

Kunstig intelligens-forstærket journalistik giver et glimt af fremtiden for videnøkonomienRobotter vil ikke holde pennene endnu, men de kan hjælpe folk med at udføre arbejdet. Kredit:Paul Fleet/Shutterstock.com Ligesom robotter har transformeret hele dele af produktionsøkonomien, kunst -

Eagle-eyed algoritme overgår menneskelige eksperterStrålingsskadede materialer ligner en krateret måneoverflade, og maskinlæring kan nu hjælpe med atomreaktordesign ved hurtigt at finde og identificere specifikke varianter af defekter. Kredit:Kevin Fi

Eagle-eyed algoritme overgår menneskelige eksperterStrålingsskadede materialer ligner en krateret måneoverflade, og maskinlæring kan nu hjælpe med atomreaktordesign ved hurtigt at finde og identificere specifikke varianter af defekter. Kredit:Kevin Fi -

Edmunds fremhæver 10 bemærkelsesværdige nye biler for 2019Dette udaterede billede leveret af Volvo Cars of North America viser 2019 Volvo XC40, en mere overkommelig, nedskaleret version af den svenske bilproducents populære SUVer i mellemstørrelse og fuld st

Edmunds fremhæver 10 bemærkelsesværdige nye biler for 2019Dette udaterede billede leveret af Volvo Cars of North America viser 2019 Volvo XC40, en mere overkommelig, nedskaleret version af den svenske bilproducents populære SUVer i mellemstørrelse og fuld st -

Boeing reducerer produktionshastigheden for urolige 737 Max -jetflyI denne marts 13, 2019, filfoto en medarbejder står på en platform nær et Boeing 737 MAX 8 -fly, der bygges til TUI Group på Boeing Cos Renton Assembly Plant i Renton, Wash. Boeing skærer produktionen

Boeing reducerer produktionshastigheden for urolige 737 Max -jetflyI denne marts 13, 2019, filfoto en medarbejder står på en platform nær et Boeing 737 MAX 8 -fly, der bygges til TUI Group på Boeing Cos Renton Assembly Plant i Renton, Wash. Boeing skærer produktionen

- DoJ søger Google -optegnelser, da amerikanske stater lancerer antitrust -undersøgelse af Big Tech

- Sådan bygges et ægdråb ud af kun tandstikker & lim

- Hvor længe kan et menneske overleve i det ydre rum?

- Det britiske frackingfirma producerer den første skifergas

- Kvantemåling metode måler små magnetiske felter

- Vi kunne drive en ny grøn bevægelse ved at tale om energiændringer