Den digitale tidsalder har desperat brug for etiske og juridiske retningslinjer

Et af de presserende spørgsmål, der opstår med kunstig intelligens, er, hvordan man skal redegøre for handlingerne fra maskiner, der selv træffer beslutninger. Kredit:ITU Pictures, licenseret under CC BY 2.0

Digitale teknologier såsom kunstig intelligens og robotik, 'desperat' har brug for en institutionel ramme og et værdisystem for at hjælpe med at regulere industrien, har en etikekspert fortalt førende forskere og politikere.

Jeroen van den Hoven, professor i etik og teknologi ved Delft University of Technology i Holland, talte på en session om etik inden for videnskab og teknologi på EuroScience Open Forum (ESOF) 2018, der afholdes i Toulouse, Frankrig, fra 9-14 juli.

"Folk bliver klar over, at denne digitale tidsalder ikke er neutral ..., det præsenteres for os hovedsageligt af store virksomheder, der ønsker at tjene noget, " han sagde.

Han opfordrede til et europæisk netværk af institutioner, der kan levere et sæt værdier, baseret på EU's charter om grundlæggende rettigheder, som teknologiindustrien kunne operere inden for.

"Vi er nødt til at oprette, som vi har gjort for mad, for luftfart og trafik ... et udførligt system af institutioner, der vil se (på) dette felt af kunstig intelligens.

”Vi skal tænke på regeringsførelse, inspektion, overvågning, test, certificering, klassifikation, standardisering, uddannelse, alle disse ting. De er der ikke. Vi skal desperat, og meget hurtigt, hjælpe os selv med det. "

Prof. van den Hoven er medlem af European Group on Ethics in Science and New Technologies (EGE), et uafhængigt rådgivende organ for Europa -Kommissionen, som organiserede den session, han talte på.

I marts, EGE offentliggjorde en erklæring om kunstig intelligens (AI), robotik og autonome systemer, der kritiserede det nuværende 'patchwork af forskellige initiativer' i Europa, der forsøger at tackle det sociale, juridiske og etiske spørgsmål, som AI har genereret. I erklæringen, EGE opfordrede til etablering af en struktureret ramme.

Europa-Kommissionen meddelte den 14. juni, at de har pålagt en gruppe på højt niveau på 52 personer fra den akademiske verden, samfundet og industrien med opgaven at udvikle retningslinjer for EU's AI-relaterede politik, herunder etiske spørgsmål såsom retfærdighed, sikkerhed, gennemsigtighed og opretholdelse af grundlæggende rettigheder.

Ekspertgruppen, som omfatter repræsentanter fra branchens ledere inden for AI såsom Google, BMW og Santander, skal forelægge deres retningslinjer for Europa -Kommissionen i begyndelsen af 2019.

Partiskhed

Etiske spørgsmål omkring AI-såsom bias i maskinlæringsalgoritmer og hvordan man overvåger beslutningstagning af autonome maskiner-vakte også omfattende diskussion på ESOF 2018-konferencen.

En stor bekymring dukker op med den hurtige udvikling af maskinlæring, er spørgsmålet om, hvordan man skal redegøre for en maskines handlinger. Dette er et særligt problem, når du bruger AI baseret på neurale netværk, et komplekst system oprettet for at efterligne den menneskelige hjerne, der gør det muligt at lære af store datasæt. Dette resulterer ofte i, at algoritme bliver det, der er kendt som en 'sort boks, "hvor det er muligt at se, hvad der går ind og hvad der kommer ud, men ikke hvordan resultatet blev nået.

Maaike Harbers, en forskningsprofessor ved Rotterdam University of Applied Sciences i Holland, sagde, at dette var et vigtigt spørgsmål i militæret, hvor våbnede droner bruges til at udføre handlinger.

"På det militære område, et meget vigtigt begreb er meningsfuld menneskelig kontrol, "sagde hun." Vi kan kun styre eller styre autonome maskiner, hvis vi forstår, hvad der foregår. "

Prof. Harbers tilføjede, at et godt design af grænsefladen mellem mennesker og maskiner kan hjælpe med at sikre, at mennesker udøver kontrol på tre vigtige stadier - datainput, behandling og begrundelse, og output eller handling.

Selv i teknologier, der bruger AI til formål, der synes at være overvældende positive, såsom ledsagende sociale robotter til børn, rejse nogle vanskelige etiske spørgsmål. Konferencepublikummet hørte, at forskere, der arbejder på dette område, kæmper med den effekt, disse teknologier kan have på familieforhold, for eksempel, eller om de kunne skabe uligheder i samfundet, eller hvis de måske skaber social isolation.

Inden for automatiseret transport, forskere ser også på den indvirkning selvkørende biler kan have på bredere spørgsmål som retfærdighed og lighed. De undersøger spørgsmål lige fra, hvordan man sikrer lige adgang til nye transportformer, til hvem der skal have fordel af omkostningsbesparelser i forbindelse med automatiseret transport.

Imidlertid, de værdier, vi inddrager i AI, kan være en nøglefaktor for offentlig accept af nye teknologier.

Et af de mest kendte moralske dilemmaer, der involverer selvkørende biler, for eksempel, er det såkaldte vognproblem. Dette stiller spørgsmålet om, hvorvidt et autonomt køretøj på vej mod en ulykke, der involverer en gruppe mennesker, bør undgå det ved at svinge ind på en sti, der kun ville ramme en person.

Dr. Ebru Burcu Dogan fra Vedecom Institute i Frankrig, sagde forskning viser, at mens folk gik ind for en utilitaristisk løsning på dilemmaet - f.eks. dræbe chaufføren frem for fem fodgængere - de ville personligt ikke købe eller køre i et køretøj, der var programmeret på en sådan måde.

"Vi ønsker alle at drage fordel af implementeringen af en teknologi, men vi ønsker ikke nødvendigvis at ændre vores adfærd, eller vedtag den nødvendige adfærd for at komme dertil. "

Sidste artikelUSA undersøger mulig kønsfordeling i Uber

Næste artikelRenault scorer ny salgsrekord drevet af nye markeder

Varme artikler

Varme artikler

-

Intel præsenterer en 10-core 5,3 GHz processorKredit:CC0 Public Domain To kometer er på vej mod os senere på måneden:Den ene er den himmelske slags, C/2019 Y4, forventes at levere et spektakulært natlys show, da det kommer tættest på Jorden s

Intel præsenterer en 10-core 5,3 GHz processorKredit:CC0 Public Domain To kometer er på vej mod os senere på måneden:Den ene er den himmelske slags, C/2019 Y4, forventes at levere et spektakulært natlys show, da det kommer tættest på Jorden s -

Total starter produktionen på det franske biobrændstofraffinaderiTotal begyndte at konvertere sit konventionelle raffinaderi ved La Mede i 2015, med anlægget, der nu producerer biobrændstof Total sagde onsdag, at det var begyndt at producere biobrændstof på et

Total starter produktionen på det franske biobrændstofraffinaderiTotal begyndte at konvertere sit konventionelle raffinaderi ved La Mede i 2015, med anlægget, der nu producerer biobrændstof Total sagde onsdag, at det var begyndt at producere biobrændstof på et -

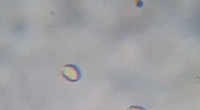

Forskere udvikler en maskinlæringsmetode til at identificere falsk honningLysfelt billede af pollen. Kredit:Han, Gkantiragas og Glowacki. Et team af forskere ved Imperial College London og UCL har for nylig udviklet en ny metode til at autentificere honning ved hjælp af

Forskere udvikler en maskinlæringsmetode til at identificere falsk honningLysfelt billede af pollen. Kredit:Han, Gkantiragas og Glowacki. Et team af forskere ved Imperial College London og UCL har for nylig udviklet en ny metode til at autentificere honning ved hjælp af -

EU for at begrænse telefonomkostninger, opsætte nødalarmsystemPrisgrænserne følger EUs tiltag sidste år for at stoppe roamingtakster for europæere, der bruger mobiltelefoner inden for blokken - et PR-kup Europa-Parlamentet stemte onsdag for at begrænse prise

EU for at begrænse telefonomkostninger, opsætte nødalarmsystemPrisgrænserne følger EUs tiltag sidste år for at stoppe roamingtakster for europæere, der bruger mobiltelefoner inden for blokken - et PR-kup Europa-Parlamentet stemte onsdag for at begrænse prise

- Mumificerede buddhistiske munk bliver dækket af rent guld

- Livet på Mars:simulerer Red Planet-base i israelsk ørken

- Fotonisk krystal og nanotrådskombination fremmer fotonisk integration

- Dyr rigeligt, plads til en præmie i Afrikas ældste zoo

- Forskerhold forvandler nanorør til hårdere kulstof til rumfartøjer, satellitter

- Forholdet mellem atomnummeret og den kemiske reaktivitet af alkaliske metaller