Gendannelse af balance i maskinlæringsdatasæt

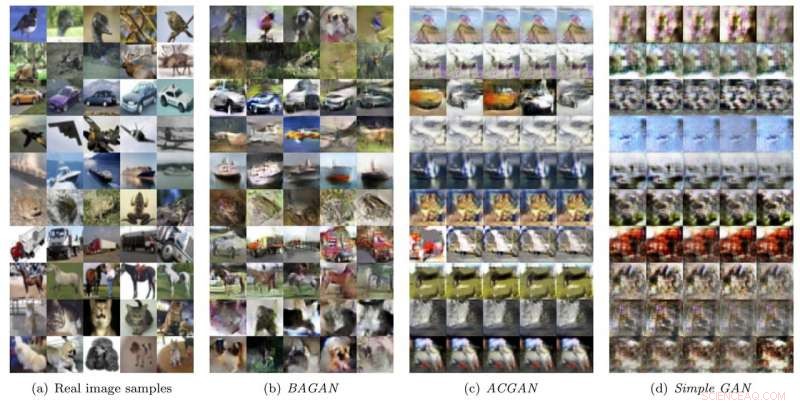

Fem repræsentative prøver for hver klasse (række) i CIFAR-10-datasættet. For hver klasse, disse prøver er opnået med generative modeller trænet efter at have droppet 40 % af billederne fra den specifikke klasse fra træningssættet. Kredit:IBM

Hvis du vil lære et barn, hvordan en elefant ser ud, du har et uendeligt antal muligheder. Tag et billede fra National Geographic, et udstoppet dyr af Dumbo, eller en elefant nøglering; vis det til barnet; og næste gang han ser en genstand, der ligner en elefant, vil han sandsynligvis pege og sige ordet.

At lære AI, hvordan en elefant ser ud, er lidt anderledes. For at træne en maskinlæringsalgoritme, du vil sandsynligvis have brug for tusindvis af elefantbilleder med forskellige perspektiver, såsom hoved, hale, og profil. Men derefter, selv efter at have indtaget tusindvis af billeder, hvis du forbinder din algoritme til et kamera og viser den en pink elefant nøglering, den vil sandsynligvis ikke genkende den som en elefant.

Dette er en form for databias, og det påvirker ofte nøjagtigheden af deep learning-klassifikatorer negativt. For at rette op på denne skævhed, ved at bruge det samme eksempel, vi ville have brug for mindst 50-100 billeder af lyserøde elefanter, hvilket kunne være problematisk, da lyserøde elefanter er "sjældne".

Dette er en kendt udfordring i maskinlæringsfællesskaber, og om det er lyserøde elefanter eller vejskilte, små datasæt giver store udfordringer for AI-forskere.

Gendannelse af balance til træning af AI

Siden tidligere i år har mine kolleger og jeg hos IBM Research i Zürich tilbyder en løsning. Det hedder BAGAN, eller afbalancere generative kontradiktoriske netværk, og det kan generere helt nye billeder, dvs. af lyserøde elefanter, at genoprette balancen til træning af AI.

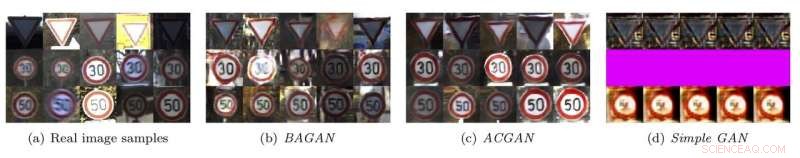

Fem repræsentative prøver genereret for de tre mest repræsenterede majoritetsklasser i GT-SRB-datasættet. Kredit:IBM

At se er at tro

I papiret rapporterer vi at bruge BAGAN på det tyske benchmark for trafikskiltgenkendelse, samt på MNIST og CIFAR-10, og sammenlignet med state-of-the-art GAN, metodikken overgår dem alle med hensyn til variation og kvalitet af de genererede billeder, når træningsdatasættet er ubalanceret. På tur, dette fører til en højere nøjagtighed af de endelige klassifikatorer trænet på det udvidede datasæt.

Fem repræsentative prøver genereret for de tre mindst repræsenterede minoritetsklasser i GT-SRB-datasættet. Kredit:IBM

Denne historie er genudgivet med tilladelse fra IBM Research. Læs den originale historie her.

Varme artikler

Varme artikler

-

Facebook ønsker at holde dig orienteret om nødsituationer, aktive skytter i dit områdeKredit:CC0 Public Domain Selvom Facebook ikke er en egentlig nyhedsorganisation, dens evne til at nå brugere hurtigere end lokale nyhedskanaler i nogle tidsfølsomme tilfælde. Fra tirsdag d. Faceb

Facebook ønsker at holde dig orienteret om nødsituationer, aktive skytter i dit områdeKredit:CC0 Public Domain Selvom Facebook ikke er en egentlig nyhedsorganisation, dens evne til at nå brugere hurtigere end lokale nyhedskanaler i nogle tidsfølsomme tilfælde. Fra tirsdag d. Faceb -

Moskva cryptocurrency boutique i juridisk gråzoneMoskvas første cryptocurrency-butik er en fysisk portal til bitcoins virtuelle rige Først ringer du, skub derefter gennem tunge døre forbi en mistænkelig sikkerhedsvagt, før du ankommer til Moskva

Moskva cryptocurrency boutique i juridisk gråzoneMoskvas første cryptocurrency-butik er en fysisk portal til bitcoins virtuelle rige Først ringer du, skub derefter gennem tunge døre forbi en mistænkelig sikkerhedsvagt, før du ankommer til Moskva -

Verdens største batteri i Australien til at trumfe MuskDen britiske milliardærforretningsmand Sanjeev Gupta vil bygge verdens største batteri i det sydlige Australien, overhalede den amerikanske stjerne -iværksætter Elon Musks projekt i samme stat sidste

Verdens største batteri i Australien til at trumfe MuskDen britiske milliardærforretningsmand Sanjeev Gupta vil bygge verdens største batteri i det sydlige Australien, overhalede den amerikanske stjerne -iværksætter Elon Musks projekt i samme stat sidste -

Sealy, 3D-printere i verdensklasse sat til at skabe opløselige medicinske implantaterMichael Sealy, assisterende professor i maskin- og materialeteknik, har et grundlæggende eksempel på de medicinske implantater, han designer via University of Nebraska-Lincolns 3D-printere. Sealy brug

Sealy, 3D-printere i verdensklasse sat til at skabe opløselige medicinske implantaterMichael Sealy, assisterende professor i maskin- og materialeteknik, har et grundlæggende eksempel på de medicinske implantater, han designer via University of Nebraska-Lincolns 3D-printere. Sealy brug

- At lave (per)bølger:Rumstudier kan forbedre fremtidige brændstoffer

- Interstellare fullerener kan hjælpe med at finde løsninger på jordiske spørgsmål

- Pas på den smarte enhed:Måder at forblive private og sikre

- Billede:Crew Dragon hardware sat på prøve

- Migration er et voksende problem, men det er fortsat en udfordring at definere, hvem der faktisk er …

- Sådan laver du et parallelt kredsløb for at tænde Lights