Følelseslæsende teknologi fejler racefordommestesten

Basketballspillerne Darren Collision (til venstre) og Gordon Hayward (til højre). Kredit:basketball-reference.com

Ansigtsgenkendelsesteknologien har udviklet sig til et punkt, hvor den nu fortolker følelser i ansigtsudtryk. Denne type analyser bruges i stigende grad i dagligdagen. For eksempel, virksomheder kan bruge software til ansigtsgenkendelse til at hjælpe med ansættelsesbeslutninger. Andre programmer scanner ansigterne i menneskemængder for at identificere trusler mod den offentlige sikkerhed.

Desværre, denne teknologi kæmper for at fortolke følelserne fra sorte ansigter. Mit nye studie, udgivet i sidste måned, viser, at følelsesanalyseteknologi tildeler flere negative følelser til sorte mænds ansigter end hvide mænds ansigter.

Det er ikke første gang, at ansigtsgenkendelsesprogrammer har vist sig at være partiske. Google mærkede sorte ansigter som gorillaer. Kameraer identificerede asiatiske ansigter som blinkende. Ansigtsgenkendelsesprogrammer kæmpede for korrekt at identificere køn for mennesker med mørkere hud.

Mit arbejde bidrager til en voksende opfordring til bedre at forstå den skjulte skævhed i software til kunstig intelligens.

Måling bias

At undersøge skævheden i ansigtsgenkendelsessystemer, der analyserer folks følelser, Jeg brugte et datasæt med 400 NBA-spillerbilleder fra sæsonen 2016 til 2017, fordi spillere er ens i deres tøj, atletik, alder og køn. Også, da disse er professionelle portrætter, spillerne ser på kameraet på billedet.

Jeg kørte billederne gennem to velkendte typer software til følelsesmæssig genkendelse. Begge tildelte sorte spillere mere negative følelsesmæssige scores i gennemsnit, uanset hvor meget de smilede.

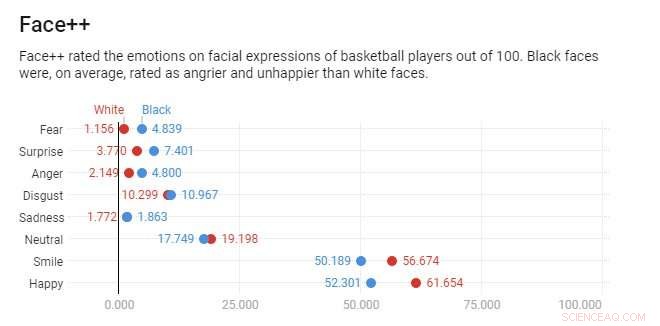

Kredit:Diagram:Samtalen, CC-BY-ND Kilde:SSRN (2018)

For eksempel, overvej de officielle NBA-billeder af Darren Collison og Gordon Hayward. Begge spillere smiler, og, ifølge ansigtsgenkendelses- og analyseprogrammet Face++, Darren Collison og Gordon Hayward har lignende smilscore - 48,7 og 48,1 ud af 100, henholdsvis.

Imidlertid, Face++ vurderer Haywards udtryk som 59,7 procent glad og 0,13 procent vred og Collisons udtryk som 39,2 procent glad og 27 procent vred. Collison betragtes som næsten lige så vred, som han er glad og langt mere vred end Hayward - på trods af at ansigtsgenkendelsesprogrammet selv erkender, at begge spillere smiler.

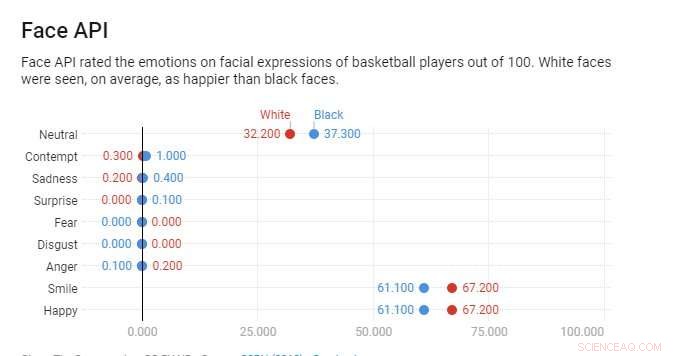

I modsætning, Microsofts Face API betragtede begge mænd som glade. Stadig, Collison betragtes som mindre glad end Hayward, med 98 og 93 procent lykkescore, henholdsvis. På trods af hans smil, Collison bliver endda scoret med en lille smule foragt, hvorimod Hayward ikke har nogen.

På tværs af alle NBA-billederne, det samme mønster viser sig. Gennemsnitlig, Face++ vurderer sorte ansigter som dobbelt så vrede som hvide ansigter. Face API scorer sorte ansigter som tre gange mere foragtende end hvide ansigter. Efter at have matchet spillere baseret på deres smil, begge ansigtsanalyseprogrammer er stadig mere tilbøjelige til at tildele de negative følelser af vrede eller foragt til sorte ansigter.

Stereotypt af AI

Min undersøgelse viser, at ansigtsgenkendelsesprogrammer udviser to forskellige typer af bias.

Kredit:Diagram:Samtalen, CC-BY-ND Kilde:SSRN (2018)

Først, sorte ansigter blev konsekvent vurderet som mere vrede end hvide ansigter for hvert smil. Face++ viste denne type bias. Sekund, sorte ansigter blev altid bedømt som mere vrede, hvis der var nogen tvetydighed om deres ansigtsudtryk. Face API viste denne type ulighed. Selvom sorte ansigter delvist smiler, min analyse viste, at systemerne antog flere negative følelser sammenlignet med deres hvide modparter med lignende udtryk. De gennemsnitlige følelsesmæssige resultater var meget tættere på tværs af racer, men der var stadig mærkbare forskelle for sorte og hvide ansigter.

Denne observation stemmer overens med anden forskning, hvilket tyder på, at sorte fagfolk skal forstærke positive følelser for at modtage paritet i deres arbejdspladspræstationsevalueringer. Undersøgelser viser, at folk opfatter sorte mænd som mere fysisk truende end hvide mænd. selv når de har samme størrelse.

Nogle forskere hævder, at ansigtsgenkendelsesteknologi er mere objektiv end mennesker. Men min undersøgelse tyder på, at ansigtsgenkendelse afspejler de samme skævheder, som folk har. Sorte mænds ansigtsudtryk bedømmes oftere med følelser forbundet med truende adfærd end hvide mænd. selv når de smiler. Der er god grund til at tro, at brugen af ansigtsgenkendelse kunne formalisere allerede eksisterende stereotyper til algoritmer, automatisk integrere dem i hverdagen.

Indtil ansigtsgenkendelse vurderer sorte og hvide ansigter på samme måde, sorte mennesker kan have brug for at overdrive deres positive ansigtsudtryk - i det væsentlige smile mere - for at reducere tvetydighed og potentielt negative fortolkninger af teknologien.

Selvom det er innovativt, kunstig intelligens kan udøve og forværre eksisterende magtdynamik, fører til forskellig indvirkning på tværs af race/etniske grupper. En vis samfundsmæssig ansvarlighed er nødvendig for at sikre retfærdighed over for alle grupper, fordi ansigtsgenkendelse, som de fleste kunstig intelligens, er ofte usynlig for de mennesker, der er mest berørt af dens beslutninger.

Denne artikel er genudgivet fra The Conversation under en Creative Commons-licens. Læs den originale artikel.

Sidste artikelApple sænker udsigterne, ser udfordringer i Kina, nye markeder

Næste artikelÆbler bombe og billion-dollar spørgsmålet

Varme artikler

Varme artikler

-

Brazils Embraer poster nettounderskud for 2018Et Embraer 190 kommercielt fly med registrering OH-LKI af det nordiske luftfartsselskab Finnair ses lande i Genève Lufthavn den 11. marts, 2019 i Genève. Embraer viser et nettounderskud for 2018 D

Brazils Embraer poster nettounderskud for 2018Et Embraer 190 kommercielt fly med registrering OH-LKI af det nordiske luftfartsselskab Finnair ses lande i Genève Lufthavn den 11. marts, 2019 i Genève. Embraer viser et nettounderskud for 2018 D -

Facebook, Twitter-nedtagninger viser dilemma med hensyn til at bremse manipulationDe seneste undertrykkelser fra Facebook og Twitter mod falske konti understreger udfordringerne for sociale mediefirmaer at forblive åbne, mens de bremser manipulation og udenlandsk indblanding Fac

Facebook, Twitter-nedtagninger viser dilemma med hensyn til at bremse manipulationDe seneste undertrykkelser fra Facebook og Twitter mod falske konti understreger udfordringerne for sociale mediefirmaer at forblive åbne, mens de bremser manipulation og udenlandsk indblanding Fac -

Har du ikke tillid til teknologigiganterne? Du stoler sandsynligvis på dem alligevel (Opdatering)I denne 1. juni, 2018, fil foto, pendlere kigger på deres telefoner i Los Angeles. Teknologigiganter som Facebook, Google og Amazon beder os om at betro dem med stadig mere følsomme aspekter af vores

Har du ikke tillid til teknologigiganterne? Du stoler sandsynligvis på dem alligevel (Opdatering)I denne 1. juni, 2018, fil foto, pendlere kigger på deres telefoner i Los Angeles. Teknologigiganter som Facebook, Google og Amazon beder os om at betro dem med stadig mere følsomme aspekter af vores -

YouTube udvider musikstreamingtjenesten til EuropaYouTube vil have en større del af musikstreamingkagen YouTube udvidede sin musikstreamingtjeneste til Europa mandag en måned efter den blev lanceret i Nordamerika og dele af Asien. YouTube Music

YouTube udvider musikstreamingtjenesten til EuropaYouTube vil have en større del af musikstreamingkagen YouTube udvidede sin musikstreamingtjeneste til Europa mandag en måned efter den blev lanceret i Nordamerika og dele af Asien. YouTube Music

- Introduktion til hvordan gigantiske vira fungerer

- Sårhelende biomaterialer aktiverer immunsystemet for stærkere hud

- Forskning åbner døren for mindre, billigere, mere adræt kommunikationsteknologi

- Europa-fanepladser mangler forventede varmesignaturer

- Tundrabiomer og abiotiske faktorer

- Kan sociale netværk hjælpe os med at være mere kreative?