Google opløser etisk komité for kunstig intelligens

Google bekræftede, at det har opløst sit etiske panel for kunstig intelligens

Google bekræftede torsdag, at det har opløst et nyligt sammensat etisk rådgivende panel for kunstig intelligens i lyset af kontroverser om deres medlemskab.

Slutningen på Advanced Technology External Advisory Council (ATEAC) kom få dage efter, at en gruppe Google-medarbejdere lancerede en offentlig kampagne mod at have præsidenten for den konservative tænketank Heritage Foundation blandt sine medlemmer.

Et andet medlem af bestyrelsen var allerede trådt tilbage, og inddragelsen af en leder af en dronevirksomhed havde genoplivet bekymringer om potentielle militære anvendelser af kunstig intelligens, ifølge Vox nyhedshjemmeside, som først berettede om rådets opløsning.

"Det er blevet klart, at i det nuværende miljø, ATEAC kan ikke fungere som vi ønskede, " fortalte Google til AFP.

"Så vi afslutter rådet og går tilbage til tegnebrættet."

Google tilføjede, at de ville søge alternative måder at indsamle input udefra om ansvarlig brug af kunstig intelligens.

At holde AI upartisk

En andragende offentliggjort online opfordrede Google til at fjerne Heritage Foundations Kay Coles James fra rådet, der blev dannet for en uge siden, på grund af hendes historie om at være "vokalt anti-trans, anti-LGBTQ og anti-immigrant."

"Ved valg af James, Google gør det klart, at dens version af 'etik' værdsætter nærhed til magt over transpersoners velfærd, andre LGBTQ-personer og immigranter, " læste en udtalelse postet på Medium af en gruppe, der identificerer sig selv som Googlers Against Transphobia.

Positioner udtrykt af James modsiger Googles erklærede værdier og hvis det infunderes i kunstig intelligens, kunne bygge diskrimination til supersmarte maskiner, ifølge indlægget.

Gruppen sagde, at begrundelsen for, at James blev tilføjet til panelet, er blevet givet som et forsøg på at have en mangfoldighed af tanke.

Senest torsdag d. online andragendet viste mere end 2, 300 underskrifter fra akademikere, Google-medarbejdere og andre, herunder jævnaldrende inden for teknologiindustrien.

Kontroversen kommer, mens verden kæmper med at afveje potentielle fordele ved kunstig intelligens med risici, den kan bruges mod mennesker eller endda, hvis man får et eget sind, tænde dens skabere.

Google-chef Sundar Pichai sagde i et interview offentliggjort i slutningen af sidste år, at teknologivirksomheder, der bygger AI, bør tage højde for etik tidligt i processen for at sikre, at vis kunstig intelligens med "sin egen agentur" ikke skader folk.

Den Californien-baserede internetgigant er førende inden for udvikling af kunstig intelligens, konkurrerer i smart software race med firmaer som Amazon, Æble, Facebook, IBM og Microsoft.

Sidste år, Google udgav et sæt interne AI-principper, den første er, at AI skal være socialt gavnlig.

Google lovede ikke at designe eller implementere kunstig intelligens til brug i våben, overvågning uden for internationale normer eller inden for teknologi rettet mod krænkelse af menneskerettighederne.

Virksomheden bemærkede, at den ville fortsætte med at arbejde med militæret eller regeringer inden for områder som cybersikkerhed, uddannelse, rekruttering, sundhedspleje og eftersøgning og redning.

AI bruges allerede til at genkende mennesker på billeder, filtrere uønsket indhold fra online platforme og gør det muligt for biler at køre selv.

© 2019 AFP

Varme artikler

Varme artikler

-

Theranos kollaps tilbyder tre store lektioner for virksomhederTheranos administrerende direktør Elizabeth Holmes. Kredit:Fortune Global Forum, CC BY-NC-ND Mindre end tre måneder efter at være blevet anklaget af US Securities and Exchange Commission (SEC) for

Theranos kollaps tilbyder tre store lektioner for virksomhederTheranos administrerende direktør Elizabeth Holmes. Kredit:Fortune Global Forum, CC BY-NC-ND Mindre end tre måneder efter at være blevet anklaget af US Securities and Exchange Commission (SEC) for -

Intelligent kamera registrerer automatisk vejsidebomberKredit:Eindhoven University of Technology Vejsidebomber er luskede og effektive mordere. De er nemme at fremstille og skjule, gør det til det foretrukne våben for oprørere og terrorister over hele

Intelligent kamera registrerer automatisk vejsidebomberKredit:Eindhoven University of Technology Vejsidebomber er luskede og effektive mordere. De er nemme at fremstille og skjule, gør det til det foretrukne våben for oprørere og terrorister over hele -

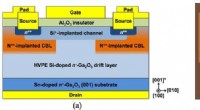

Udvikling af verdens første vertikale galliumoxidtransistor gennem ionimplantationsdopingFig. 1 (a) Skematisk tværsnit og (b) optisk mikrofotografi i planbillede af den vertikale Ga2O3 MOSFET. Kredit:National Institute of Information and Communications Technology (NICT) Forskere ved N

Udvikling af verdens første vertikale galliumoxidtransistor gennem ionimplantationsdopingFig. 1 (a) Skematisk tværsnit og (b) optisk mikrofotografi i planbillede af den vertikale Ga2O3 MOSFET. Kredit:National Institute of Information and Communications Technology (NICT) Forskere ved N -

Hurtig opladning beskadiger elbils batterierEt lithium-ion elbilbatteri, der revnede efter hurtig opladning i industristandard. Kredit:Ozkan Lab/UCR Kommercielle hurtigladestationer udsætter elbilbatterier for høje temperaturer og høj modst

Hurtig opladning beskadiger elbils batterierEt lithium-ion elbilbatteri, der revnede efter hurtig opladning i industristandard. Kredit:Ozkan Lab/UCR Kommercielle hurtigladestationer udsætter elbilbatterier for høje temperaturer og høj modst

- Ser sommerskyer på Titan

- Ny proces til konservering af tømmer kan give fordele i forhold til trykbehandling

- Forskere udvikler enzym fremstillet af landbrugsaffald til brug som vaskemiddel

- Biden for at standse leasing af fossile brændstoffer på føderalt jord

- Hvad er kolloid siliciumdioxid?

- NASA finder de stærkeste storme uden for centrum i Tropical Storm 14W