Forskere træder tilbage til mannequin viralbølge for at undersøge dybden

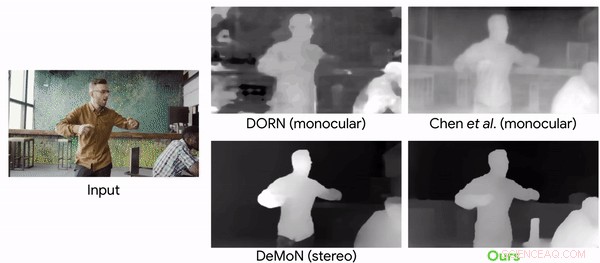

Sammenligning af dybdeforudsigelsesmodeller med et videoklip med kameraer i bevægelse og mennesker. Kredit:Google

Hvem sagde, at den virale dille kaldet Mannequin Challenge (MC) er færdig og støvet? Ikke så. Forskere har vendt sig til den udfordring, der vandt opmærksomhed i 2016 for at tjene deres mål. De brugte MC til træning af et neuralt netværk, der kan rekonstruere dybdeinformation fra videoerne.

"At lære dybderne i bevægelse ved at se frosne mennesker" er navnet på deres papir, nu op på arXiv, skrevet af Zhengqi Li, Tali Dekel, Forrester Cole, Richard Tucker, Noah Snavely, Ce Liu og William Freeman. Papiret blev indsendt i april i år.

Mannequin -udfordringen? Hvem kan glemme? Dette var en YouTube -trend gået viral. Anthony Alford i InfoQ bragte læserne tilbage til 2016, da et internet -meme fik folk i grupper til at efterligne mannequiner. De var "frosne", men en videograf ville bevæge sig rundt på scenen og tage en video fra forskellige vinkler.

Alford skrev, fordi kameraet bevæger sig, og resten af scenen er statisk, parallaksmetoder kan let rekonstruere nøjagtige dybdekort af menneskelige figurer i forskellige stillinger.

Som forfatterne sagde, videoerne involverede frysning i forskellige, naturlige stillinger, mens et håndholdt kamera turnerede på scenen.

Til træning af det neurale netværk, holdet konverterede 2, 000 af videoerne til 2-D-billeder med dybdegående data i høj opløsning.

Alford sagde, at ud af de 2, 000 YouTube MC -videoer, der blev produceret et datasæt med 4, 690 sekvenser med i alt mere end 170K gyldige billeddybdepar. Målet for læringssystemet var det kendte dybdekort for inputbilledet, beregnet ud fra MC -videoerne. DNN lærte at tage inputbilledet, indledende dybdekort, og menneskelig maske, og udsender et "raffineret" dybdekort, hvor dybdeværdierne for mennesker blev udfyldt.

Christine Fisher, Engadget :"For at træne det neurale netværk, forskerne konverterede klipene til 2-D-billeder, estimerede kamerapositionen og lavede dybdekort. AI var derefter i stand til at forudsige dybden af bevægelige objekter i videoer med større nøjagtighed end tidligere muligt. "

At tage udfordringen op blev beskrevet af to af papirets medforfattere tilbage i maj i en Google-blog.

"Fordi hele scenen er stationær (kun kameraet bevæger sig), triangulationsbaserede metoder-f.eks. multi-view-stereo (MVS)-arbejde, og vi kan få nøjagtige dybdekort til hele scenen, herunder menneskene i den. Vi samlede cirka 2000 sådanne videoer, spænder over en lang række realistiske scener med mennesker, der naturligt poserer i forskellige gruppekonfigurationer. "Tali Dekel, forsker og Forrester Cole, software ingeniør, maskinopfattelse, skrev mere om den udfordring, de tog på.

"Det menneskelige visuelle system har en bemærkelsesværdig evne til at forstå vores 3D-verden ud fra dets 2-D-projektion. Selv i komplekse miljøer med flere objekter i bevægelse, mennesker er i stand til at opretholde en gennemførlig fortolkning af objekternes geometri og dybdeordning. Datavisningsfeltet har længe undersøgt, hvordan man kan opnå lignende muligheder ved beregningsmæssigt at rekonstruere en scenes geometri ud fra 2-D billeddata, men robust genopbygning er stadig vanskelig i mange tilfælde. "

Hvorfor har dette betydning:"Selvom der for nylig er en stigning i brugen af maskinlæring til dybdeforudsigelse, dette arbejde er det første til at skræddersy en læringsbaseret tilgang til tilfælde af samtidig kamera og menneskelig bevægelse, "sagde de i majbloggen." I dette arbejde, vi fokuserer specifikt på mennesker, fordi de er et interessant mål for augmented reality og 3D-videoeffekter. "

Taler om resultater, Karen Hao, MIT Technology Review , sagde forskerne konverterede 2, 000 af videoerne til 2-D-billeder med data i høj opløsning og brugte dem til at træne et neuralt netværk. Det var derefter i stand til at forudsige dybden af bevægelige objekter i en video med meget højere nøjagtighed, end det var muligt med tidligere state-of-the-art metoder.

© 2019 Science X Network

Varme artikler

Varme artikler

-

Robotprototype vil lade dig føle, hvordan den følesRobotprototypen udtrykker sin vrede med både øjne og hud, som bliver spidse gennem væskeaktuatorer, der er oppustet under huden, baseret på dens humør. Kredit:Lindsay France I 1872, Charles Darwin

Robotprototype vil lade dig føle, hvordan den følesRobotprototypen udtrykker sin vrede med både øjne og hud, som bliver spidse gennem væskeaktuatorer, der er oppustet under huden, baseret på dens humør. Kredit:Lindsay France I 1872, Charles Darwin -

Fire anholdelser efter Taiwans første bitcoin-røveriDer stiger opfordringer til, at Bitcoin og andre kryptovalutaer skal reguleres, og priserne har svinget i de seneste måneder på grund af bekymring over skærpet kontrol Taiwans politi har anholdt f

Fire anholdelser efter Taiwans første bitcoin-røveriDer stiger opfordringer til, at Bitcoin og andre kryptovalutaer skal reguleres, og priserne har svinget i de seneste måneder på grund af bekymring over skærpet kontrol Taiwans politi har anholdt f -

Kryptovalutaer og kriminalitet:myte eller virkelighed?Bitcoins rolle i kriminalitet kan være overvurderet, siger nogle eksperter Den nylige buste af en verdensomspændende international pædofilring, der bruger Bitcoin-betalinger, fremhævede en af de

Kryptovalutaer og kriminalitet:myte eller virkelighed?Bitcoins rolle i kriminalitet kan være overvurderet, siger nogle eksperter Den nylige buste af en verdensomspændende international pædofilring, der bruger Bitcoin-betalinger, fremhævede en af de -

Høj præcision navigation til førerløse bilerDe har store planer for deres lille enhed:Lukas Meier og Zhenzhong Su. Kredit:Florian Bachmann / ETH Zürich Fixposition er en ETH-spin-off med speciale i navigationssystemer i realtid til brug i s

Høj præcision navigation til førerløse bilerDe har store planer for deres lille enhed:Lukas Meier og Zhenzhong Su. Kredit:Florian Bachmann / ETH Zürich Fixposition er en ETH-spin-off med speciale i navigationssystemer i realtid til brug i s

- Et hurtigere øje for robotteknologi til at hjælpe i vores rodede, menneskelige miljøer

- Sådan fungerer elektriske fly

- Implanterede atomer skaber unikke elektriske ID'er, der adskiller bona fide-enheder fra forfalskning…

- Hvad er molarmassen af stål?

- Klimaet i de nordamerikanske byer vil flytte hundredvis af miles på en generation

- Hvordan man identificerer Brown Recluse Spider