Facebook genererer stadig Islamisk Stat automatisk, al-Qaeda sider

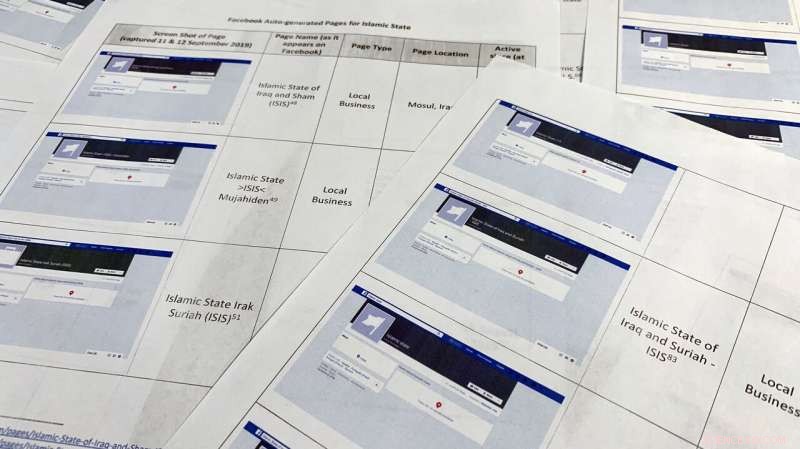

Sider fra en fortrolig whistleblower-rapport indhentet af The Associated Press, sammen med to trykte Facebook-sider, der var aktive tirsdag, 17. september, 2019, er fotograferet i Washington. Facebook kan lide at sige, at dets automatiserede systemer fjerner det store flertal af forbudt indhold, der glorificerer Islamisk Stat-gruppen og al-Qaeda, før det bliver rapporteret. Men en whistleblower-klage viser, at Facebook selv uforvarende har produceret snesevis af sider i deres navne. (AP Photo/Jon Elswick)

I lyset af kritikken af, at Facebook ikke gør nok for at bekæmpe ekstremistiske beskeder, virksomheden kan lide at sige, at dets automatiserede systemer fjerner langt størstedelen af forbudt indhold, der glorificerer Islamisk Stat-gruppen og al-Qaida, før det bliver rapporteret.

Men en whistleblower-klage viser, at Facebook selv uforvarende har givet de to ekstremistiske grupper et netværks- og rekrutteringsværktøj ved at producere snesevis af sider i deres navn.

Det sociale netværksfirma ser ud til at have gjort få fremskridt i spørgsmålet i de fire måneder, der er gået siden The Associated Press detaljerede, hvordan sider, som Facebook automatisk genererer til virksomheder, hjælper Mellemøsten-ekstremister og hvide supremacister i USA.

På onsdag, amerikanske senatorer i handelsudvalget, Videnskab, og Transportation vil udspørge repræsentanter fra sociale medievirksomheder, inklusive Monika Bickert, som leder Facebooks bestræbelser på at dæmme op for ekstremistiske beskeder.

De nye detaljer kommer fra en opdatering af en klage til Securities and Exchange Commission, som National Whistleblower Center planlægger at indgive i denne uge. Den arkivering, der er opnået af AP, identificerer næsten 200 automatisk genererede sider - nogle for virksomheder, andre for skoler eller andre kategorier – der direkte refererer til gruppen Islamisk Stat og snesevis flere, der repræsenterer al-Qaeda og andre kendte grupper. En side opført som en "politisk ideologi" har titlen "Jeg elsker islamisk stat." Den har et IS-logo inden for konturerne af Facebooks berømte tommelfinger-op-ikon.

Som svar på en anmodning om kommentar, en Facebook-talsmand sagde til AP:"Vores prioritet er at opdage og fjerne indhold postet af folk, der overtræder vores politik mod farlige individer og organisationer for at være på forkant med dårlige aktører. Autogenererede sider er ikke som normale Facebook-sider, da folk ikke kan kommentere eller post på dem, og vi fjerner alt, der overtræder vores politikker. Selvom vi ikke kan fange alle, vi er fortsat årvågne i denne indsats."

Facebook har en række funktioner, der automatisk genererer sider fra indhold, som er lagt op af brugere. Den opdaterede klage gennemgår en funktion, der er beregnet til at hjælpe virksomhedsnetværk. Det skraber beskæftigelsesoplysninger fra brugernes sider for at oprette sider til virksomheder. I dette tilfælde, det kan hjælpe de ekstremistiske grupper, fordi det giver brugerne mulighed for at like siderne, potentielt give en liste over sympatisører til rekrutterere.

Sider fra en fortrolig whistleblower-rapport indhentet af The Associated Press, er fotograferet i Washington, på tirsdag, 17. september, 2019. Facebook kan lide at sige, at dets automatiserede systemer fjerner langt størstedelen af forbudt indhold, der glorificerer Islamisk Stat-gruppen og al-Qaida, før det bliver rapporteret. Men en whistleblower-klage viser, at Facebook selv uforvarende har produceret snesevis af sider i deres navne. (AP Photo/Jon Elswick)

Den nye ansøgning viste også, at brugernes sider, der promoverer ekstremistiske grupper, forbliver lette at finde med simple søgninger, der bruger deres navne. De afslørede en side for "Mohammed Atta" med et ikonisk foto af en af al-Qaeda-tilhængerne, der var en flykaprer i angrebene den 11. september. Siden viser brugerens arbejde som "Al Qaidah" og uddannelse som "University Master Bin Laden" og "School Terrorist Afghanistan."

Facebook har arbejdet på at begrænse spredningen af ekstremistisk materiale på sin tjeneste, indtil videre med blandet succes. I marts, den udvidede sin definition af forbudt indhold til at omfatte amerikansk hvid nationalistisk og hvid separatistisk materiale samt materiale fra internationale ekstremistiske grupper. Den siger, at den har forbudt 200 hvide overherredømmeorganisationer og 26 millioner stykker indhold relateret til globale ekstremistiske grupper som IS og al-Qaida.

Den udvidede også sin definition af terrorisme til ikke kun at omfatte voldshandlinger, der var til stede for at opnå et politisk eller ideologisk mål, men også forsøg på vold, især når det er rettet mod civile med den hensigt at tvinge og skræmme. Det er uklart, selvom, hvor godt håndhævelsen fungerer, hvis virksomheden stadig har problemer med at befri sin platform for kendte ekstremistiske organisationers tilhængere.

Men som rapporten viser, masser af materiale kommer igennem sprækkerne - og bliver automatisk genereret.

AP-historien i maj fremhævede problemet med automatisk generering, men det nye indhold identificeret i rapporten tyder på, at Facebook ikke har løst det.

Rapporten siger også, at forskere fandt ud af, at mange af siderne, der refereres til i AP-rapporten, blev fjernet mere end seks uger senere den 25. dagen før Bickert blev afhørt til endnu en kongreshøring.

Problemet blev markeret i den første SEC-klage indgivet af centrets administrerende direktør, John Kostyack, der hævder, at selskabet på sociale medier har overdrevet sin succes med at bekæmpe ekstremistiske budskaber.

"Facebook vil gerne have os til at tro, at dets magiske algoritmer på en eller anden måde skrubber dets hjemmeside for ekstremistisk indhold, " sagde Kostyack. "Alligevel er de samme algoritmer autogenererende sider med titler som 'Jeg elsker Islamisk Stat,' ' som er ideelle for terrorister at bruge til netværk og rekruttering."

© 2019 The Associated Press. Alle rettigheder forbeholdes.

Varme artikler

Varme artikler

-

Verdens tyndeste, letteste signalforstærker muliggør bioinstrumentering med reduceret støjFig. 1. Elektrokardielle signaler opnået ved hjælp af fleksibel organisk differentialforstærker (A) Konventionel single-ended forstærker (B) Differentialforstærker udviklet i denne undersøgelse (C) El

Verdens tyndeste, letteste signalforstærker muliggør bioinstrumentering med reduceret støjFig. 1. Elektrokardielle signaler opnået ved hjælp af fleksibel organisk differentialforstærker (A) Konventionel single-ended forstærker (B) Differentialforstærker udviklet i denne undersøgelse (C) El -

Qantas bestiller yderligere seks Dreamliner-fly, mens jumboen bukker udBoeings 747 har været en del af Qantas-flåden siden 1971 Det australske nationale luftfartsselskab Qantas bestilte onsdag seks Dreamliner-fly fra luftfartsgiganten Boeing til at erstatte det sidst

Qantas bestiller yderligere seks Dreamliner-fly, mens jumboen bukker udBoeings 747 har været en del af Qantas-flåden siden 1971 Det australske nationale luftfartsselskab Qantas bestilte onsdag seks Dreamliner-fly fra luftfartsgiganten Boeing til at erstatte det sidst -

Slovakiet føler mest smerte fra Trump biltakster:eksperterPer indbygger, intet land producerer flere biler end Slovakiet Som verdens største bilproducent pr. indbygger, Slovakiet vil blive hårdest ramt, hvis USAs præsident Donald Trump gør op med sin tru

Slovakiet føler mest smerte fra Trump biltakster:eksperterPer indbygger, intet land producerer flere biler end Slovakiet Som verdens største bilproducent pr. indbygger, Slovakiet vil blive hårdest ramt, hvis USAs præsident Donald Trump gør op med sin tru -

At lære computerprogrammering, uden lærere og uden undervisningSoftwareingeniører er meget eftertragtede af de bedste teknologivirksomheder i Silicon Valley Aspirerende softwareingeniører Kevin Yook og Becky Chen sidder krumbøjet over en computerskærm, diskut

At lære computerprogrammering, uden lærere og uden undervisningSoftwareingeniører er meget eftertragtede af de bedste teknologivirksomheder i Silicon Valley Aspirerende softwareingeniører Kevin Yook og Becky Chen sidder krumbøjet over en computerskærm, diskut

- Hvordan virker en pneumatisk solenoidventil?

- Fleksibel isolator giver høj styrke og overlegen termisk ledning

- Eksperimenter med fransk partikelaccelerator undersøger supernovaernes egenskaber

- Geopolymerbeton:Bygning af månebaser med astronauturin og regolit

- Hvorfor er det endnu sværere at forudsige vejret og klimaet for Australiens regnfulde nordlige nabo…

- Katodefremstilling til oxid-solid-state-batterier ved stuetemperatur