Følelsesmæssig AI og gen Z:Holdningen til ny teknologi og dens bekymringer

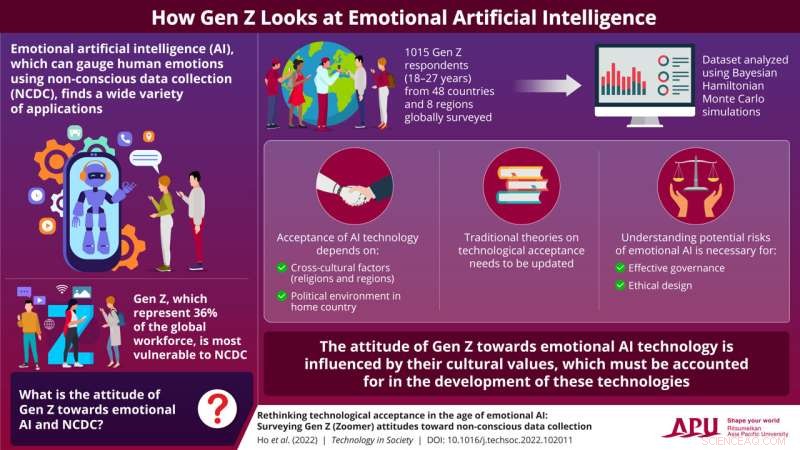

I en ny undersøgelse fremhæver forskere de sociokulturelle faktorer, der ligger til grund for bekymringen hos Gen Z-medlemmer over hele verden over for følelsesmæssig AI, og hvor acceptabelt det er for dem. Kredit:Ritsumeikan Asia Pacific University

AI har allestedsnærværende tilstedeværelse i teknologi. Alligevel havde det manglet et afgørende træk:evnen til at engagere menneskelige følelser.

Dette ændrer sig dog. Algoritmer, der kan fornemme menneskelige følelser og interagere med dem, bliver hurtigt mainstream, da de bliver indlejret i eksisterende systemer. Kendt som "emotionel AI" opnår den nye teknologi denne bedrift gennem en proces kaldet "non-conscious data collection" (NCDC), hvor algoritmen indsamler data om brugerens hjerte- og respirationsfrekvens, stemmetoner, mikro-ansigtsudtryk, bevægelser osv. for at analysere deres stemninger og tilpasse dens respons i overensstemmelse hermed.

Imidlertid har den uregulerede karakter af denne teknologi rejst mange etiske og privatlivsmæssige bekymringer. Især er det vigtigt at kende den nuværende største demografiske holdning til NCDC, nemlig Generation Z (Gen Z). Gen Z, der udgør 36 % af den globale arbejdsstyrke, vil sandsynligvis være den mest udsatte for følelsesmæssig AI. Desuden er AI-algoritmer sjældent kalibreret til sociokulturelle forskelle, hvilket gør deres implementering endnu mere bekymrende.

I en ny undersøgelse, der blev gjort tilgængelig online den 9. juni 2022 og offentliggjort i bind 70 af Technology in Society den 22. juni 2022 stræbte et team af forskere, herunder prof. Peter Mantello og prof. Nader Ghotbi fra Ritsumeikan Asia Pacific University, Japan, på at afdække de faktorer, der styrer Gen Z's reaktion på følelsesmæssig AI. "NCDC repræsenterer en ny udvikling inden for menneske-maskine-relationer og er langt mere invasive sammenlignet med tidligere AI-teknologier. I lyset af dette er der et presserende behov for bedre at forstå deres indflydelse og accept blandt Gen Z-medlemmerne," siger Prof. Mantello.

Holdet undersøgte 1.015 Gen Z-respondenter, der spænder over 48 lande og otte regioner verden over. Deltagerne blev spurgt om deres holdning til NCDC, brugt af både kommercielle og statslige aktører. De brugte derefter en Bayesiansk multilevel-analyse til at kontrollere for variabler og observere effekten af hver variabel ad gangen.

Holdet fandt, at overordnet set var mere end 50 % af de adspurgte bekymrede over brugen af NCDC. Men holdningen varierede baseret på køn, indkomst, uddannelsesniveau og religion.

"Vi fandt ud af, at det at være mand og have høj indkomst begge var korreleret med at have positive holdninger til at acceptere NCDC. Derudover var erhvervslivet mere tilbøjelige til at være mere tolerante over for NCDC," siger prof. Ghotbi. Kulturelle faktorer, såsom region og religion, viste sig også at have en indflydelse, og folk fra Sydøstasien, muslimer og kristne rapporterede bekymring over NCDC.

"Vores undersøgelse viser tydeligt, at sociokulturelle faktorer har dybt indflydelse på accepten af ny teknologi. Det betyder, at teorier baseret på Davis' traditionelle teknologiacceptmodel, som ikke tager højde for disse faktorer, skal modificeres," forklarer prof. Mantello.

Undersøgelsen adresserede dette problem ved at foreslå en "mind-svamp" modelbaseret tilgang, der tager højde for sociokulturelle faktorer i vurderingen af accepten af AI-teknologi. Derudover foreslog det også en grundig forståelse af de potentielle risici ved teknologien for at muliggøre effektiv styring og etisk design. "Offentlige opsøgende initiativer er nødvendige for at gøre befolkningen opmærksom på de etiske implikationer af NCDC. Disse initiativer skal overveje de demografiske og kulturelle forskelle for at være succesfulde," siger Dr. Nguyen.

Samlet set fremhæver undersøgelsen, i hvilket omfang følelsesmæssig AI- og NCDC-teknologier allerede er implementeret, og de afvejninger af privatlivets fred, de indebærer for den yngre generation. Der er således et presserende behov for at sikre, at disse teknologier tjener både individer og samfund godt. + Udforsk yderligere

Lassa-feber har dræbt 142 i Nigeria siden januar:officielt

Varme artikler

Varme artikler

-

Facebook sender gratis La Liga-spil på det indiske subkontinentSeere på det indiske subkontinent vil være i stand til at se gratis Barcelona FC, afbilledet her vinde den spanske Super Cup tidligere på måneden, på Facebook takket være sin aftale om at udsende La L

Facebook sender gratis La Liga-spil på det indiske subkontinentSeere på det indiske subkontinent vil være i stand til at se gratis Barcelona FC, afbilledet her vinde den spanske Super Cup tidligere på måneden, på Facebook takket være sin aftale om at udsende La L -

Samsung bringer banebrydende ultraviolet lysteknologi til DRAM-produktionKredit:Samsung Electronics Samsung Electronics annoncerede i dag, at de vil introducere de første DRAM-hukommelsesmoduler i branchen designet med banebrydende Extreme Ultraviolet Technology (EUV).

Samsung bringer banebrydende ultraviolet lysteknologi til DRAM-produktionKredit:Samsung Electronics Samsung Electronics annoncerede i dag, at de vil introducere de første DRAM-hukommelsesmoduler i branchen designet med banebrydende Extreme Ultraviolet Technology (EUV). -

Google opløser etisk komité for kunstig intelligensGoogle bekræftede, at det har opløst sit etiske panel for kunstig intelligens Google bekræftede torsdag, at det har opløst et nyligt sammensat etisk rådgivende panel for kunstig intelligens i lyse

Google opløser etisk komité for kunstig intelligensGoogle bekræftede, at det har opløst sit etiske panel for kunstig intelligens Google bekræftede torsdag, at det har opløst et nyligt sammensat etisk rådgivende panel for kunstig intelligens i lyse -

Boeing giver råd om sensorer efter nedstyrtning i IndonesienLion Air JT610 styrtede ned i Javahavet mindre end en halv time efter at have lettet fra Jakarta på en rutineflyvning til Pangkal Pinang by Boeing udsendte onsdag en særlig bulletin, der adressere

Boeing giver råd om sensorer efter nedstyrtning i IndonesienLion Air JT610 styrtede ned i Javahavet mindre end en halv time efter at have lettet fra Jakarta på en rutineflyvning til Pangkal Pinang by Boeing udsendte onsdag en særlig bulletin, der adressere

- Små materialer klar til stor indflydelse i byggeriet

- Verdens hurtigste Bose-Einstein kondensat skabt

- Magnetbølge flyder under bedre kontrol fra nu af

- Forskere forbedrer algoritmen, der beskriver de hydrologiske ændringer i Middelhavets vådområder

- Tyve års forskning i relationsvedligeholdelse:Der er brug for mere mangfoldighed

- Negative effekter af regnvejr