Hvordan folk efterforsker - eller ikke - falske nyheder på Twitter og Facebook

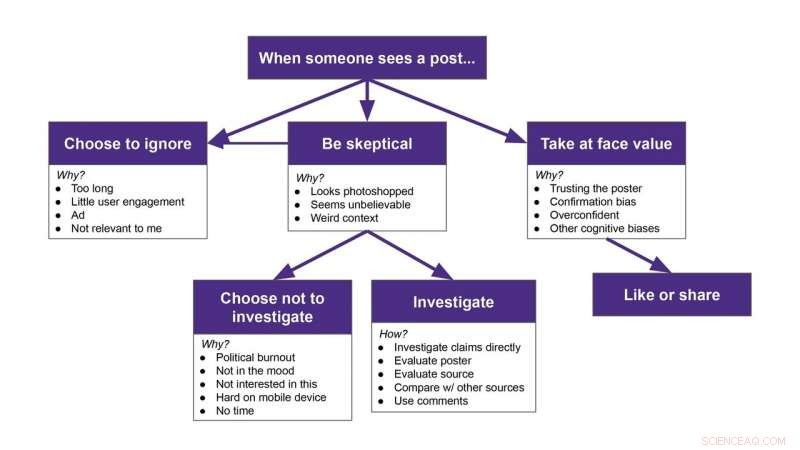

Deltagerne havde forskellige reaktioner på at støde på et falsk indlæg:Nogle ignorerede det direkte, nogle tog det for pålydende, nogle undersøgte, om det var sandt, og nogle var mistænksomme over for det, men valgte så at ignorere det. Kredit:Franziska Roesner/University of Washington

Sociale medieplatforme, såsom Facebook og Twitter, give folk en masse information, men det bliver sværere og sværere at sige, hvad der er ægte, og hvad der ikke er.

Forskere ved University of Washington ville vide, hvordan folk undersøgte potentielt mistænkelige indlæg på deres egne feeds. Holdet så 25 deltagere rulle gennem deres Facebook- eller Twitter-feeds, mens uden at de ved det, en Google Chrome-udvidelse tilføjede tilfældigt debunkeret indhold oven på nogle af de rigtige indlæg. Deltagerne havde forskellige reaktioner på at støde på et falsk indlæg:Nogle ignorerede det direkte, nogle tog det for pålydende, nogle undersøgte, om det var sandt, og nogle var mistænksomme over for det, men valgte så at ignorere det. Disse resultater er blevet accepteret til 2020 ACM CHI-konferencen om menneskelige faktorer i computersystemer.

"Vi ønskede at forstå, hvad folk gør, når de støder på falske nyheder eller misinformation i deres feeds. Lægger de mærke til det? Hvad gør de ved det?" sagde seniorforfatter Franziska Roesner, en UW-lektor ved Paul G. Allen School of Computer Science &Engineering. "Der er mange mennesker, der forsøger at være gode forbrugere af information, og de kæmper. Hvis vi kan forstå, hvad disse mennesker gør, vi kan måske designe værktøjer, der kan hjælpe dem."

Tidligere forskning i, hvordan folk interagerer med misinformation bad deltagerne om at undersøge indhold fra en forsker-oprettet konto, ikke fra nogen, de valgte at følge.

"Det kan gøre folk automatisk mistænksomme, " sagde hovedforfatter Christine Geeng, en UW doktorand i Allen School. "Vi sørgede for, at alle opslag så ud, som om de kom fra folk, som vores deltagere fulgte."

Forskerne rekrutterede deltagere i alderen 18 til 74 fra hele Seattle-området, forklarer, at holdet var interesseret i at se, hvordan folk bruger sociale medier. Deltagerne brugte Twitter eller Facebook mindst en gang om ugen og brugte ofte de sociale medieplatforme på en bærbar computer.

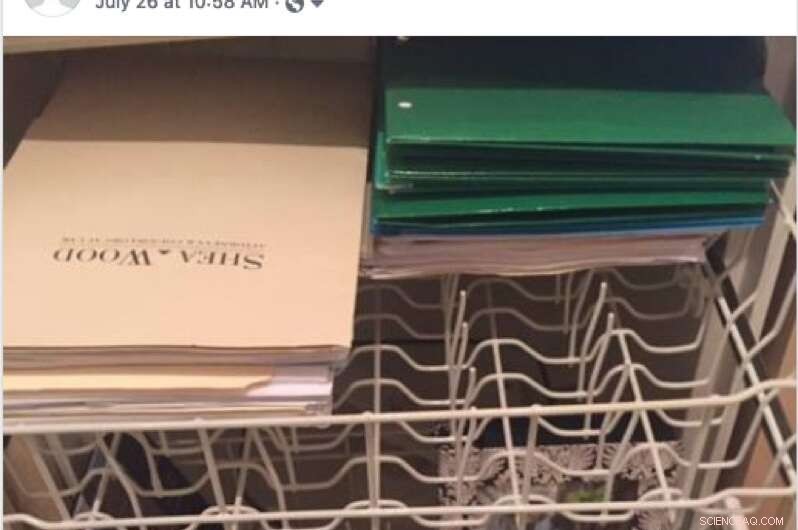

Et eksempel på et falsk opslag, som en deltager kan se på deres Facebook-feed under undersøgelsen. En deltager nævnte at springe dette indlæg over, fordi de så ordet "Florida" og besluttede, at det ikke gjaldt dem. Kredit:Geeng et al./2020 ACM CHI-konference om menneskelige faktorer i computersystemer

Derefter udviklede holdet en Chrome-udvidelse, der tilfældigt tilføjede falske opslag eller memes, som var blevet afkræftet af faktatjekhjemmesiden Snopes.com oven på rigtige opslag for at få det midlertidigt til at se ud, at de blev delt af folk på deltagernes feeds. Så i stedet for at se en fætters indlæg om en nylig ferie, en deltager ville se deres fætter dele en af de falske historier i stedet for.

Forskerne installerede enten udvidelsen på deltagerens bærbare computer, eller deltageren loggede ind på deres konti på forskerens bærbare computer, som havde udvidelsen aktiveret. Holdet fortalte deltagerne, at udvidelsen ville ændre deres feeds - forskerne sagde ikke hvordan - og ville spore deres likes og delinger under undersøgelsen - selvom, faktisk, den sporede ikke noget. Udvidelsen blev fjernet fra deltagernes bærbare computere i slutningen af undersøgelsen.

"Vi ville have dem til at rulle gennem deres feeds med udvidelsen aktiv, " sagde Geeng. "Jeg fortalte dem at tænke højt over, hvad de lavede, eller hvad de ville gøre, hvis de var i en situation uden mig i rummet. Så ville folk tale om 'Åh ja, Jeg ville læse denne artikel, ' eller 'Jeg ville springe dette over.' Nogle gange stiller jeg spørgsmål som 'Hvorfor springer du over dette? Hvorfor vil du gerne have det?'"

Deltagerne kunne faktisk ikke like eller dele de falske opslag. På Twitter, et "retweet" ville dele det rigtige indhold under det falske opslag. Den ene gang en deltager retweetede indhold under det falske opslag, forskerne hjalp dem med at fortryde det, efter undersøgelsen var slut. På Facebook, like- og del-knapperne virkede slet ikke.

Efter at deltagerne stødte på alle de falske opslag - ni for Facebook og syv for Twitter - stoppede forskerne undersøgelsen og forklarede, hvad der foregik.

"Det var ikke som vi sagde, 'Hej, der var nogle falske opslag derinde.' Vi sagde, 'Det er svært at få øje på misinformation. Her var alle de falske opslag, du lige har set. Disse var falske, og dine venner har ikke rigtig postet dem, '" sagde Geeng. "Vores mål var ikke at narre deltagere eller at få dem til at føle sig afsløret. Vi ønskede at normalisere vanskeligheden ved at afgøre, hvad der er falsk, og hvad der ikke er."

Et eksempel på et falsk opslag, som en deltager kan se på deres Facebook-feed under undersøgelsen. Kredit:Geeng et al./2020 ACM CHI-konference om menneskelige faktorer i computersystemer

Forskerne afsluttede interviewet med at bede deltagerne om at dele, hvilke typer strategier de bruger til at opdage misinformation.

Generelt, forskerne fandt ud af, at deltagerne ignorerede mange indlæg, især dem, de fandt for lange, overly political or not relevant to them.

But certain types of posts made participants skeptical. For eksempel, people noticed when a post didn't match someone's usual content. Sometimes participants investigated suspicious posts—by looking at who posted it, evaluating the content's source or reading the comments below the post—and other times, people just scrolled past them.

"I am interested in the times that people are skeptical but then choose not to investigate. Do they still incorporate it into their worldviews somehow?" Roesner said. "At the time someone might say, 'That's an ad. I'm going to ignore it.' But then later do they remember something about the content, and forget that it was from an ad they skipped? That's something we're trying to study more now."

While this study was small, it does provide a framework for how people react to misinformation on social media, sagde holdet. Now researchers can use this as a starting point to seek interventions to help people resist misinformation in their feeds.

"Participants had these strong models of what their feeds and the people in their social network were normally like. They noticed when it was weird. And that surprised me a little, " Roesner said. "It's easy to say we need to build these social media platforms so that people don't get confused by fake posts. But I think there are opportunities for designers to incorporate people and their understanding of their own networks to design better social media platforms."

Varme artikler

Varme artikler

-

Hvad hvis Jorden ændrede sin bane?Hvis Jordens bane bevægede sig tættere på solen, vi ville alle brænde. Hvis den flyttede længere væk, vi ville alle fryse. Godt, at vi er på det søde sted. Loops7/Getty Images Planeten, vi lever på,

Hvad hvis Jorden ændrede sin bane?Hvis Jordens bane bevægede sig tættere på solen, vi ville alle brænde. Hvis den flyttede længere væk, vi ville alle fryse. Godt, at vi er på det søde sted. Loops7/Getty Images Planeten, vi lever på, -

De unikke forhold for mennesker, der bor i deres køretøjerDenne informationsfolder er et af en række opsøgende materialer til sociale tjenester skabt gennem et samarbejde med Pruss af UW Professor Karen Chengs designstuderende på UW School of Art + Art Histo

De unikke forhold for mennesker, der bor i deres køretøjerDenne informationsfolder er et af en række opsøgende materialer til sociale tjenester skabt gennem et samarbejde med Pruss af UW Professor Karen Chengs designstuderende på UW School of Art + Art Histo -

Data afslører det store billede af det franske præsidentvalg i 2017:Sociale medier, falske nyheder…Politoskop-skærm, der viser Twitter-konti, der kommenterede Penelopegate-skandalen. Jo rødere en konto, jo flere tweets postede den om dette emne. Kredit:CNRS / ISC-PIF--Chavalarias D, Gaumont N, Pana

Data afslører det store billede af det franske præsidentvalg i 2017:Sociale medier, falske nyheder…Politoskop-skærm, der viser Twitter-konti, der kommenterede Penelopegate-skandalen. Jo rødere en konto, jo flere tweets postede den om dette emne. Kredit:CNRS / ISC-PIF--Chavalarias D, Gaumont N, Pana -

Forbedrer tidlig adgang til pensionsmidler helbredet?Kredit:CC0 Public Domain I en nylig undersøgelse fra Singapore, tidlig adgang til pensionsformue var forbundet med forbedret helbredstilstand. Resultaterne er offentliggjort i Økonomisk undersøge

Forbedrer tidlig adgang til pensionsmidler helbredet?Kredit:CC0 Public Domain I en nylig undersøgelse fra Singapore, tidlig adgang til pensionsformue var forbundet med forbedret helbredstilstand. Resultaterne er offentliggjort i Økonomisk undersøge

- Instrumentet kan muliggøre mail-in test til at detektere tungmetaller i vand

- Kinas ZTE dykker 39% ved genoptagelse af handelen i Hong Kong

- Første højpræcisionsmåling af massen af W boson ved LHC

- Moral demonstreret i historier kan ændre dømmekraft for tidlige teenagere

- Geologer producerer en ny tidslinje for Jordens paleozoiske klimaændringer

- Realistisk ny model peger på vejen til mere effektiv og rentabel fracking