Identificering af dybe netværksgenererede billeder ved hjælp af forskelle i farvekomponenter

Eksempel på billede af ægte ansigt fra datasæt leveret af papir “Progressiv vækst af GAN’er for forbedret kvalitet, Stabilitet, og variation ”. Kredit:Karras et al.

Forskere ved Shenzhen University har for nylig udtænkt en metode til at detektere billeder genereret af dybe neurale netværk. Deres undersøgelse, forududgivet på arXiv, identificerede et sæt funktioner til at fange farvebilledstatistikker, der kan registrere billeder genereret ved hjælp af nuværende kunstige intelligensværktøjer.

"Vores forskning var inspireret af den hurtige udvikling af billedgenerative modeller og spredningen af genererede falske billeder, "Bin Li, en af forskerne, der gennemførte undersøgelsen, fortalt Tech Xplore . "Med fremkomsten af avancerede billedgenerative modeller, såsom generative adversarial netværk (GAN) og varianter af autoencoders, billeder genereret af dybe netværk bliver mere og mere fotorealistiske, og det er ikke længere let at identificere dem med menneskelige øjne, hvilket medfører alvorlige sikkerhedsrisici. "

For nylig, flere forskere og globale medieplatforme har udtrykt deres bekymring over risikoen ved kunstige neurale netværk, der er uddannet til at generere billeder. For eksempel, dybe læringsalgoritmer som generative adversarial netværk (GAN) og variationer autoencoders kunne bruges til at generere realistiske billeder og videoer til falske nyheder eller kunne lette onlinesvindel og forfalskning af personlige oplysninger på sociale medier.

GAN -algoritmer er uddannet til at generere stadig mere realistiske billeder gennem en prøve- og fejlproces, hvor en algoritme genererer billeder og en anden, diskriminatoren, giver feedback for at gøre disse billeder mere realistiske. Hypotetisk, denne diskriminator kan også trænes til at opdage falske billeder fra rigtige. Imidlertid, disse algoritmer bruger primært RGB -billeder som input og overvejer ikke forskelle i farvekomponenter, derfor ville deres ydeevne sandsynligvis være utilfredsstillende.

Eksempel på genereret ansigtsbillede fra datasæt leveret af papir “Progressiv vækst af GAN’er for forbedret kvalitet, Stabilitet, og variation ”. Kredit:Karras et al.

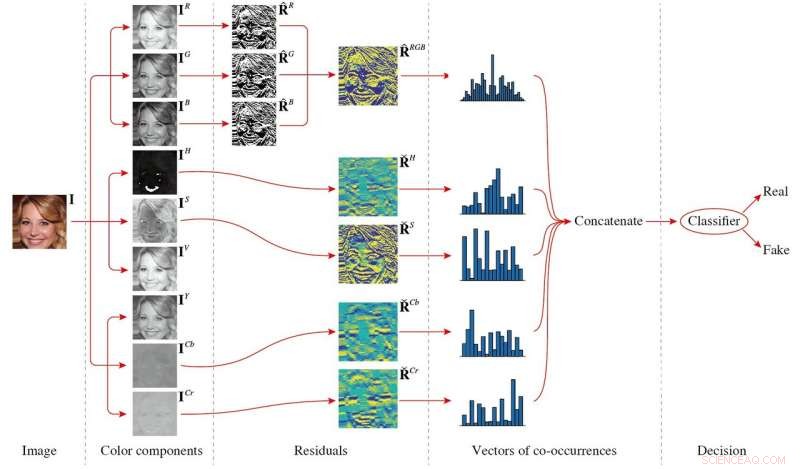

I deres undersøgelse, Li og hans kolleger analyserede forskellene mellem billeder genereret af GAN og rigtige billeder, foreslår et sæt funktioner, der effektivt kan hjælpe med at klassificere dem. Den resulterende metode fungerer ved at analysere forskelle i farvekomponenter mellem sande og genererede billeder.

"Vores grundtanke er, at generationens pipelines af rigtige billeder og genererede billeder er ganske forskellige, så de to klasser af billeder skal have nogle forskellige egenskaber, "Haodong Li, forklarede en af forskerne. "Faktisk, de kommer fra forskellige rørledninger. For eksempel, virkelige billeder genereres af billeddannelsesenheder såsom kameraer og scannere til at fange en rigtig scene, mens genererede billeder skabes på en helt anden måde med konvolvering, forbindelse, og aktivering fra neurale netværk. Forskellene kan resultere i forskellige statistiske egenskaber. I dette studie, vi overvejede hovedsageligt de statistiske egenskaber ved farvekomponenter. "

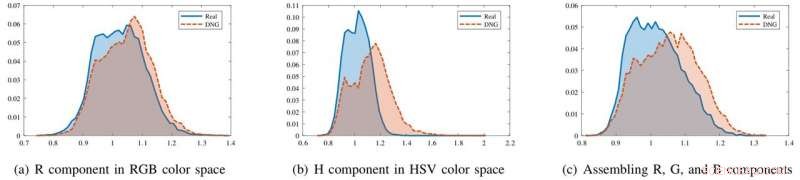

Forskerne fandt ud af, at selvom genererede billeder og rigtige billeder ligner hinanden i RGB -farverummet, de har markant forskellige statistiske egenskaber i chrominanskomponenterne i HSV og YCbCr. De observerede også forskelle ved montering af R, G, og B -farvekomponenter sammen.

Funktionssæt, de foreslog, som består af co-forekomstmatricer ekstraheret fra billedets højpasfiltreringsrester af flere farvekomponenter, udnytter disse forskelle, fange farveforskelle mellem virkelige og genererede billeder. Dette funktionssæt er af lav dimension og kan fungere godt, selv når det trænes på et lille billedsæt.

Histogrammerne for billedstatistikker for rigtige billeder (blå) og dybe netværksgenererede (DNG) billeder (røde) i forskellige farvekomponenter. I R -komponenten, de to histogrammer overlapper stort set. Imidlertid, i H -komponenten eller ved at samle R, G, B -komponenter sammen, histogrammerne er mere adskilelige. Kredit:Li et al.

Li og hans kolleger testede udførelsen af deres metode på tre billeddatasæt:CelebFaces Attributes, CelebA i høj kvalitet, og Mærkede ansigter i naturen. Deres resultater var meget lovende, med et sæt funktioner, der fungerer godt på alle tre datasæt.

"Det mest meningsfulde fund i vores undersøgelse er, at billeder, der genereres af dybe netværk, let kan detekteres ved at udtrække funktioner fra visse farvekomponenter, selvom de genererede billeder muligvis ikke kan skelnes visuelt med menneskelige øjne, "Sagde Haodong Li." Når der er tilgængelige billedprøver eller generative modeller, de foreslåede funktioner udstyret med en binær klassifikator kan effektivt skelne mellem genererede billeder og rigtige billeder. Når de generative modeller er ukendte, de foreslåede funktioner sammen med en klassiker i én klasse kan også opnå tilfredsstillende ydeevne. "

Undersøgelsen kan have en række praktiske konsekvenser. Først, metoden kan hjælpe med at identificere falske billeder online.

Den overordnede ramme for den foreslåede metode. Inputbilledet nedbrydes først i forskellige farvekomponenter, og derefter beregnes resten af hver farvekomponent. For at beregne co-forekomster, R, G, og B -komponenter er samlet, mens H, S, Cb, og Cr -komponenter behandles uafhængigt. Endelig, all the co-occurrence vectors are concatenated and fed to a classifier for obtaining the decision result. Credit:Li et al.

Their findings also imply that several inherent color properties of real images have not yet been effectively replicated by existing generative models. I fremtiden, this knowledge could be used to build new models that generate even more realistic images.

Endelig, their study proves that different generation pipelines used to produce real images and generated images are reflected in the properties of the images produced. Color components comprise merely one of the ways in which these two types of images differ, so further studies could focus on other properties.

"In future, we plan to improve the image generation performance by applying the findings of this research to image generative models, " Jiwu Huang, one of the researchers said. "For eksempel, including the disparity metrics of color components for real and generated images into the objective function of a GAN model could produce more realistic images. We will also try to leverage other inherent information from the real image generation pipeline, such as sensor pattern noises or properties of color filter array, to develop more effective and robust methods for identifying generated images."

© 2018 Tech Xplore

Varme artikler

Varme artikler

-

Ansigtsgenkendelse gør subtile fremskridt i StorbritannienKritikere har advaret om, at ansigtsgenkendelsesteknologi risikerer at underminere menneskerettighederne Eksperimentet blev udført diskret. Mellem 2016 og 2018, to overvågningskameraer blev instal

Ansigtsgenkendelse gør subtile fremskridt i StorbritannienKritikere har advaret om, at ansigtsgenkendelsesteknologi risikerer at underminere menneskerettighederne Eksperimentet blev udført diskret. Mellem 2016 og 2018, to overvågningskameraer blev instal -

Hvad er augmented reality, alligevel?Er det Pikachu på gaden lige ved siden af dig? Kredit:Marc Bruxelle/Shutterstock.com Augmented reality-systemer viser virtuelle objekter i den virkelige verden - som katteører og knurhår på en S

Hvad er augmented reality, alligevel?Er det Pikachu på gaden lige ved siden af dig? Kredit:Marc Bruxelle/Shutterstock.com Augmented reality-systemer viser virtuelle objekter i den virkelige verden - som katteører og knurhår på en S -

Perfekte mønstre bane vej til hurtigere, billigere MRKredit:University of Queensland En opdagelse fra en University of Queensland -forsker kan fremskynde MR -scanningstider og gøre scanningerne mere overkommelige. Dr Shekhar Chandra fra UQs School

Perfekte mønstre bane vej til hurtigere, billigere MRKredit:University of Queensland En opdagelse fra en University of Queensland -forsker kan fremskynde MR -scanningstider og gøre scanningerne mere overkommelige. Dr Shekhar Chandra fra UQs School -

Hvad er det ekstra i min online kurv? Snart, måske en momsI denne 14. dec. 2017, fil foto, pakker rejser på et transportbånd til sortering på hovedpostkontoret i Omaha, Neb. stater vil være i stand til at tvinge kunder til at betale moms, når de foretager on

Hvad er det ekstra i min online kurv? Snart, måske en momsI denne 14. dec. 2017, fil foto, pakker rejser på et transportbånd til sortering på hovedpostkontoret i Omaha, Neb. stater vil være i stand til at tvinge kunder til at betale moms, når de foretager on

- Hvilken slags hjorte er der i Texas?

- Forskere undersøger affaldsdisk i et nærliggende planetsystem

- Kina forbyder udenlandsk affald - men hvad sker der med verdens genbrug?

- Indledende motivation er en nøglefaktor for læring i massive åbne onlinekurser

- Forskere udvikler teknik til at omdanne termoelektrisk materiale til højtydende elektricitet

- De vigtigste dele af en robot