Ud over dybe forfalskninger:Forvandling af videoindhold til en anden videostil, automatisk

Forskere ved Carnegie Mellon University har udtænkt en måde til automatisk at omdanne indholdet af en video til en andens stil, gør det muligt at overføre en persons ansigtsudtryk til en anden persons video, eller endda en tegneseriefigur. Kredit:Carnegie Mellon University

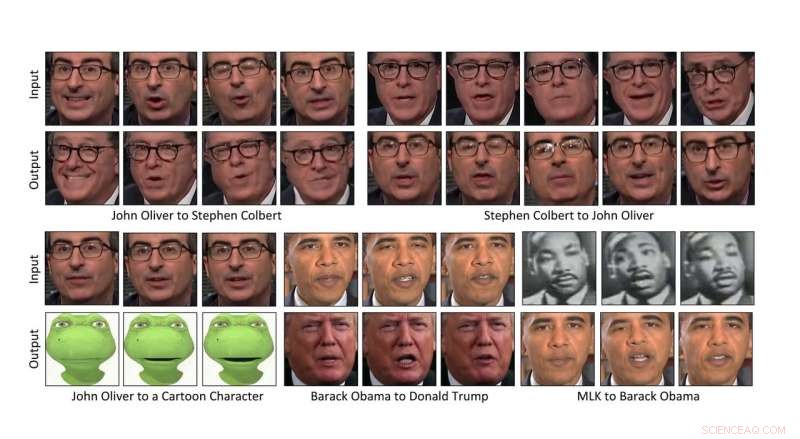

Forskere ved Carnegie Mellon University har udtænkt en måde til automatisk at omdanne indholdet af en video til en andens stil, gør det muligt at overføre komikerens John Olivers ansigtsudtryk til en tegneseriefigurs ansigtsudtryk, eller at få en påskelilje til at blomstre på nogenlunde samme måde som en hibiscus ville.

Fordi den datadrevne metode ikke kræver menneskelig indgriben, det kan hurtigt transformere store mængder video, gør det til en velsignelse for filmproduktion. Det kan også bruges til at konvertere sort-hvid-film til farve og til at skabe indhold til virtual reality-oplevelser.

"Jeg tror, der er mange historier at fortælle, " sagde Aayush Bansal, en ph.d. studerende i CMU's Robotics Institute. Filmproduktion var hans primære motivation for at hjælpe med at udtænke metoden, forklarede han, gør det muligt at producere film hurtigere og billigere. "Det er et værktøj for kunstneren, der giver dem en indledende model, som de derefter kan forbedre, " han tilføjede.

Teknologien har også potentiale til at blive brugt til såkaldte "dybe forfalskninger, "videoer, hvor en persons billede er indsat uden tilladelse, få det til at se ud som om personen har gjort eller sagt ting, der er ude af karakter, Bansal anerkendt.

"Det var en øjenåbner for os alle i feltet, at sådanne forfalskninger ville blive skabt og have en sådan indflydelse, " sagde han. "At finde måder at opdage dem på vil være vigtigt fremadrettet."

Bansal vil præsentere metoden i dag på ECCV 2018, den europæiske konference om computersyn, i München. Hans medforfattere inkluderer Deva Ramanan, CMU lektor i robotteknologi.

Overførsel af indhold fra en video til en andens stil afhænger af kunstig intelligens. I særdeleshed, en klasse af algoritmer kaldet generative adversarial networks (GAN'er) har gjort det lettere for computere at forstå, hvordan man anvender et billedes stil på et andet, især når de ikke er blevet nøje afstemt.

I en GAN, to modeller er skabt:en diskriminator, der lærer at opdage, hvad der stemmer overens med stilen på et billede eller en video, og en generator, der lærer at skabe billeder eller videoer, der matcher en bestemt stil. Når de to arbejder konkurrerende – generatoren forsøger at narre diskriminatoren og diskriminatoren scorer effektiviteten af generatoren – lærer systemet til sidst, hvordan indhold kan transformeres til en bestemt stil.

En variant, kaldet cyklus-GAN, fuldender løkken, meget som at oversætte engelsk tale til spansk og derefter spansk tilbage til engelsk og derefter vurdere, om den to gange oversatte tale stadig giver mening. Brug af cycle-GAN til at analysere billeders rumlige karakteristika har vist sig effektiv til at transformere et billede til et andet billedes stil.

Den rumlige metode lader stadig noget tilbage at ønske for video, med uønskede artefakter og ufuldkommenheder, der dukker op i den fulde cyklus af oversættelser. For at afhjælpe problemet, forskerne udviklede en teknik, kaldet Recycle-GAN, der omfatter ikke kun rumlige, men tidsmæssige oplysninger. Denne yderligere information, tage højde for ændringer over tid, begrænser processen yderligere og giver bedre resultater.

Forskerne viste, at Recycle-GAN kan bruges til at omdanne video af Oliver til, hvad der ser ud til at være medkomiker Stephen Colbert og tilbage til Oliver. Eller video af John Olivers ansigt kan forvandles til en tegneseriefigur. Recycle-GAN tillader ikke kun at kopiere ansigtsudtryk, men også forestillingens bevægelser og kadence.

Effekterne er ikke begrænset til ansigter, eller endda kroppe. Forskerne viste, at video af en blomstrende blomst kan bruges til at manipulere billedet af andre typer blomster. Eller skyer, der krydser himlen hurtigt på en blæsende dag, kan bremses for at give et mere roligt vejr.

Sådanne effekter kan være nyttige til at udvikle selvkørende biler, der kan navigere om natten eller i dårligt vejr, sagde Bansal. Det kan være svært at få video af nattescener eller stormvejr, hvor genstande kan identificeres og mærkes. forklarede han. Genbrug-GAN, på den anden side, kan forvandle let opnåede og mærkede dagscener til natlige eller stormfulde scener, at levere billeder, der kan bruges til at træne biler til at fungere under disse forhold.

Varme artikler

Varme artikler

-

Biokonstruktion:Ud over hampbetonKredit:Paolo Ronchetti En af de almindelige overbevisninger om biokonstruktion er, at det kun er for rige mennesker. Ifølge Mike Lawrence, Professor ved BRE CICM (Center for Innovative Constructio

Biokonstruktion:Ud over hampbetonKredit:Paolo Ronchetti En af de almindelige overbevisninger om biokonstruktion er, at det kun er for rige mennesker. Ifølge Mike Lawrence, Professor ved BRE CICM (Center for Innovative Constructio -

5 måder at hjælpe robotter med at arbejde sammen med menneskerAt få mest muligt ud af menneske-robot-samarbejder vil kræve godt teamwork. Kredit:WeStudio/Shutterstock.com For de fleste mennesker i dag, robotter og smarte systemer er tjenere, der arbejder i b

5 måder at hjælpe robotter med at arbejde sammen med menneskerAt få mest muligt ud af menneske-robot-samarbejder vil kræve godt teamwork. Kredit:WeStudio/Shutterstock.com For de fleste mennesker i dag, robotter og smarte systemer er tjenere, der arbejder i b -

Apple-kreditkortet er herI denne 25. marts, 2019, fil foto, Jennifer Bailey, vicepræsident for Apple Pay, taler om Apple Card i Steve Jobs Theatre under en begivenhed for at annoncere nye produkter i Cupertino, Californien De

Apple-kreditkortet er herI denne 25. marts, 2019, fil foto, Jennifer Bailey, vicepræsident for Apple Pay, taler om Apple Card i Steve Jobs Theatre under en begivenhed for at annoncere nye produkter i Cupertino, Californien De -

Twitter:1 million konti suspenderet for fremme af terrorismeTwitter siger, at mere end en million konti er blevet suspenderet siden 2015 for fremme af terrorisme Twitter sagde torsdag, at det har suspenderet over en million konti for fremme af terrorisme s

Twitter:1 million konti suspenderet for fremme af terrorismeTwitter siger, at mere end en million konti er blevet suspenderet siden 2015 for fremme af terrorisme Twitter sagde torsdag, at det har suspenderet over en million konti for fremme af terrorisme s

- Er fødevarer fremstillet ved hjælp af bioteknologi sikre at spise?

- Tredimensionelt kulstof bliver metallisk

- Bi-efterlignende clearwing-møl brummer tilbage til livet efter 130 år

- Xiaomi søger at rejse op til $6 milliarder i Hong Kong IPO

- Nyt hybridmateriale kan inspirere til meget effektive næste generations skærme

- Kunstige cilia ansporer til nytænkning inden for nanoteknologi