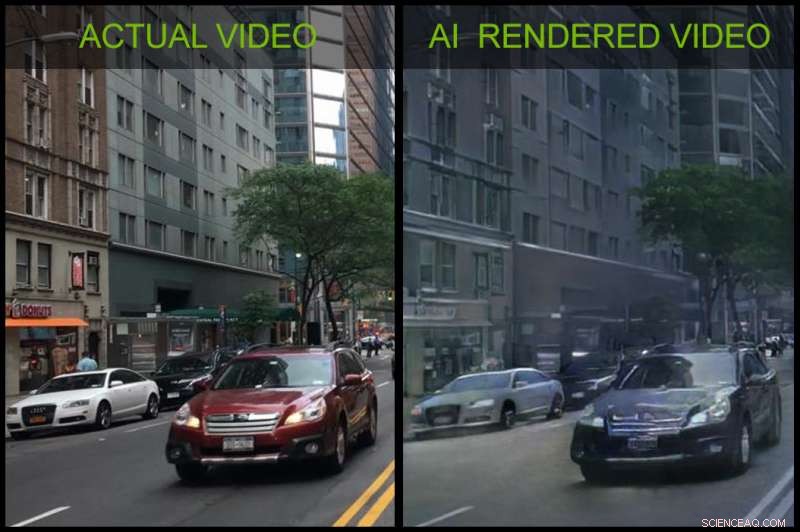

AI fik dem til at gøre det:Nvidia udforsker hvad hvis det er at træne en model til at tegne nye verdener

Kredit:Nvidia

Her er en ordstreng, du kan overveje:AI interaktiv grafik. Nvidia er hovedakten. GPU-brainiacs er fuldt ud bag et næste kapitel, "AI, " for den grafiske industri. Der sker fantastiske ting, når du bringer et neuralt netværkssystem til bordet for virtuelle verdener baseret på videooptagelser.

At skabe en naturtro digital scene kræver normalt masser (og masser) af tålmodighed. "Nu kan vi bare overføre arbejdet til en AI-algoritme, " sagde Will Knight, i sit kig på, hvad Nvidia arbejder på, i MIT Technology Review .

Nvidia annoncerer, hvad det sagde, var den første interaktive AI-gengivne virtuelle verden, og kaldte det et "AI-gennembrud." Holdet af forskere blev ledet af Bryan Catanzaro, vicepræsident, anvendt dyb læring. "Vi lærer faktisk modellen, hvordan man tegner baseret på ægte video, " sagde han ind MIT Technology Review .

Rammerne er gengivet af AI-teknologi, sagde forsker, Ting-Chun Wang. Med andre ord, holdet har trænet et neuralt netværk til at gengive 3D-miljøer efter at være blevet trænet i eksisterende videoer.

Gennembrud starter med nogens spørgsmål. Hos Nvidia, hvad hvis spørgsmålet var, hvad nu hvis vi kunne træne en AI-model til at tegne nye verdener bare baseret på video fra den virkelige verden? Så, det er nu en færdig handel inden for teknologi, der viser en sådan billedgenerering.

Målrettede brugere er udviklere og kunstnere. Ideen er, at de skal skabe interaktive 3D virtuelle verdener til bilindustrien, spil eller virtual reality.

Videoer af byer til at gengive bymiljø blev udvalgt, hvorpå de trænede det neurale netværk.

"Vi fik køresekvenser af forskellige byer, " sagde Ting-Chun Wang. Så brugte de et andet segmenteringsnetværk, at udtrække semantikken på højt niveau, han sagde, fra disse sekvenser.

UE4-motoren hjalp med at generere de farvelagte layouts - forskellige objekter fik forskellige farver. Netværket konverterer til gengæld repræsentationen til billeder.

[UE4 refererer til Unreal Engine 4. Randen beskrev det som "en populær motor brugt til titler som Fortnite, PUBG, Gears of War 4, og mange andre." Unreal Engine 4-webstedet sagde, at det er "en komplet pakke af spiludviklingsværktøjer lavet af spiludviklere, for spiludviklere."]

Nvidia har vist sine fremskridt på NeurIPS-konferencen i Montreal, Canada, et show med fokus på AI-forskning.

Ja, men, andet end gee-whiz-faktoren, hvad er pointen? Indholdsoprettelse er dyrt, og denne AI-rute sparer penge og sparer tid. Nyt Atlas gjorde den observation, at "For at få virtuelle verdener til at føles mere fordybende, kunstnere skal fylde dem med bygninger, sten, træer, og andre genstande. At skabe og placere alle disse virtuelle objekter giver hurtigt ret høj udviklingstid og -omkostninger."

Til spiludvikling eller andre applikationer, Nvidia udforskede en metode, der ville give udviklere mulighed for at skabe til en lavere pris, ved at bruge AI, der lærer af den virkelige verden. Nyhedsmeddelelsen påpegede, at da output er syntetisk genereret, "en scene kan nemt redigeres for at fjerne, modificere, eller tilføje objekter."

James Vincent ind Randen gik læserne gennem Nvidias forskningsindsats:

"Problemet er, hvis deep learning-algoritmerne genererer grafikken for verden med en hastighed på 25 billeder i sekundet, hvordan holder de objekter til at se ens ud? Catanzaro siger, at dette problem betød, at de første resultater af systemet var 'smerteligt at se på', da farver og teksturer 'ændrede hver frame'. Holdet gav systemet korttidshukommelse, og så det kunne sammenligne en ny ramme med det, der er gået før. Som sådan, det skaber nye rammer, der stemmer overens med det, der er på skærmen.

Nvidias pressemeddelelse sagde, at "denne forskning er på et tidligt stadium."

© 2018 Science X Network

Sidste artikelStorySign app konverterer tekst i børnebøger til tegnsprog

Næste artikelGoogles robot-spinoff lancerer ride-hailing-tjeneste

Varme artikler

Varme artikler

-

Samsung til støberi-event taler om 3nm, MBCFET udviklingKredit:Samsung Nanometerprocessen omhandler rummet mellem transistorerne monteret på et substrat på nanometerniveau, sagde Puls . Jo smallere afstanden er, jo flere chips kan presses ind for a

Samsung til støberi-event taler om 3nm, MBCFET udviklingKredit:Samsung Nanometerprocessen omhandler rummet mellem transistorerne monteret på et substrat på nanometerniveau, sagde Puls . Jo smallere afstanden er, jo flere chips kan presses ind for a -

Ny elektrolyt standser hurtig nedgang i ydeevnen af næste generations lithiumbatteriOpladning resulterer i dobbelt- eller tredobbelt ladede metalkationer, såsom Mg2+ (orange kugler), sammen med enkeltladede lithiumioner (grønne kugler), der co-indsættes fra elektrolytten i silicium (

Ny elektrolyt standser hurtig nedgang i ydeevnen af næste generations lithiumbatteriOpladning resulterer i dobbelt- eller tredobbelt ladede metalkationer, såsom Mg2+ (orange kugler), sammen med enkeltladede lithiumioner (grønne kugler), der co-indsættes fra elektrolytten i silicium ( -

Engineering team udvikler skibsværft på et skibNebraskas Yongfeng Lu (til venstre) og ph.d.-studerende Lei Liu med en bærbar laser, der hjælper med at forhindre og reparere korrosion på aluminiumsidede skibe. Kredit:Alyssa Amen | NUtech Ventures

Engineering team udvikler skibsværft på et skibNebraskas Yongfeng Lu (til venstre) og ph.d.-studerende Lei Liu med en bærbar laser, der hjælper med at forhindre og reparere korrosion på aluminiumsidede skibe. Kredit:Alyssa Amen | NUtech Ventures -

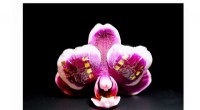

Hurtig, fleksible ioniske transistorer til bioelektroniske enhederIGT-baserede NAND- og NOR-porte er i overensstemmelse med overfladen af orkidéblade (til venstre). Skala bar, 1 cm. Optiske mikrografer af NOR (øverst til højre) og NAND (nederst til højre) logiske

Hurtig, fleksible ioniske transistorer til bioelektroniske enhederIGT-baserede NAND- og NOR-porte er i overensstemmelse med overfladen af orkidéblade (til venstre). Skala bar, 1 cm. Optiske mikrografer af NOR (øverst til højre) og NAND (nederst til højre) logiske

- Sådan forstår du en af Stephen Hawkings afsluttende papirer - ifølge en ekspert

- De første menneskelige forfædre ammede i længere tid end nutidige slægtninge

- Sådan fungerer genbanker

- Til rummet og videre!

- Eksempler på vindpollinerede blomster

- Australske dyr står over for udryddelsestrussel, da antallet af skovbrande stiger