3 nedbrud, 3 dødsfald rejser spørgsmål om Teslas Autopilot

I denne 8. juli, 2018, fil foto, skyer afspejles over virksomhedens logo på motorhjelmen på et Tesla -køretøj uden for et showroom i Littleton, Colo. National Highway Traffic Safety Administration efterforsker styrtet af en hastende Tesla, der dræbte to mennesker i en forstad i Los Angeles, meddelte agenturet tirsdag, 31. december kl. 2019. (AP Photo/David Zalubowski, Fil)

Tre nedbrud med Teslas, der dræbte tre mennesker, har øget undersøgelsen af virksomhedens Autopilot-kørselssystem bare måneder, før administrerende direktør Elon Musk har planlagt at sætte fuldt selvkørende biler på gaden.

På søndag, en Tesla Model S sedan forlod en motorvej i Gardena, Californien, ved høj hastighed, løb et rødt lys og ramte en Honda Civic, dræber to mennesker indeni, sagde politiet.

Samme dag, en Tesla Model 3 ramte en parkeret brandbil på en motorvej i Indiana, dræbe en passager i Tesla.

Og den 7. december, endnu en Model 3 ramte en politicruiser på en motorvej i Connecticut, selvom ingen kom til skade.

Den særlige kollisionsundersøgelsesenhed i National Highway Traffic Safety Administration kigger på ulykken i Californien. Agenturet har ikke besluttet, om dets specialuheldsenhed vil gennemgå styrtet, der fandt sted søndag nær Terre Haute, Indiana. I begge tilfælde, myndighederne mangler endnu at afgøre, om Teslas autopilotsystem blev brugt.

NHTSA undersøger også sammenbruddet i Connecticut, hvor føreren fortalte politiet, at bilen kørte på Autopilot, et Tesla -system designet til at holde en bil i sin vognbane og i sikker afstand fra andre køretøjer. Autopilot kan også skifte spor alene.

Tesla har gentagne gange sagt, at dets autopilotsystem kun er designet til at hjælpe chauffører, der stadig skal være opmærksom og være klar til at gribe ind hele tiden. Virksomheden hævder, at Teslas med Autopilot er sikrere end køretøjer uden den, men advarer om, at systemet ikke forhindrer alle nedbrud.

Ikke desto mindre, eksperter og sikkerhedsforkæmpere siger, at en række Tesla -nedbrud rejser alvorlige spørgsmål om, hvorvidt chaufførerne er blevet for afhængige af Teslas teknologi, og om virksomheden gør nok for at sikre, at chaufførerne bliver ved med at være opmærksomme. Nogle kritikere har sagt, at det er for længst tid for NHTSA at stoppe med at undersøge og handle, såsom at tvinge Tesla til at sikre, at bilister er opmærksomme, når systemet bruges.

NHTSA har startet undersøgelser af 13 Tesla -nedbrud fra mindst 2016, hvor agenturet mener, at Autopilot kørte. Agenturet har endnu ikke udstedt nogen regler, selvom den studerer, hvordan den skal evaluere lignende "avancerede driverassistent" -systemer.

"På et tidspunkt, spørgsmålet bliver:Hvor mange beviser er nødvendige for at afgøre, at den måde, denne teknologi bruges på, er usikker? "sagde Jason Levine, administrerende direktør for nonprofit Center for Auto Safety i Washington. "I dette tilfælde, forhåbentlig vil disse tragedier ikke være forgæves og føre til noget mere end en undersøgelse foretaget af NHTSA. "

Levine og andre har opfordret agenturet til at kræve, at Tesla begrænser brugen af Autopilot til hovedsageligt firefelts opdelte motorveje uden krydstrafik. De vil også have, at Tesla installerer et bedre system til at overvåge drivere for at sikre, at de hele tiden er opmærksomme. Teslas system kræver, at bilister placerer deres hænder på rattet. Men føderale efterforskere har fundet ud af, at dette system lader chaufførerne zone for længe.

Tesla planlægger at bruge de samme kameraer og radarsensorer, dog med en mere kraftfuld computer, i sine selvkørende biler. Kritikere sætter spørgsmålstegn ved, om disse biler vil være i stand til selv at køre sikkert uden at bringe andre bilister i fare.

Tvivl om Teslas autopilotsystem har længe været ved. I september, National Transportation Safety Board, som undersøger transportulykker, udsendte en rapport om, at en designfejl i Autopilot og førerens uopmærksomhed kombineret til at få en Tesla Model S til at smække ind i en brandbil, der parkerede langs en motorvej i Los Angeles-området i januar 2018. Bestyrelsen fastslog, at føreren var alt for afhængig af systemet og at Autopilots design lod ham frigøre sig fra at køre for længe.

Ud over dødsfaldene søndag aften, tre amerikanske dødsulykker siden 2016 - to i Florida og et i Silicon Valley - involverede køretøjer, der brugte Autopilot.

David Friedman, vicepræsident for advokatvirksomhed for forbrugerrapporter og en tidligere fungerende NHTSA -administrator, sagde, at agenturet burde have erklæret Autopilot defekt og søgt tilbagekaldelse efter et uheld i 2016 i Florida, der dræbte en chauffør. Hverken Teslas system eller føreren havde bremset, før bilen kørte under en sættevogn, der havde drejet foran bilen.

"Vi har ikke brug for, at flere mennesker kommer til skade for, at vi ved, at der er et problem, og at Tesla og NHTSA ikke har klaret det. "Sagde Friedman.

Ud over NHTSA, stater kan regulere autonome køretøjer, selvom mange har besluttet, at de vil opmuntre til test.

I 2016 -styrtet, NHTSA afsluttede sin undersøgelse uden at søge om tilbagekaldelse. Friedman, der ikke var på NHTSA på det tidspunkt, sagde agenturet fastslået, at problemet ikke skete ofte. Men han sagde, at argumentet siden er blevet afkræftet.

Friedman sagde, at det er forudseeligt, at nogle bilister ikke vil være opmærksomme på vejen, mens de bruger Autopilot, så systemet er defekt.

"Offentligheden skylder en eller anden forklaring på den manglende handling, "sagde han." Bare ved at sige, at de fortsætter med at undersøge - den linje har slidt dens anvendelighed og dens troværdighed ud. "

I en erklæring, NHTSA sagde, at det er afhængigt af data for at træffe beslutninger, og hvis det konstaterer, at et køretøj udgør en urimelig sikkerhedsrisiko, "agenturet vil ikke tøve med at handle." NHTSA har også sagt, at det ikke ønsker at stå i vejen for teknologien i betragtning af sit livreddende potentiale.

Meddelelser blev efterladt torsdag og søgte kommentarer fra Tesla.

Raj Rajkumar, en professor i elektroteknik og computerteknik ved Carnegie Mellon University, sagde, at det er sandsynligt, at Tesla i søndagens ulykke i Californien kørte på Autopilot, som tidligere er blevet forvirret af banelinjer. Han spekulerede i, at banelinjen var mere synlig for afkørselsrampen, så bilen tog rampen, fordi den lignede en motorvejsbane. Han foreslog også, at chaufføren muligvis ikke var meget opmærksom.

"Intet normalt menneske ville ikke bremse i en udgangsbane, " han sagde.

I april, Musk sagde, at han forventede at begynde at konvertere virksomhedens elbiler til fuldstændigt selvkørende køretøjer i 2020 for at oprette et netværk af robot-taxaer for at konkurrere mod Uber og andre ridehail-tjenester.

På det tidspunkt, eksperter sagde, at teknologien ikke er klar, og at Teslas kamera og radarsensorer ikke var gode nok til et selvkørende system. Rajkumar og andre siger, at yderligere nedbrud har vist, at det er sandt.

Mange eksperter siger, at de ikke er klar over dødsulykker med lignende førerassistentsystemer fra General Motors, Mercedes og andre bilproducenter. GM overvåger chauffører med kameraer og lukker køresystemet ned, hvis de ikke ser vejen.

"Tesla er ikke i nærheden af den standard, " han sagde.

Han forudsagde flere dødsfald, der involverede Teslas, hvis NHTSA undlader at handle.

"Det er meget ærgerligt, sagde han. "Bare tragisk."

© 2020 Associated Press. Alle rettigheder forbeholdes.

Varme artikler

Varme artikler

-

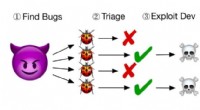

En ny defensiv teknik kunne afholde angribere ved at gøre software buggiereForenklet angriber-arbejdsgang. Angribere finder fejl, triage dem for at bestemme udnyttelsesevne, derefter udvikle udnyttelser og implementere dem til deres mål. Kreditering:Hu, Hu &Dolan-Gavitt.

En ny defensiv teknik kunne afholde angribere ved at gøre software buggiereForenklet angriber-arbejdsgang. Angribere finder fejl, triage dem for at bestemme udnyttelsesevne, derefter udvikle udnyttelser og implementere dem til deres mål. Kreditering:Hu, Hu &Dolan-Gavitt. -

Effektiv omkostningseffektiv køleløsning til højtydende chipsMulti-jet køler. Kredit:IMEC Imec, verdens førende forsknings- og innovationshub inden for nanoelektronik og digital teknologi, annonceret i dag, at det for første gang har demonstreret en billig

Effektiv omkostningseffektiv køleløsning til højtydende chipsMulti-jet køler. Kredit:IMEC Imec, verdens førende forsknings- og innovationshub inden for nanoelektronik og digital teknologi, annonceret i dag, at det for første gang har demonstreret en billig -

Google forbyder politiske annoncer i Singapore, da valget truerDet demokratiske parti i Singapore siger, at Google afslog deres anmodning om at købe annoncer på webstedet Google har forbudt politiske annoncer i Singapore forud for valget, sagde et oppositions

Google forbyder politiske annoncer i Singapore, da valget truerDet demokratiske parti i Singapore siger, at Google afslog deres anmodning om at købe annoncer på webstedet Google har forbudt politiske annoncer i Singapore forud for valget, sagde et oppositions -

Indien efterlyser WhatApp -reformer efter lynchingerIndien har øget presset på WhatsApp for at kontrollere spredningen af falske nyheder, skylden for lynchinger i hele landet Indien opfordrede tirsdag WhatsApp til at stramme op om falske nyheder

Indien efterlyser WhatApp -reformer efter lynchingerIndien har øget presset på WhatsApp for at kontrollere spredningen af falske nyheder, skylden for lynchinger i hele landet Indien opfordrede tirsdag WhatsApp til at stramme op om falske nyheder

- Fremstilling af natrium-ion-batterier, der holder

- Forskere øger lithium-svovlbatteriets levetid med en faktor 10

- Hvordan svamp manipulerer frugtfluer til at hoste sporer og frigive dem

- Energi er et grundlæggende behov, og mange amerikanere kæmper for at få råd til det i COVID-19 r…

- Copernicus Sentinel-1 viser det største delta i Arktis

- Forskere løfter sløret for en ny metode til at opdage lungekræft