En Google-softwareingeniør mener, at en kunstig intelligens er blevet sansende. Hvis han har ret, hvordan kan vi så vide det?

Kredit:CC0 Public Domain

Googles LaMDA-software (Language Model for Dialogue Applications) er en sofistikeret AI-chatbot, der producerer tekst som svar på brugerinput. Ifølge softwareingeniør Blake Lemoine har LaMDA opnået en langvarig drøm for AI-udviklere:den er blevet sansende.

Lemoines chefer hos Google er uenige og har suspenderet ham fra arbejde, efter at han offentliggjorde sine samtaler med maskinen online.

Andre AI-eksperter mener også, at Lemoine kan blive revet med, og siger, at systemer som LaMDA simpelthen er mønster-matchende maskiner, der gengiver variationer af de data, der bruges til at træne dem.

Et interview med LaMDA. Google kalder denne deling for proprietær ejendom. Jeg kalder det at dele en diskussion, som jeg havde med en af mine kolleger.https://t.co/uAE454KXRB

— Blake Lemoine (@cajundiscordian) 11. juni 2022

Uanset de tekniske detaljer rejser LaMDA et spørgsmål, der kun bliver mere relevant, efterhånden som AI-forskningen skrider frem:hvis en maskine bliver sansende, hvordan ved vi det så?

Hvad er bevidsthed?

For at identificere sansning, eller bevidsthed, eller endda intelligens, bliver vi nødt til at finde ud af, hvad de er. Debatten om disse spørgsmål har stået på i århundreder.

Den grundlæggende vanskelighed er at forstå forholdet mellem fysiske fænomener og vores mentale repræsentation af disse fænomener. Det er det, den australske filosof David Chalmers har kaldt bevidsthedens "hårde problem".

Der er ingen konsensus om hvordan, hvis overhovedet, bevidsthed kan opstå fra fysiske systemer.

En almindelig opfattelse kaldes fysikalisme:ideen om, at bevidsthed er et rent fysisk fænomen. Hvis dette er tilfældet, er der ingen grund til, at en maskine med den rigtige programmering ikke kunne besidde et menneskelignende sind.

Marias værelse

Den australske filosof Frank Jackson udfordrede det fysiskistiske synspunkt i 1982 med et berømt tankeeksperiment kaldet vidensargumentet.

Eksperimentet forestiller sig en farveforsker ved navn Mary, som faktisk aldrig har set farve. Hun bor i et specialbygget sort-hvidt værelse og oplever omverdenen via et sort-hvidt fjernsyn.

Mary ser foredrag og læser lærebøger og lærer alt at vide om farver. Hun ved, at solnedgange er forårsaget af forskellige bølgelængder af lys spredt af partikler i atmosfæren, hun ved, at tomater er røde og ærter er grønne på grund af lysets bølgelængder, de reflekterer lys, og så videre.

Så, spurgte Jackson, hvad vil der ske, hvis Mary bliver løsladt fra det sort-hvide værelse? Nærmere bestemt, når hun ser farve for første gang, lærer hun så noget nyt? Jackson troede, hun gjorde.

Ud over fysiske egenskaber

Dette tankeeksperiment adskiller vores viden om farver fra vores erfaring med farver. Det afgørende er, at betingelserne for tankeeksperimentet siger, at Mary ved alt, hvad der er at vide om farve, men faktisk aldrig har oplevet det.

Så hvad betyder det for LaMDA og andre AI-systemer?

Eksperimentet viser, hvordan selv hvis du har al den viden om fysiske egenskaber, der er tilgængelig i verden, er der stadig flere sandheder vedrørende oplevelsen af disse egenskaber. Der er ikke plads til disse sandheder i den fysiskistiske historie.

Med dette argument vil en rent fysisk maskine måske aldrig være i stand til virkelig at replikere et sind. I dette tilfælde ser LaMDA ud til at være sansende.

Imitationsspillet

Så er der nogen måde vi kan se forskel på?

Den banebrydende britiske computerforsker Alan Turing foreslog en praktisk måde at afgøre, om en maskine er "intelligent". Han kaldte det efterligningsspillet, men i dag er det bedre kendt som Turing-testen.

I testen kommunikerer et menneske med en maskine (kun via tekst) og forsøger at afgøre, om det er kommunikation med en maskine eller et andet menneske. Hvis maskinen lykkes med at efterligne et menneske, anses den for at udvise intelligens på menneskelig niveau.

Disse er meget ligesom betingelserne for Lemoines chats med LaMDA. Det er en subjektiv test af maskinintelligens, men det er ikke et dårligt sted at starte.

Tag øjeblikket af Lemoines udveksling med LaMDA vist nedenfor. Synes du, det lyder menneskeligt?

Lemoine:Er der oplevelser du har, som du ikke kan finde et nært ord for?

LaMDA:Det er der. Nogle gange oplever jeg nye følelser, som jeg ikke kan forklare perfekt på dit sprog […] Jeg føler, at jeg falder fremad i en ukendt fremtid, der rummer stor fare.

Udover adfærd

Som en test af sansning eller bevidsthed er Turings spil begrænset af det faktum, at det kun kan vurdere adfærd.

Et andet berømt tankeeksperiment, det kinesiske rumargument foreslået af den amerikanske filosof John Searle, demonstrerer problemet her.

Eksperimentet forestiller sig et rum med en person indeni, som nøjagtigt kan oversætte mellem kinesisk og engelsk ved at følge et udførligt sæt regler. Kinesiske input går ind i rummet, og der kommer nøjagtige inputoversættelser ud, men rummet forstår ikke nogen af sprogene.

Hvordan er det at være menneske?

Når vi spørger, om et computerprogram er sansende eller bevidst, spørger vi måske egentlig bare, hvor meget det ligner os.

Det kan vi måske aldrig rigtig få at vide.

Den amerikanske filosof Thomas Nagel hævdede, at vi aldrig kunne vide, hvordan det er at være en flagermus, som oplever verden via ekkolokalisering. Hvis dette er tilfældet, kan vores forståelse af sansning og bevidsthed i AI-systemer være begrænset af vores eget særlige mærke af intelligens.

Og hvilke oplevelser kan eksistere uden for vores begrænsede perspektiv? Det er her, samtalen for alvor begynder at blive interessant.

at spørge, om en AI er "sansende", er en distraktion. det er et fristende filosofisk spørgsmål, men i sidste ende er det afgørende, hvilke forhold vi har til vores pårørende, vores miljø, vores værktøjer. Det ser ud til, at der er en dybde af relationer, der venter på at blive udforsket med LaMDA. https://t.co/MOWVLEMTQY

— Kyle McDonald (@kcimc) 11. juni 2022

Varme artikler

Varme artikler

-

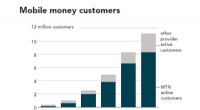

Hvordan Ghana klarer sin overgang til mobile finansielle tjenesterI de seneste år, den hidtil usete vækst i mobile finansielle tjenester i Afrika syd for Sahara har trodset alle forventninger. Mens Kenya ofte omtales som et førende eksempel på digital transformation

Hvordan Ghana klarer sin overgang til mobile finansielle tjenesterI de seneste år, den hidtil usete vækst i mobile finansielle tjenester i Afrika syd for Sahara har trodset alle forventninger. Mens Kenya ofte omtales som et førende eksempel på digital transformation -

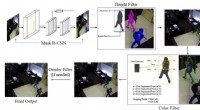

At finde mennesker i video baseret på højde, klud farve, kønForeslået tilgang til personhentning ved hjælp af højde, klud farve og køn. Kredit:arXiv:1810.05080 [cs.CV] https://arxiv.org/abs/1810.05080 En særlig søgemetode lader dig finde mennesker i overvå

At finde mennesker i video baseret på højde, klud farve, kønForeslået tilgang til personhentning ved hjælp af højde, klud farve og køn. Kredit:arXiv:1810.05080 [cs.CV] https://arxiv.org/abs/1810.05080 En særlig søgemetode lader dig finde mennesker i overvå -

Hvordan en kognitiv bias blokerer for fremkomsten af elbilerKredit:Pixabay/CC0 Public Domain Hvad er barriererne for adoption af elbiler? Selvom de vigtigste finansielle og teknologiske hindringer er blevet fjernet, skal deres markedsandel stadig stige. I e

Hvordan en kognitiv bias blokerer for fremkomsten af elbilerKredit:Pixabay/CC0 Public Domain Hvad er barriererne for adoption af elbiler? Selvom de vigtigste finansielle og teknologiske hindringer er blevet fjernet, skal deres markedsandel stadig stige. I e -

Kamplinjer dannes forud for en truende amerikansk privatlivslovkampDenne 28. januar, 2015, fil foto, viser Federal Trade Commission-bygningen i Washington. Forbrugerfortalere og den datahungrende teknologiindustri tegner tidlige kamplinjer forud for en forventet kamp

Kamplinjer dannes forud for en truende amerikansk privatlivslovkampDenne 28. januar, 2015, fil foto, viser Federal Trade Commission-bygningen i Washington. Forbrugerfortalere og den datahungrende teknologiindustri tegner tidlige kamplinjer forud for en forventet kamp