Nyt billeddannelsessystem skaber billeder ved at måle tid

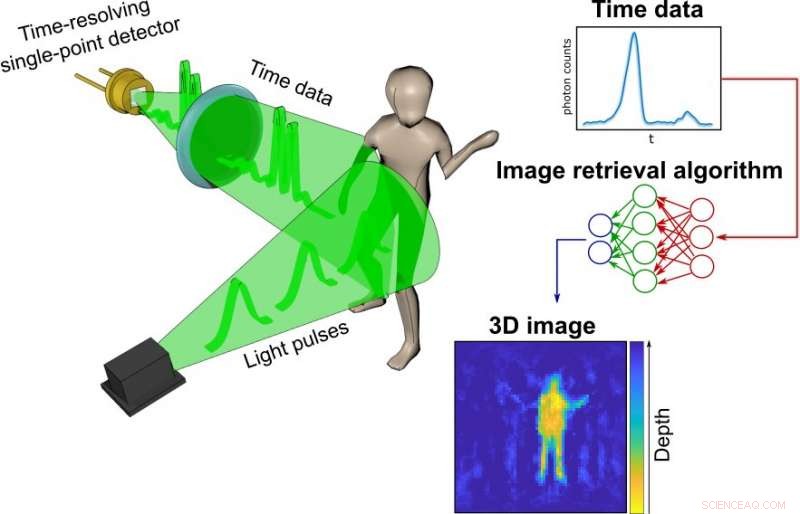

Kredit:University of Glasgow

En radikal ny billeddannelsesmetode, der udnytter kunstig intelligens til at gøre tid til visioner om 3D-rum, kan hjælpe biler, mobile enheder og sundhedsmonitorer udvikler 360-graders bevidsthed.

Fotos og videoer produceres normalt ved at fange fotoner - lysets byggesten - med digitale sensorer. For eksempel, digitale kameraer består af millioner af pixels, der danner billeder ved at detektere lysets intensitet og farve på hvert sted i rummet. 3D-billeder kan derefter genereres enten ved at placere to eller flere kameraer rundt om motivet for at fotografere det fra flere vinkler, eller ved at bruge strømme af fotoner til at scanne scenen og rekonstruere den i tre dimensioner. På den ene eller anden måde, et billede er kun bygget ved at indsamle rumlige oplysninger om scenen.

I et nyt papir offentliggjort i dag i tidsskriftet Optica , forskere baseret i Storbritannien, Italien og Holland beskriver en helt ny måde at lave animerede 3D-billeder på:ved at fange tidsmæssige oplysninger om fotoner i stedet for deres rumlige koordinater.

Deres proces begynder med en enkel, billig enkeltpunktsdetektor indstillet til at fungere som en slags stopur for fotoner. I modsætning til kameraer, måling af den rumlige fordeling af farve og intensitet, detektoren registrerer kun, hvor lang tid det tager de foton, der produceres af en split-sekunders puls af laserlys, at hoppe af hvert objekt i en given scene og nå sensoren. Jo længere væk et objekt er, jo længere tid det tager hver reflekteret foton at nå sensoren.

Oplysningerne om timerne for hver foton reflekteret i scenen - hvad forskerne kalder de tidsmæssige data - er samlet i en meget enkel graf.

Disse grafer omdannes derefter til et 3D-billede ved hjælp af en sofistikeret neural netværksalgoritme. Forskerne trænede algoritmen ved at vise den tusindvis af konventionelle fotos af teamet, der bevæger sig og bærer objekter rundt i laboratoriet, sammen med tidsmæssige data fanget af enkeltpunktsdetektoren på samme tid.

Til sidst, netværket havde lært nok om, hvordan de tidsmæssige data svarede til billederne, at det var i stand til at skabe meget præcise billeder udelukkende af de tidsmæssige data. I princippet om principeksperimenter, teamet formåede at konstruere bevægelige billeder med cirka 10 billeder i sekundet ud fra de tidsmæssige data, selvom den anvendte hardware og algoritme har potentiale til at producere tusindvis af billeder i sekundet.

Dr. Alex Turpin, Lord Kelvin Adam Smith Fellow i Data Science ved University of Glasgow's School of Computing Science, ledet universitetets forskerhold sammen med prof. Daniele Faccio, med støtte fra kolleger ved Polytechnic University of Milan og Delft University of Technology.

Dr. Turpin sagde:"Kameraer i vores mobiltelefoner danner et billede ved at bruge millioner af pixels. At oprette billeder med en enkelt pixel alene er umuligt, hvis vi kun overvejer rumlige oplysninger, som en-punkts detektor har ingen. Imidlertid, sådan en detektor kan stadig give værdifuld information om tid. Det er lykkedes os at finde en ny måde at omdanne endimensionelle data-en simpel måling af tid-til et bevægeligt billede, der repræsenterer de tre dimensioner af rummet i en given scene. Den vigtigste måde, der adskiller sig fra konventionel billedfremstilling, er, at vores tilgang er i stand til helt at afbryde lys fra processen. Selvom meget af papiret diskuterer, hvordan vi har brugt pulserende laserlys til at indsamle tidsmæssige data fra vores scener, det viser også, hvordan vi har formået at bruge radarbølger til samme formål. Vi er overbeviste om, at metoden kan tilpasses ethvert system, der er i stand til at undersøge en scene med korte impulser og præcist måle returekkoet. Dette er egentlig bare starten på en helt ny måde at visualisere verden ved hjælp af tid i stedet for lys. "

I øjeblikket, neurale netets evne til at skabe billeder er begrænset til, hvad det er blevet trænet til at udvælge fra de tidsmæssige data fra scener, som forskerne har skabt. Imidlertid, med videre uddannelse og endda ved at bruge mere avancerede algoritmer, det kunne lære at visualisere en varieret række scener, udvide sine potentielle applikationer i virkelige situationer.

Dr. Turpin tilføjede:"Enkeltpunktsdetektorerne, der indsamler de tidsmæssige data, er små, let og billigt, hvilket betyder, at de let kan føjes til eksisterende systemer som kameraer i autonome køretøjer for at øge nøjagtigheden og hastigheden af deres vejsøgning. Alternativt kan de kunne forstærke eksisterende sensorer i mobile enheder som Google Pixel 4, som allerede har et simpelt gest-genkendelsessystem baseret på radarteknologi. Fremtidige generationer af vores teknologi kan endda bruges til at overvåge stigningen og faldet af en patients bryst på hospitalet for at advare personalet om ændringer i deres vejrtrækning, eller at holde styr på deres bevægelser for at sikre deres sikkerhed på en datakompatibel måde. Vi er meget begejstrede for potentialet i det system, vi har udviklet, og vi glæder os til at fortsætte med at undersøge dets potentiale. Vores næste trin er at arbejde på en selvstændig, bærbart system-in-a-box, og vi er ivrige efter at begynde at undersøge vores muligheder for at fremme vores forskning med input fra kommercielle partnere. "

Holdets papir, med titlen "Rumlige billeder fra tidsmæssige data, "udgives i Optica .

Sidste artikelLangvarig spænding i standardmodellen adresseret

Næste artikelKosmisk tango mellem de helt små og de meget store

Varme artikler

Varme artikler

-

Kvantecomputernes mysteriumKredit:Sabrina Maniscalco Vores computere, selv de hurtigste, synes ude af stand til at modstå behovene i den enorme mængde data, der produceres i vores teknologiske samfund. Derfor arbejder forsk

Kvantecomputernes mysteriumKredit:Sabrina Maniscalco Vores computere, selv de hurtigste, synes ude af stand til at modstå behovene i den enorme mængde data, der produceres i vores teknologiske samfund. Derfor arbejder forsk -

En fjernbetjening til alt det lilleIntensitetsfordeling af et elektrisk bølgefelt, der anvender et veldefineret drejningsmoment på det kvadratiske mål. Kredit:TU Wien Atomer, molekyler eller endda levende celler kan manipuleres med

En fjernbetjening til alt det lilleIntensitetsfordeling af et elektrisk bølgefelt, der anvender et veldefineret drejningsmoment på det kvadratiske mål. Kredit:TU Wien Atomer, molekyler eller endda levende celler kan manipuleres med -

Hvordan kvanteprikker kan tale med hinandenTo kvanteprikker kommunikerer med hinanden ved at udveksle lys. Kredit:HZB Såkaldte kvanteprikker er en ny klasse af materialer med mange anvendelsesmuligheder. Kvanteprikker realiseres af små hal

Hvordan kvanteprikker kan tale med hinandenTo kvanteprikker kommunikerer med hinanden ved at udveksle lys. Kredit:HZB Såkaldte kvanteprikker er en ny klasse af materialer med mange anvendelsesmuligheder. Kvanteprikker realiseres af små hal -

Halvvejs mod LHC -konsolideringTo medlemmer af LHC -konsolideringsteamet inspicerer og rengør en diodeindkapsling af dipolmagneterne, inden de forbedrer den elektriske isolation. Kredit:Maximilien Brice og Julien Ordan/CERN Lar

Halvvejs mod LHC -konsolideringTo medlemmer af LHC -konsolideringsteamet inspicerer og rengør en diodeindkapsling af dipolmagneterne, inden de forbedrer den elektriske isolation. Kredit:Maximilien Brice og Julien Ordan/CERN Lar

- Russisk fly i dødelig brand fandt få kunder på verdensplan

- Gemme IoT fra botnets

- FTSE 100 kvindelige direktører betalte 73 % mindre end mænd:undersøgelse

- Grønlandske huler:Tidsrejse til et varmt Arktis

- Canadisk politik for virksomheders emissioner oversættes til højere markedsværdi

- Heliummangel! Hvad hvis vi løb tør for helium?