En tilgang til sikring af lydklassificering mod modstridende angreb

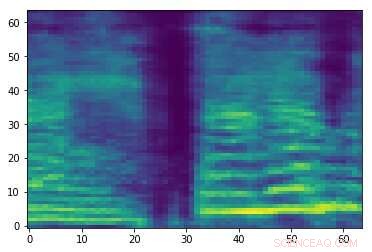

Spektrogram af et tilfældigt lydsignal. Kredit:Emailpour, Kardinal og Lemeiras Koerich.

Modstridende lydangreb er små forstyrrelser, som ikke kan opfattes af mennesker, og som med vilje tilføjes til lydsignaler for at forringe ydeevnen af maskinlæringsmodeller (ML). Disse angreb giver anledning til alvorlige bekymringer om sikkerheden af ML-modeller, da de kan få dem til at begå fejl og i sidste ende generere forkerte forudsigelser.

Forskere ved École de Technologie Supérieure, en del af University of Quebec i Canada har for nylig udviklet en ny tilgang, der kan hjælpe med at sikre lydklassificeringsværktøjer mod modstridende angreb. I deres papir, forudgivet på arXiv, de gennemgår nogle af de stærkeste eksisterende modstridende angreb og deres indvirkning på ydelsen af almindelige ML-modeller, derefter foreslå en tilgang, der kunne modvirke disse angreb.

"I øjeblikket, der er mange stærke og hurtige (ved runtime) klassifikatorer med hensyn til nøjagtighed, nemlig deep learning-klassifikatorer (f.eks. konvolutionelle neurale netværk), som endda kan overgå det menneskelige niveau af medier (f.eks. tale, billede, video, animation, tekst, osv.) genkendelse og regression, "Mohammad Esmaeilpour, en af de forskere, der har udført undersøgelsen, fortalte TechXplore. "Akilleshælen i disse avancerede algoritmer er deres sårbarhed over for input, der indeholder omhyggeligt udformede forstyrrelser, kendt som modstridende angreb."

Modstridende angreb virker ved at producere prøver, der ligner legitime træningsprøver, men det fører faktisk til, at en eller flere ML-modeller genererer forkerte etiketter med høje konfidensniveauer. I ML-forskning, hvis der er nok data til at træne en klassifikator, den vigtigste udfordring er ikke længere at forbedre dens genkendelsesnøjagtighed, men sikre dens modstandsdygtighed mod modstridende angreb.

"Modstridige angreb er aktive trusler for alle datadrevne algoritmer, selv dem, der er trænet i små datasæt, " sagde Esmaeilpour. "Dette vakte vores interesse for at studere truslen om modstridende angreb til lyd- og talegenkendelsesapplikationer, da alle smartphones nu er udstyret med en virtuel taleassistent som Siri, Google Assistant og Cortana."

I deres undersøgelse, Esmaeilpour og hans kolleger udførte eksperimenter, der involverede miljømæssige lyddatasæt, snarere end taledatasæt. Ikke desto mindre, i fremtiden kan deres tilgang også potentielt udvides til talegenkendelse, som ville hjælpe med at sikre stemmeassistenter mod modstridende angreb.

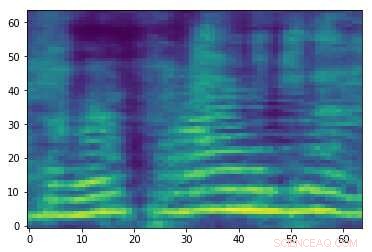

Lavet modstridende spektrogram forbundet med lydsignalet i det første billede. Selvom de to billeder ligner hinanden, de har forskellige mærker, tyder på, at et angreb finder sted. Kredit:Emailpour, Kardinal og Lemeiras Koerich.

"Vores hovedformål i dette papir var at studere truslen om modstridende angreb for både konventionelle og deep learning lydklassifikatorer og ideelt set foreslå en mere pålidelig algoritme med hensyn til modstandsdygtighed over for nogle almindelige angreb som en baseline mod ægte robust lydklassificering, " Esmaeilpour forklarede. "Vi ønskede at skabe en rimelig balance for klassifikatorer i genkendelsesnøjagtighed, beregningsmæssig kompleksitet, og robusthed mod modstridende angreb."

Generelt, klassifikatorer, der er mere robuste over for modstridende angreb, opnår lavere genkendelsesnøjagtighed, og omvendt. I deres undersøgelse, forskerne fokuserede på modstandsdygtig omskoling, en af de mest gyldige eksisterende forsvarsteknikker, der ikke slører gradientinformation. På trods af dets fordele, denne særlige forsvarsstrategi er dyr (da stærke angreb er dyre, modstridende genoptræning ved hjælp af disse angreb vil være dyrere) og kan påvirke en klassifikators genkendelsespræstation negativt.

"Det ideelle tilfælde for os ville være at foreslå en gradient sløringsfri og modstridende genoptræningsfri lydklassificering, som i sagens natur lærer 'robuste funktioner', " sagde Esmaeilpour. "Vores klassificeringsscenarie omfatter flere trin, hovedsagelig spektrogram (2D-repræsentation for lydsignaler) forbedring, dimensionalitetsreduktion ved hjælp af en algebraisk nedbrydningsteknik, og udjævning ved at bruge en foldningsde-noising autoencoder, hvor de sidste to trin (stablet sammen) har vist positive virkninger på at fjerne små ukendte potentielle modstridende forstyrrelser."

Efter at have gennemgået nogle af de stærkeste modstridende angreb derude og deres virkninger på ML-modellernes ydeevne, forskerne udtog funktioner fra de spektrogrammer, der blev behandlet af modellerne, organiserede dem i en kodebog og trænede en støttevektormaskine (SVM) algoritme på denne kodebog. I deres træningspipeline, de implementerede ingen proaktive eller reaktive teknikker til detektering af modstridende angreb eller forsvarsalgoritmer.

"Vores hovedmål var at 'lære robuste funktionsvektorer' uden nogen form for præ- eller efterbehandlingsoverhead til at detektere potentielle modstridende prøver, " Esmaeilpour forklarede. "Vores resultater viser, at vores foreslåede klassifikator udkonkurrerer state-of-the-art dyb læring og konventionelle algoritmer over for fem typer stærke modstridende angreb for nogle praktiske miljømæssige lyddatasæt."

Esmaeilpour og hans kolleger påviste statistisk sårbarheden af både konventionelle klassifikatorer (dvs. klassifikatorer, der lærer fra feature space) og deep learning algoritmer (dvs. algoritmer, der lærer af rå data) over for modstridende angreb. Ifølge forskerne, der er i øjeblikket ingen pålidelig datadrevet algoritme til lydklassificering, der også er robust over for modstridende angreb. Blandt eksisterende modeller, deep-learning-baserede tilgange ser ud til at være de mindst sikre mod disse angreb, selvom de typisk opnår den højeste genkendelsesnøjagtighed.

"Klassificeringsscenariet, vi foreslog i vores papir, bruger en SVM med polynomiel kerne som en endelig klassifikator, " sagde Esmaeilpour. "Men, Anvendelse af en foldningsde-støjdæmpende autoencoder oven på singular værdinedbrydning efterfulgt af en uovervåget klynge af udtrukne fremskyndede robuste funktionsvektorer kunne hjælpe med at lære flere strukturelle komponenter og sandsynligvis robuste funktioner, som kunne give os mulighed for at opnå en rimelig balance mellem genkendelsesnøjagtighed (sammenlignelig med state-of-the-art ydeevne) og robusthed mod fem almindelige stærke modstridende angreb."

Selvom resultaterne indsamlet af forskerne er meget lovende, de kan variere afhængigt af det anvendte datasæt eller en klassifikators specifikke anvendelse, derfor er de endnu ikke generaliserbare. I fremtiden, deres undersøgelse kunne informere udviklingen af andre klassifikatorer, der er bedre rustet mod modstridende angreb, uden at give væsentlige tab i ydeevne (dvs. genkendelsesnøjagtighed).

"At lære robuste funktioner er et åbent problem, og vi har stadig ikke en klar idé om, hvordan vi skal løse det korrekt; det bliver undersøgt af vores forskerhold, og nogle resultater vil snart blive frigivet, " sagde Esmaeilpour. "I mellemtiden, vi arbejder på en ny, stærk og hurtig modstridende angrebsteknik, der sigter mod at bruge dette angreb til kontradiktorisk at træne læringsmodellen (hvilket forbedrer dens robusthed) og også gemme modellens genkendelsesydelse, før den trænes."

© 2019 Science X Network

Varme artikler

Varme artikler

-

Forskere opdager sikkerhedsfejl i udbredte datalagringsenhederKredit:Radboud Universitet Forskere ved Radboud University i Holland har opdaget, at meget brugte datalagringsenheder med selvkrypterende drev ikke giver det forventede niveau af databeskyttelse.

Forskere opdager sikkerhedsfejl i udbredte datalagringsenhederKredit:Radboud Universitet Forskere ved Radboud University i Holland har opdaget, at meget brugte datalagringsenheder med selvkrypterende drev ikke giver det forventede niveau af databeskyttelse. -

Australske byer halter bagefter med at grønnere deres bygningerGrønne tage er gode sociale rum. Kredit:Forfatter oplyst At dække tag og vægge i bygninger med vegetation er en god måde at reducere drivhusgasemissioner. Og disse grønne tage og vægge får byer ti

Australske byer halter bagefter med at grønnere deres bygningerGrønne tage er gode sociale rum. Kredit:Forfatter oplyst At dække tag og vægge i bygninger med vegetation er en god måde at reducere drivhusgasemissioner. Og disse grønne tage og vægge får byer ti -

Traditionelt japansk seglsystem hæmmer fjernarbejde for nogleDet personlige segl kendt som inkan eller hanko er stadig populært i Japan, og viser for nogle en hindring for fjernarbejde Nogle japanske kontorarbejdere står over for en lille, men uoverstigelig

Traditionelt japansk seglsystem hæmmer fjernarbejde for nogleDet personlige segl kendt som inkan eller hanko er stadig populært i Japan, og viser for nogle en hindring for fjernarbejde Nogle japanske kontorarbejdere står over for en lille, men uoverstigelig -

USA bør købe kontrol over Nokia, Ericsson kæmper mod Huawei:RigsadvokatDen amerikanske justitsminister Bill Barr siger, at USA bør overveje at tage en kontrollerende andel af Nokia og/eller Ericsson for at bekæmpe dominansen af ny 5G-telekommunikationsteknologi fra Kin

USA bør købe kontrol over Nokia, Ericsson kæmper mod Huawei:RigsadvokatDen amerikanske justitsminister Bill Barr siger, at USA bør overveje at tage en kontrollerende andel af Nokia og/eller Ericsson for at bekæmpe dominansen af ny 5G-telekommunikationsteknologi fra Kin

- Den illegale skildpaddehandel - hvorfor videnskabsmænd holder på hemmeligheder

- Brande bringer klimadrevet hjem til at genoverveje, hvor – og hvordan – vi bor

- En mulig forklaring på, hvordan kimlinjer forynges

- Løsning af plastikmanglen med en ny kemisk katalysator

- Hormese og paradoksale effekter i planter ved eksponering for formaldehyd er almindelige fænomener

- Et NASA infrarødt kig på Tropical Depression 02W, advarsler indsendt