Teamet tager et trin op i systemet, der lærer robotten at udføre en opgave

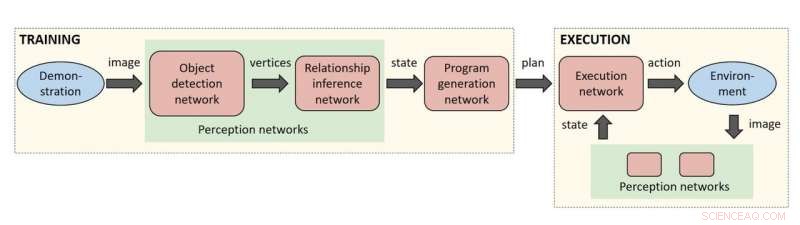

En beskrivelse af, hvordan metoden fungerer:Et kamera henter et live video feed af en scene, og positionerne og forholdet mellem objekter i scenen udledes i realtid af et par neurale netværk. De resulterende opfattelser føres til et andet netværk, der genererer en plan for at forklare, hvordan man genskaber disse opfattelser. Endelig, et udførelsesnetværk læser planen og genererer handlinger til robotten, under hensyntagen til verdens nuværende tilstand for at sikre robusthed over for eksterne forstyrrelser. Kredit:NVIDIA

NVIDIA-forskere er gået i gang med at lære en robot at udføre en opgave ved – her er kickeren – blot at observere et menneskes handlinger. Netværk blev trænet som beskrevet i en video. Systemet blev testet i den virkelige verden på et pick-and-place-problem med at stable farvede terninger, og de brugte en Baxter -robot.

Et team med seks forfattere diskuterede dette arbejde, "Syntetisk uddannede neurale netværk til læring af menneskelæsbare planer fra virkelige demonstrationer." Deres succes involverede en robot, der var i stand til at lære en opgave fra en enkelt demonstration i den virkelige verden.

Hvorfor det betyder noget:Planlæggere udforsker spørgsmål om, hvordan mennesker vil arbejde sammen med robotter – hvor sikkert og effektivt kan dette gøres? Forfatterne udtrykte det klart. "For at robotter kan udføre nyttige opgaver i virkelige indstillinger, det skal være nemt at kommunikere opgaven til robotten; dette inkluderer både det ønskede slutresultat og eventuelle hints om det bedste middel til at opnå dette resultat."

Frederic Lardinois i TechCrunch vejede ind:"Industrielle robotter handler typisk om at gentage en veldefineret opgave igen og igen. Normalt, det betyder at udføre disse opgaver i sikker afstand fra de skrøbelige mennesker, der har programmeret dem. Mere og mere, imidlertid, forskere tænker nu over, hvordan robotter og mennesker kan arbejde i nærheden af mennesker og endda lære af dem. "

Lardinois sagde Dieter Fox, seniordirektør for robotforskning hos NVIDIA, fortalte ham, at holdet ønskede at aktivere denne næste generation af robotter, der sikkert kan arbejde tæt på mennesker. Robotter skal lære, hvordan de kan hjælpe mennesker, hvad enten det er i industrielle omgivelser eller i folks hjem.

Holdet viste et system til at udlede og udføre et menneskeligt læsbart program fra en demonstration i den virkelige verden.

NVIDIA Developer-webstedet sagde, at dette var det første af sin slags deep learning-system, der kan lære en robot at udføre en opgave blot ved at se et menneskes handlinger. "Med demonstrationer, en bruger kan kommunikere en opgave til robotten og give fingerpeg om, hvordan opgaven bedst udføres."

Deres system involverede en række neurale netværk. Hvordan de arbejdede:forskerne trænede en sekvens af neurale netværk til at udføre opgaver forbundet med perception, programgenerering og programudførelse.

Deres teknik:Et kamera fik et livevideofeed af en scene, hvor objekters positioner og forhold blev udledt i realtid af et par neurale netværk. Disse blev ført til et andet netværk, der genererede en plan for at forklare, hvordan man genskaber disse opfattelser. Et udførelsesnetværk læste planen og genererede handlinger for robotten.

Hvad adskiller deres udforskning fra tidligere forskning? En forskel ligger i træning af neurale netværk. Nuværende tilgange kræver store mængder mærkede træningsdata - en "alvorlig flaskehals i disse systemer, " sagde NVIDIA-siden.

I modsætning, "Med syntetisk datagenerering, en næsten uendelig mængde mærkede træningsdata kan produceres med meget lidt indsats."

Lardinois i TechCrunch kaldte deres forskning "et vigtigt skridt i denne overordnede rejse for at sætte os i stand til hurtigt at lære en robot nye opgaver."

I betragtning af det stærke visuelle aspekt ved denne træningsproces, han skrev, Nvidias baggrund i grafikhardware hjælper helt sikkert. TechSpot bemærkede, hvordan "At køre alle disse neurale netværk kræver nogle alvorlige beregningsmuligheder."

Forskerne brugte NVIDIA TITAN X GPU'er.

Jonathan Tremblay, Tak til, Artem Molchanov, Stephen Tyree, Jan Kautz, Stan Birchfield er holdet bag avisen.

© 2018 Tech Xplore

Varme artikler

Varme artikler

-

ID -tyveri stikker, men det er svært at fastgøre bestemte datahacksI denne tirsdag, 30. juli kl. 2019, fil foto, logoet for Capital One Financial vises over en handelspost på gulvet på New York Stock Exchange. Datalbrud gennem hackingangreb er almindelige i disse dag

ID -tyveri stikker, men det er svært at fastgøre bestemte datahacksI denne tirsdag, 30. juli kl. 2019, fil foto, logoet for Capital One Financial vises over en handelspost på gulvet på New York Stock Exchange. Datalbrud gennem hackingangreb er almindelige i disse dag -

Googles robot-spinoff lancerer ride-hailing-tjenesteDette udaterede billede leveret af Waymo viser dens selvkørende minivan. Googles selvkørende bil-spinoff er endelig klar til at forsøge at drage fordel af sin næsten årti gamle teknologi. Waymo introd

Googles robot-spinoff lancerer ride-hailing-tjenesteDette udaterede billede leveret af Waymo viser dens selvkørende minivan. Googles selvkørende bil-spinoff er endelig klar til at forsøge at drage fordel af sin næsten årti gamle teknologi. Waymo introd -

Apple buster Facebook for at distribuere datasugende appDenne 19. feb. 2014, filbillede viser Facebook-app-ikonet på en iPhone i New York. Apple siger, at det har forbudt en Facebook-fremstillet app, der betalte brugere, herunder teenagere, til omfattende

Apple buster Facebook for at distribuere datasugende appDenne 19. feb. 2014, filbillede viser Facebook-app-ikonet på en iPhone i New York. Apple siger, at det har forbudt en Facebook-fremstillet app, der betalte brugere, herunder teenagere, til omfattende -

737 MAX testflyvning endnu ikke planlagt:FAAEfter gentagne gange at misse sine mål for at genoptage flyvninger sidste år, Boeing sigter mod at vende tilbage i midten af 2020, men siger, at tidsrammen vil afhænge af tilsynsmyndigheder Der

737 MAX testflyvning endnu ikke planlagt:FAAEfter gentagne gange at misse sine mål for at genoptage flyvninger sidste år, Boeing sigter mod at vende tilbage i midten af 2020, men siger, at tidsrammen vil afhænge af tilsynsmyndigheder Der

- Undersøgelse giver et nyt syn på, hvordan karteller fungerer

- Vand ændrer, hvordan koboltbaseret molekyle gør kuldioxid til lovende kemikalie

- Hvorfor forbrugerne har brug for hjælp til at skifte til bæredygtige kostvaner

- Find undvigende partikler fra din telefon med Oxfords nye neutrino viewer -app

- De første COVID-19-lockdowns forbedrede luftkvaliteten. Hvor er vi et år senere?

- Virobot:Sådan siger du, at din pc er toast, på fransk?