Computerprogram ser fem minutter ud i fremtiden

Hvornår vil du gøre hvad? Prof. Jürgen Gall (til højre) og Yazan Abu Farha fra Institut for Datalogi ved Universitetet i Bonn. Kredit:Barbara Frommann/Uni Bonn

Dataloger fra universitetet i Bonn har udviklet software, der kan se et par minutter ud i fremtiden. Programmet lærer først den typiske rækkefølge af handlinger, såsom madlavning, fra videosekvenser. Baseret på denne viden, den kan så præcist forudsige i nye situationer, hvad kokken vil gøre på hvilket tidspunkt. Forskere vil præsentere deres resultater på verdens største konference om computersyn og mønstergenkendelse, som afholdes 19-21 juni i Salt Lake City, USA.

Den perfekte butler, som enhver fan af britisk socialt drama ved, har en særlig evne:Han fornemmer sin arbejdsgivers ønsker, før de overhovedet er blevet ytret. Prof. Dr. Jürgen Galls arbejdsgruppe ønsker at lære computere noget lignende:"Vi ønsker at forudsige timingen og varigheden af aktiviteter - minutter eller endda timer før de sker, " forklarer han.

En køkkenrobot, for eksempel, kunne derefter videregive ingredienserne, så snart de er nødvendige, forvarm ovnen i tide – og advar i mellemtiden kokken, hvis han er ved at glemme et forberedelsestrin. Den automatiske støvsuger ved i mellemtiden, at den ikke har noget at gøre i køkkenet på det tidspunkt, og i stedet tager sig af stuen.

Vi mennesker er meget gode til at forudse andres handlinger. For computere dog denne disciplin er stadig i sin vorden. Forskerne ved Institute of Computer Science ved universitetet i Bonn er nu i stand til at annoncere en første succes:De har udviklet selvlærende software, der kan estimere timingen og varigheden af fremtidige aktiviteter med forbløffende nøjagtighed i perioder på flere minutter.

Træningsdata:fire timers salatvideoer

De træningsdata, som forskerne brugte, omfattede 40 videoer, hvor kunstnere tilbereder forskellige salater. Hver af optagelserne var omkring 6 minutter lang og indeholdt i gennemsnit 20 forskellige handlinger. Videoerne indeholdt også præcise detaljer om, hvornår handlingen startede, og hvor lang tid det tog.

Computeren "så" disse salatvideoer på i alt omkring fire timer. Denne måde, algoritmen lærte, hvilke handlinger der typisk følger hinanden under denne opgave, og hvor længe de varer. Dette er på ingen måde trivielt:Når alt kommer til alt, hver kok har sin egen tilgang. Derudover rækkefølgen kan variere afhængigt af opskriften.

"Så testede vi, hvor vellykket læringsprocessen var, " forklarer Gall. "Til dette konfronterede vi softwaren med videoer, som den ikke havde set før." De nye kortfilm passede i hvert fald ind i konteksten:De viste også tilberedningen af en salat. Til testen, computeren fik at vide, hvad der vises i de første 20 eller 30 procent af en af de nye videoer. På dette grundlag skulle den så forudsige, hvad der ville ske i resten af filmen.

Det fungerede fantastisk godt. Gall:"Nøjagtigheden var over 40 procent for korte prognoseperioder, men faldt så, jo mere algoritmen skulle se ind i fremtiden." For aktiviteter, der var mere end tre minutter i fremtiden, computeren havde stadig ret i 15 procent af tilfældene. Imidlertid, prognosen blev kun betragtet som korrekt, hvis både aktiviteten og dens timing var korrekt forudsagt.

Gall og hans kolleger ønsker, at undersøgelsen kun skal forstås som et første skridt ind i det nye felt af aktivitetsforudsigelse. Især da algoritmen klarer sig mærkbart dårligere, hvis den selv skal genkende, hvad der sker i den første del af videoen, i stedet for at blive fortalt. Fordi denne analyse aldrig er 100 procent korrekt - Gall taler om "støjende" data. "Vores proces fungerer med det, " siger han. "Men desværre ikke nær så godt."

Varme artikler

Varme artikler

-

Togo lancerer ny energiordning med fokus på vedvarende energiTogos ambitiøse elektrificeringsstrategi vil medføre store investeringer i solenergi, herunder brugen af individuelle solpanelsæt til fjerntliggende husstande som disse, der bruges i Uganda Togo

Togo lancerer ny energiordning med fokus på vedvarende energiTogos ambitiøse elektrificeringsstrategi vil medføre store investeringer i solenergi, herunder brugen af individuelle solpanelsæt til fjerntliggende husstande som disse, der bruges i Uganda Togo -

Demokraterne løfter sløret for et lovforslag om at genoprette USA's netneutralitetHusets formand, Nancy Pelosi (C) og andre demokratiske lovgivere taler på en pressekonference, hvor de afslører et lovforslag, der vil genoprette USAs beskyttelse af netneutralitet, som blev vendt i 2

Demokraterne løfter sløret for et lovforslag om at genoprette USA's netneutralitetHusets formand, Nancy Pelosi (C) og andre demokratiske lovgivere taler på en pressekonference, hvor de afslører et lovforslag, der vil genoprette USAs beskyttelse af netneutralitet, som blev vendt i 2 -

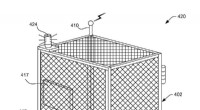

Amazon har patenteret et system, der ville sætte arbejdere i et bur, oven på en robotKredit:U.S. Patent and Trademark Et patent, som Amazon har modtaget, vil parre mennesker og maskiner. I dette tilfælde, mennesker ville være i et bur. Illustrationer, der ledsager patentet, som b

Amazon har patenteret et system, der ville sætte arbejdere i et bur, oven på en robotKredit:U.S. Patent and Trademark Et patent, som Amazon har modtaget, vil parre mennesker og maskiner. I dette tilfælde, mennesker ville være i et bur. Illustrationer, der ledsager patentet, som b -

Dødelige kampe fortsætter med at ramme videospilGuillame Bruner, senior producer (L) og Gabrielle Schrager, Narrative director fra Ubisoft Montpellier introducerer nye spil til publikum ved Ubisoft E3 2018 mediebriefing forud for Electronic Enterta

Dødelige kampe fortsætter med at ramme videospilGuillame Bruner, senior producer (L) og Gabrielle Schrager, Narrative director fra Ubisoft Montpellier introducerer nye spil til publikum ved Ubisoft E3 2018 mediebriefing forud for Electronic Enterta

- Team demonstrerer et stort løfte om helt uorganiske perovskit-solceller til forbedring af solcellee…

- Jeg vil have sne til jul:Studerende kræver klimaindsats

- Virkelige anvendelser af Pythagorean Theorem

- Shape-shifting plankton:Hvordan plankton klarer turbulens

- Elbilrevolutionen har et synlighedsproblem

- Fracking kan forårsage social stress i nærliggende områder, ifølge forskning