Et kig inde i neurale netværk

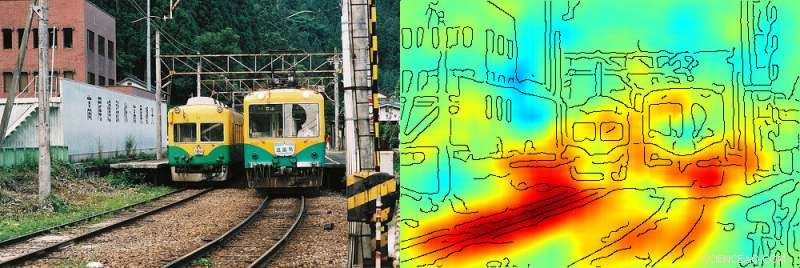

Her klassificerer AI -systemet et billede som et tog, fordi spor er til stede. Kredit:Fraunhofer HHI

Kunstig intelligens (AI) er allerede fast forankret i vores hverdag og erobrer mere og mere territorium. For eksempel, stemmeassistenter er allerede en hverdagsting i mange menneskers smartphones, biler og boliger. Fremskridt inden for kunstig intelligens er primært baseret på brugen af neurale netværk. Efterligne funktionaliteten af den menneskelige hjerne, neurale netværk forbinder matematisk definerede enheder med hinanden. Men tidligere vidste man ikke, hvordan et neuralt netværk tager beslutninger. Forskere ved Fraunhofer Institute for Telecommunications, Heinrich Hertz Institut, HHI og Technische Universität Berlin har udviklet en teknologi, der afslører de kriterier, AI-systemer bruger, når de træffer beslutninger. Den innovative Spectral Relevance Analysis (SpRAy) metode baseret på Layer-wise Relevance Propagation-teknologi giver et første kig ind i den "sorte boks."

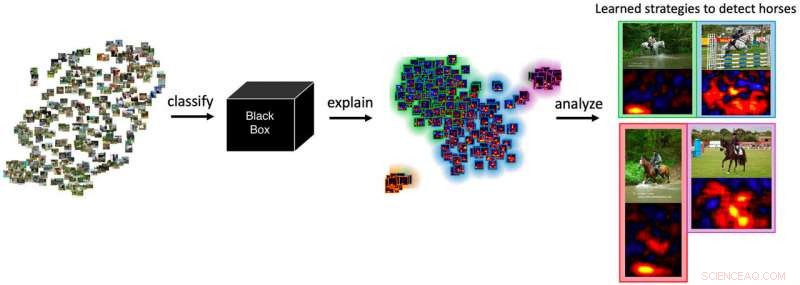

I dag er det næsten umuligt at finde et område, hvor kunstig intelligens er irrelevant, om det er i fremstilling, reklame eller kommunikation. Mange virksomheder bruger lærings- og netværksbaserede AI -systemer, for eksempel at generere præcise efterspørgselsprognoser og præcist at forudsige kundeadfærd. Denne tilgang kan også bruges til at justere regionale logistikprocesser. Sundhedsvæsenet bruger også specifikke AI -aktiviteter, såsom prognosegenerering på basis af strukturerede data. Dette spiller for eksempel en rolle i billedgenkendelse:Røntgenbilleder indlæses i et AI-system, som derefter udsender en diagnose. Korrekt registrering af billedindhold er også afgørende for autonom kørsel, hvor trafikskilte, træer, fodgængere og cyklister skal identificeres med fuldstændig nøjagtighed. Og det er sagens kerne:AI-systemer skal levere absolut pålidelige problemløsningsstrategier i følsomme anvendelsesområder som medicinsk diagnostik og i sikkerhedskritiske områder. Imidlertid, tidligere har det ikke været helt klart, hvordan AI -systemer træffer beslutninger. Desuden, forudsigelserne afhænger af kvaliteten af inputdataene. Forskere ved Fraunhofer Institute for Telecommunications, Heinrich Hertz Instituttet, HHI og Technische Universität Berlin har nu udviklet en teknologi, Layer-wise Relevance Propagation (LRP), hvilket gør AI -prognoserne forklarelige og dermed afslører upålidelige strategier for problemløsninger. En videreudvikling af LRP -teknologi, kaldet Spectral Relevance Analysis (SpRAy), identificerer og kvantificerer et bredt spektrum af indlært beslutningsadfærd og identificerer dermed uønskede beslutninger selv i enorme datasæt.

Gennemsigtig AI

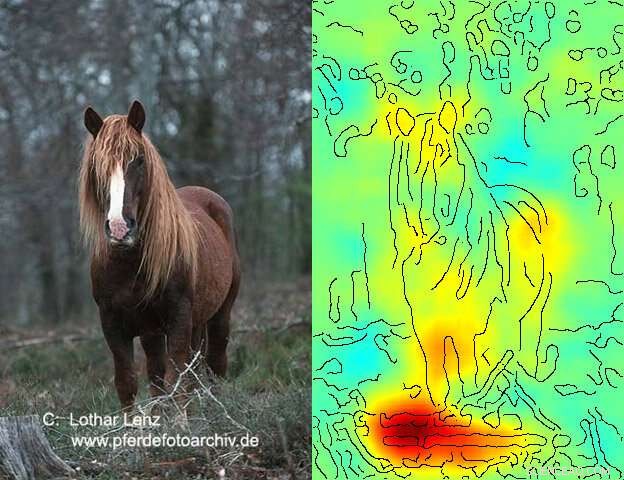

Her tildeler AI-systemet billedet til den korrekte kategori baseret på copyright-banneret. Alligevel, løsningsstrategien er mangelfuld. Kredit:Fraunhofer HHI

I praksis identificerer teknologien de enkelte inputelementer, der er blevet brugt til at forudsige. Således f.eks. når et billede af en vævsprøve indlæses i et AI-system, påvirkningen af hver enkelt pixel kvantificeres i klassificeringsresultaterne. Med andre ord, samt forudsige, hvor "malignt" eller "godartet" det afbildede væv er, systemet giver også oplysninger om grundlaget for denne klassificering. "Ikke kun formodes resultatet at være korrekt, løsningsstrategien er også. I fortiden, AI-systemer er blevet behandlet som sorte bokse. Systemerne blev betroet til at gøre de rigtige ting. Med vores open-source software, der anvender lagvis vis relevansformering, det er lykkedes os at gøre løsningsfindingsprocessen for AI-systemer gennemsigtig, "siger Dr. Wojciech Samek, leder af forskningsgruppen "Machine Learning" ved Fraunhofer HHI. "Vi bruger LRP til at visualisere og fortolke neurale netværk og andre maskinlæringsmodeller. Vi bruger LRP til at måle indflydelsen fra hver inputvariabel i den overordnede forudsigelse og analysere de beslutninger, klassifikatorerne har taget, " tilføjer Dr. Klaus-Rob-ert Müller, Professor for maskinlæring ved TU Berlin.

Upålidelige løsningstrategier

At stole på resultaterne af neurale netværk betyder nødvendigvis at forstå, hvordan de fungerer. Ifølge forskerholdets test, AI-systemer anvender ikke altid de bedste strategier for at nå frem til en løsning. For eksempel, et velkendt AI-system klassificerer billeder baseret på kontekst. Den tildelte fotografier til kategorien "skib", når en stor mængde vand var synlig på billedet. Det løste ikke selve opgaven med at genkende billeder af skibe, selvom det i de fleste tilfælde valgte de rigtige billeder ud. "Mange AI -algoritmer bruger upålidelige strategier og når frem til meget upraktiske løsninger, "siger Samek, opsummerer resultaterne af undersøgelserne.

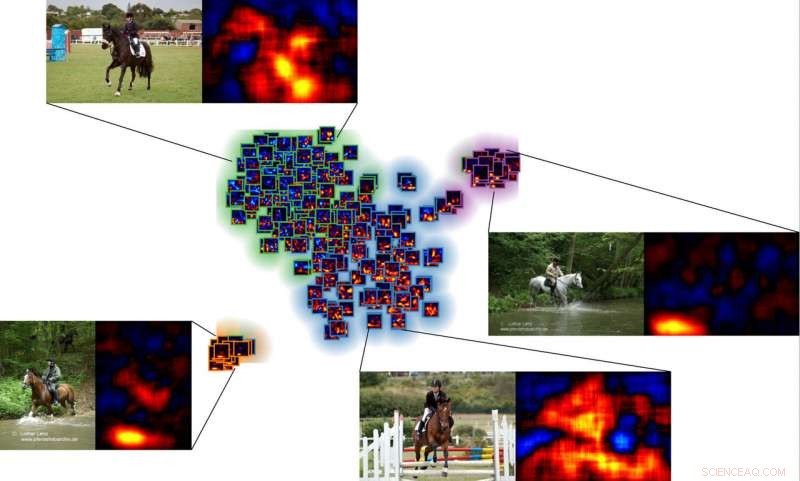

Den nye spektralmæssige relevansanalyse-teknologi gør synlige kriterier synlige for AI-systemer, når de træffer beslutninger. Kredit:Fraunhofer HHI

At se neurale netværk tænke

LRP-teknologien afkoder funktionaliteten af neurale netværk og finder ud af, hvilke karakteristiske egenskaber der bruges, for eksempel at identificere en hest som en hest og ikke som et æsel eller en ko. Det identificerer de oplysninger, der flyder gennem systemet på hver node i netværket. Dette gør det muligt at undersøge selv meget dybe neurale netværk.

Forskergrupperne fra Fraunhofer HHI og TU Berlin er i øjeblikket ved at formulere nye algoritmer til undersøgelse af yderligere spørgsmål for at gøre AI -systemer endnu mere pålidelige og robuste. Projektpartnerne har offentliggjort deres forskningsresultater i tidsskriftet Naturkommunikation .

Lagmæssig relevansudbredelse giver et kig inde i den "sorte boks". Kredit:Fraunhofer HHI

AI, maskinlæring og meget mere

Kunstig intelligens beskæftiger sig med udviklingen af systemer, der uafhængigt kan løse problemer og handle analogt med mønstre af menneskelig tanke og adfærd. På nuværende tidspunkt gøres de største fremskridt inden for maskinlæring, et underfelt af AI. Maskinindlæring omhandler metoder til udtrækning af viden fra data og uafhængige læringskontekster indeholdt i dataene. Fremgangen er et resultat af at bruge kunstige neurale netværk baseret på forbindelser mellem matematiske beregningsenheder, der i princippet efterligner den menneskelige hjernes neurale struktur. Et underområde for maskinlæring, dyb læring, dækker en klasse af nye procedurer, der gør det muligt at undervise og træne komplekse kunstige neurale netværk. Disse netværk består af et stort antal niveauer, der er forbundet med hinanden i strukturer med mange lag.

Sidste artikelSamsung kan ende i fransk domstol på grund af etiske løfter:NGO'er

Næste artikelOpbygning af tillid til kunstig intelligens

Varme artikler

Varme artikler

-

Intels neuromorfe system surfer næste bølge i hjerneinspireret forskningEt nærbillede viser Loihi, Intels neuromorfe forskningschip. Intels seneste neuromorfe system, Pohoiki Strand, vil bestå af 64 af disse Loihi -chips. Pohoiki Beach blev introduceret i juli 2019. Kredi

Intels neuromorfe system surfer næste bølge i hjerneinspireret forskningEt nærbillede viser Loihi, Intels neuromorfe forskningschip. Intels seneste neuromorfe system, Pohoiki Strand, vil bestå af 64 af disse Loihi -chips. Pohoiki Beach blev introduceret i juli 2019. Kredi -

Læs dette før du installerer udvidelser til din webbrowserKredit:CC0 Public Domain Da Amazon for nylig tilbød at betale Prime-medlemmer $10 for at downloade sin Assistant-browserudvidelse, Jeremy Tillman, der kører den ad-blokerende software Ghostery, la

Læs dette før du installerer udvidelser til din webbrowserKredit:CC0 Public Domain Da Amazon for nylig tilbød at betale Prime-medlemmer $10 for at downloade sin Assistant-browserudvidelse, Jeremy Tillman, der kører den ad-blokerende software Ghostery, la -

Undersøgelse:Sundhedsindustrien er værst til at beskytte forbrugerdata, føderale regering er beds…Kredit:CC0 Public Domain Den føderale regering er bedst til at beskytte forbrugerdata, og sundhedssektoren er den værste, ifølge en ny undersøgelse foretaget af non-profit Internet Societys Online

Undersøgelse:Sundhedsindustrien er værst til at beskytte forbrugerdata, føderale regering er beds…Kredit:CC0 Public Domain Den føderale regering er bedst til at beskytte forbrugerdata, og sundhedssektoren er den værste, ifølge en ny undersøgelse foretaget af non-profit Internet Societys Online -

Apple fjerner eller begrænser apps til styring af skærmtidKredit:CC0 Public Domain Apples fjernelse af næsten et dusin apps, der hjælper brugere med at administrere skærmtid, rejser spørgsmål om virksomhedens dominans og dens forpligtelse til at hjælpe f

Apple fjerner eller begrænser apps til styring af skærmtidKredit:CC0 Public Domain Apples fjernelse af næsten et dusin apps, der hjælper brugere med at administrere skærmtid, rejser spørgsmål om virksomhedens dominans og dens forpligtelse til at hjælpe f

- En overraskende ny sommerfuglefisk er beskrevet fra den filippinske tusmørkezone og udstilling

- Forklarende UFO'er

- Videnskabelige Fair Projekter for Middle School 8th Grade

- Planter og dyr i Stillehavet

- Hvordan det sprog, du taler, stemmer overens med din genetiske oprindelse og kan påvirke forskninge…

- Global opvarmning vil få økosystemer til at producere mere metan end først forudsagt